Clear Sky Science · sv

YOLO-DC för fordonsdetektion med deformbara konvolutionsnätverk och tvär-kanals koordinat-uppmärksamhet

Varför det är avgörande att upptäcka fordon med kameror

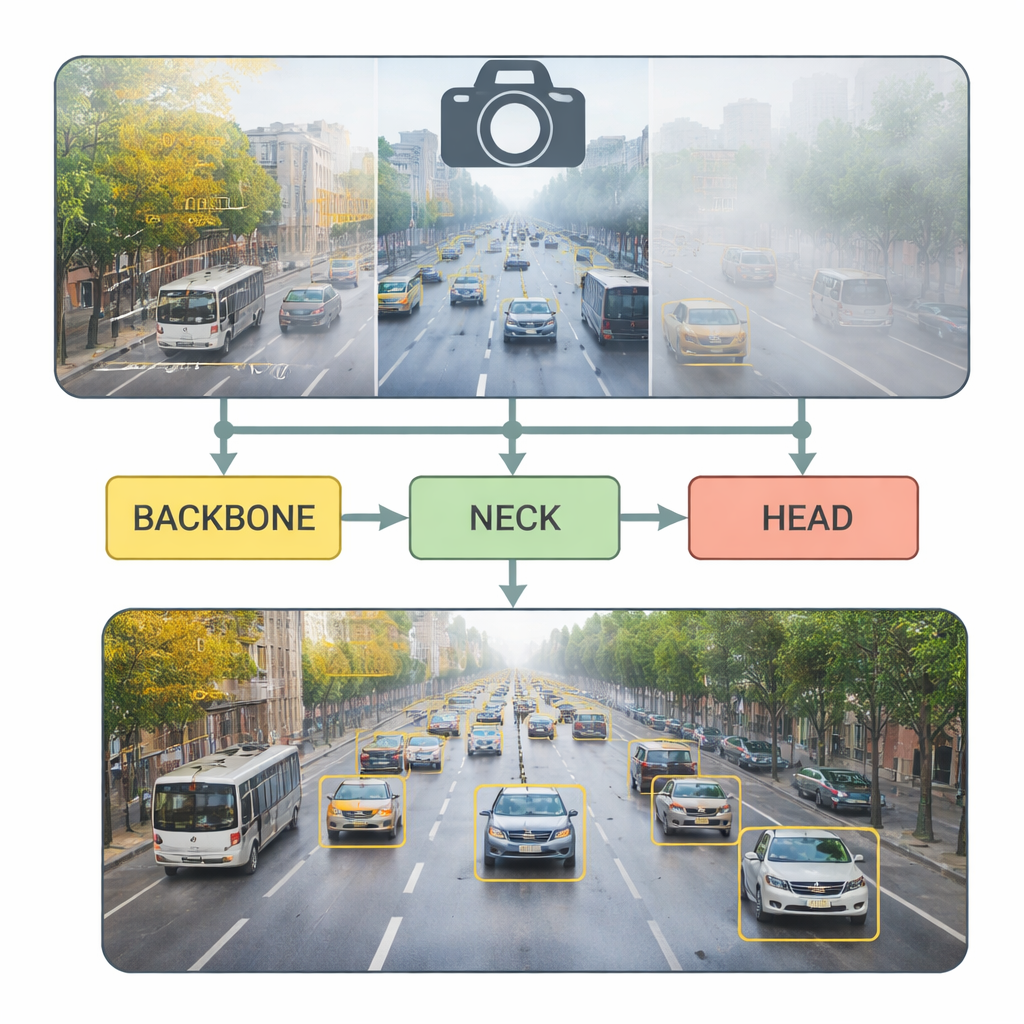

Moderna städer förlitar sig på kameror som övervakar trafikerade vägar, hjälper till att hantera köer och banar väg för självkörande fordon. Men att pålitligt identifiera varje fordon i kameraflöden är förvånansvärt svårt, särskilt när bilar är små i fjärran, delvis dolda i köer eller suddiga av regn, dimma eller mörker. Denna artikel presenterar YOLO‑DC, ett nytt datorseendesystem som syftar till att upptäcka bilar, bussar och andra fordon snabbt och noggrant, även i röriga verkliga förhållanden och på enheter med begränsad beräkningskapacitet.

Trafikproblemet bakom forskningen

Växande städer står inför överfyllda vägar, fler olyckor och ökade utsläpp. Smarta transportsystem lovar hjälp genom att övervaka trafiken i realtid och vägleda både mänskliga och autonoma förare. Kärningrediensen är snabb, pålitlig fordonsdetektion i video. Tidigare "tvåstegs"-algoritmer skannar bilder i flera omgångar och kan vara mycket exakta, men är ofta för långsamma för realtidsbruk på vägkameror eller i fordon. Nyare "enstegs"-system, som YOLO ("You Only Look Once")-familjen, byter en del komplexitet mot mycket högre hastighet, vilket gjort dem populära i praktiken. De har dock fortfarande problem med små, överlappande fordon och med hårt väder som döljer detaljer. YOLO‑DC bygger vidare på den senaste YOLOv8-modellen och omformar dess inre lager för att bättre hantera dessa utmaningar.

Hur YOLO‑DC ser mer med smartare fokus

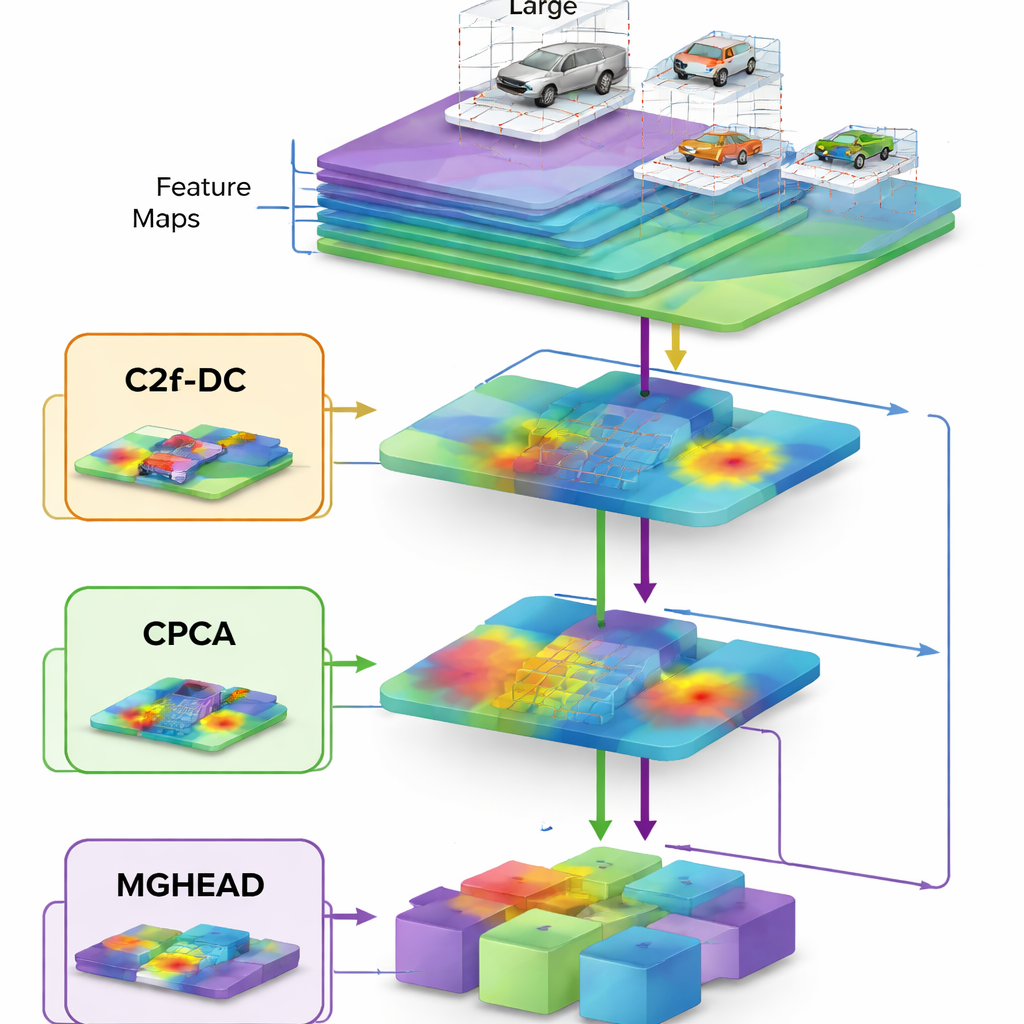

I hjärtat av YOLO‑DC finns ett omarbetat "backbone"-nätverk, den del som först omvandlar råa bilder till abstrakta kännetecken. Författarna introducerar en mekanism kallad tvär‑kanals koordinat-uppmärksamhet, som effektivt lär nätverket inte bara var i bilden det ska titta utan också vilka typer av visuella mönster som förtjänar mer vikt. I kombination med så kallade deformbara konvolutioner — filter som kan böja sitt samplingmönster för att följa snedställda eller ovalt formade fordon — kan detta backbone bättre anpassa sig till bilar sedda i olika vinklar, skalor och positioner. Istället för att behandla varje vägfläck lika lär sig systemet att betona de karaktäristiska konturer och texturer som skiljer riktiga fordon från byggnader, träd eller vägmarkeringar.

Fånga små och avlägsna fordon utan att sakta ner

Modellens mittdel, känd som neck, ansvarar för att sammanföra information från grova, utskalade vyer med fina, närbildsdetaljer. YOLO‑DC uppgraderar detta steg på två sätt. För det första hjälper en kanal‑prioritetsuppmärksamhetsmodul nätverket att undertrycka brus och framhäva subtila ledtrådar från små fordon långt borta i bildrutan. För det andra minskar ett omdesignat block inspirerat av den lättviktiga FasterNet-arkitekturen antalet operationer genom att tillämpa fullständiga konvolutioner på endast en del av datan och sedan blanda det effektivt. Denna noggranna omdesign minskar både antalet parametrar och mängden minnestrafik, vilket gör att modellen körs snabbare samtidigt som den faktiskt förbättrar noggrannheten — en ovanlig men mycket önskvärd kombination för kant-enheter som trafik kameror och inbyggda fordonsdatorer.

Se fordon i många storlekar och i dåligt väder

Det sista skedet, eller head, bestämmer var objekten är och vad de är. YOLO‑DC introducerar multiskaliga grupperade konvolutioner här, genom att dela upp feature-maps i flera kanaler som var och en använder olika filterstorlekar innan de återkombineras. Detta ger detektorn en rikare känsla för skala, så att den kan känna igen stora bussar som fyller ramen, medelstora lastbilar och små bilar knappt synliga i fjärran, samtidigt. I omfattande tester på UA‑DETRAC-datasetet, som innehåller vägscener under molnigt, soligt, regnigt och nattliga förhållanden, matchade eller överträffade YOLO‑DC noggrannheten hos topprankade detektorer samtidigt som den använde bara en bråkdel av deras beräkning och körde hundratals bildrutor per sekund på modern hårdvara. På DAWN-datasetet, som är utformat särskilt för dimma, regn, snö och sandstormar, levererade den nya modellen särskilt stora förbättringar i kraftigt regn och tät dimma, där traditionella system ofta misslyckas.

Vad resultaten betyder för vardagliga vägar

För icke-experter är huvudbudskapet att YOLO‑DC är bättre på att "se" verklig trafik som den faktiskt ser ut: trång, rörig och ofta skymd av dåligt väder eller dålig belysning. Genom att kombinera flexibla filter som följer fordonsformer med uppmärksamhetsmekanismer som fokuserar på de mest informativa regionerna upptäcker systemet fler fordon, missar färre och kör tillräckligt snabbt för livevideanalys på modest hårdvara. Det gör det till en lovande byggsten för smartare trafikstyrning, mer tillförlitlig olycksövervakning och säkrare autonom körning — samtidigt som bearbetningskostnaderna hålls tillräckligt låga för bred utplacering över stadsgator och i framtida fordon.

Citering: Liu, Z., Zhu, M., Gao, B. et al. YOLO-DC for vehicle detection using deformable convolutional networks and cross-channel coordinate attention. Sci Rep 16, 6284 (2026). https://doi.org/10.1038/s41598-026-37094-w

Nyckelord: fordonsdetektion, intelligent transport, YOLO, ofördelaktigt väder, real-tidsvision