Clear Sky Science · sv

Tolkningdrift i förklarbar AI vid etikettbrus

Varför AI-förklaringar tyst kan gå fel

Många förlitar sig numera på artificiell intelligens inte bara för svar, utan för skälen bakom dem: Varför nekades ett lån? Varför flaggade ett system en patient som högrisk? Den här studien visar att även när ett AI-modells noggrannhet ser lugnande stabil ut kan berättelsen om varför den fattade ett beslut driva kraftigt om träningsdatan innehåller fel. Denna gömda förskjutning i förklaringar — som författarna kallar ”tolkningsdrift” — kan vilseleda yrkespersoner som förlitar sig på AI för att motivera viktiga beslut.

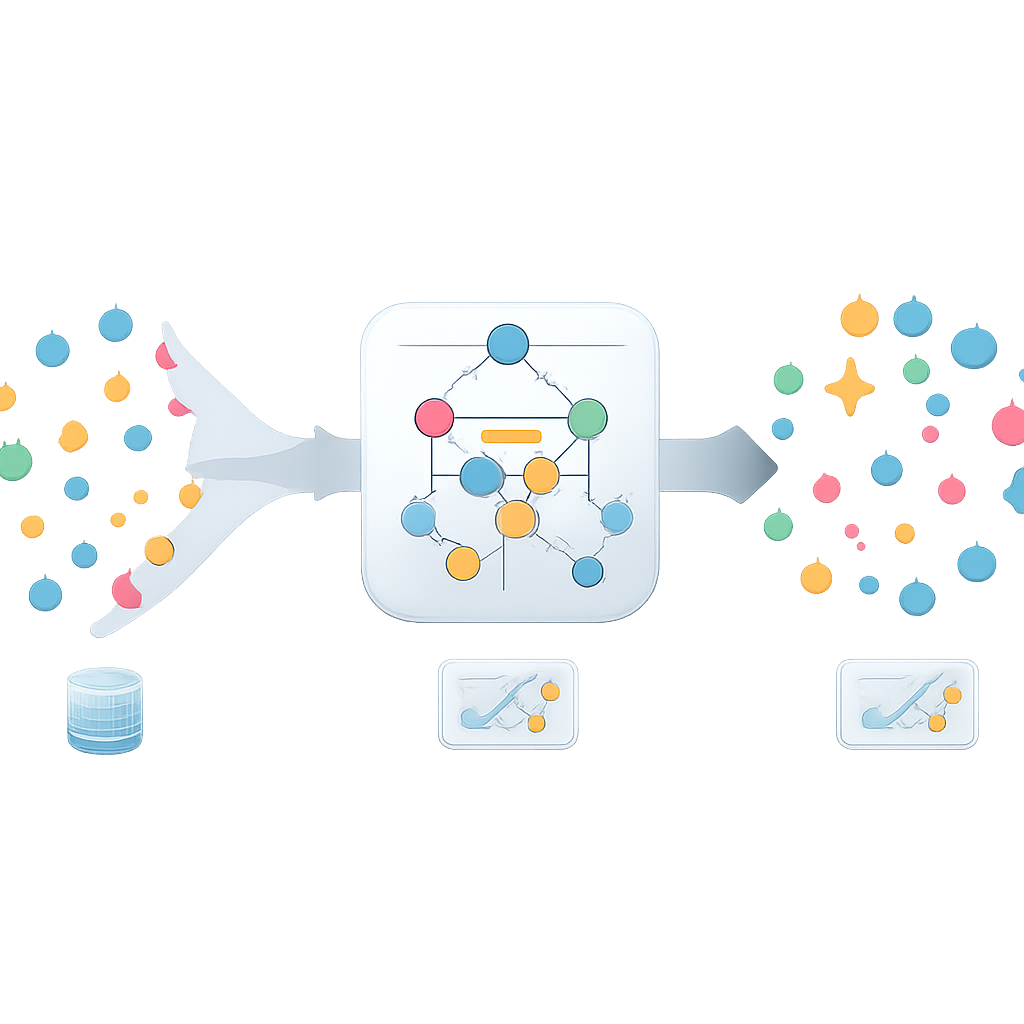

När rena data möter röriga etiketter

De flesta moderna AI-system är ”svarta lådor” som ger förutsägelser utan tydliga skäl. För att göra AI mer genomskinlig använder många tillämpningar regelbaserade modeller som liknar mänskligt om–så-resonemang: till exempel ”om blodtrycket är högt och ålder över 60, då är risken hög.” Dessa regelsamlingar är särskilt attraktiva inom känsliga områden som sjukvård, juridik och finans, där användare behöver granska och lita på logiken. Men verkliga data är sällan perfekta. Ett vanligt problem är etikettbrus — fall där det påstådda ”rätta svaret” i träningsdatan är fel, som en felregistrerad diagnos eller ett felmärkt kundutfall. Medan etikettbrus är känt för att skada prediktiv kvalitet har dess inverkan på stabiliteten i AI-förklaringar inte studerats systematiskt.

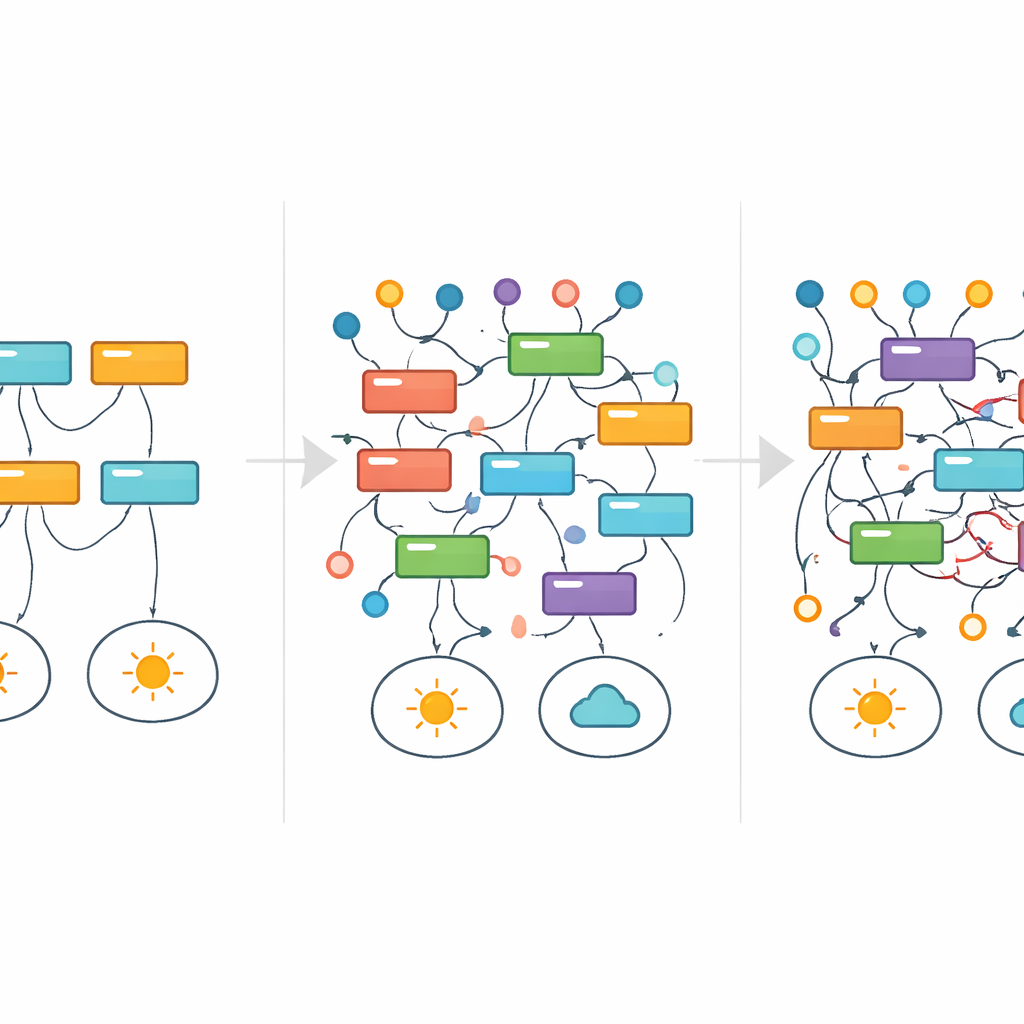

Test av hur förklaringar håller ihop under brus

Författarna utvärderade hur robusta regelbaserade förklaringar förblev när etiketter gradvis korruptades. De använde fyra olika datamängder från sjukvård, bankverksamhet, leversjukdom och till och med talteori, alla uppställda som ja–nej-prediktionsuppgifter. Tre regelinlärningsmetoder jämfördes: två populära, snabba algoritmer (IREP och RIPPER) och ett mer beräkningsintensivt tillvägagångssätt kallat Human Knowledge Models (HKM), som uttryckligen syftar till att producera mycket enkla, människolika regelsamlingar. För varje metod tränade forskarna modeller upprepade gånger samtidigt som de slumpmässigt vände en växande andel av träningsetiketterna — från nästan perfekt rena data hela vägen till nära-komplett nonsens. De följde två saker parallellt: hur väl modellerna fortfarande förutsade på en ren testuppsättning, och hur mycket de lärda reglerna ändrades jämfört med dem från brusfria data.

Stabil noggrannhet, logik i flöde

Vid första anblicken kunde resultaten få användare att känna en falsk trygghet. Vid måttliga brusnivåer, särskilt med HKM-metoden, verkade den prediktiva prestationen relativt stabil när den mättes med det vanliga F1-värdet. Men en närmare granskning av regelsamlingarna berättade en annan historia. Med hjälp av ett likhetsmått som jämför samlingar av regler fann författarna att även blygsamma mängder etikettbrus snabbt eroderade överlappningen mellan de ursprungliga och brusiga förklaringarna. Med andra ord kan modellen fortfarande ha rätt i många fall, men av alltmer olika skäl. Mer komplexa regelsamlingar var särskilt sköra: när antalet villkor i en regel ökade kunde små förändringar i datan lättare klyva eller ersätta dessa regler, vilket accelererade förlusten av tolkningsstabilitet.

Följa regler när de dyker upp och försvinner

För att visualisera hur individuella förklaringar överlever eller misslyckas när bruset ökar lånade forskarna ett verktyg från medicinen: överlevnadsanalys. Istället för att följa patienters överlevnad över tid följde de hur länge en viss regel fortsatte att förekomma bland de bästa modellerna när etikettbruset ökade. Istället för att varsamt tona bort flimrade många regler in och ut — ett tecken på att helt olika förklaringar kunde dominera vid olika brusnivåer, även för samma underliggande uppgift. I en enkel dataset om delbarhet av tal, till exempel, ersattes rena och matematiskt korrekta regler gradvis av bredare approximationer och slutligen av invecklade, till synes godtyckliga mönster som ändå passade de korrupta etiketterna. Genom stora delar av denna process signalerade inte de övergripande prestationsmåtten klart att något var fel.

Vad detta betyder för dem som förlitar sig på AI

Huvudbudskapet är att ”pålitlig” AI inte kan bedömas enbart utifrån noggrannhet. Även modeller som presenterar sin logik i människoläsbara regler kan tyst ändra sitt resonemang när de etiketter de lär av är ofullkomliga — vilket är precis situationen i de flesta verkliga databaser. Författarna menar att utvecklare och tillsynsmyndigheter bör behandla förklaringsstabilitet som ett krav av första rang, jämte noggrannhet och rättvisa. Nya mått som direkt mäter hur konsekventa en modells förklaringar förblir under brus, och verktyg som varnar användare för tolkningsdrift, blir väsentliga om vi vill ha AI-system vars berättelser om världen är lika pålitliga som deras prediktioner.

Citering: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

Nyckelord: förklarbar AI, etikettbrus, modelltolkbarhet, regelbaserade modeller, tolkningsdrift