Clear Sky Science · sv

Utvärdering av sårbarheter i gångsystems genom PPO och GAN-genererade adversariella attacker

Varför det spelar roll att lura gångmönster

De flesta av oss känner igen vänner och familj på deras gångsätt, även på avstånd. Datorer kan nu göra något liknande: "gångigenkänning"system analyserar en persons gångstil för att identifiera dem utan fingeravtryck eller ansiktsavläsning. Dessa verktyg används i allt större utsträckning inom säkerhet och övervakning. Denna studie ställer en oroande fråga: hur lätt är det att lura sådana system med små, noggrant utformade förändringar som människor inte kan märka — men som maskiner kan? Svaret har stora konsekvenser för integritet, säkerhet och hur mycket vi kan lita på artificiell intelligens i sammanhang med höga insatser.

Hur datorer läser vårt gångsätt

Modern gångigenkänning bygger på djuplärande, samma familj av tekniker som ligger bakom ansiktsigenkänning och självkörande bilar. Istället för att titta på en enda bildruta kombinerar dessa system många rutor av en gående person till en enda "gait energy image", en slags suddig siluett som fångar hur kroppsdelar rör sig över en hel stegcykel. Ett specialbyggt neuralt nätverk lär sig sedan att skilja en persons gång från en annans, även när kläder eller föremål som bärs förändras. I tester på två stora forskningsdatabaser med gångvideor (CASIA-B och OU-ISIR) identifierade författarnas basmodell korrekt personer i mer än 97 % av fallen — en stark prestation som kan ge intrycket att tekniken är redo för verklig användning.

De osynliga klistermärkena som lurar smarta kameror

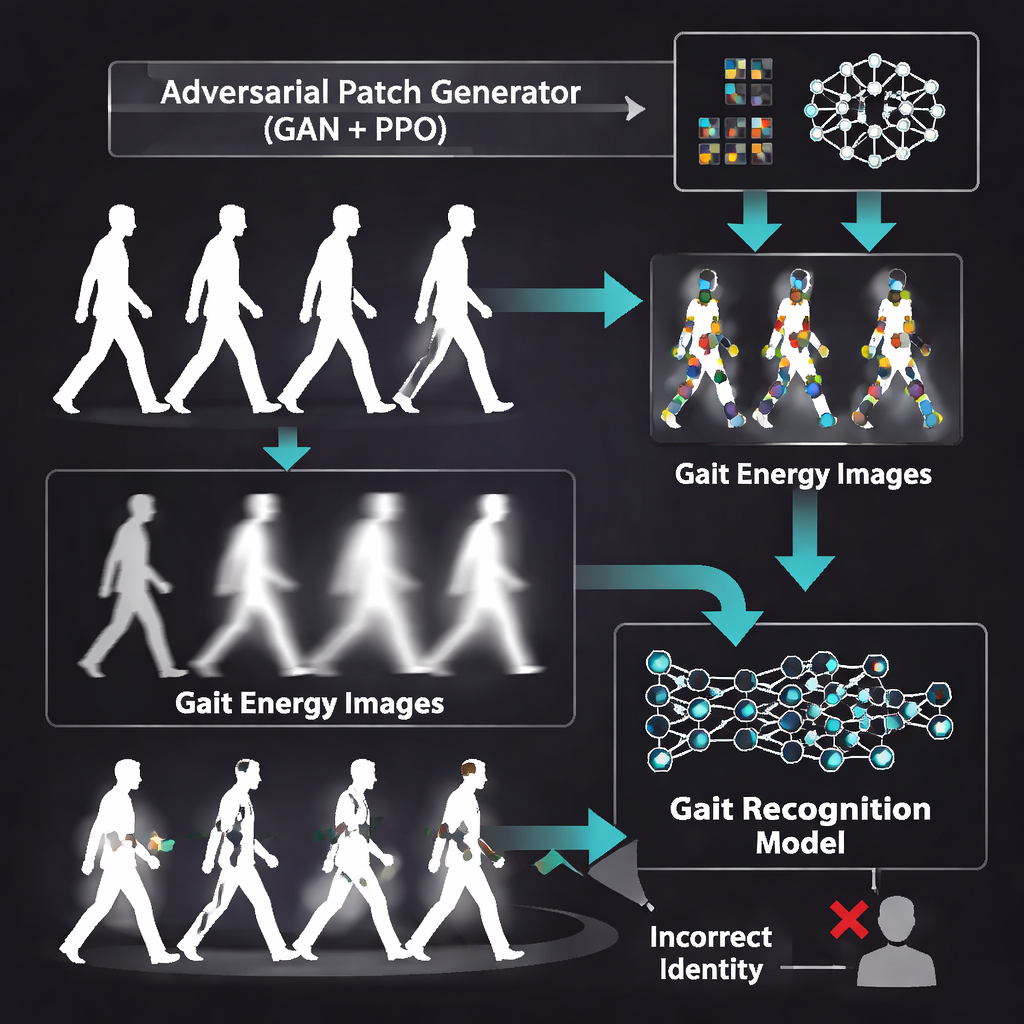

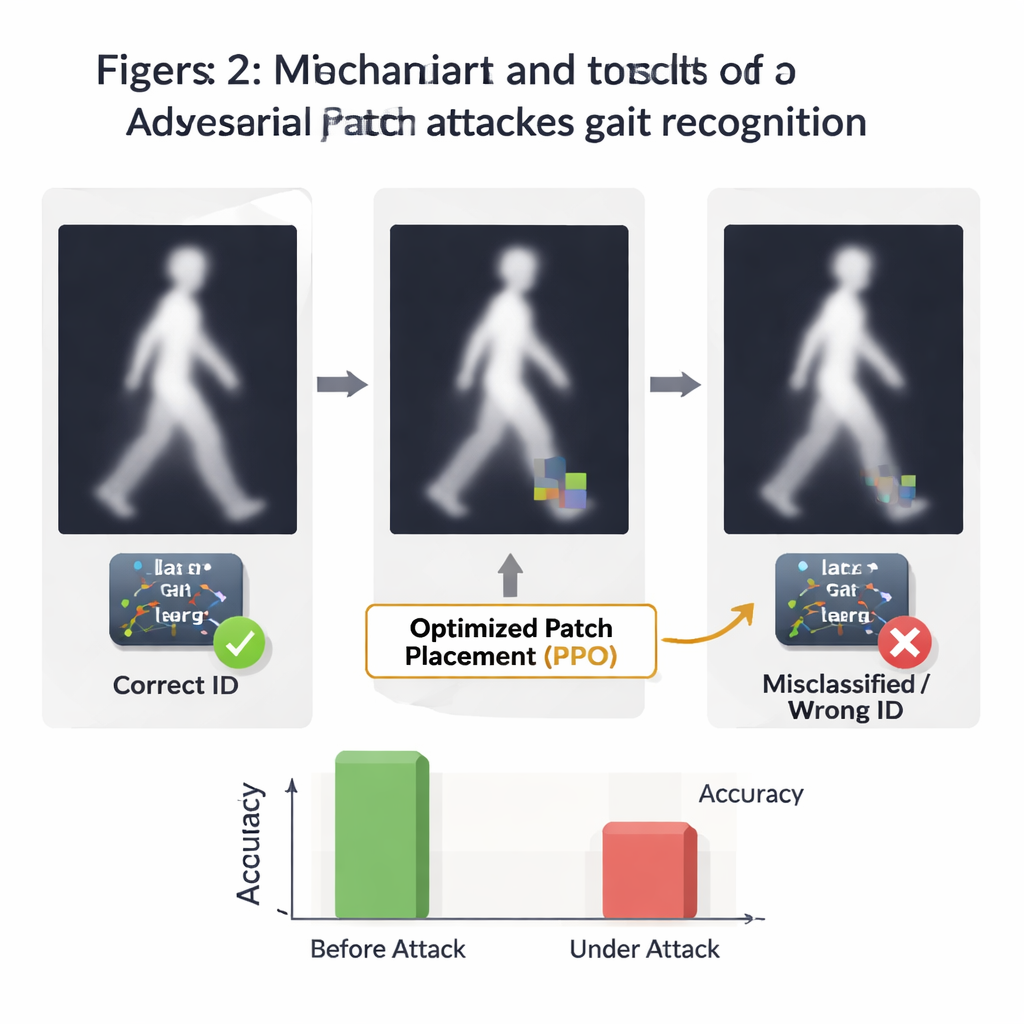

Hjärtpunkten i artikeln är inte att bygga ett bättre id-system, utan att avsiktligt bryta det för att blottlägga svagheter. Forskarna genererar små "adversariella patchar" — kvadratiska områden med förändrade pixlar som ser harmlösa ut, men som matematiskt är finjusterade för att förvirra det neurala nätverket. För att skapa dessa patchar använder de ett Generative Adversarial Network (GAN), en typ av AI som lär sig producera realistiskt utseende bilder genom att tävla mot en inbyggd kritiker. GAN:en tränas direkt på gait energy images så att dess utdata smälter naturligt in i de spöklika siluetterna. Dessa patchar är utformade för att vara så subtila att en människa som hastigt ser på gångmönstret troligtvis inte skulle märka något konstigt.

Låta en inlärande agent hitta svaga punkter

Var en patch placeras kan spela lika stor roll som hur den ser ut. För att upptäcka de mest skadliga positionerna vänder sig författarna till en förstärkningsinlärningsmetod kallad Proximal Policy Optimization (PPO). De behandlar varje gångbild som en rutnätsformad miljö och låter en mjukvaru"agent" flytta patchen — upp, ner, vänster eller höger — samtidigt som den observerar hur mycket igenkänningssystemets säkerhet minskar. När en position får modellen att feltolka personen belönas agenten; när den misslyckas straffas den. Över många episoder lär sig agenten en policy för att placera patchar i särskilt sårbara regioner av gaitbilden, ofta nära rörliga kroppsdelar som modellen förlitar sig mest på.

Vad som händer när attacken släpps lös

Efter att ha tränat både patchgeneratorn och placeringsstrategin attackerar teamet sin egen högpresterande gångigenkännare. Under normala förhållanden visar systemet utmärkt noggrannhet, få falska alarm och stark separation mellan korrekta och felaktiga träffar. När adversariella patchar läggs till sjunker dock prestandan kraftigt. Beroende på hur aggressivt patchen tillåts röra sig över bilden stiger attackframgångsfrekvenser över 60 %, och andelen korrekt identifierade personer kan falla till nära en tredjedel av sin ursprungliga nivå. Kurvor som tidigare visade nästan perfekt diskriminering mellan äkta användare och bedragare bågnar mot linjen för slumpmässig gissning, vilket avslöjar hur lätt modellen kan tryckas ur kurs utan synliga förvrängningar.

Vad detta betyder för vardaglig säkerhet

För icke-specialister är slutsatsen tydlig: ett gångigenkänningssystem som verkar mycket korrekt i laboratoriet kan vara förvånansvärt skört inför skicklig, maskindesignad manipulation. Studien visar att kombinationen av generativa bildverktyg och trial-and-error-inlärning kan frambringa små, nästintill osynliga förändringar som orsakar allvarliga identifieringsfel. Snarare än en handbok för verkligt missbruk är arbetet avsett som en varning och ett testningsramverk. Det ger systemdesigners ett sätt att pröva och mäta hur sårbara deras modeller är, och betonar behovet av att bygga skydd mot sådana attacker innan gångigenkänning får stort förtroende för övervakning, åtkomstkontroll eller andra kritiska tillämpningar.

Citering: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Nyckelord: gångigenkänning, biometrisk säkerhet, adversariella attacker, djuplärande, förstärkningsinlärning