Clear Sky Science · sv

Objektigenkänning på lågpresterande edge-SoC: ett reproducerbart benchmark och riktlinjer för distribution

Varför små kretsar för smarta kameror spelar roll

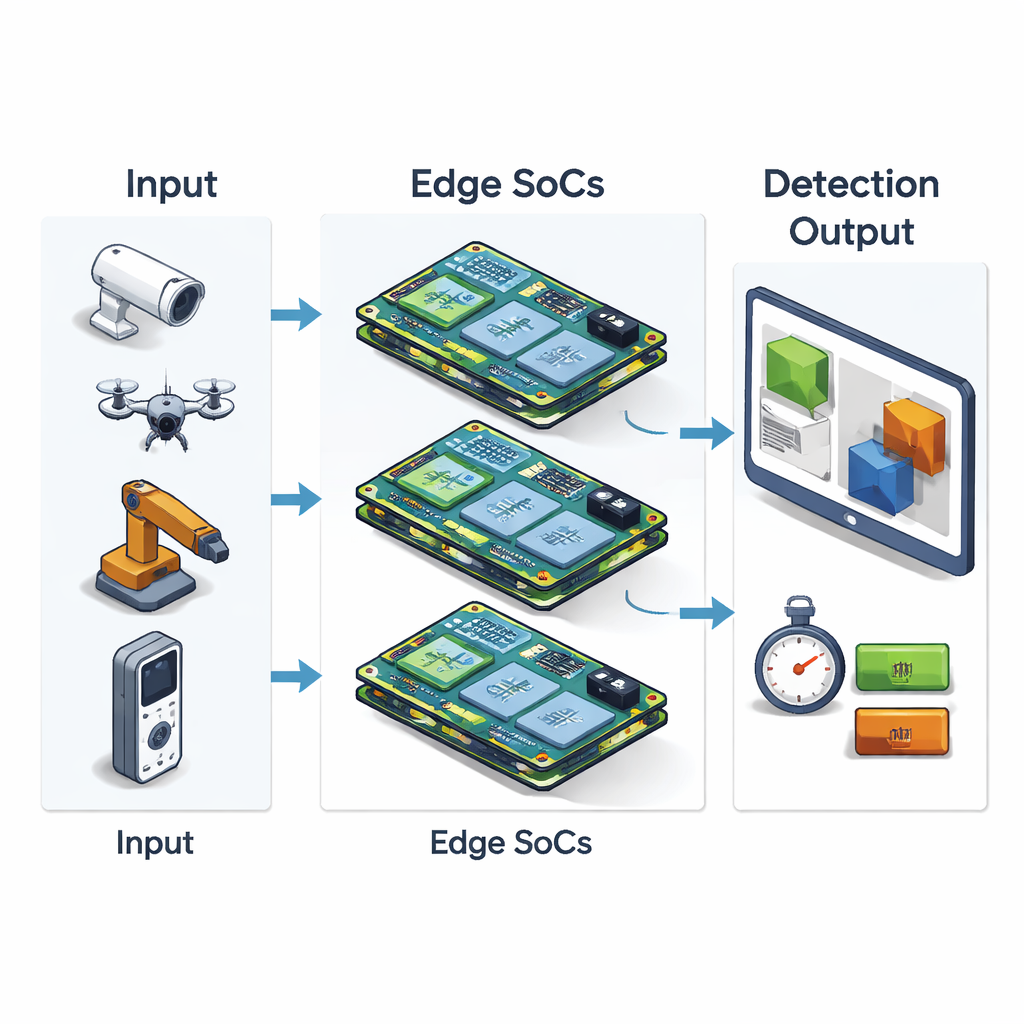

Många av de ”smarta” enheter runt oss – övervakningskameror, drönare, fabriksensorer och dörrklockor – måste känna igen människor och föremål i realtid, men förlitar sig på mycket små, strömsnåla kretsar i stället för energikrävande datacenter-hårdvara. Företag väljer ofta populära YOLO-modeller för objektigenkänning, men de uppgivna prestandasiffrorna för dessa kretsar säger lite om hur det verkligen fungerar i fält. Denna artikel gör en hård, experimentell granskning av hur nio moderna YOLO-varianter beter sig på tre välanvända, lågkostnads Rockchip-processorer och avslöjar vad som faktiskt styr hastighet, energianvändning och tillförlitlighet när intelligensen flyttas ut till edge.

Tre vardagliga kretsar under luppen

Författarna fokuserar på tre kommersiella system-on-chip (SoC) som tyst driver många system för inbyggd vision: den lilla RV1106, mellanmodellen RK3568 och den mer kapabelt RK3588. Var och en kombinerar vanliga processor‑kärnor med en dedikerad neural processningsenhet (NPU) och extern minnesanslutning. På dessa plattformar distribuerar teamet nio YOLO-modeller – tre generationer (YOLOv5, YOLOv8, YOLO11) i tre storlekar (Nano, Small, Medium) – alla tränade på samma benchmark-dataset. De konverterar modellerna till ett gemensamt format, kvantiserar dem till 8‑bitars aritmetik, kompilerar med Rockchips verktyg och kör hundratals tidmätta tester för att få stabila mätningar av fördröjning, effekt och energi per behandlad bildruta.

Hastighet är inte vad databladet antyder

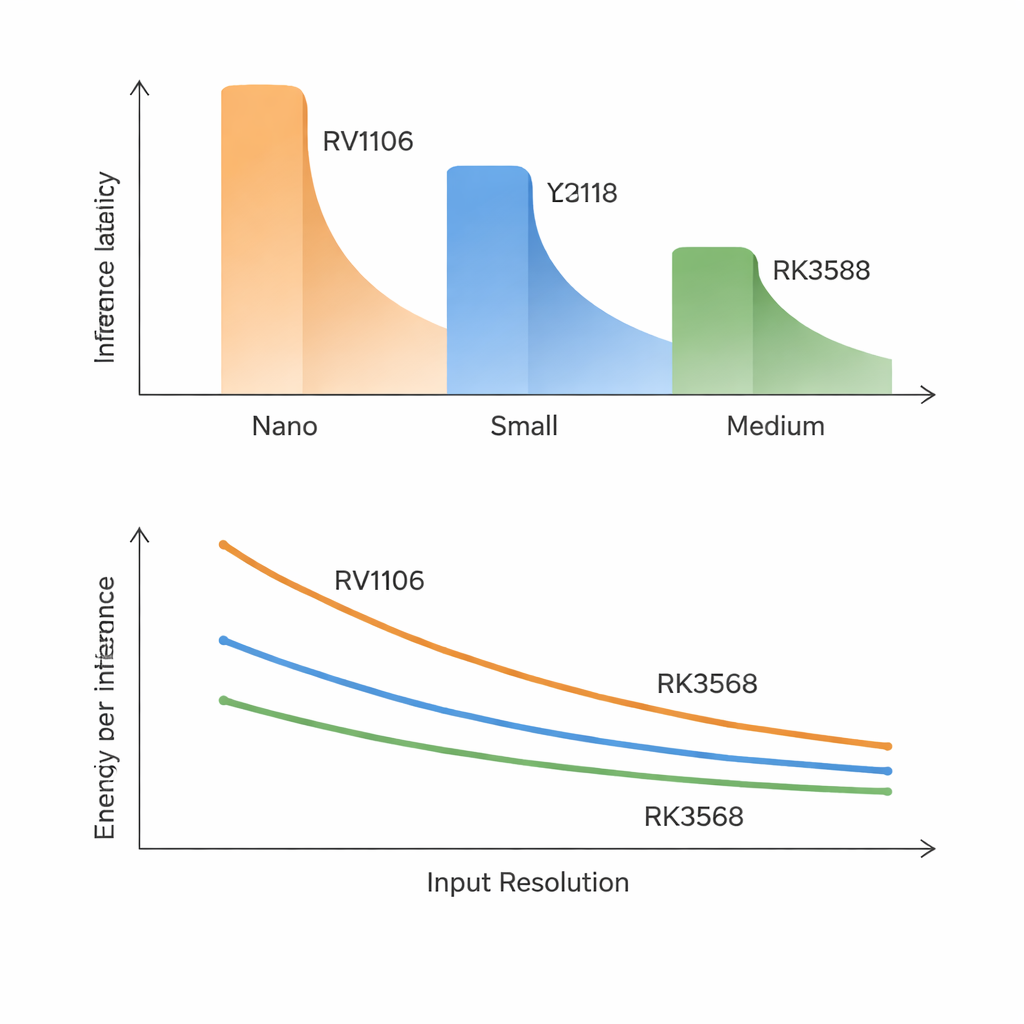

En av de tydligaste lärdomarna är att traditionella modell- och kretsmått är dåliga prognosverktyg för verklig hastighet. På den långsammaste kretsen tar till och med de minsta modellerna omkring 70–100 millisekunder per bildruta och medelstora modeller är långt ifrån lämpliga för verklig realtidsanvändning. Den snabbaste kretsen kan köra Nano‑ och många Small‑modeller nära 30 bilder per sekund, men större modeller når fortfarande inte mycket höga bildfrekvensmål. Förvånande nog korrelerar fördröjningen mer med modellens noggrannhet än med antalet matematiska operationer eller parametrar. Nyare, mer exakta YOLO‑arkitekturer lägger till interna block som förbättrar noggrannheten men som är svåra för dessa NPU:er att exekvera, så ”smartare” innebär ofta ”påtagligt långsammare” på sådan hårdvara.

När större bilder och delat minne slår tillbaka

Studien visar att att göra indata-bilder större inte bara ökar arbetsmängden jämnt. I teorin borde en fördubbling av bredd och höjd öka kostnaden fyra gånger, men på kretsar med låg bandbredd kan ökningen bli ännu större. När bilderna blir större får inte mellanliggande data plats längre och måste flyttas upprepade gånger till minnet utanför chipet. På de minsta och mellanliga SoC:erna blir detta en trafikstockning: medelstora modeller saktas ner mycket mer än väntat, och tung bakgrundsanvändning av minne från andra uppgifter kan öka fördröjningarna med 50–270 %. I kontrast hanterar RK3588 med betydligt högre minnesbandbredd upplösningsökningar smidigt och påverkas knappt av extra CPU- eller minneslast, vilket tydliggör att minneshastighet – inte rå beräkningskraft – ofta är den verkliga flaskhalsen.

Fler kärnor och mer effekt garanterar inte effektivitet

Rockchips snabbaste krets innehåller en NPU med tre kärnor, men att köra YOLO över flera kärnor ger endast blygsamma fördelar. För de flesta modeller minskar uppdelning över två eller tre kärnor fördröjningen med mindre än 10 %, och ibland försämras prestandan till och med. Överheaden för att koordinera kärnorna och dela samma minnespool äter upp mycket av den teoretiska vinsten. Effektmätningarna tillför en annan dimension: alla tre SoC:er drar bara några få watt under körning, men energin per behandlad bildruta kan skilja sig med en faktor tre. Den mer avancerade RK3588 använder mer effekt i varje ögonblick men blir klar så snabbt att den ofta visar sig vara det mest energieffektiva alternativet, särskilt för medelstora modeller och högre upplösningar.

Praktiska slutsatser för verkliga enheter

För läsare som funderar på smarta kameror, robotar eller IoT‑prylar är budskapet enkelt. På de minsta kretsarna är bara de allra minsta YOLO‑modellerna vid måttliga bildstorlekar praktiska, och även då är realtidsvideo svårnått. Mellannivåkretsar kan bekvämt stödja små modeller och ibland medelstora om bildfrekvens eller batteritid kan fås att vara mindre strikt. Den avancerade RK3588 gör det till sist realistiskt att köra mer precisa, medelstora YOLO‑varianter samtidigt som energin per bildruta hålls i schack. Genomgående argumenterar artikeln för att designers bör välja modeller med hårdvaran i åtanke, noggrant bevaka minnesbandbredden och föredra minnessnåla lösningar framför att jaga allt större nätverk. Vad som slutligen räknas är inte de uppgivna tera‑operationerna per sekund, utan om hela systemet kan leverera snabb, stabil och energieffektiv objektigenkänning under verklighetens stökiga förhållanden.

Citering: Kong, C., Li, F., Yan, X. et al. Object detection on low-compute edge SoCs: a reproducible benchmark and deployment guidelines. Sci Rep 16, 5875 (2026). https://doi.org/10.1038/s41598-026-36862-y

Nyckelord: edge AI, objektigenkänning, inbyggd vision, YOLO-modeller, lågeffekts-SoC