Clear Sky Science · sv

Sekantoptimeringsalgoritm för effektiv global optimering

Smartare sökningar för svåra problem

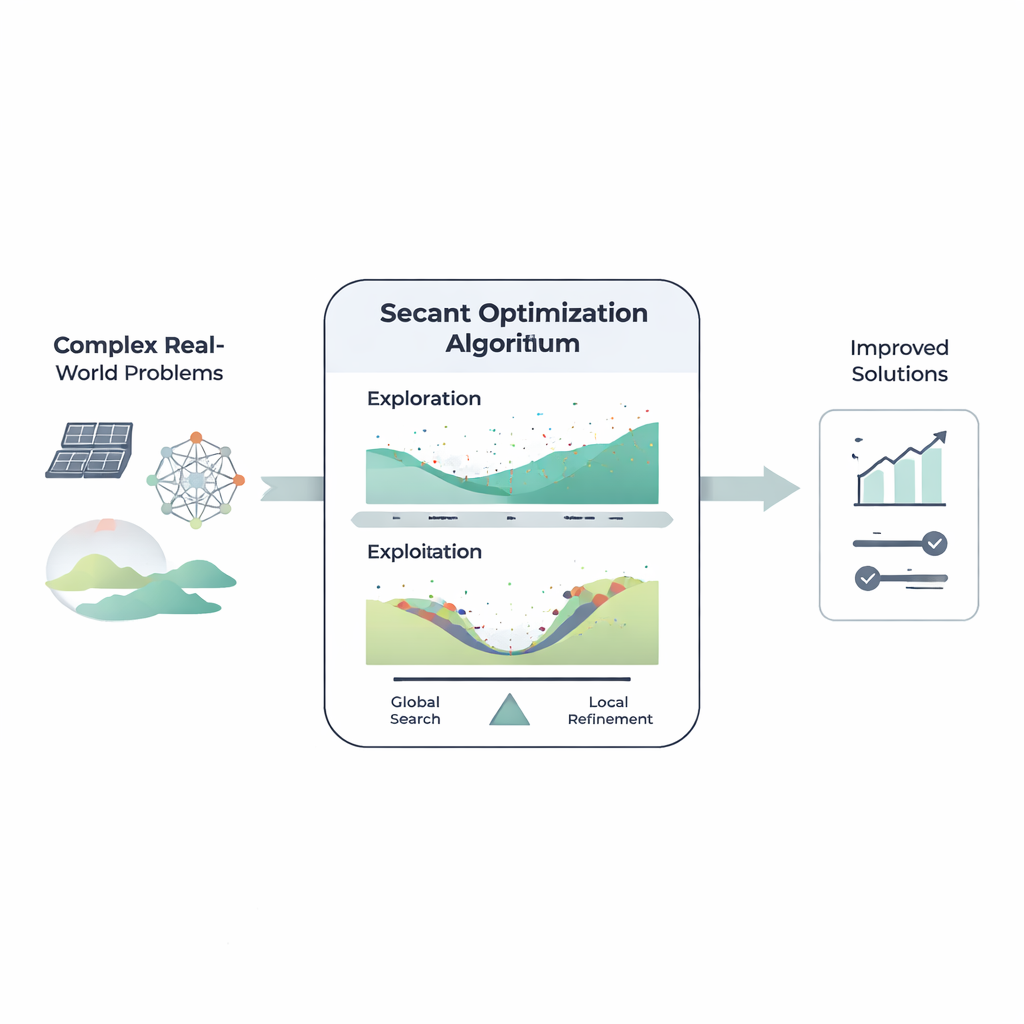

Från att utforma renare solpaneler till att träna exakta bildigenkänningssystem, kokar många av dagens utmaningar ner till samma uppgift: att söka i ett enormt möjlighetsrum för att hitta en bra lösning. Denna artikel introducerar Sekantoptimeringsalgoritmen (SOA), ett nytt sätt att genomföra den sökningen mer effektivt. Inspirerad av en klassisk idé från kalkyl men konstruerad för röriga, verkliga data, syftar SOA till att vara både snabb och pålitlig när traditionella metoder har svårt.

Varför optimering behöver nya idéer

Moderna ingenjörs- och datavetenskapsproblem involverar ofta dussintals eller hundratals inställningar att justera, flera mål och intrasslade relationer som är svåra att skriva som enkla formler. Klassiska tekniker som följer exakta gradienter, såsom brantaste nedstigning, kan misslyckas när landskapet är skrovligt, fullt av lokala fällor eller när derivator är svåra eller omöjliga att beräkna. Som svar har forskare utvecklat ”metaheuristiska” algoritmer som imiterar natur, fysik eller matematik för att utforska dessa svåra landskap. Dessa metoder, som genetiska algoritmer eller svärmoptimizerare, har visat sig vara anmärkningsvärt mångsidiga men står fortfarande inför avvägningar mellan att ströva brett och att zooma in precist.

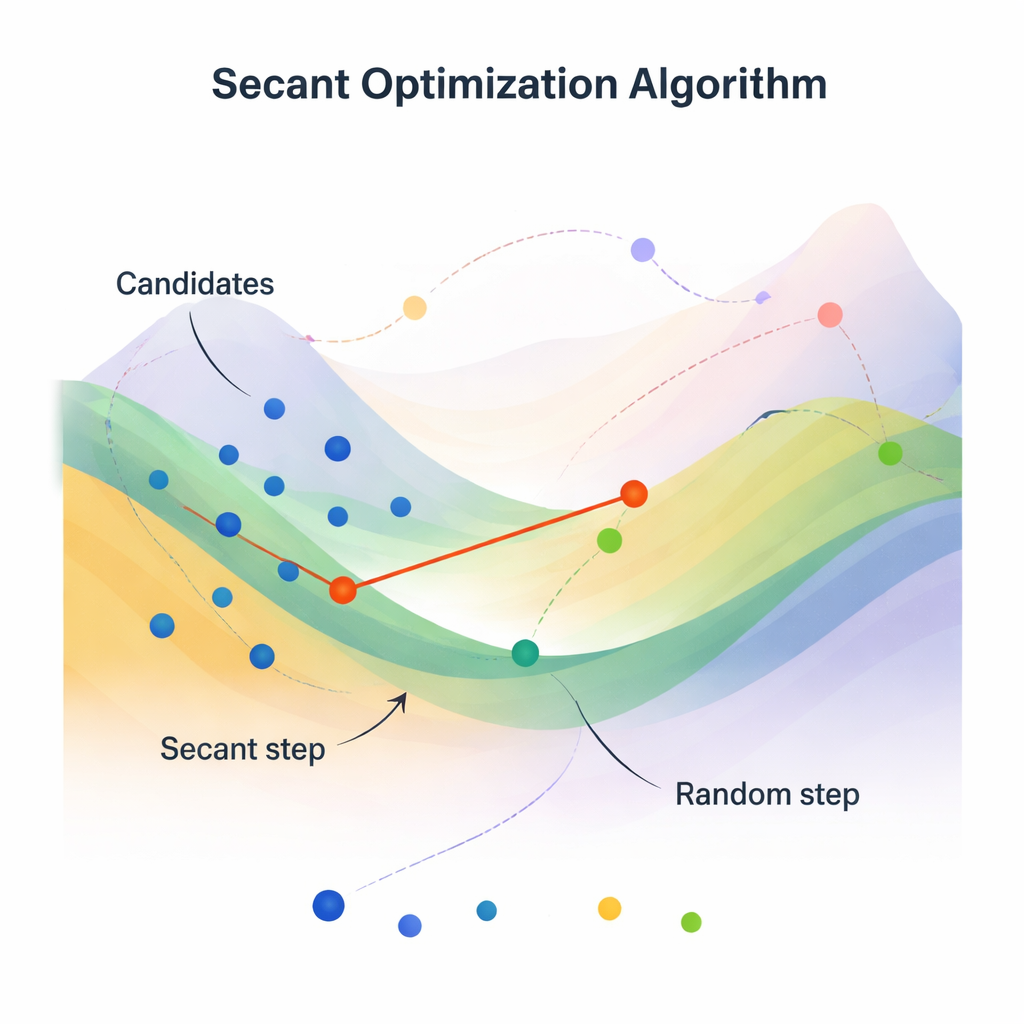

Att förvandla ett lärobokstrick till en sökmotor

Kärnan i SOA är sekantmetoden, ett gammalt numeriskt knep för att hitta var en kurva korsar noll utan att behöva exakta derivator. Istället för att använda en lutning beräknad från kalkyl drar sekantmetoden en rät linje mellan två närliggande punkter på kurvan och använder den linjen som en ungefärlig lutning. SOA generaliserar denna idé till många dimensioner och många kandidatlösningar samtidigt. Den håller en population av vektorer (möjliga svar) och uppdaterar dem upprepade gånger med sekantliknande steg som approximerar hur objektivfunktionen utvecklar sig, men endast utifrån funktionsvärden. Detta gör metoden attraktiv i situationer där gradienter är brusiga, dyra eller odefinierade, såsom vid justering av neurala nätverks hyperparametrar genom att titta på valideringsfel.

Att balansera bred utforskning med skarp fokusering

SOA:s utformning skiljer uttryckligen åt hur den utforskar och hur den förfinar. I utforskningsfasen justeras varje kandidat med en sekantbaserad regel som kombinerar information från den nuvarande bästa lösningen, den aktuella vektorn och en slumpmässigt utvald kamrat. Detta hjälper till att styra sökningen i riktningar som verkar lovande, utan att vara helt slumpmässig. I exploateringsfasen introducerar SOA en ”expansionsfaktor” och kontrollerad slumpmässighet. Den förflyttar lösningar mot den bästa, medelvärdet, den närmaste och till och med de längst bort i populationen, och blandar in slumpvandringar. En enkel mutationsregel behåller ibland en gammal position istället för den nya, vilket bevarar mångfalden. Tillsammans hjälper dessa mekanismer SOA att undkomma lokala fällor samtidigt som den inriktar sig mot högkvalitativa svar.

Testning på benchmarks och verkliga enheter

För att se om SOA är mer än en smart idé på papper testar författarna den på välanvända benchmark-familjer kända som CEC2021 och CEC2020. Dessa funktioner är designade för att vara krävande: vissa är lågdimensionella men fulla av falska minima; andra sträcker sig till 50 eller 100 dimensioner. I dessa tester jämförs SOA med två grupper av konkurrerande algoritmer, inklusive 11 matematikinspirerade metoder och 9 nyare eller variant-optimizerare. Med hjälp av statistik såsom medelfel, variationsbredd, konvergenskurvor och rangbaserade tester, matchar eller överträffar SOA konsekvent de flesta rivaler, särskilt vad gäller att snabbt och pålitligt nå bra lösningar. Författarna går sedan utöver syntetiska tester till två krävande verkliga uppgifter: att uppskatta nyckelparametrar i fotovoltaiska (PV) modeller och att automatiskt justera hyperparametrarna för konvolutionella neurala nätverk för flera bilddatamängder.

Från solpaneler till neurala nätverk

Inom solenergi är precisa modeller av PV-celler och moduler avgörande för att förutsäga produktion och optimera drift. Teamet tillämpar SOA på flera standard PV-modeller, inklusive enkeldiod, dubbeldiod och fullständiga modulbeskrivningar. Med mätta ström–spänningsdata justerar SOA modellparametrarna för att minimera fel och visar sig uppnå lägre eller jämförbart rotmedelkvadratfel än en rad etablerade optimizerare. I maskininlärningsexperiment används SOA för att finjustera arkitektur och träningsinställningar för ett konvolutionellt neuralt nätverk på MNIST och relaterade bilddatamängder. Där hittar algoritmen också hyperparameterkombinationer som ger konkurrenskraftiga eller bättre klassificeringsnoggrannheter jämfört med andra automatiserade sökstrategier.

Vad detta betyder i praktiken

För icke-specialister är huvudbudskapet att SOA erbjuder en praktisk ny ”sökmotor” för svåra optimeringsproblem där landskapet är skrovligt och gradienter inte finns tillgängliga. Genom att låna geometrin från sekantmetoden och inbädda den i en populationsbaserad sökning med välavvägd slump, konvergerar algoritmen ofta snabbare och mer precist än många nuvarande alternativ. Eftersom den är relativt enkel, derivatfri och kräver få inställningsparametrar, kan SOA kopplas in i en rad tillämpningar — från att utforma mer effektiva solenergisystem till att konfigurera djupa inlärningsmodeller — vilket gör den till ett lovande tillskott i verktygslådan för ingenjörer och dataforskare.

Citering: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Nyckelord: global optimering, metaheuristiska algoritmer, sekantoptimeringsalgoritm, fotovoltaisk modellering, justering av hyperparametrar