Clear Sky Science · sv

Realtidsdetektion av eld och rök med vision-transformers och spatiotemporalt lärande

Varför snabbare brandlarm spelar roll

Bränder i hem, fabriker och skogar kan bli dödliga på bara några minuter. Idag är många larm fortfarande beroende av värme- eller röksensorer som reagerar först när lågor redan är väl etablerade. Denna artikel beskriver ett nytt datorseendesystem som kan upptäcka tecken på eld och rök i kameraflöden nästan omedelbart, även under svåra förhållanden som svagt ljus eller kraftig dis. Genom att kombinera flera avancerade artificiell intelligens-tekniker i en enda modell vill forskarna ge brandkårer, stadsplanerare och miljömyndigheter ett mycket tidigare varningssignal — vilket potentiellt kan rädda liv, egendom och ekosystem.

Den växande utmaningen att upptäcka lågor

Moderna städer och skogar övervakas i allt högre grad med kameror, men att lära datorer att pålitligt känna igen eld och rök i bilder och videor är svårt. Traditionella metoder använder neurala nätverk som fungerar bra på stillbilder eller korta klipp, men de har ofta problem i röriga, verkliga scener. Ett enda ögonblicksbild kan visa något som ser ut som rök men som bara är dimma eller avgaser. System som är inriktade på video kan följa hur former rör sig över tid, men tenderar att vara långsamma och krävande för hårdvaran. Som ett resultat ger tidigare modeller ofta falsklarm eller missar subtila, snabbt föränderliga tecken på fara—särskilt i dåligt ljus, tät rök eller stökiga bakgrunder.

En hybrid AI-observatör för bilder och video

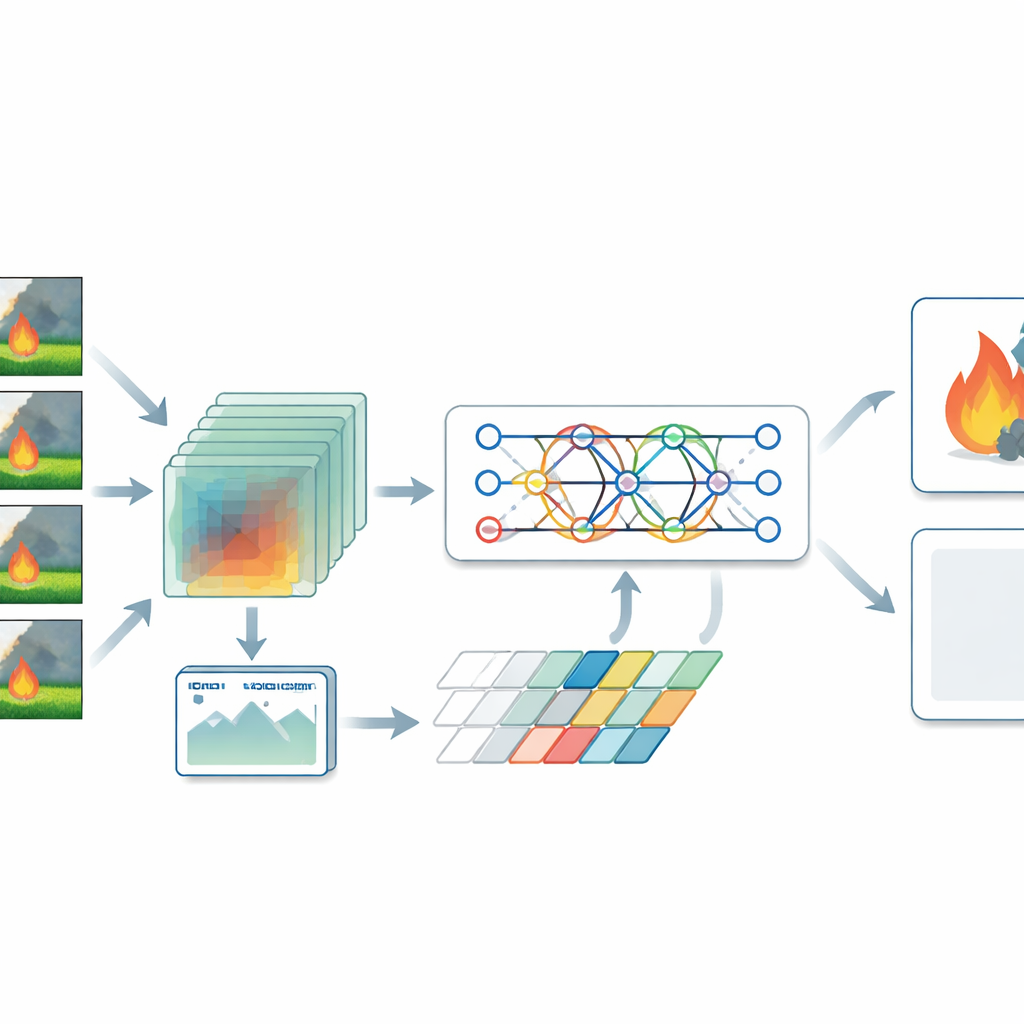

Författarna föreslår en hybridmodell som behandlar branddetektion både som ett rumsligt och ett tidsligt problem. För stillbilder använder de en typ av neuralt nätverk kallat vision-transformer, som ser en bild som ett lapptäcke av regioner och lär sig hur avlägsna områden relaterar till varandra. Det hjälper modellen att upptäcka breda mönster, såsom rökstråk som sprider sig över en dal eller lågor utspridda i en skog. För video förlitar sig systemet på ett tredimensionellt konvolutionellt nätverk som bearbetar staplar av ramar samtidigt och fångar hur rök och eld förändras över tid. En transformer-encoder granskar sedan dessa föränderliga mönster och riktar uppmärksamheten mot de ögonblick och områden som mest sannolikt indikerar fara, i stället för att ge lika vikt åt varje bildruta.

Att blanda ledtrådar och balansera datan

Ett nyckelsteg i systemet är ett fusionslager som blandar detaljerade ledtrådar från stillbilder med rörelsemönster från video. Genom att kombinera dessa kompletterande vyer kan modellen bättre skilja verkliga bränder från ofarliga efterliknelser som solblänk, dimma eller moln. Forskarna insåg också att många publika dataset innehåller betydligt fler exempel på brand än icke-brand, vilket kan göra att en modell överrapporterar lågor. För att motverka detta genererade de ett stort antal realistiska icke-brand-scener genom noggrann dataaugmentation—ändrade ljusstyrka, beskärning och spegling av bilder samt simulerade situationer som dimmiga morgnar eller dunkla interiörer. De tränade sedan modellen med en förlustfunktion som explicit balanserar fel på brand- och icke-brandfall, vilket förbättrar tillförlitligheten i vardagsbruk.

Att testa systemet

För att se hur väl deras metod fungerar testade författarna den på två väl använda dataset: ett med nästan tusen stillbilder från NASA Space Apps Challenge och ett annat med brandrelaterade videor från Kaggle. Efter förbehandling och balansering tränade och utvärderade de sin hybridmodell tillsammans med välkända baslinjer som ResNet, VGG, LSTM, rena 3D-konvolutionsnätverk och flera hybrida kombinationer av dessa äldre metoder. Det nya systemet nådde cirka 99,2 % noggrannhet på NASA-bilderna och 98,3 % på videodatasetet, och överträffade tydligt de traditionella modellerna som typiskt låg i mitten av 80- till mitten av 90-procentområdet. Det kördes också tillräckligt snabbt—tio- till tiotals millisekunder per bildruta—och med en måttlig modellstorlek, vilket gör det lämpligt för distribution på edge-enheter som små GPU:er och inbäddade kort.

Vad detta innebär för vardagssäkerhet

I praktiska termer visar denna forskning att en genomtänkt AI kan övervaka kameraflöden i realtid och pålitligt svara på en enkel men livsviktig fråga: ”Finns det eld eller farlig rök här just nu?” Genom att kombinera bred visuell kontext, rörelse över tid och smart uppmärksamhet på de mest talande detaljerna minskar hybridmodellen avsevärt både missade bränder och falsklarm. Med ytterligare finjustering och exponering för mer varierade scener—såsom täta stadsmiljöer, underjordiska utrymmen och extremt väder—kan den bli en praktisk stomme för smartare larmsystem, nätverk för övervakning av skogsbränder och industriella säkerhetsverktyg som reagerar snabbare och mer precist än många av dagens lösningar.

Citering: Lilhore, U.K., Sharma, Y.K., Venkatachari, K. et al. Real time fire and smoke detection using vision transformers and spatiotemporal learning. Sci Rep 16, 8928 (2026). https://doi.org/10.1038/s41598-026-36687-9

Nyckelord: eldetection, rökdetektion, datorseende, transformermodeller, övervakning i realtid