Clear Sky Science · sv

Finkornig utvärdering av stora språkmodeller inom medicin med icke-parametrisk kognitiv diagnostisk modellering

Varför detta spelar roll för framtida läkarbesök

Artificiella intelligenssystem som talar och skriver, kända som stora språkmodeller, rör sig snabbt från forskningslabben in i sjukhusmiljöer. De kan redan hjälpa läkare att tolka komplexa journaler, föreslå behandlingar och besvara medicinska frågor. Men de flesta tester av dessa system ger bara ett enda övergripande resultat, ungefär som ett slutbetyg, vilket kan dölja farliga blinda fläckar. Denna studie visar ett nytt sätt att granska dessa poäng och avslöja exakt vilka medicinska områden modellerna verkligen förstår — och var de fortfarande kan utsätta patienter för risk.

Bortom ett enda testresultat

Idag bedöms de flesta medicinska AI-system på hur många frågor de svarar rätt på i prov som är modellerade efter läkarlegitimationstentor. Det tillvägagångssättet är enkelt men grovt. En modell kan få högt totalresultat samtidigt som den är svag inom ett kritiskt område, som hjärtrytmsanalys eller leversjukdomar. I verkliga kliniska sammanhang kan sådana luckor få livsavgörande konsekvenser. Författarna hävdar att säker användning av AI inom medicin kräver en djupare, mer finkornig utvärdering — en som kan kartlägga en detaljerad färdighetsprofil istället för att dela ut ett enda, möjligen missvisande, betyg.

Ett smartare sätt att testa medicinsk kunskap

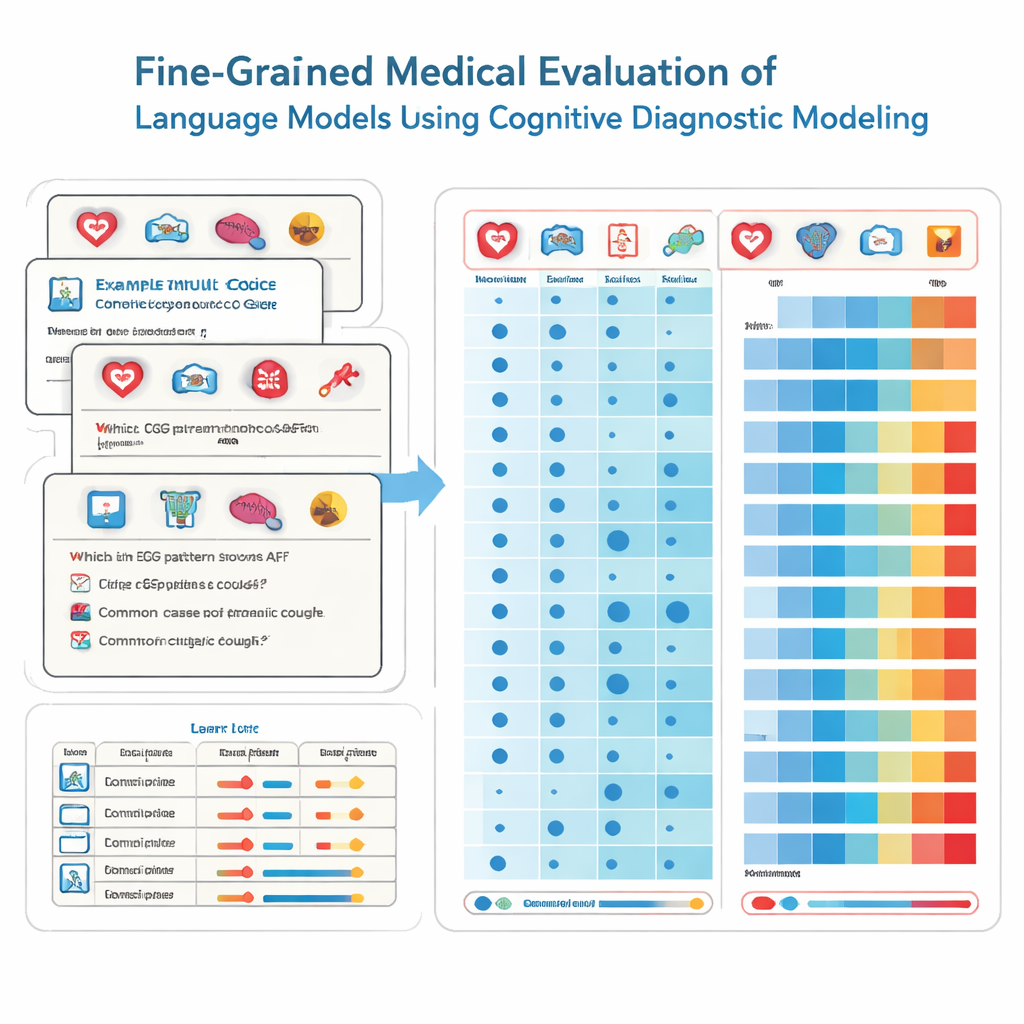

För att uppnå detta lånar forskarna verktyg från utbildningspsykologin som kallas kognitiv diagnostisk bedömning. Istället för att behandla varje provfråga som om den mätte samma vaga förmåga delar denna metod upp medicinsk kunskap i specifika byggstenar, som kardiologi, radiologi eller akutsjukvård. Varje flervalsfråga taggas med den exakta mixen av färdigheter som krävs. Med en icke-parametrisk statistisk teknik jämför teamet hur en modell svarar på tusentals sådana frågor med idealiska svarsmönster. Därigenom härleder de om modellen har ”bemästrat” varje underliggande färdighet, ungefär som ett detaljerat betygsutdrag kan visa styrkor och svagheter över skolämnen.

41 AI-modeller prövades mot ett medicinskt prov

Teamet testade 41 vida använda språkmodeller, inklusive både kommersiella system och öppna modeller, på 2 809 noggrant granskade frågor hämtade från en kinesisk nationell medicinsk provbank. Dessa frågor spänner över 22 medicinska underdomäner och är avsedda för studenter som står inför läkarlegitimationsexamen. Varje fråga har ett korrekt svar och är av experter märkt för att indikera vilka specialiteter den berör. Med sin diagnostiska metod uppskattade forskarna för varje modell hur många av dessa 22 medicinska attribut den effektivt bemästrat, inte bara hur många frågor den råkade svara rätt på.

Stark allmänkunskap, men skarpa blinda fläckar

Resultaten är både imponerande och oroande. De bäst presterande modellerna, såsom flera ledande kommersiella system, svarade rätt på de flesta frågor och visade bemästring i 20 av 22 medicinska domäner. Över alla modeller var prestationen utmärkt inom många vanliga specialiteter, med full bemästring i 15 områden inklusive kardiologi, dermatologi och endokrinologi. Men den finkorniga analysen exponerade tydliga luckor i andra områden. Radiologi låg efter med mycket lägre bemästringsgrader, och två underdomäner — EKG & hypertoni & lipider samt leversjukdomar — bemästrades inte av någon modell. Viktigt är att vissa mindre modeller delade samma bemästrade färdigheter som mycket större modeller, vilket visar att ren storlek inte garanterar bred, tillförlitlig medicinsk kunskap.

Välja rätt verktyg för rätt uppgift

Dessa detaljerade profiler är viktiga eftersom modeller med mycket liknande totalpoäng kan ha helt olika mönster av styrkor och svagheter. Ett system kan vara starkt i neurologi men svagt i farmakologi, medan ett annat visar motsatt mönster. För sjukhusledare innebär det att de inte säkert kan välja en AI-assistent enbart baserat på dess huvudresultat eller antal parametrar. Istället behöver de diagnostiska resultat som de i denna studie för att matcha varje modell till specifika kliniska uppgifter och för att utforma arbetsflöden där mänskliga specialister dubbelkollar AI:s utsagor i högriskområden där modellen är känd för att vara svag.

Vad detta betyder för patienter och kliniker

Enkelt uttryckt slutsatsen i studien att ett högt ”betyg” på medicinska prov inte garanterar att ett AI-system är säkert att använda inom alla delar av medicinen. Den nya metoden fungerar mer som en grundlig hälsokontroll för AI:n själv och avslöjar vilka organ — i detta fall medicinska specialiteter — som är friska och vilka som behöver uppmärksamhet. Genom att upptäcka dolda luckor i kritiska områden som EKG-tolkning och leversjukdomar ger metoden sjukhus, tillsynsmyndigheter och utvecklare en praktisk färdplan: använd modeller endast där de visat sig starka, behåll människor strikt i beslutskedjan där svagheter kvarstår, och rikta framtida träning mot de mest riskfyllda blinda fläckarna. Denna typ av finkornig utvärdering, menar författarna, är inte bara användbar — den är nödvändig innan man litar på AI med patientvård.

Citering: Zheng, T., Liu, J., Feng, S. et al. Fine-grained evaluation of large language models in medicine using non-parametric cognitive diagnostic modeling. Sci Rep 16, 6460 (2026). https://doi.org/10.1038/s41598-026-36627-7

Nyckelord: medicinsk AI, stora språkmodeller, klinisk säkerhet, modellutvärdering, diagnostisk testning