Clear Sky Science · sv

Databehandling för seriekristallografi med femtosekundpulser vid det globala vetenskapsdatahubcentret på KISTI

Varför små kristaller behöver stora datorer

Moderna röntgenlaser kan ta ”molekylfilmer” av proteiner och andra molekyler genom att skjuta ultrakorta, ultrastarka pulser mot otaliga mikrokristaller. Denna metod, kallad seriekristallografi med femtosekundpulser, genererar en ström av bilder som visar hur molekyler ser ut och rör sig vid rumstemperatur. Men det finns en hake: ett enda experiment kan generera terabyte av data, långt mer än en typisk laboratoriedator snabbt kan hantera. Denna artikel förklarar hur Koreas nationella datahub, GSDC vid KISTI, byggdes och testades för att effektivt bearbeta dessa stora datamängder, och vilka praktiska lärdomar forskare kan använda för att gå från råbilder till 3D‑strukturer utan långa fördröjningar.

Från laserblixtar till struktursnapshots

I seriekristallografi med femtosekundpulser träffar en röntgenfri elektronlaser (XFEL) strömmar eller arrayer av mikroskopiska kristaller med snabba pulser. Varje kristall träffas bara en gång och ger ett enda ”snapshot”‑diffraktionsmönster innan den förstörs. För att rekonstruera molekylens fulla tredimensionella struktur måste forskarna kombinera hundratusentals till miljontals sådana snapshots. Många bilder är oanvändbara — vissa innehåller ingen signal, andra visar flera överlappande kristaller. Användbara bilder (”hits”) måste upptäckas, sorteras och omvandlas till intensitetsdata som kan slås ihop till en högkvalitativ struktur. Att göra detta i något som liknar realtid kräver högpresterande databehandling, särskilt när lasern körs med tiotals pulser per sekund.

En nationell datahub för röntgenexperiment

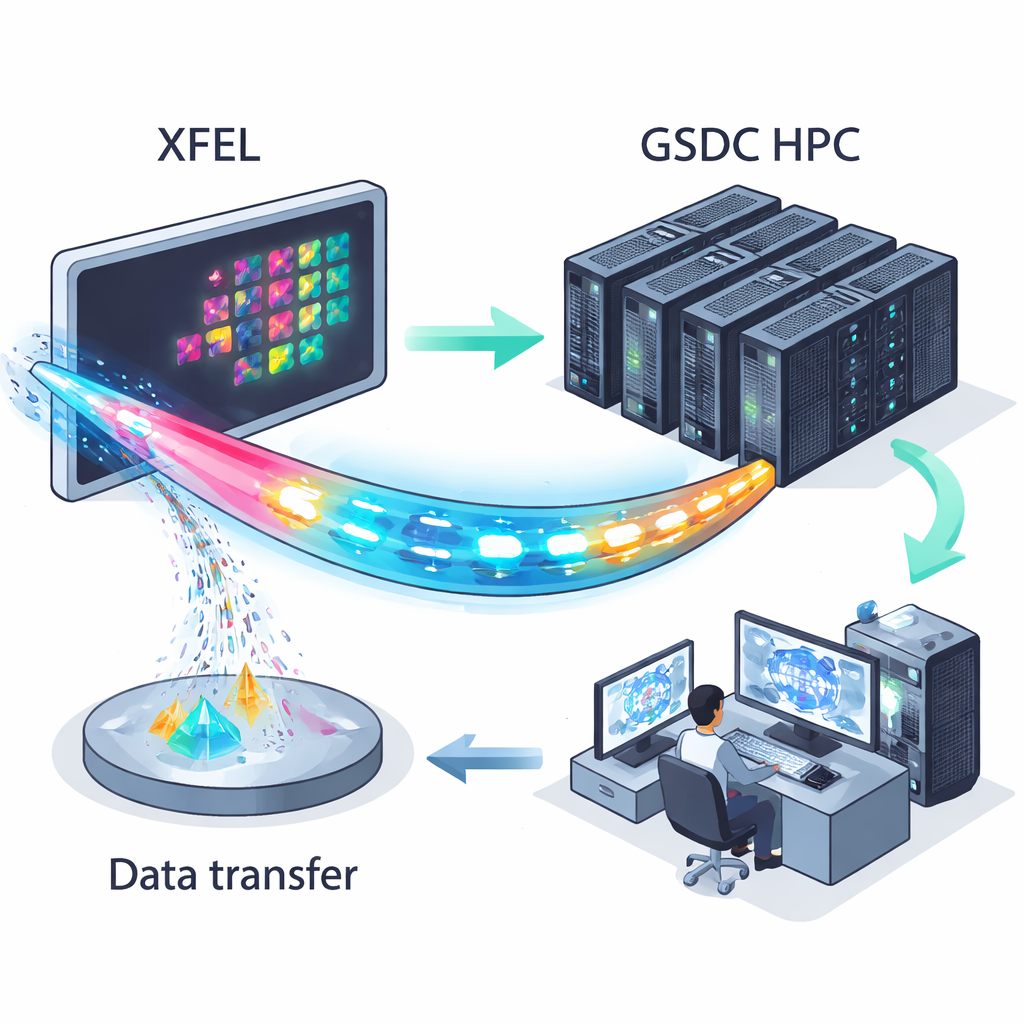

Global Science Data hub Center (GSDC) vid KISTI etablerades som en nationell anläggning för dataintensiva vetenskaper, från partikel‑fysik till genomik. För seriekristallografi vid Pohang Accelerator Laboratory XFEL (PAL‑XFEL) driver GSDC tre dedikerade servrar utrustade med tiotals CPU‑kärnor, hundratals gigabyte minne och ett höghastighets parallellt lagringssystem. Under experiment vid PAL‑XFEL:s nanokristallografistation samlas diffraktionsbilder in på en snabb röntgendetektor och strömmas till GSDC via en 10‑gigabit‑per‑sekund länk. Ett enda 12–24 timmars experiment kan generera flera till nästan tio terabyte data. På GSDC loggar användare in på distans, filtrerar bort onyttiga ramar och kör specialiserad programvara — såsom CrystFEL och dess tillhörande indexeringsprogram — för att omvandla råbilder till förfinade strukturella data.

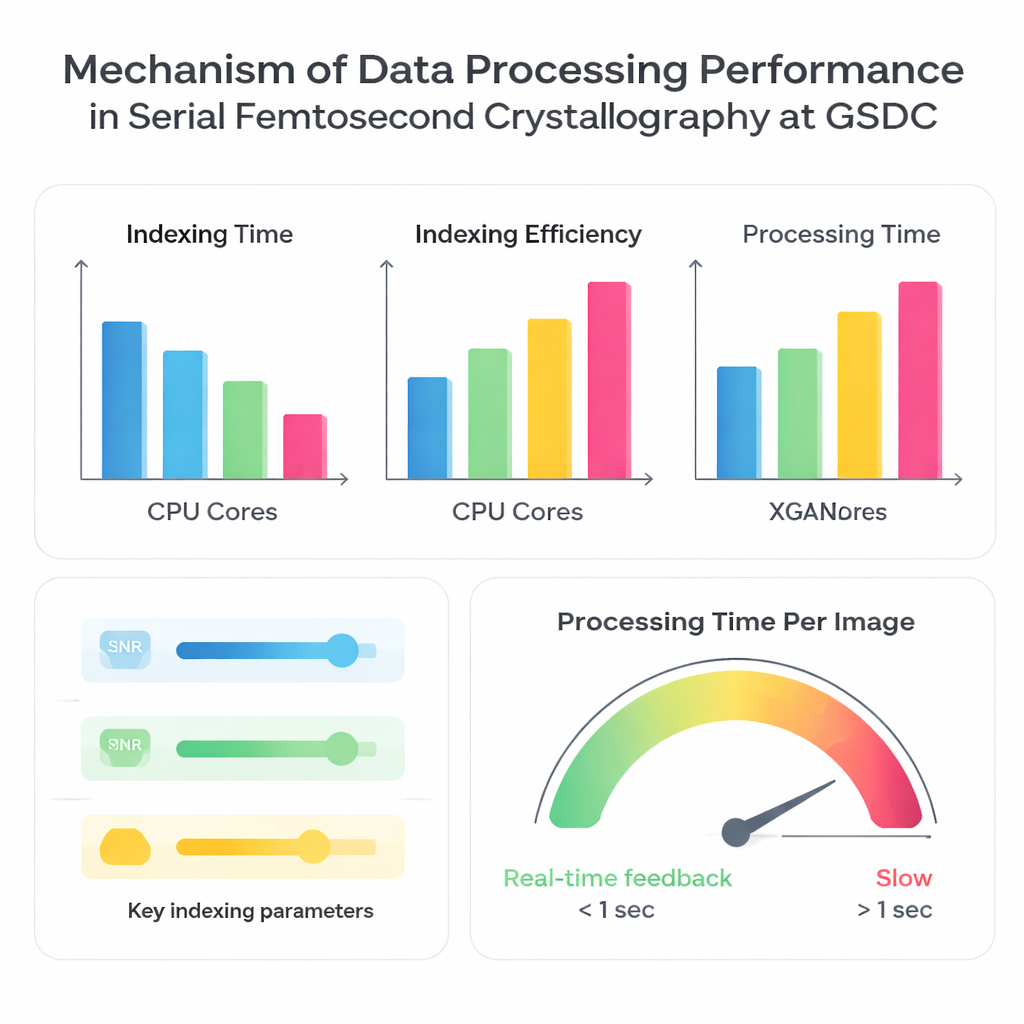

Hur många processorer hjälper, och när

Författarna testade GSDC‑systemet med tre tidigare insamlade dataset från olika proteiner. Först undersökte de hur mycket bearbetningshastigheten förbättras när fler CPU‑kärnor används parallellt. Som väntat minskade mer processorkraft den totala tiden som krävdes för att indexera bilder, men inte i perfekt proportion. Att gå från 10 till ungefär 30–40 CPU‑kärnor gav stora vinster, varefter förbättringarna avtog. Utöver den punkten tillförde fler kärnor overhead och hindrades av begränsningar såsom minnesbandbredd, in‑/ut‑hastighet vid läsning av många små filer och koordinering mellan många parallella uppgifter. Detta visar tydligt att ”fler kärnor” inte alltid är bättre; det finns en balanspunkt där hårdvaran används effektivt utan att bli en flaskhals.

Avvägningen mellan hastighet och fullständighet

Därefter jämförde teamet fyra i vid bemärkelse använda indexeringsalgoritmer — XDS, DirAx, MOSFLM och XGANDALF — på samma beräkningsplattform. Vissa metoder, som XDS och DirAx, var snabbare totalt sett men identifierade en mindre andel bilder som kunde omvandlas till användbara diffraktionsmönster. Andra, såsom MOSFLM och XGANDALF, var långsammare men konverterade fler bilder till användbara data och gav generellt bättre statistisk kvalitet i den slutliga sammanslagna datasetet. Författarna utforskade också hur enkla inmatningsval påverkar både hastighet och lyckandefrekvens: att höja signal‑mot‑brus‑tröskeln eller stänga av multi‑kristall‑indexering gjorde bearbetningen snabbare men minskade antalet användbara bilder; att sänka tröskeln eller tillåta multi‑kristallhantering gjorde motsatsen. Avgörande var att även små fel i detektorns geometri — som avståndet mellan detektor och prov — fick indexeringen att misslyckas oftare och gjorde bearbetningen dramatiskt långsammare, eftersom programvaran fortsatte försöka och avvisa felaktiga lösningar.

Vad detta betyder för framtida experiment

Genom att systematiskt mäta hur hårdvaruval, programvarualgoritmer och användarkontrollerade inställningar påverkar prestanda omvandlar denna studie en komplex datahanteringsutmaning till ett antal praktiska riktlinjer. För forskare som planerar PAL‑XFEL‑experiment visar den när parallellbearbetning är mest effektiv, vilka indexeringsprogram som är bättre för snabb återkoppling respektive maximal datakvalitet, och varför noggrann kalibrering av detektorns geometri är så viktig. Författarna drar slutsatsen att GSDC redan möjliggör effektiv bearbetning och i vissa fall realtidsfeedback under datainsamling, men att en vidare utbyggnad av beräkningsresurser kommer att behövas i takt med att repetitionsfrekvenser och datasetstorlekar fortsätter växa. För icke‑experter är huvudbudskapet att att göra ”filmer” av molekyler inte bara är en triumf för avancerade lasrar och detektorer — det beror också avgörande på väl utformade datacenter som kan hantera datamängdens översvämning.

Citering: Nam, K.H., Na, SH. Serial femtosecond crystallography data processing at the global science data hub center at KISTI. Sci Rep 16, 6786 (2026). https://doi.org/10.1038/s41598-026-36540-z

Nyckelord: seriekristallografi med femtosekundpulser, röntgenfri elektronlaser, högpresterande databehandling, databehandling, proteinstruktur