Clear Sky Science · sv

Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis

Varför små ledtrådar i recensioner spelar roll

Online-recensioner rymmer ofta blandade känslor: en restaurang kan ha ”utmärkt mat men långsam service”, eller en telefon kan ha en ”vacker skärm men fruktansvärd batteritid”. Företag och forskare vill att datorer ska förstå den här typen av detaljerade åsikter, inte bara om en hel recension är positiv eller negativ. Denna artikel presenterar en ny artificiell intelligensmodell som zoomar in på specifika delar av en mening—som ”service” eller ”batteritid”—och avgör exakt hur folk känner för varje del, även när ledtrådarna är utspridda och subtila.

Bortom enkel helhetsbedömning

Traditionell sentimentanalys behandlar en mening eller recension som en enda textmassa och avgör om den i stort är positiv eller negativ. Det fungerar för enkla kommentarer, men misslyckas när människor berömmer en aspekt och kritiserar en annan i samma mening. Fältet aspektbaserad sentimentanalys tar sig an detta genom att fråga: vad är sentimentet gentemot varje specifikt mål, såsom ”service”, ”miljö” eller ”personal” i en restaurangrecension. Tidigare metoder byggde på handgjorda regler eller enkla maskininlärningsmetoder som räknade ord, och gick sedan över till neurala nätverk som läser text sekventiellt, som att läsa från vänster till höger. Dessa sekventiella modeller förbättrade noggrannheten men missade fortfarande långdistanskopplingar och subtila signaler, särskilt när de relevanta orden ligger långt ifrån varandra eller är förenade av kontrastord som ”men” och ”även om”.

Att göra meningar till sammankopplade kartor

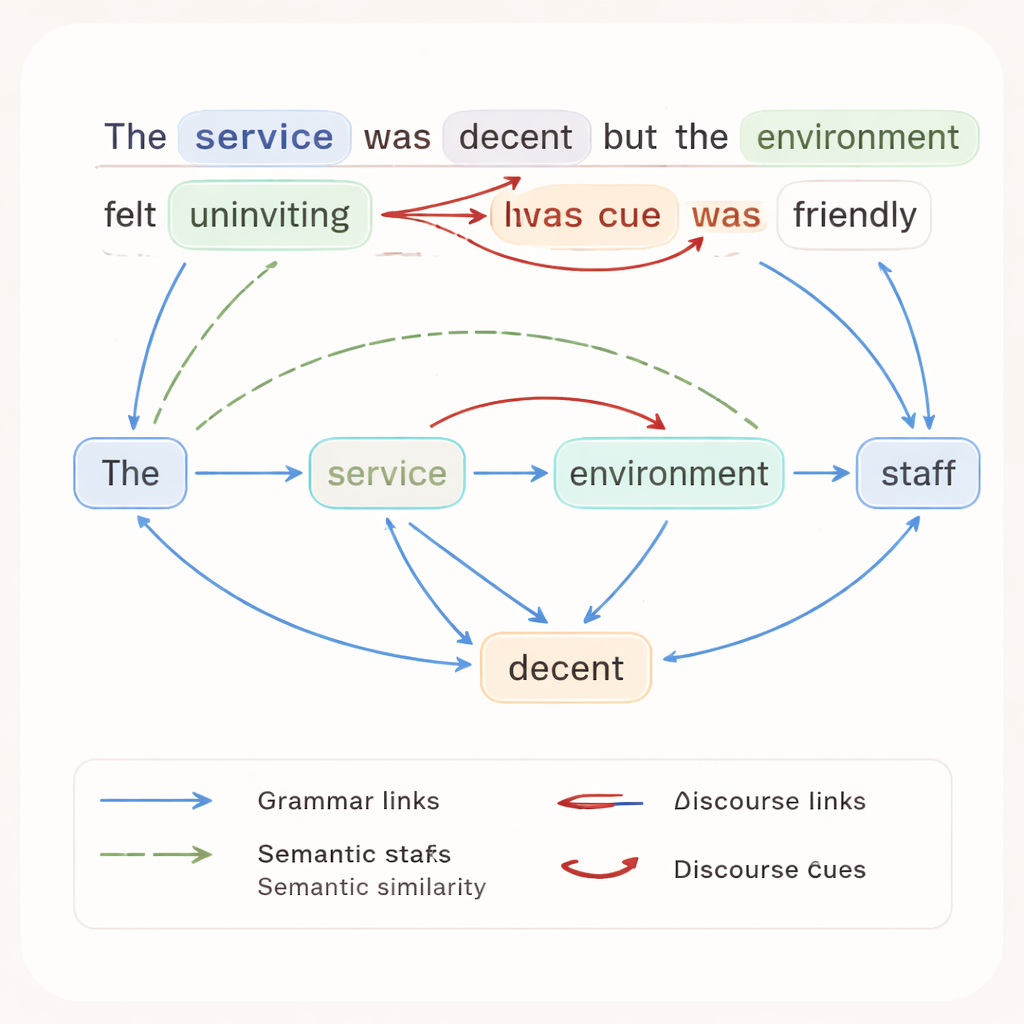

Författarna hävdar att för att verkligen förstå finfördelade åsikter bör en dator se en mening som ett nätverk snarare än en rak linje. I deras tillvägagångssätt blir varje ord en nod i en graf, och olika typer av relationer blir kanter. En uppsättning kanter fångar grammatiken, till exempel vilket ord som är subjekt eller objekt. En annan länkar ord som är likartade i betydelse, även om de inte står intill varandra. En tredje märkning fångar diskursmarkörer—ord som ”men”, ”dock” eller ”även om” som ofta signalerar en förändring i sentiment. I en mening som ”Servicen var okej men miljön kändes oinbjudande även om personalen var vänlig” visar denna graf hur beröm och kritik vävs ihop kring olika aspekter.

En dubbel strålkastare på kontext och mål

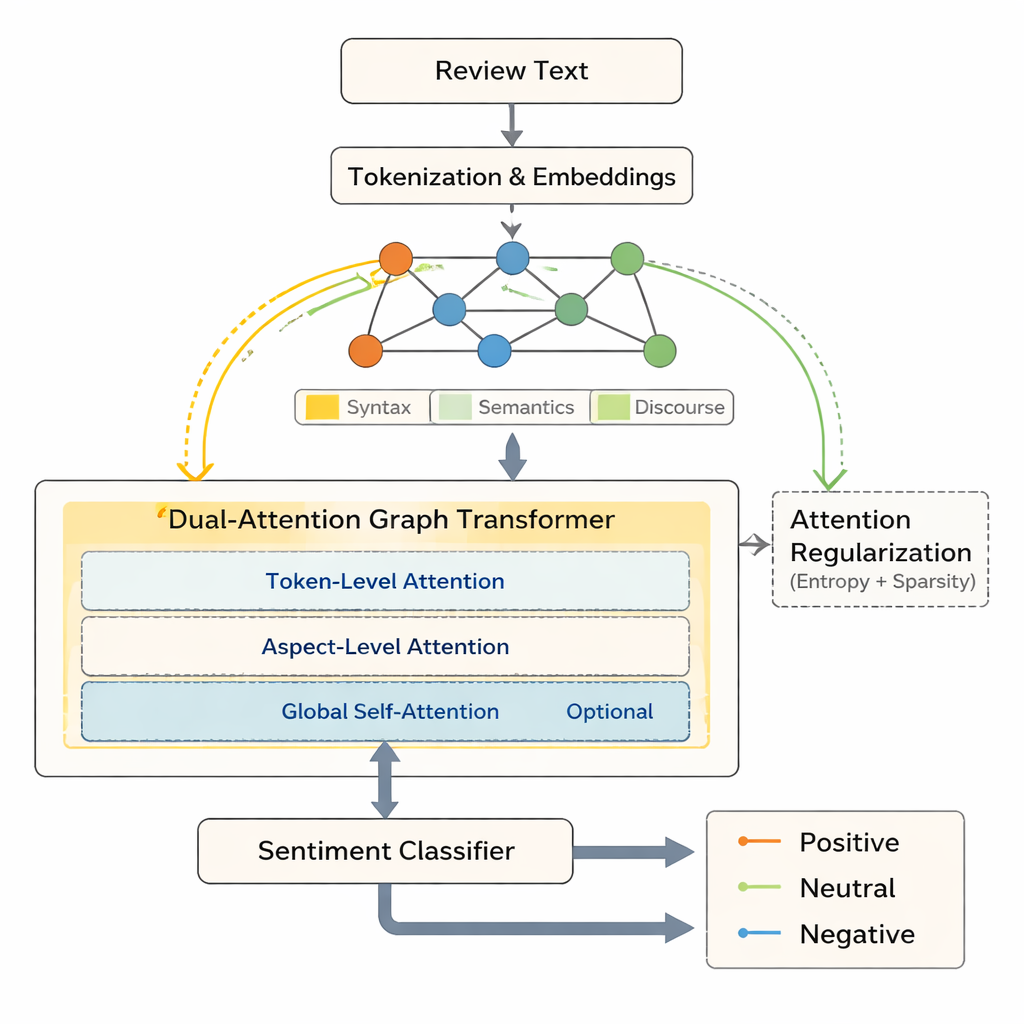

Med denna grafvy som grund presenterar artikeln Multi-Relational Dual-Attention Graph Transformer (MRDAGT). Denna modell använder en Transformer-liknande uppmärksamhetsmekanism anpassad för grafer. Ett uppmärksamhetshuvud ser brett på hur alla ord i meningen relaterar till varandra och samlar användbar lokal kontext. Ett annat uppmärksamhetshuvud fokuserar särskilt på den aspekt som undersöks—till exempel ”service” eller ”miljö”—och höjer inflytandet från ord som formar åsikter om det målet, såsom ”okej” eller ”oinbjudande”. När flera aspekter förekommer i en mening hjälper ett valfritt globalt uppmärksamhetslager modellen att väga deras samspel. I praktiken kastar systemet två koordinerade strålkastare: en på den allmänna meningsstrukturen och en direkt på den aspekt vars sentiment det försöker bedöma.

Att göra maskinell uppmärksamhet mer selektiv och förklarlig

En viktig fråga med modern AI är att uppmärksamhetsvikter—de siffror som anger vilka ord modellen fokuserade på—kan bli för utspädda, vilket gör beslut svåra att tolka. MRDAGT tacklar detta med två regulariserande krafter. Ett entropi-straff motverkar alltför platt uppmärksamhet och uppmuntrar modellen att koncentrera sig skarpare på ett fåtal viktiga ord. Samtidigt skjuter en L1-sparsitetsterm många uppmärksamhetskopplingar mot noll och trimma bort svaga, brusiga samband. Tillsammans skapar dessa krafter en ”fokuserad gleshet”: modellen tenderar att placera tydliga, höga vikter på verkligt relevanta ord–aspekt-par samtidigt som den bortser från distraktioner. Experiment på tre benchmark-dataset—formella laptoprecensioner, komplexa flerradiga recensioner och informella Twitter-inlägg—visar att MRDAGT konsekvent slår starka befintliga system med omkring en till två procentenheter i noggrannhet, samtidigt som den producerar renare och mer tolkbara uppmärksamhetskartor.

Vad detta betyder för verklig opinionsanalys

För icke-specialister är slutsatsen att denna modell erbjuder ett mer precist och tillförlitligt sätt att utvinna åsikter ur rörig, verklig text. Istället för att bara säga att en recension är ”till största delen positiv” kan MRDAGT separat rapportera att kunder gillar en enhets hastighet men ogillar dess batteri, eller att gäster uppskattar ett kafés personal men klagar på buller. Eftersom dess uppmärksamhetsmönster stämmer överens med mänsklig intuition—med fokus på kontrastord, sentimentadjektiv och aspekttermer—är det enklare för analytiker att förstå varför modellen fattade ett visst omdöme. Författarna föreslår att detta tillvägagångssätt kan stödja bättre produktdesignbeslut, skarpare övervakning av sociala medier och framtida utvidgningar till många språk och till och med multimodala data som ljud och bilder, samtidigt som resonemanget hålls relativt transparent.

Citering: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Nyckelord: aspektbaserad sentimentanalys, grafneurala nätverk, transformer-uppmärksamhet, opinionsutvinning, behandling av naturligt språk