Clear Sky Science · sv

En djup sentimentmodell som kombinerar ALBERT-driven kontext och EHO-optimerad arkitektur

Varför smartare läsning av sentiment spelar roll

Varje dag delar miljontals människor åsikter om produkter, tjänster, politik och händelser på internet. Att omvandla denna ström av text till tillförlitlig insikt är avgörande för företag, myndigheter och forskare. Samtidigt är vårt online-språk rörigt: sarkastiska skämt, slang, stavfel och ovanliga känslor kan lätt förvirra datorer. Denna artikel presenterar ett nytt system för sentimentanalys som syftar till att läsa dessa känslor mer korrekt, samtidigt som det använder mindre beräkningskraft än många nuvarande artificiella intelligensmodeller.

Från enkla ordräkningar till kontextmedveten läsning

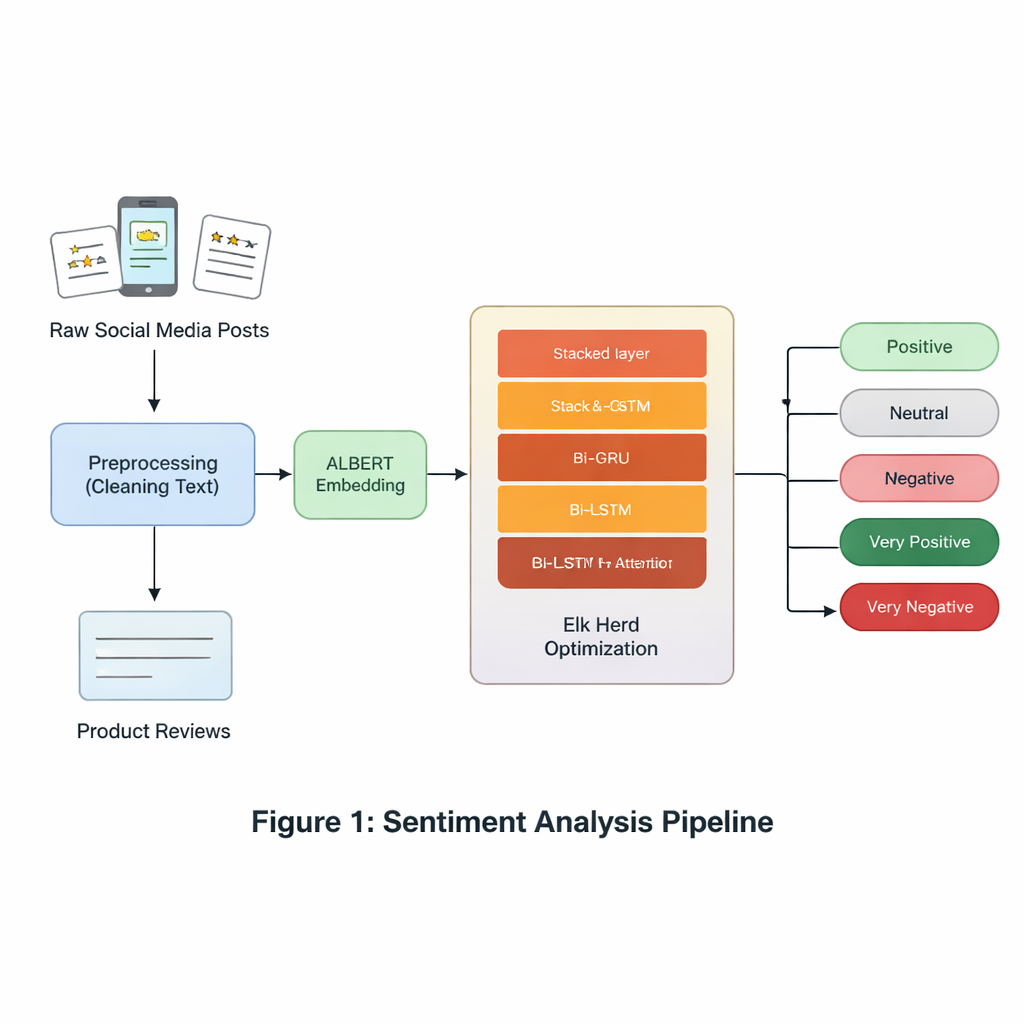

Tidiga verktyg för sentimentanalys behandlade text som en påse oberoende ord och räknade hur ofta termer som “bra” eller “fruktansvärt” förekom. Detta synsätt ignorerade ordningsföljd och subtil kontext, som att “inte dåligt” betyder något närmare “ganska bra.” Djuplärande metoder förbättrade detta genom att bearbeta text som sekvenser, men de krävde ofta stora annoterade dataset och tung beräkning. Transformermodeller som BERT ökade noggrannheten ytterligare, men deras stora storlek gör dem dyra att köra i verkliga tillämpningar som kundserviceplattformar eller övervakning av sociala medier. Författarna till denna artikel svarar på denna utmaning genom att kombinera flera lättare men kraftfulla komponenter i ett sammanslaget system.

En slankare hjärna för att förstå text

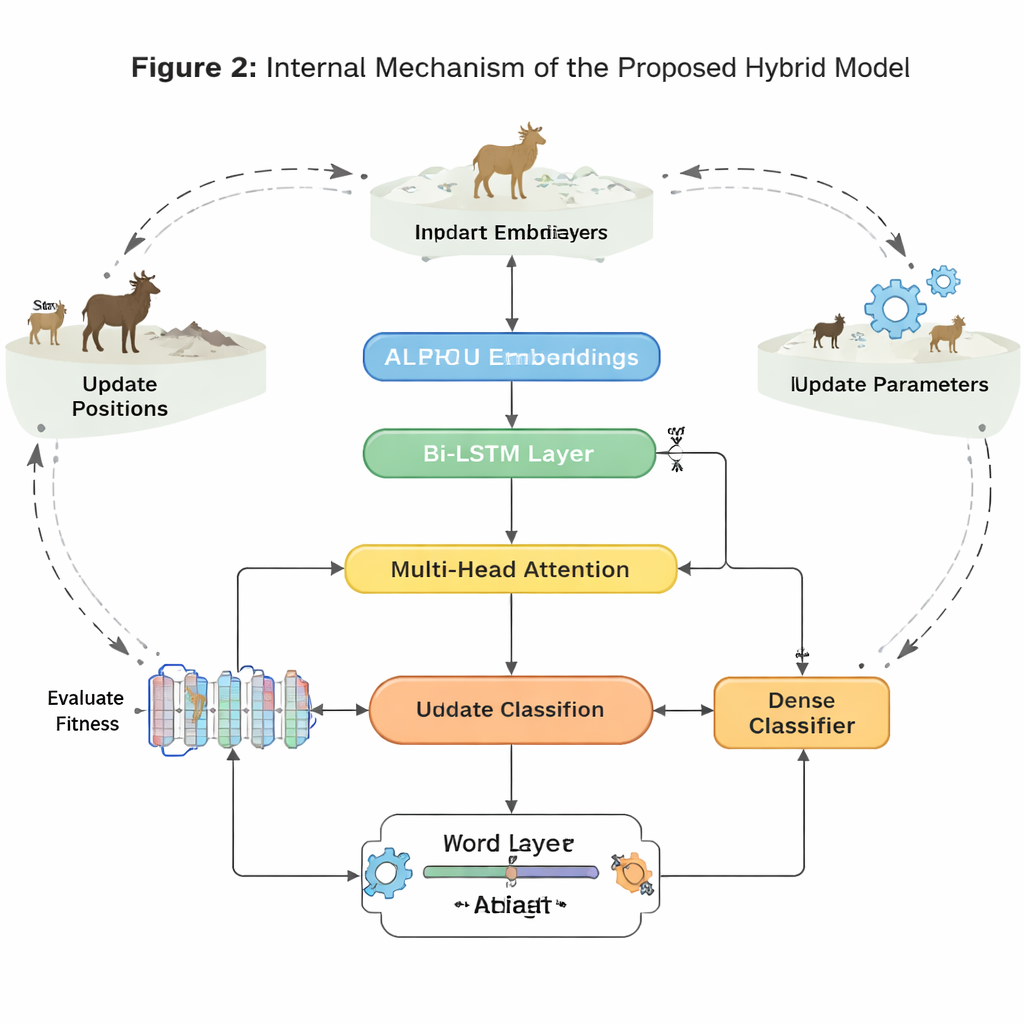

I modellens kärna finns ALBERT, en kompakt kusin till språkmodellen BERT. ALBERT omvandlar varje ord i en mening till en kontextmedveten numerisk representation och fångar hur betydelser skiftar beroende på intilliggande ord. Till skillnad från större modeller minskar ALBERT minnesanvändningen genom att dela parametrar mellan lager och komprimera sitt ordlexikon. Det gör det lättare att köra på standardhårdvara utan att offra mycket förståelse. Dessa ALBERT-baserade ordrepresentationer blir indata till en sekvens av specialiserade lager som fokuserar på hur sentiment utvecklas över en mening.

Låta två minnessystem samarbeta

För att följa hur betydelsen förändras från ord till ord använder systemet två typer av rekurrenta nätverk: GRU (Gated Recurrent Units) och LSTM (Long Short-Term Memory), vardera körd i både fram- och bakåtriktning. GRU:er är effektiva på att spåra kortare fraser med färre parametrar, medan LSTM:er är bättre på att minnas information över längre textstycken. Genom att stapla ett bidirektionellt GRU-lager ovanpå ett bidirektionellt LSTM-lager och lägga till en attention-mekanism kan modellen framhäva de mest sentimentsbetonade delarna av varje mening—som frasen “utom batteritiden” i en i övrigt positiv recension. Denna hybriddesign syftar till att fånga både snabba tonförändringar och längre kontext som kan vända det övergripande sentimentet.

Naturnära justering för svåra fall

Utöver arkitekturen tar författarna itu med ett centralt verklighetsproblem: sentimentdataset är ofta obalanserade och brusiga. Känslor som avsky eller förvåning, och neutrala uttalanden, förekommer mer sällan än tydligt positiva eller negativa, vilket får många modeller att ignorera dem. För att motverka detta använder artikeln Elk Herd Optimization, en naturnära sökstrategi modellerad på hur älgar rör sig, tävlar och bildar grupper. Efter att det neurala nätverket genererat interna sentimentvektorer finjusterar detta optimeringssteg hur dessa vektorer representerar varje klass, särskilt de sällsynta, genom att iterativt förbättra en ”fitness”-poäng. Denna process hjälper modellen undvika ytliga lösningar och förbättrar dess förmåga att särskilja subtila eller underrepresenterade känslor.

Sätta modellen på prov

Författarna utvärderar sitt system på sex välanvända dataset, inklusive Twitter-inlägg, restaurang- och laptoprecensioner samt ett femgradigt filmrecensionsbenchmark som skiljer mycket positiva och mycket negativa åsikter från mer måttliga. Över dessa skiftande källor överträffar den nya metoden konsekvent flera avancerade grafbaserade och transformerbaserade konkurrenter i både noggrannhet och F1-poäng, ett mått som väger samman korrekta träffar och missade fall. Vinsterna är särskilt starka på femvägsfilmrecensionsuppgiften och för underrepresenterade sentimentklasser, vilket visar att metoden kan hantera både finskuren känsla och snedfördelad data. En ablationsstudie, där komponenter tas bort en i taget, bekräftar att ALBERT, den kombinerade GRU–LSTM-designen, attention och älg-inspirerad optimering alla bidrar till den övergripande prestandan.

Vad detta betyder för vardagliga tillämpningar

För icke-specialister är huvudpoängen att denna forskning erbjuder ett mer effektivt och tillförlitligt sätt att tolka stora volymer av onlineåsikter. Genom att blanda en kompakt språkmodell med kompletterande minneslager och ett biologiskt inspirerat finjusteringssteg läser systemet mellan raderna mer exakt, särskilt när sentiment är subtila eller data är snedfördelade. Det gör det lovande för verkliga användningar som att spåra kundnöjdhet, övervaka folkhälsostämningar eller mäta reaktioner på policyer och händelser, där både precision och beräkningskostnad spelar roll.

Citering: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Nyckelord: sentimentanalys, ALBERT, djuplärande, textklassificering, metaheuristisk optimering