Clear Sky Science · sv

IASUNet: byggnadsutvinning baserad på förbättrad attention Swin-UperNet

Varför det spelar roll att upptäcka varje byggnad från rymden

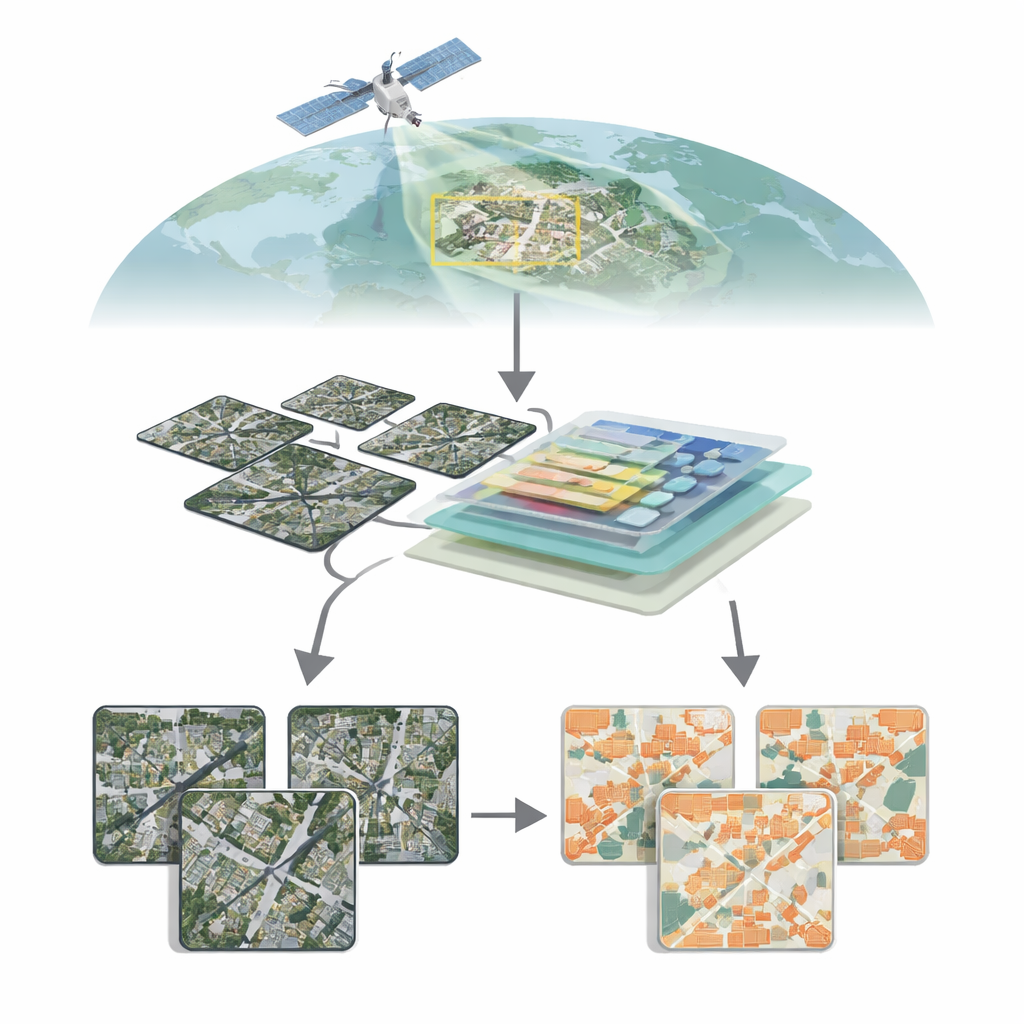

När städer växer och klimatet förändras har det blivit avgörande att exakt veta var byggnader finns — och hur de förändras över tid. Från att planera säkrare bostadsområden och spåra olaglig byggnation till att styra katastrofinsatser efter översvämningar eller jordbävningar, är detaljerade byggnadskartor nu en kärnkomponent i smarta och resilienta städer. Denna artikel presenterar IASUNet, ett nytt artificiellt intelligenssystem som lär sig identifiera byggnader automatiskt från högupplösta satellitbilder med anmärkningsvärd precision, även i röriga, tätbefolkade verkliga miljöer.

Att se städer uppifrån

Moderna satelliter kan fotografera jorden i extraordinär detalj och avslöja enskilda tak, vägar och även smala gränder. Att omvandla detta hav av pixlar till rena byggnadskartor är emellertid långt ifrån trivialt. Byggnader varierar kraftigt i storlek, form, färg och omgivning: glastorn i stadskärnor, låga hus i förorter, spridda gårdsbyggnader på landsbygden. I landsbygds- eller blandområden kan byggnader upptar endast en mycket liten del av varje bild, medan vegetation, jord och vatten dominerar. Traditionella datorseendemetoder, främst baserade på konvolutionella neurala nätverk, kan ha svårt att fånga helhetsbilden över en hel scen samtidigt som de bevarar skarpa gränser, vilket leder till missade små strukturer eller suddiga kanter.

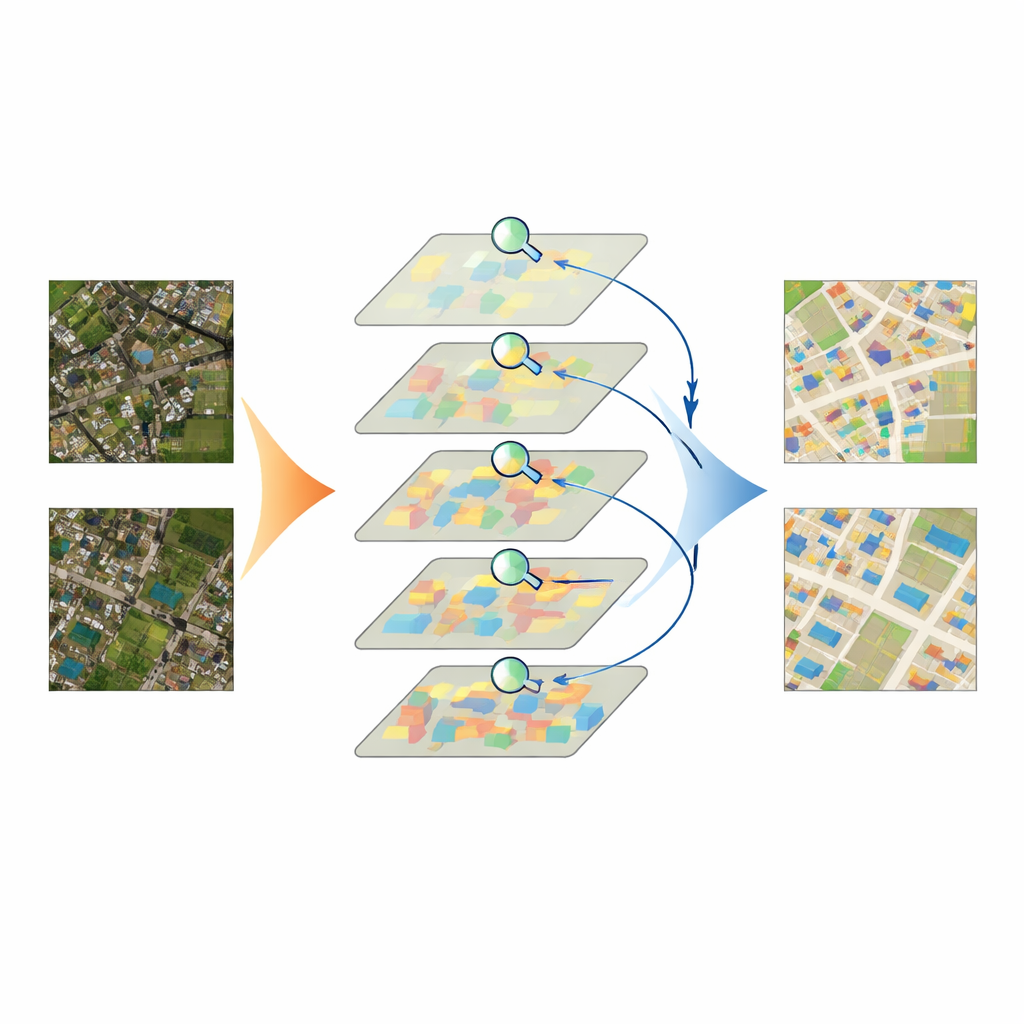

Smartare uppmärksamhet på detaljer

IASUNet angriper dessa utmaningar genom att kombinera två kraftfulla idéer: en transformerbaserad encoder kallad Swin Transformer och en flexibel decoder känd som UperNet. Swin Transformer delar upp en bild i många små patchar och lär sig hur de relaterar till varandra över hela scenen, istället för att bara titta genom ett fönster med fast storlek. Detta hjälper modellen att förstå bredare kontext — till exempel om en ljus rektangel ligger inne i ett tätt stadskvarter eller på ett isolerat fält — samtidigt som detaljer bevaras. Ovanpå detta introducerar författarna en attention-mekanism kallad Convolutional Block Attention Module (CBAM) i flera stadier. CBAM lär sig, kanal för kanal och region för region, vilka bildfunktioner som sannolikt hör till byggnader och vilka som är bakgrundsstörningar, förstärker det förra och dämpar det senare innan decodern pusslar ihop allt till en fullständig byggnadskarta.

Att balansera oddsen när byggnader är sällsynta

En annan praktisk utmaning är obalans: i många satellitscener visar majoriteten av pixlarna vägar, fält, träd eller vatten, medan byggnader utgör små öar. Standardträningsmetoder tenderar att favorisera det som förekommer oftast, vilket riskerar att lära en modell att behandla mindre frekventa byggnader som en bisak. För att motverka detta anpassar författarna en förlustfunktion kallad Focal Cross‑Entropy. Denna strategi minskar inflytandet av "lätta" bakgrundspixlar och förstärker påverkan av svårklassificerade byggnadspixlar under träningen. Som ett resultat ägnar modellen extra uppmärksamhet åt små, svaga eller ovanliga strukturer som annars kan förbises, vilket förbättrar återkallningen utan att översvämma kartan med falska positiva.

Sätta modellen på prov

Teamet testade IASUNet på tre välkända byggnadsdatamängder från Tyskland, Nya Zeeland och USA, samt på en noggrant kurerad samling kinesiska satellitbilder som de själva förberett och kvalitetssäkrat. Över dessa benchmarkar matchade eller överträffade IASUNet konsekvent ledande tillvägagångssätt, inklusive starka konvolutionella nätverk och andra transformerbaserade modeller. På den ultra-detaljerade Potsdam-datamängden uppnådde den nästan perfekt överlappning mellan predicerade och verkliga byggnadsområden, samtidigt som den kördes i praktiska hastigheter på modern grafik-hårdvara. Även i mer oregelbundna landskap, där byggnader är spridda, delvis dolda eller tätt packade, ritade IASUNet renare konturer, fångade fler små mål och undvek många av de utelämnanden och gränsfel som ses i konkurrerande metoder.

Från pixlar till bättre städer

I praktiska termer visar studien att vi nu kan lära datorer att avläsa stadslandskap från omloppsbana med en hittills oöverträffad tydlighet. Genom att noggrant rikta modellens "uppmärksamhet" mot rätt delar av en bild och medvetet viktning av sällsynta men avgörande byggnadspixlar, förvandlar IASUNet råa satellitbilder till exakta, uppdaterade byggnadskartor med måttlig extra beräkningskostnad. Sådana kartor kan mata in i stadsplanering, energi- och värmeö-effektstudier, markanvändningsreglering och snabba skadegörelsebedömningar efter katastrofer. Även om arbetet är tekniskt i grunden är slutsatsen enkel: smartare AI kan ge beslutsfattare en skarpare, mer pålitlig bild av den byggda miljön och hjälpa städer att växa på säkrare och mer hållbara sätt.

Citering: Zhang, H., Ma, Y., Wang, G. et al. IASUNet: building extraction based on impoved attention Swin-UperNet. Sci Rep 16, 7969 (2026). https://doi.org/10.1038/s41598-026-36270-2

Nyckelord: fjärranalys, byggnadsutvinning, semantisk segmentering, transformernätverk, stadskartläggning