Clear Sky Science · sv

Autonom navigation i ostrukturerade utomhusmiljöer med semantisk segmentering styrd förstärkningsinlärning

Robotar som lär sig vandra i skogen

Föreställ dig en liten robot som kan vandra självständigt längs en skogsstig, slingra sig mellan träd och stenar utan GPS eller en människa som håller en joystick. Denna artikel beskriver ett system som lär sådana robotar att "se" stigar i tät skog och fatta, ögonblick för ögonblick, beslut om hur de ska röra sig framåt på ett säkert sätt. Arbetet är viktigt för framtida robotar som kan hjälpa till med skogskontroll, förebyggande av skogsbränder, sök- och räddningsinsatser och till och med utomhusleveranser på platser där satellitsignaler är svaga eller saknas.

Varför skogar är så svåra för robotar

Skogar är några av de tuffaste miljöerna för autonoma maskiner. Stigar kan vara smala och krokiga, marken är ojämn, grenar och buskar blockerar ofta sikten och höga träd gör GPS-signaler opålitliga. Traditionella navigationsmetoder förlitar sig på precisa kartor, stark GPS eller dyra lasersensorer, och antar ofta tydliga, strukturerade utrymmen som stadsgator eller fabriksplan. I skogen kollapsar dessa antaganden: skuggor, årstidsväxlingar och tät växtlighet förvirrar enkla visionssystem, medan regelbaserade styrsystem har svårt att hantera alla röriga, oväntade situationer som uppstår på en verklig stig.

Tre hjärnor som samarbetar

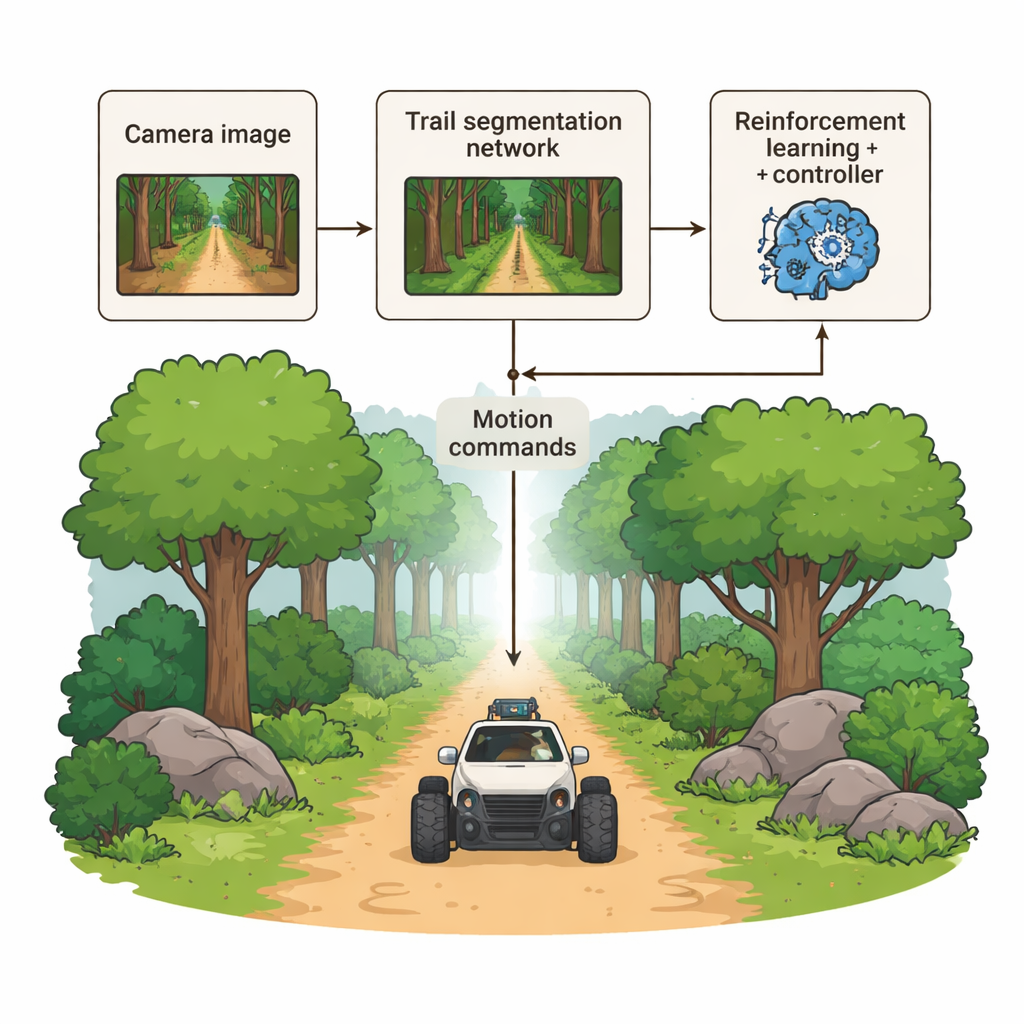

Författarna föreslår ett hybridnavigationssystem som ger robotarna tre kompletterande "hjärnor." För det första granskar en djupvisionsmodul varje kameras bild och markerar, nästan pixel för pixel, vilka delar som tillhör den gångbara stigen. För det andra använder en inlärningsbaserad beslutsmodul förstärkningsinlärning för att välja mjuka styr- och hastighetskommando, och belönar beteende som håller sig på stigen, undviker kollisioner och når målet effektivt. För det tredje omvandlar en klassisk regulator den förutsagda stigformen till stabila hjulrörelser, slätar ut plötsliga svängar och håller robotens bana graciös snarare än ryckig. I stället för ett enda, ogenomskinligt end-to-end-nätverk är dessa moduler separata men tätt länkade, vilket låter ingenjörer förstå och felsöka varje steg.

Träna vision att känna igen stigar

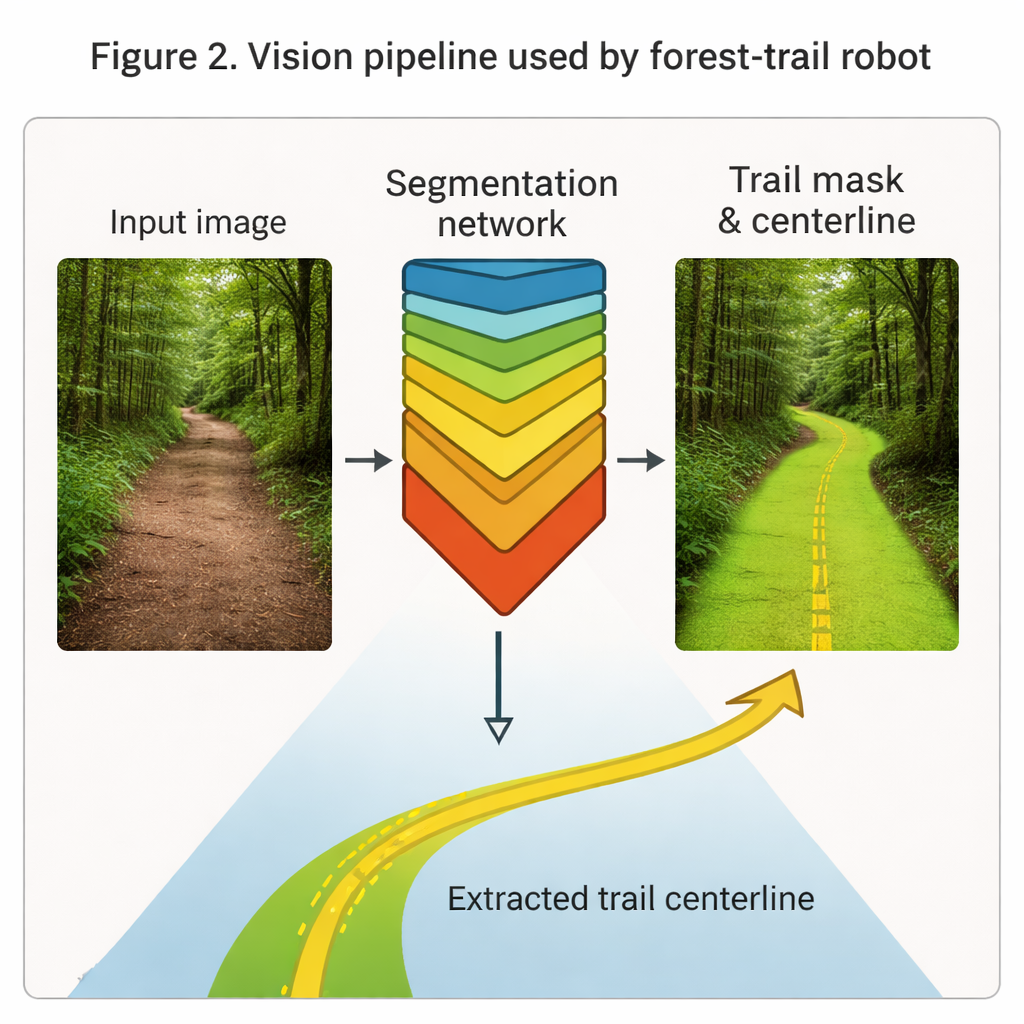

I robotens "ögon" finns ett djupt nätverk känt som Mask R-CNN, här fininställt för att framhäva skogsstigar i vanliga färgbilder. Tränat på nästan 24 000 märkta ramar från verkliga vandringsfilmer filmade i mänsklig höjd under varierande ljus, väder och stigtyper lär sig systemet att måla stigregionen i varje bild som en ren mask. Från denna mask extraherar det en tunn mittlinjekurva som fångar riktningen och kurvaturen av stigen framför. I tester uppnår visionsmodulen hög överensstämmelse med människors ritade etiketter och över 90% pixelnoggrannhet, och skissar robust ut stigar även när grenar eller skuggor delvis döljer vägen. Dessa geometriska signaler matas direkt in i både inlärnings- och styrmodulerna som en kompakt beskrivning av "var stigen är."

Att träna en robot att göra bra val

Den andra nyckelkomponenten är beslutsmodulen, som använder en teknik som kallas förstärkningsinlärning. I stället för att få exakt instruktioner provar roboten åtgärder i en realistisk simulerad skog och får belöningar för bra utfall och straff för dåliga. Att röra sig framåt längs stigen är bra; att driva iväg, kollidera med hinder eller fastna är dåligt. Under ungefär 150 000 träningssteg upptäcker systemet gradvis strategier som håller det centrerat på stigen, hanterar kurvor smidigt och reagerar förnuftigt när grenar eller stenar dyker upp i vägen. För att hålla rörelserna mjuka och säkra kan de inlärda åtgärderna blandas med de som kommer från den klassiska regulatorn, vilket är särskilt hjälpsamt i tajta kurvor eller bullriga förhållanden.

Sätta systemet på prov

För att bedöma hur väl denna kombination fungerar byggde forskarna tre detaljerade virtuella skogar: en med smala, röriga stigar, en annan med brant, ojämn mark och stora hinder, och en tredje fylld med förgreningar, återvändsgränder och vilseledande falska stigar. Över 90 försök i dessa kartor nådde roboten sitt mål utan kollision i cirka 87% av episoderna, med i genomsnitt endast 0,2 stötar per körning och höll sig typiskt inom ungefär 30 centimeter från stigmitten. Den klarade också rutterna snabbt och konsekvent. När författarna tog bort eller förenklade en modul i taget sjönk prestandan kraftigt—vilket visar att alla tre komponenter är nödvändiga. Jämfört med andra moderna system, inklusive sådana som använder laserskannrar, gav detta visionsbaserade hybridupplägg den bästa totala kombinationen av framgångsfrekvens, precision och säkerhet.

Vad detta betyder för robotar i verkligheten

För en icke-specialist är slutsatsen att robotar blir bättre på att vandra som försiktiga, kompetenta stigvandrare. Genom att kombinera en stark känsla för visuellt sammanhang ("det här är stigen"), erfarenhetsbaserat beslutsfattande ("de här rörelserna fungerade bra tidigare") och en stabil styrmekanism låter det föreslagna systemet en liten hjulgående robot navigera komplexa skogar utan kartor eller GPS. Även om arbetet testades i simulation och fortfarande möter utmaningar som extremt ljus och sällsynta stigtyper, erbjuder det en praktisk plan för framtida fältrobotar som säkert kan dela vilda miljöer med människor, hjälpa oss att inspektera skogar, stödja räddningsteam och förvalta naturresurser mer effektivt.

Citering: Tibermacine, A., Tibermacine, I.E., Akrour, D. et al. Autonomous navigation in unstructured outdoor environments using semantic segmentation guided reinforcement learning. Sci Rep 16, 2633 (2026). https://doi.org/10.1038/s41598-026-36022-2

Nyckelord: autonom navigation, skogsrobotik, datorseende, förstärkningsinlärning, semantisk segmentering