Clear Sky Science · sv

Förbättrad generaliserad normalfördelningsoptimerare med Gaussisk fördelningsreparationsmetod och Cauchy omvänd inlärning för urval av egenskaper

Varför rätt dataval spelar roll

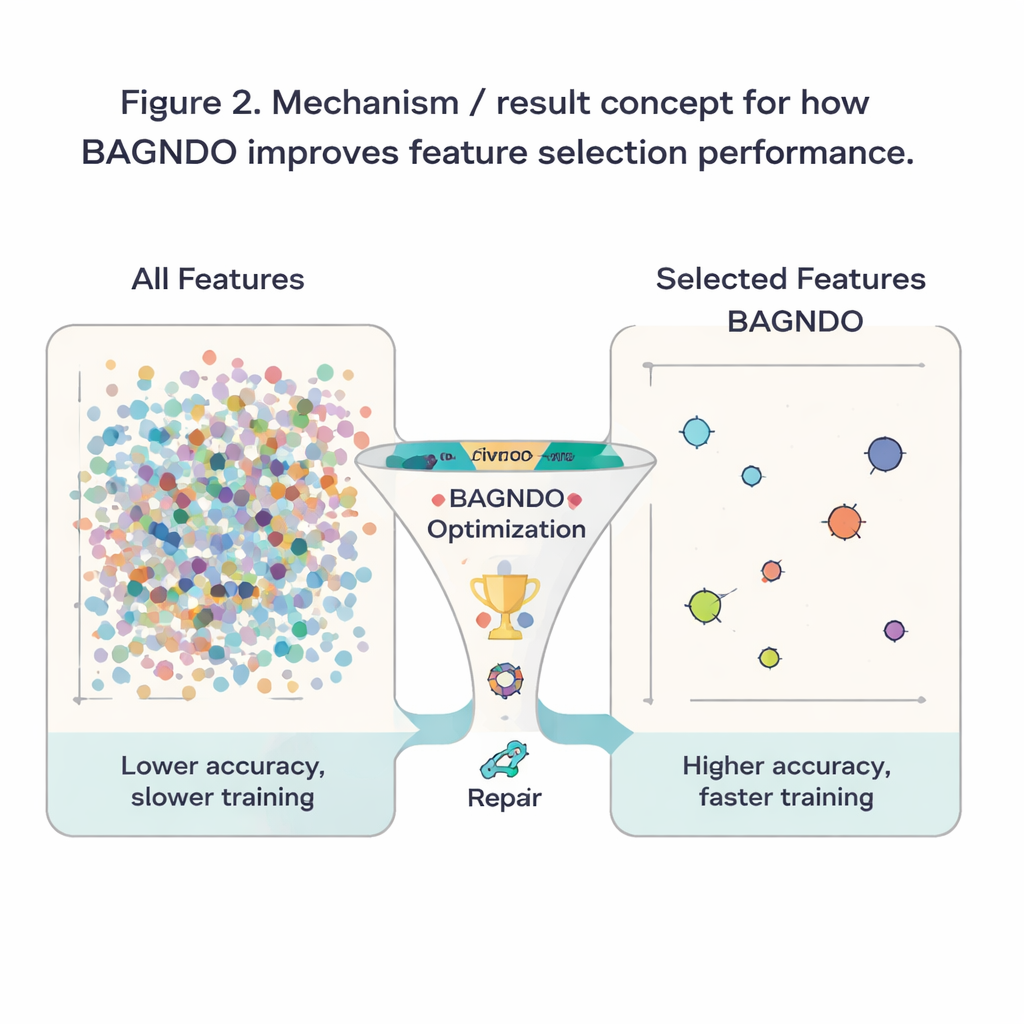

Det moderna livet drivs av data, från medicinska bilder och bankuppgifter till flöden i sociala medier. Men mer data är inte alltid bättre. När datorer ska lära sig från tusentals råa mätvärden samtidigt kan de bli långsammare, dyrare att köra och oväntat mindre träffsäkra. Denna artikel presenterar ett smartare sätt att sålla bland alla dessa mätningar och behålla endast de som verkligen betyder något, med en ny algoritm kallad Binary Adaptive Generalized Normal Distribution Optimizer, eller BAGNDO.

Problemet med för många ledtrådar

Föreställ dig att diagnostisera en sjukdom med hundratals labbtester, skanningar och enkätfrågor. Många av dessa "egenskaper" kan vara brusiga, överflödiga eller helt enkelt irrelevanta, och att mata in dem alla i en klassificerare kan förvirra mer än hjälpa. Urval av egenskaper syftar till att välja en mindre, mer informativ undergrupp av indata så att maskininlärningsmodeller blir snabbare, billigare och mer tillförlitliga. Enkla statistiska filter kan ta bort uppenbart ovidkommande egenskaper, men de anpassar inte sina val efter den specifika modellen som används och missar ofta subtila kombinationer av variabler. Mer avancerade så kallade "wrapper"-metoder bedömer egenskapsuppsättningar genom att direkt testa hur väl en klassificerare presterar, men detta skapar ett enormt sökproblem: antalet möjliga delmängder exploderar när antalet egenskaper ökar.

Söka smart istället för slentrianmässigt

För att hantera denna explosion förlitar sig forskare på metaheuristiska algoritmer—sökstrategier inspirerade av natur- eller fysikaliska processer som balanserar bred utforskning med fokuserad förfining. En sådan metod, Generalized Normal Distribution Optimizer (GNDO), behandlar kandidatlösningar som om de drogs från en flexibel klockformad kurva och förskjuter gradvis denna kurva mot bättre svar. GNDO har fungerat väl inom teknik- och energitillämpningar, men tenderar att stanna för tidigt vid blott dugliga lösningar och har svårt att balansera sin globala vandring med lokal finslipning när den används för urval av egenskaper. Författarna identifierar detta som en kritisk brist: GNDOS eleganta matematik översätts inte automatiskt till stark prestanda för högdimensionella ja-eller-nej-beslut om vilka egenskaper som ska behållas.

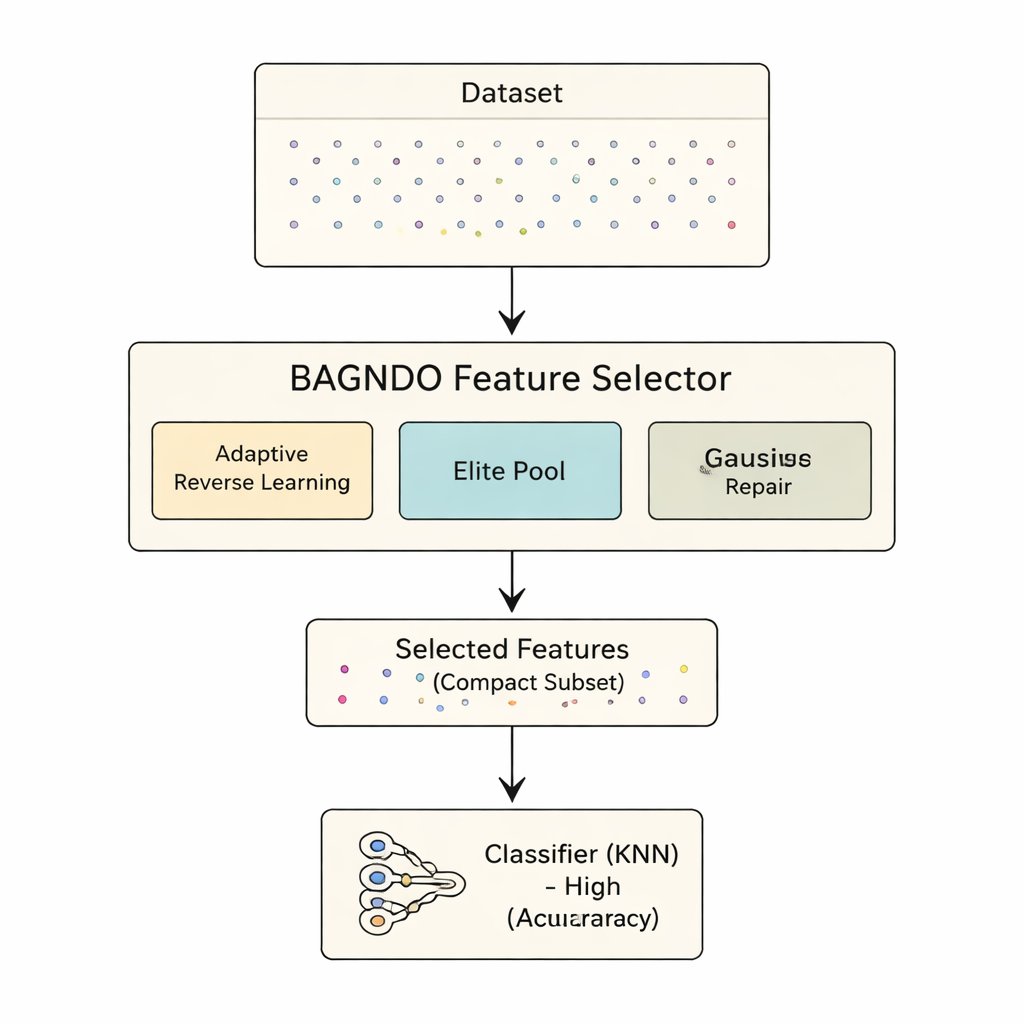

En tredelad uppgradering av en klassisk motor

Det föreslagna BAGNDO-ramverket uppgraderar GNDO med tre samordnade idéer. För det första genererar en Adaptiv Cauchy Omvänd Inlärningsstrategi regelbundet "spegel"-versioner av aktuella lösningar med hjälp av en tungsvansad sannolikhetsfördelning. Detta uppmuntrar djärva hopp in i outforskade regioner av sökutrymmet och förhindrar att algoritmen fastnar i lokala fåror. För det andra håller en Elite Pool-strategi inte bara en enda bästa lösning, utan en liten grupp toppresterare plus en blandad "guide"-kandidat. Denna rikare ledargrupp hjälper till att upprätthålla mångfald samtidigt som den styr sökningen mot lovande regioner. För det tredje granskar en Gaussisk fördelningsbaserad reparationsmetod för de sämsta lösningarna de svagaste kandidaterna och knuffar dem mot mönster inhämtade från elitgruppen, vilket effektivt återvinner dåliga lösningar till bättre istället för att kassera dem.

Metoden på prov

För att avgöra om dessa idéer hjälper i praktiken tillämpade författarna BAGNDO på 18 välkända benchmarks från UCI-repositoriet, täckande medicinsk diagnostik, spel, signaler med mera. I varje fall sökte algoritmen efter en delmängd egenskaper som gjorde det möjligt för en standard k-närmaste grannar-klassificerare att göra träffsäkra förutsägelser. BAGNDO ställdes mot nio starka konkurrenter, inklusive partikelsvärmsoptimering, genetikinspirerade metoder och flera moderna svärminspirerade algoritmer. I dessa tester fann BAGNDO konsekvent mindre uppsättningar egenskaper samtidigt som den bibehöll, och ofta förbättrade, förutsägelseprecisionen. Den uppnådde bäst noggrannhet med de mest kompakta egenskapsdelmängderna i 14 av 18 datasätt, och statistiska tester bekräftade att dessa vinster inte berodde på slumpen.

Vad detta betyder för vardaglig maskininlärning

För en lekmannamässigt sammanfattat resultatet enkelt: författarna har byggt en mer disciplinerad "egenskapsväljare" som hjälper inlärningsalgoritmer att fokusera på vad som verkligen betyder något i en datamängd. Genom att bättre balansera bred utforskning, elitstyrning och reparation av svaga kandidater trimmar BAGNDO bort onödiga indata samtidigt som noggrannheten bibehålls eller förbättras. Det innebär snabbare modeller, minskade lagrings- och beräkningskostnader och ofta klarare insikter om vilka mätningar eller frågor som är mest informativa. Även om metoden är mer beräkningskrävande än vissa enklare alternativ, erbjuder den ett kraftfullt verktyg för problem där noggrannhet och tolkbarhet är avgörande, från medicinskt beslutsstöd till industriell övervakning och vidare.

Citering: Ghetas, M., Elaziz, M.A. & Issa, M. Enhanced generalized normal distribution optimizer with Gaussian distribution repair method and cauchy reverse learning for features selection. Sci Rep 16, 4794 (2026). https://doi.org/10.1038/s41598-026-35804-y

Nyckelord: urval av egenskaper, metaheuristisk optimering, maskininlärning, dimensionsreduktion, klassificeringsnoggrannhet