Clear Sky Science · sv

Fusionsnätverk med flera funktionsförstärkningar för semantisk segmentering av fjärranalysbilder

Skarpare kartor från skyn

Varje dag tar satelliter och drönare detaljerade bilder av våra städer och jordbruksområden. Att omvandla dessa råa bilder till tydliga pixel‑för‑pixel‑kartor över vägar, tak, träd och grödor är avgörande för uppgifter som att övervaka grödors hälsa eller planera nya bostadsområden. Denna artikel presenterar ett nytt sätt att göra dessa kartor mer precisa, särskilt längs svåra gränser där byggnader, fält och vegetation smälter ihop.

Varför flygbilder är svåra att tolka

Fjärranalysbilder ser annorlunda ut än vanliga fotografier. De tas långt ovanifrån, ofta i skarpa vinklar och under skiftande ljusförhållanden. Olika objekt kan framstå som mycket lika från luften: en betongparkering och ett plant tak kan ha nästan samma färg; olika grödoslag kan visa förvirrande liknande mönster. Samtidigt kan samma typ av objekt se väldigt olika ut beroende på skuggor, fukt eller kamerainställningar. Traditionella datorprogram, och även många moderna djupinlärningssystem, har svårt att hålla kanter skarpa under dessa förhållanden. De suddar ofta ut gränser mellan kategorier eller missar små detaljer som parkerade bilar eller smala bevattningskanaler.

Se både helheten och de fina linjerna

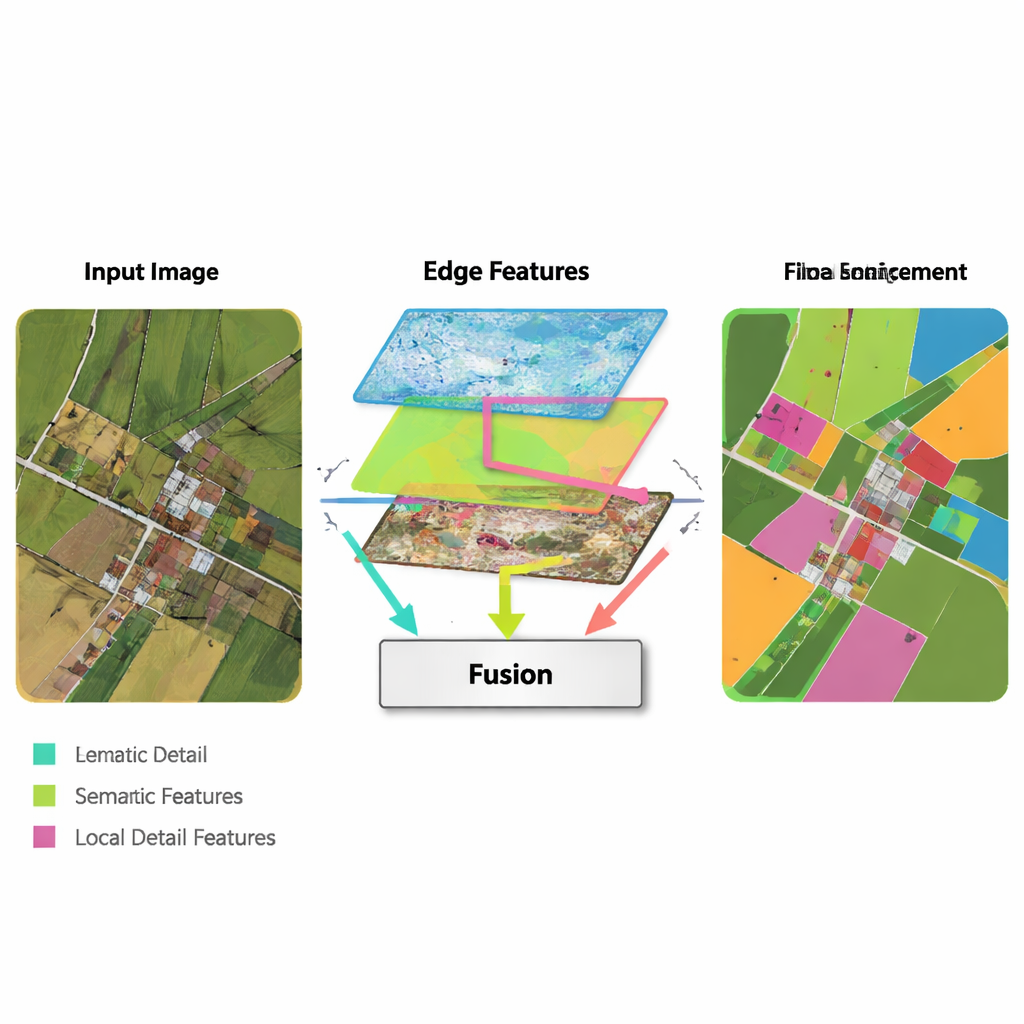

Moderna neurala nätverk lär sig genom att skicka en bild genom många lager. Tidiga lager fångar upp fina detaljer som linjer och texturer, medan djupare lager lär sig bredare mönster som ”detta område är troligen byggnader”. Utmaningen är att kombinera dessa två slags information inte är enkelt. Låg‑nivådetaljer kan vara brusiga och överflödiga, och hög‑nivåmönster kan tvätta ut kanterna och ge suddiga konturer. Författarna föreslår en ny arkitektur, kallad Multi‑Feature Enhancement Fusion Network (MFEF‑UNet), som är speciellt utformad för att balansera lokal detaljrikedom med global förståelse. Det görs genom att behandla kanter, lokala mönster och bred kontext som separata men samarbetande informationskällor.

Framhäva kanter och blanda funktioner

En central idé i den nya metoden är att låna enkla, klassiska kantdetekteringsverktyg och väva in dem i en modern djupinlärningspipeline. En Edge Enhancement Module tar de tidigaste funktionerna från nätverket och låter dem passera genom operatorer som är mycket bra på att hitta gränser—liknande hur grundläggande bildredigeringsprogram kan detektera konturer. Dessa förbättrade kantkartor produceras i flera skalor, så att nätverket ser både fina och grova gränser. En Multi‑Feature Fusion Module sammanför sedan tre strömmar: den utvecklande hög‑nivåinformationen om ”vad är detta område?”, decoderens rekonstruktion av detaljer, och kantkartorna. I stället för att bara stapla dem använder modulen en uppmärksamhetsliknande mekanism så att semantiska funktioner kan "fråga" kant‑ och detaljströmmarna var gränser och små strukturer verkligen finns, och anpassa den slutliga representationen därefter.

Balansera lokala detaljer med global kontext

En annan komponent i MFEF‑UNet är en Local‑Global Feature Enhancement Module. För den oinvigde kan detta ses som den del av nätverket som ser till att det inte tappar bort helheten medan det fokuserar på detaljerna—eller staden medan varje byggnad förfinas. Bilden delas upp i hanterbara delrutor så att närliggande pixlar kan modelleras tillsammans, vilket bevarar former och texturer. Efter denna lokala modellering sys rutorna tillbaka till en hel bild, och en andra genomgång tillåter information att flöda över avlägsna regioner. Denna tvåstegsprocess hjälper modellen att respektera både små strukturer, som bilar och smala fältgränser, och storskaliga mönster, som kvarter av bostäder eller sammanhängande vattenytor.

Bevisa metoden på städer och jordbruksmark

Forskarna testade sitt tillvägagångssätt på tre allmänt tillgängliga datamängder: två som täcker europeiska småstäder och städer, och en stor samling jordbruksbilder från USA. Dessa datamängder innehåller en blandning av tak, vägar, vegetation, vatten och subtila grödomönster. Över alla tre benchmarks producerade MFEF‑UNet konsekvent mer korrekta kartor än en rad ledande metoder, inklusive klassiska konvolutionsnätverk, transformer‑baserade arkitekturer och nyare ”state‑space”‑modeller. Dess fördelar var mest synliga runt komplexa byggnadskonturer, kluster av små objekt som fordon, och långa, smala strukturer som dräneringskanaler eller grödrader—platser där andra metoder tenderar att fragmentera eller sudda ut segmenteringen.

Vad detta betyder i praktiken

I praktiken omvandlar det föreslagna nätverket flygbilder till renare, mer tillförlitliga markkarteringskartor. Stadsplanerare kan med större förtroende mäta bebyggda ytor, ingenjörer kan bättre spåra vägar och tak, och agronomer kan mer precist avgränsa fält, vattendrag och områden med grödstress. Även om de tillagda kant‑ och fusionskomponenterna medför viss extra beräkningskostnad, förblir den övergripande designen relativt effektiv samtidigt som den levererar tydliga förbättringar i noggrannhet och robusthet. För icke‑specialister är slutsatsen att genom att medvetet betona kanter och varsamt förena olika typer av visuella ledtrådar kan datorer nu läsa satellit‑ och drönarbilder med ett skarpare öga—vilket för oss närmare uppdaterade, högprecisionskartor över världen.

Citering: Zhang, W., Yang, W., Yin, Y. et al. Multi-feature enhancement fusion network for remote sensing image semantic segmentation. Sci Rep 16, 5023 (2026). https://doi.org/10.1038/s41598-026-35723-y

Nyckelord: fjärranalys, semantisk segmentering, satellitbilder, djupinlärning, markanvändningskartering