Clear Sky Science · sv

DermNet: integrativ CNN-ViT‑arkitektur för att minska bias i dermatologisk diagnostik med avancerad osupervised lesionsegmentering

Varför diagnoser för ljusare hud är viktiga att rätta till

Hudsjukdomar drabbar nästan alla någon gång i livet, från akne och eksem till allvarligare tillstånd. För många med bruna och mörka hudtoner är dessa problem dock svårare att upptäcka och lättare att felbedöma, både i kliniken och av artificiella intelligens‑(AI‑)verktyg. Denna artikel presenterar DermNet, ett nytt AI‑system utformat för att känna igen hudsjukdomar mer rättvist över olika hudtoner genom att lära datorn fokusera på den faktiska skadade fläcken i stället för färgen på den omgivande huden.

Problemet med en enda modell för alla hudtyper

De flesta befintliga AI‑system för huddiagnostik är tränade på foton som kraftigt lutar mot ljus hud. När samma system används på personer med mörkare hud sjunker deras noggrannhet med 8–12 %. I praktiken kan den skillnaden innebära att tidiga varningssignaler missas och behandling fördröjs. Att samla balanserade medicinska bilddatasets är dessutom svårt: bilder är utspridda över sjukhus, vissa länder för förhållandevis lite digitala register och expertmärkning av dermatologer är tidsödande och kostsamt. Som en följd lär sig AI ofta genvägar, till exempel att associera vissa sjukdomar främst med ljus hud, i stället för att verkligen förstå hur en lesion ser ut.

Att lära datorn se endast den sjuka fläcken

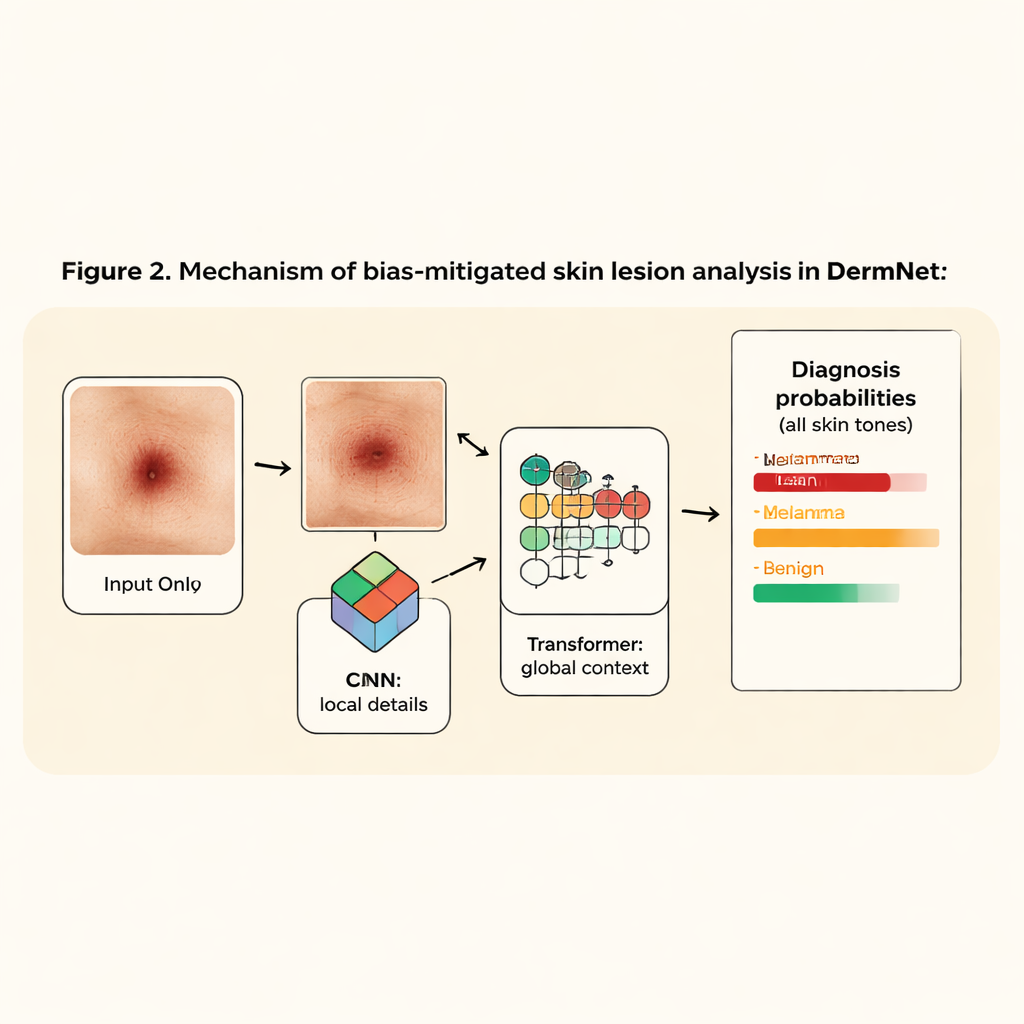

Författarna angriper denna bias vid källan: bilden själv. I stället för att mata fulla foton av arm, ansikte eller ben till AI:n beskär de först automatiskt bara det sjuka området — lesionen — oavsett vilken färg den omgivande huden har. För detta kombinerar de ett kraftfullt open‑source‑verktyg kallat Segment Anything (som kan avgränsa objekt utan särskild träning) med klassiska bildbehandlingsmetoder som framhäver skillnader i färg och ljusstyrka. Genom att smart växla färgrymder och applicera automatisk tröskling producerar de svartvita ”masker” som separerar lesion från normal hud. Anmärkningsvärt nog når denna osupervised pipeline cirka 90 % överlappning med expertritade lesionkonturer över både ljusare och mörkare hudtoner, utan att förlita sig på handritade träningsmasker.

Nätverkets slankare, smartare design för hudsjukdomar

När lesionen väl isolerats tar DermNet över. Denna klassificerare blandar två populära AI‑idéer: konvolutionella neurala nätverk (CNN), som är bra på att upptäcka kanter och texturer, och vision transformers, som utmärker sig på att fånga långräckande mönster i en bild. DermNet använder först bara två lätta CNN‑lager för att extrahera finare detaljer från den beskurna lesionen, och för vidare dessa mönster in i en transformer som lär sig hur olika delar av lesionen relaterar till varandra. Eftersom systemet inte längre behöver tolka helkroppsfoton kan det hållas litet — cirka 2,5 miljoner parametrar, under 10 megabyte — samtidigt som det överträffar mycket större och mer använda bildmodeller.

Att bygga ett mer rättvist dataset bakom kulisserna

För att träna och testa DermNet slog teamet samman två dermatologannoterade samlingar till det de kallar SkinCon‑datasetet. Efter att ha krävt minst 20 bilder per sjukdom fick de 3 643 bilder som täcker 122 tillstånd, med ungefär en tredjedel vardera från ljusa, bruna och mörka hudtyper. De utökade vidare denna uppsättning genom enkla transformationer, som rotation och ändringar i ljusstyrka, för att minska överanpassning och öka robustheten. Med detta mångsidiga och kurerade dataset fann de att träning på fullständiga, osegmenterade bilder ledde till instabil inlärning och valideringsnoggrannhet runt 50–56 %. När de övergick till enbart lesioninmatningar steg prestandan markant: DermNet nådde cirka 81 % valideringsnoggrannhet och gjorde det mer konsekvent över alla tre hudtonsgrupper.

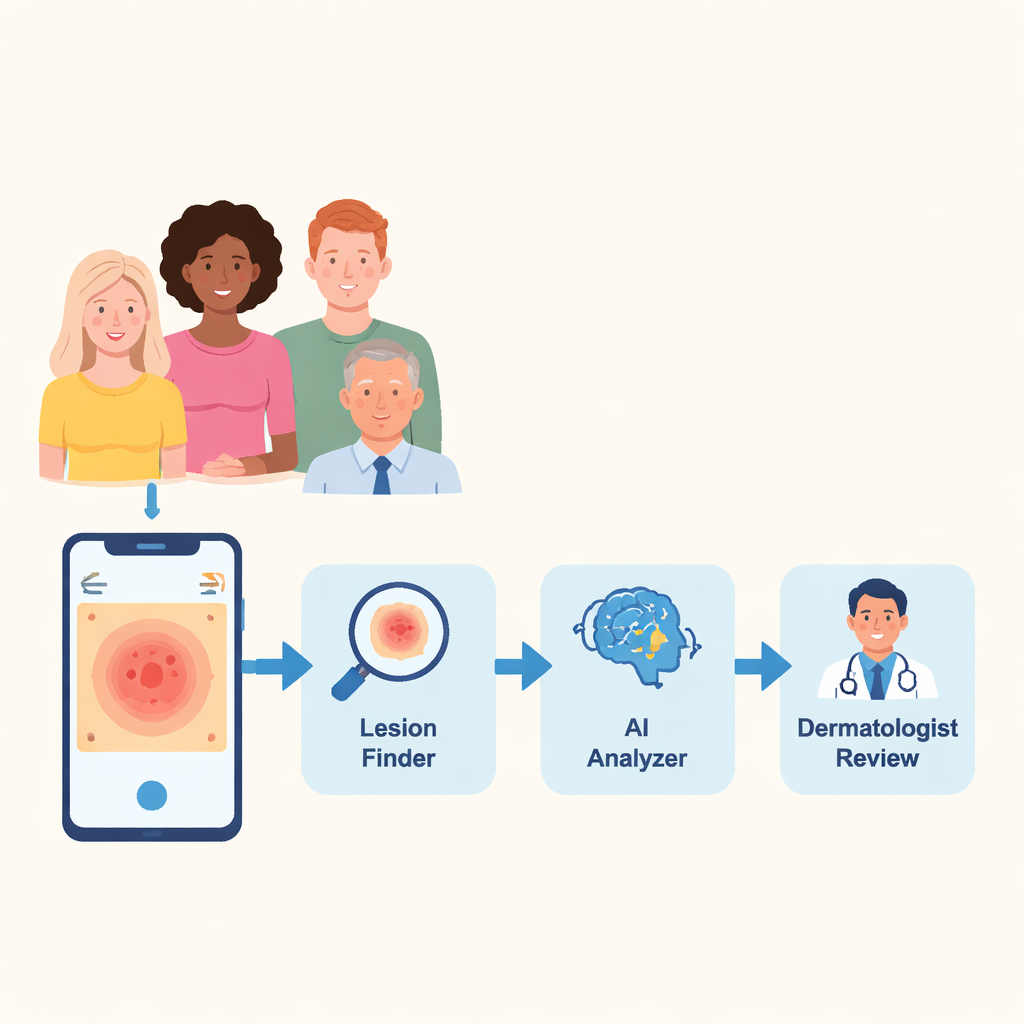

Från laboratoriepipeline till fickassistent

För att visa hur detta kan fungera i praktiken byggde forskarna en prototyp av en mobilapp. En användare tar eller laddar upp ett foto av ett misstänkt hudområde; systemet segmenterar automatiskt lesionen, kör den genom DermNet och returnerar de tre mest sannolika diagnoserna med deras sannolikheter — på under 20 sekunder — medan den slutgiltiga bedömningen lämnas till en dermatolog. Även om det inte är en ersättning för en läkare kan sådana verktyg flagga för sjukdom i tidiga skeden, särskilt i regioner där dermatologer är få, och hjälpa till att rikta begränsad specialisttid till de mest brådskande fallen.

Vad detta betyder för vardagspatienter

Huvudpoängen för icke‑experter är att AI inte behöver vara ”färgblind” i en naiv bemärkelse; i stället kan den styras att titta på rätt sak: själva lesionen. Genom att ta bort påverkan från bakgrundens hudton och fokusera på det sjuka området visar denna studie att det är möjligt att bygga en slank, noggrann modell som behandlar bilder av ljus, brun och mörk hud mer lika. DermNet är ett tidigt steg mot hudsjukdomsappar och diagnostiska system som fungerar pålitligt för alla, inte bara för dem vars hud råkar matcha majoriteten av befintliga medicinska foton.

Citering: Imran, M.H., Shahid, M., Aazam, M. et al. DermNet: integrative CNN-ViT architecture for bias mitigation in dermatological diagnostics using advanced unsupervised lesion segmentation. Sci Rep 16, 5291 (2026). https://doi.org/10.1038/s41598-026-35697-x

Nyckelord: diagnos av hudsjukdomar, medicinsk AI‑bias, lesionsegmentering, dermatologisk bildbehandling, vision transformer