Clear Sky Science · sv

NeoHebbianska synapser för att påskynda online‑träning av neuromorfa hårdvaror

Att lära chip att lära av erfarenhet

Modern artificiell intelligens är anmärkningsvärt kraftfull men långt ifrån hjärnans förmåga att lära sig från glesa, fördröjda återkopplingar—som att komma ihåg vilken genväg genom stan som faktiskt sparade tid. Denna artikel presenterar en ny typ av artificiell ”synaps”, förbindelserna mellan artificiella neuroner, som låter neuromorfa chip lära på ett mer hjärneliknande, online‑sätt samtidigt som de förblir kompakta och energieffektiva. För läsare intresserade av AI‑hårdvarans framtid visar den hur värme i sig kan användas som en användbar signal för inlärning inne i små minnesenheter.

Varför neuromorfa hjärnor behöver bättre synapser

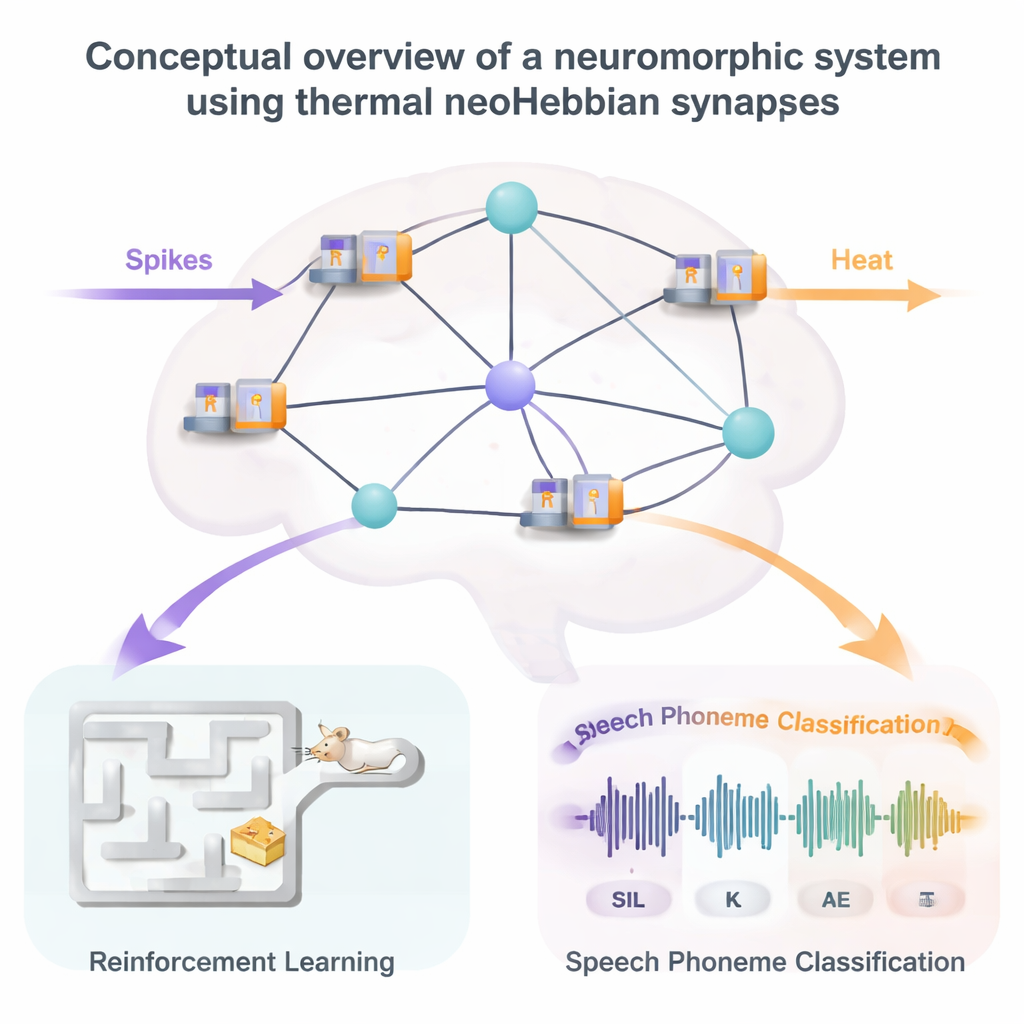

Neuromorf databehandling syftar till att efterlikna hur hjärnan bearbetar information: genom spikande neurala nätverk, där korta elektriska spikar passerar genom omfattande nätverk av synapser. Dagens hårdvara kan redan realisera synapser med memristiva komponenter som ReRAM, vars elektriska ledningsförmåga kan justeras för att lagra en vikt. Enkla ”hebbiska” inlärningsregler—där synapser förstärks eller försvagas enbart utifrån lokal spike‑tidsing—har dock svårt med realistiska uppgifter som kräver att knyta ihop händelser åtskilda i tid, såsom talförståelse eller navigationsproblem. Standardtekniker inom djupinlärning löser detta med backpropagation through time, men den metoden kräver för mycket minne och energi för hjärneliknande hårdvara. Fältet har därför vänt sig till ”tre‑faktors” inlärningsregler och algoritmer som eligibility propagation (e‑prop), vilka inför ett extra lokalt minnesspår i varje synaps så att en fördröjd global belöningssignal fortfarande kan justera rätt förbindelser.

Att lagra ett avtagande minne i värme

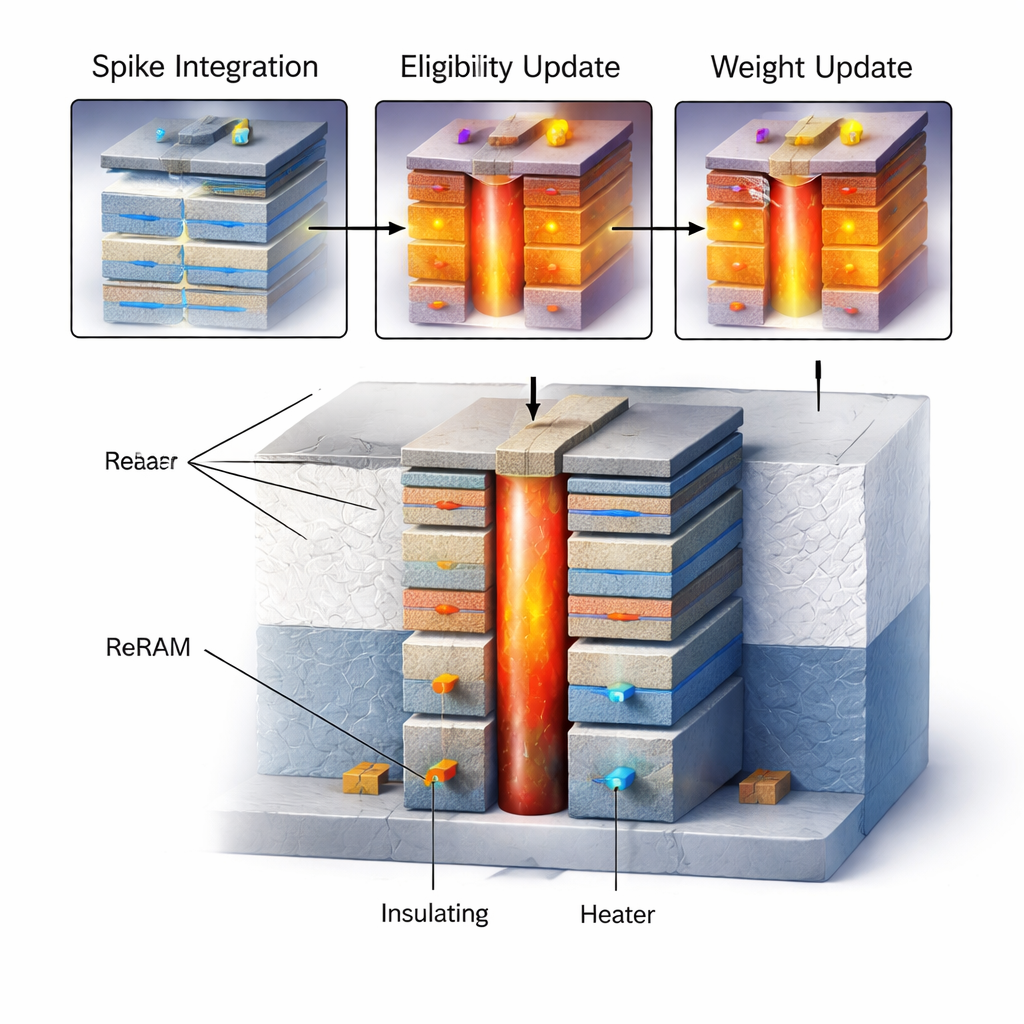

Huvudidén i detta arbete är en ”neoHebbiansk” synaps som har två interna tillståndsvariabler: en långtidskopplad vikt och ett korttids berättigandespår (eligibility trace) som minns nylig aktivitet. Vikten kodas, som vanligt, i ledningsförmågan hos en ReRAM‑enhet. Eligibility‑spåret däremot lagras i den lokala temperaturen hos samma enhet, kontrollerad av en nanoskalig resistiv värmare integrerad direkt ovanför eller intill den. Under normal spike‑bearbetning multiplicerar ReRAM enkelt inkommande spikar med sin lagrade vikt. Under inlärning driver neuronala signaler som motsvarar ”vad som fyrade tidigare” och ”hur känslig den postsynaptiska neuronen för närvarande är” ström genom den lilla värmaren. Eftersom värmaren och ReRAM är termiskt kopplade höjer denna effekt enhetens temperatur i proportion till produkten av de två signalerna—det matematiska eligibility‑spår som e‑prop‑algoritmen kräver.

Hur värme förändrar minnet

När en kort indatasekvens—kallad ett dataframe—har bearbetats kodar den ackumulerade temperaturökningen hur ”berättigad” den synapsen är att ändras. En fast programmeringspuls appliceras därefter över ReRAM. Avgörande experiment visar att den resulterande ledningsförändringen är starkt temperaturberoende: varmare enheter förändras mer, och riktning och magnitud av förändringen beror på det initiala ledningsläget och på om enheten drivs mot högre eller lägre ledningsförmåga. Genom att noggrant välja pulsamplituder och utnyttja denna temperatursensitivitet ordnar författarna så att viktförändringen blir ungefär proportionell mot det lagrade eligibility‑spåret. Numeriska modeller av värmeflöde i en 3D‑integrerad värmar‑plus‑ReRAM‑stapel bekräftar att temperaturen kan höjas och tillåtas avklinga över justerbara tidsskalor, och att strukturen kan utformas för att förstärka önskad självuppvärmning samtidigt som termisk ”korsprat” till intilliggande synapser begränsas.

Att utsätta termiska synapser för prov

För att bedöma om denna exotiska synaps verkligen är användbar simulerar författarna hela neuromorfa system som inkluderar realistiska enhetsbeteenden såsom temperaturavklingning, enhets‑till‑enhets‑variabilitet och begränsad precision. I en demonstration styr ett spikande nätverk en virtuell mus som måste lära sig navigera i ett rutnätsliknande labyrint för att hitta ost samtidigt som den undviker fällor. Här fungerar naturlig termisk avkylning—som långsamt urholkar det lagrade eligibility‑spåret—som den ”diskonteringsfaktor” som är bekant från förstärkningsinlärning: nyligen inträffade tillstånd‑aktionspar betyder mer än avlägsna. Simuleringarna visar att inlärningen är snabbast när denna avklingning varken är för snabb eller för långsam, och att variabilitet i ReRAM‑beteende försämrar prestandan bara gradvis. I ett andra, mer krävande test tränas ett rekurrent spikande nätverk med termiska neoHebbianska synapser online på TIMIT‑datasetet för fonemklassificering, en standarduppgift inom taligenkänning. Med tillräcklig ledningsupplösning (ungefär motsvarande 8 bitar) når den hårdvaruvänliga modellen en noggrannhet inom ett par procent av en ideal, flyttalsbaserad implementation.

Vad detta betyder för framtidens AI‑hårdvara

Sammanfattningsvis visar studien att lokal temperatur kan fungera som ett praktiskt, styrbart internt minne för avancerade inlärningsregler, vilket möjliggör snabb, inbyggd träning utan massiva digitala overheadkostnader. Den föreslagna synapsen upptar ungefär samma yta som en konventionell ReRAM‑cell, men implementerar både en stabil vikt och ett avtagande spår, och dess energikostnad per inlärningssteg ligger i pikojoule‑området. Att förlita sig på värme innebär visserligen verkliga utmaningar—temperatur är svårt att mäta direkt och kan påskynda enhetsnedbrytning—men arbetet antyder att att omfamna snarare än bekämpa elektro‑termiska effekter kan låsa upp nya klasser av kompakta inlärningshårdvaror. För icke‑experter är slutsatsen att framtida AI‑chip kanske inte bara förflyttar elektroner: de kan också räkna med noggrant utformade värmemönster, vilket för maskininlärning ett steg närmare människohjärnans effektivitet och anpassningsförmåga.

Citering: Pande, S., Bezugam, S.S., Bhattacharya, T. et al. NeoHebbian synapses to accelerate online training of neuromorphic hardware. Sci Rep 16, 6836 (2026). https://doi.org/10.1038/s41598-026-35641-z

Nyckelord: neuromorf databehandling, spikande neurala nätverk, ReRAM‑synaps, onlineinlärning, hårdvarueffektiv AI