Clear Sky Science · sv

CRFusion: ett nytt LiDAR-kamera-fusionsnätverk för konstruktion av BEV-kartor

Smartare digitala kartor för självkörande bilar

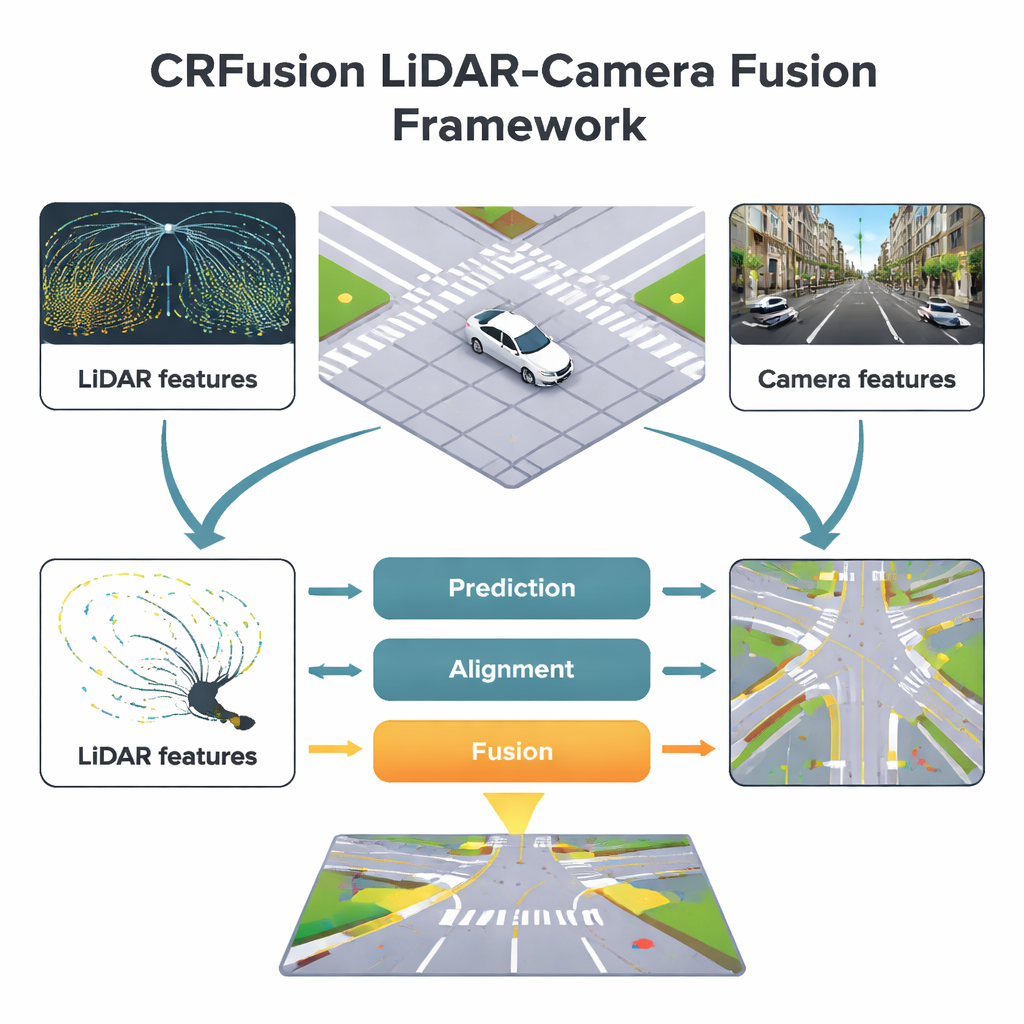

För en självkörande bil är förståelsen av vägen framför som att läsa en ständigt förändrande karta. Fordonet måste veta exakt var körfält, övergångsställen och vägkanter finns, även när det är mörkt, regnar eller något skymmer sikten. Denna artikel presenterar CRFusion, ett nytt system som kombinerar laserskannrar och kameror för att bygga renare, mer pålitliga överblickskartor över stadsgator, vilket hjälper autonoma bilar att hålla sig i rätt körfält och undvika gående med större säkerhet.

Varför två “elektroniska ögon” är bättre än ett

Moderna självkörande bilar förlitar sig i hög grad på två huvudgivare. Kameror fångar rika färgbilder, vilket gör det enkelt att upptäcka körfältsmarkeringar, trafikskyltar och övergångsställen långt fram. Laserskannrar, eller LiDAR, skickar ut ljuspulser och mäter återkomsten, vilket bygger en noggrann 3D-bild av avstånd och former runt bilen. Var och en har svagheter: kamerabilder kan luras av dåliga ljusförhållanden eller väder, medan LiDAR-mätningar blir glesa och ofullständiga med ökande avstånd. CRFusion är utformat för att slå ihop dessa styrkor och svagheter till en enda fågelperspektivsvy, en top-down-karta där varje pixel representerar en liten markfläck märkt som körfält, skiljeremsa eller övergångsställe.

Att fylla i luckorna i långdistansseendet

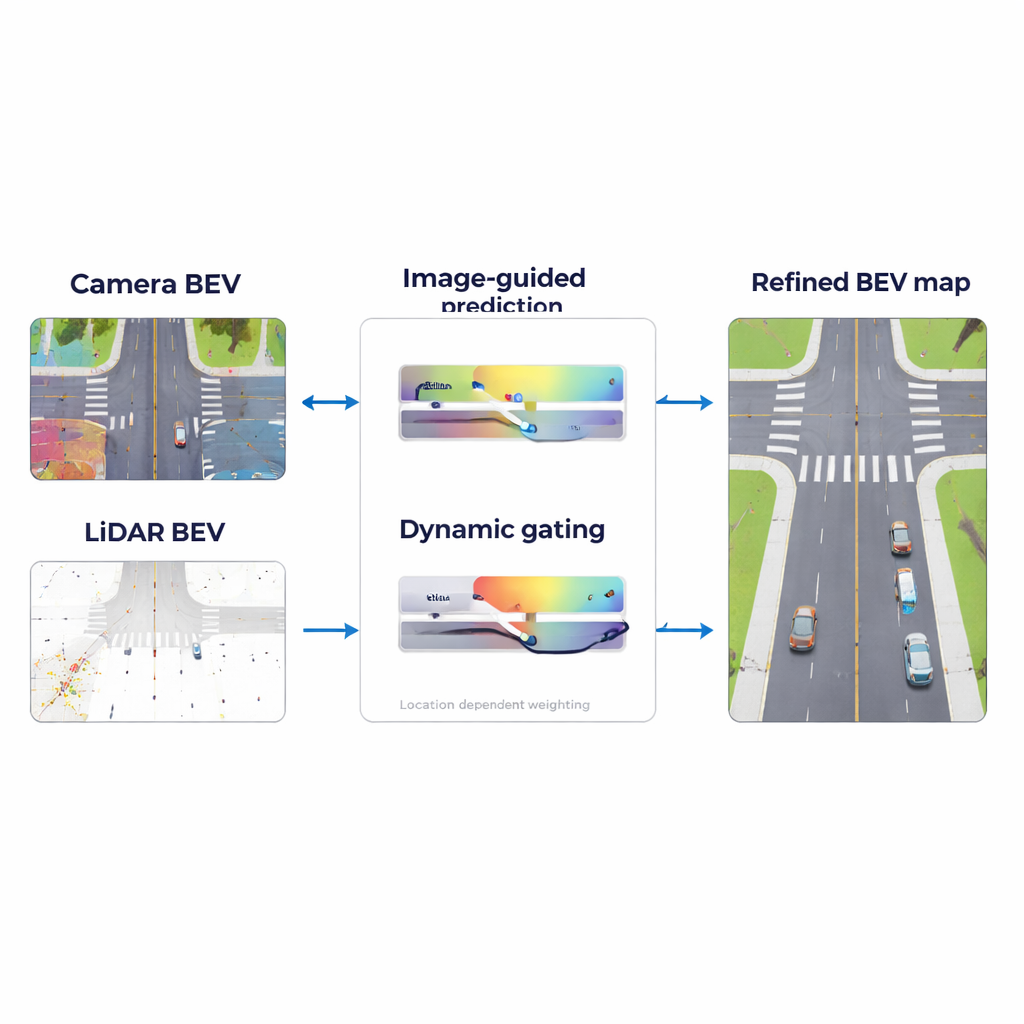

En central utmaning i väggkartläggning är att LiDAR ofta missar detaljer långt från bilen, precis där planering i förväg är viktigast. CRFusion tacklar detta med en ”LiDAR Range Predictor”. I enkla termer tittar systemet på vad kameran ser långt fram på vägen och använder den informationen för att gissa vad LiDAR skulle ha mätt om det hade varit tätt och komplett. En mekanism kallad attention hjälper modellen att avgöra vilka delar av kamerans vy som bäst förklarar de tomma eller osäkra områdena i LiDAR-baserade kartan. Den förfinar sedan denna prediktion genom att jämföra intilliggande regioner i kartan, förstärka konsekventa mönster som kontinuerliga körfältslinjer och minska slumpmässigt brus.

Få sensorerna att vara överens om samma bild

Även när både kamera och LiDAR fungerar gör de inte alltid perfekt överensstämmelse. Små fel i avståndsuppskattningar eller sensorplacering kan göra att körfältsmarkeringar som ses av kameran verkar något förskjutna jämfört med LiDAR-avläsningar. CRFusion inför ett aligneringssteg som varsamt ”böjer” kamerans top-down-egenskaper så att de bättre matchar LiDAR-vyn. Detta görs med ett lättviktskorrektionsnätverk som förutsäger hur varje punkt i kamerans karta bör skjutas. Som resultat beskriver de två givarvyerna samma fysiska vägpositioner, vilket gör den senare fusionen mycket mer pålitlig.

Anpassning till dag, natt och dåligt väder

När de två givarvyerna väl är justerade måste systemet fortfarande avgöra hur mycket det ska lita på vardera vid varje plats. En solig motorväg med tydlig körfältsmarkering är mycket annorlunda än en regnig natt i en trång stad. CRFusion hanterar detta med en modul kallad ”Dynamic Gated Fusion” som tilldelar flexibla vikter åt kamera- och LiDAR-egenskaper över kartan. Där LiDAR-returer är starka, såsom närliggande vägkanter eller fasta objekt, lutar systemet mer mot LiDAR. Där visuella ledtrådar är tydligare, såsom ljusa övergångsställen på avstånd, förlitar det sig mer på kameran. Dessa vikter lärs automatiskt från data, vilket gör att fusionsstrategin kan skifta smidigt när förhållandena förändras.

Bevis för fördelarna i verkliga data

Forskarna testade CRFusion på en allmänt använd dataset för självkörning kallad NuScenes, som innehåller många körscener i olika städer, väder och tidpunkter på dygnet. Jämfört med ledande tidigare metoder producerade CRFusion mer exakta körfältsgränser, skiljeremser och övergångsställen, särskilt på medel- och långa avstånd upp till 90 meter. Det förbättrade standardmått för både överlappning med referenskartor och förmågan att upptäcka individuella körfältsegment, och en ablationsstudie visade att varje huvudkomponent — långdistansprediktionen, aligneringsnätverket och den dynamiska fusionen — bidrog med betydande förbättringar. Visuella exempel visade jämnare kontinuitet i körfält och tydligare övergångsställen, vilket bekräftar att systemets kartor mer liknar noggrant ritade vägplaner.

Vad detta betyder för vardaglig körning

För icke-specialister är huvudslutsatsen att CRFusion hjälper självkörande bilar att bygga renare, mer pålitliga gatkartor genom att låta kameror och LiDAR ”prata med varandra” på ett smartare sätt. Genom att förutsäga saknad LiDAR-information från kameravyer, ställa in de två givarperspektiven i linje och justera hur mycket det litar på respektive beroende på situation, minskar systemet blinda fläckar och gissningar. Det förflyttar autonoma fordon ett steg närmare att hantera komplexa, röriga stadsgator med samma självförtroende som en försiktig mänsklig förare som följer välmarkerade körfält och övergångar.

Citering: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Nyckelord: självkörande fordon, LiDAR-kamera-fusion, HD-semantiska kartor, fågelperspektiv-perception, stadskartering