Clear Sky Science · sv

En ny djupinlärningsmetod för klassificering av myggarter via en dubbelhuvudstruktur och kalibreringsmedveten fusionsarkitektur

Varför smartare myggidentifiering spelar roll

Myggor är små, men sprider några av världens farligaste sjukdomar. Hälsomyndigheter förlitar sig i allt högre grad på mobilbilder av infångade insekter för att spåra var olika arter dyker upp. Problemet är att många myggor ser förvillande lika ut, och fältbilder är ofta suddiga, dåligt belysta eller tagna med många olika kameror. Den här studien presenterar ett nytt artificiellt intelligenssystem som kan skilja åt liknande myggarter med laboratorienivånoggrannhet, samtidigt som det uppskattar hur säkert det är i varje beslut — en förmåga som är avgörande när besluten styr verkliga smittskyddsinsatser.

Från mobilbilder till pålitliga identifieringar

Forskarnas fokus ligger på bilder som liknar vad en fältarbetare eller medborgarforskare kan ta: hela myggor fotograferade med smarttelefoner mot röriga, verkliga bakgrunder. Målet är tvåfalt. För det första ska systemet korrekt skilja mellan åtta kategorier, inklusive flera sjukdomsöverförande Aedes- och Culex-arter och en grupp för "annan/okänd". För det andra måste det ange sin säkerhet i varje prediktion på ett sätt som stämmer med verkligheten, så att ansvariga tryggt kan sätta trösklar — till exempel när ett uppföljningsbesök i ett område ska utlösas. Dåligt kalibrerade system kan verka säkra men ofta ha fel när de används på nya platser eller med andra kameratyper.

Två synvägar som samarbetar

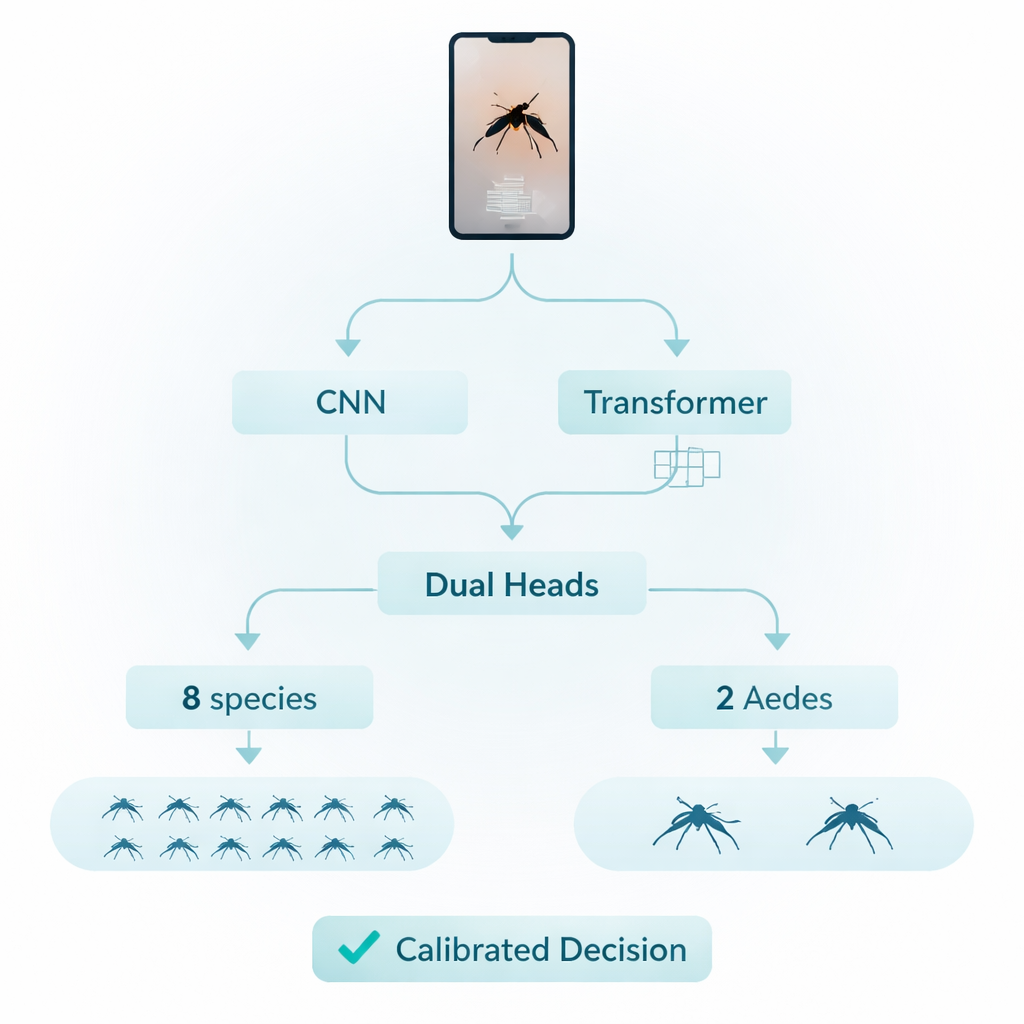

För att nå dessa mål bygger teamet en bildanalyspipeline som kombinerar två kompletterande sätt att "se". Den ena vägen använder konventionella konvolutionella neurala nätverk (CNN), som är utmärkta på att fånga lokala texturer som kroppsskal, ränder och vingårar. Den andra vägen använder en nyare design kallad Transformer, som är bättre på att fånga helhetsarrangemanget av kroppsdelar i bilden, såsom proportioner mellan vingar, thorax och bakkropp. Båda vägarna bearbetar samma myggbild parallellt och skickar sedan sina bedömningar till en gemensam beslutmodul. Denna mångsidiga uppsättning hjälper systemet att vara pålitligt även när foton varierar i pose, fokus eller enhet.

Lär sig både detaljerade och grova etiketter

En nyckelinnovation ligger i hur systemet tränas att tänka kring arter. Istället för att lära sig bara en uppgift lär det sig två samtidigt. Ett "huvud" förutsäger alla åtta kategorier i huvuddatasetet. Ett andra "huvud" fokuserar enbart på att skilja mellan två nära besläktade Aedes-arter som är av särskilt folkhälsomyndigt intresse. Genom att gemensamt lära dessa fina och grova distinktioner skärper modellen gränserna mellan lätt förväxlade arter samtidigt som den fortfarande känner igen den bredare uppsättningen. Under träningen ombalanserar författarna också medvetet data så att sällsynta arter får större inflytande och systemet inte enbart favoriserar de vanligaste myggorna.

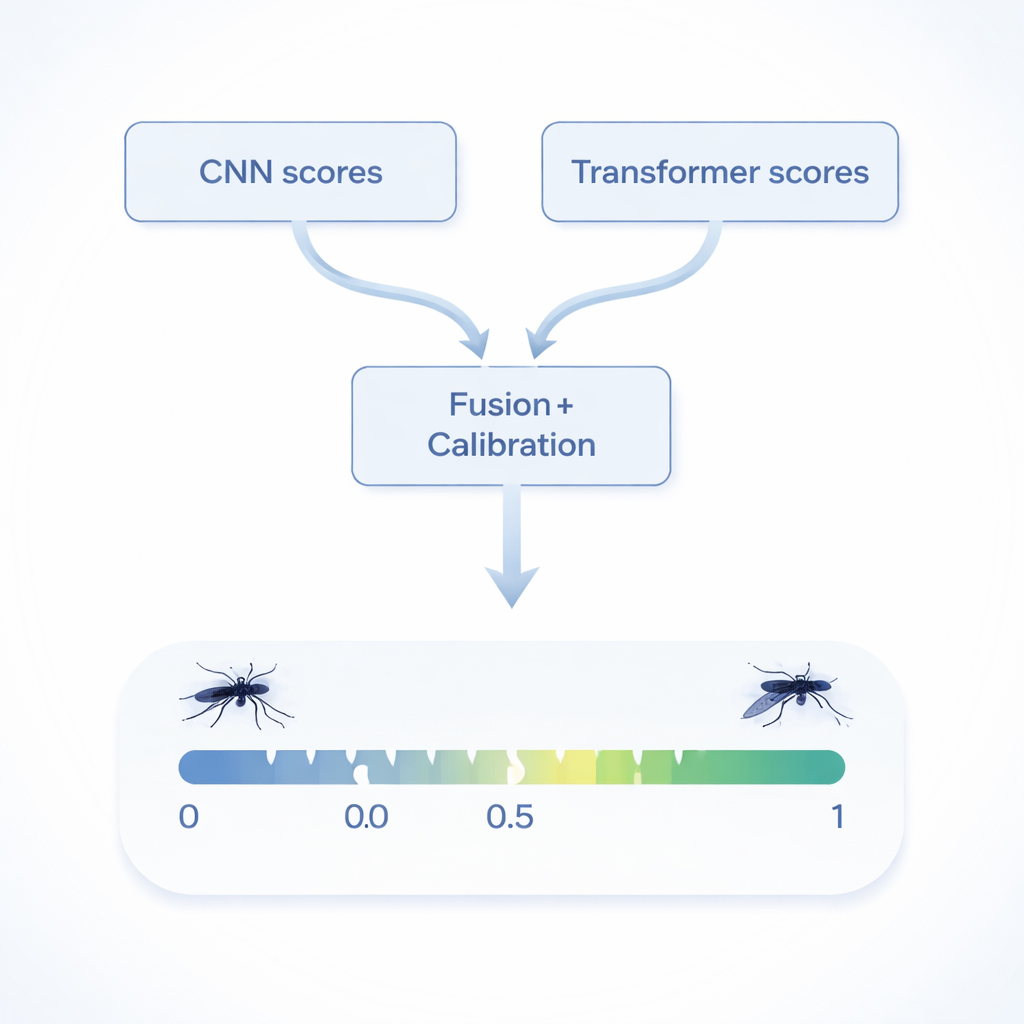

Att omvandla råa poäng till tillförlitlig sannolikhet

En annan central framsteg är hur systemet fusionerar information från sina två synvägar och två huvuden. Istället för att bara genomsnittsbilda deras gissningar lär sig modellen hur mycket den ska lita på varje intern källa baserat på tidigare prestanda, en process som kallas kalibrerad stapling. Den passeras sedan den kombinerade poängen genom ett enkelt justeringssteg kallat temperaturskalning, som finjusterar skärpan i dess konfidensnivåer. Teamet testar också varje bild flera gånger med lätt ändrade beskärningar och speglingar, och tar medelvärdet av resultaten för att minska slumpmässig variation. Tillsammans gör dessa steg att de slutgiltiga konfidenspoängen stämmer väl överens med verkliga felgrader, även när systemet appliceras på en separat datamängd det aldrig tidigare sett.

Nästan perfekt noggrannhet i labbet och i fält

För att se hur väl detta fungerar i praktiken tränar och finjusterar författarna sin modell på en stor åttaklassig smarttelefonbildsamling och utvärderar den sedan både på hållna bilder från samma uppsättning och på ett helt separat Aedes-dataset som används strikt för testning. På den ursprungliga åttaklassuppgiften når deras metod cirka 99,5 procent noggrannhet, något men konsekvent bättre än starka enkelmodellsbaslinjer och enkla ensemblemetoder. På den osett tvåarts-testuppsättningen identifierar den korrekt över 99 procent av bilderna. Lika viktigt är att dess konfidens är väl kalibrerad: när den rapporterar 90 procents säkerhet har den fel bara ungefär en gång av tio — en egenskap som många tidigare myggigenkänningssystem inte mätte eller garanterade.

Vad detta betyder för folkhälsan

För icke-specialister är slutsatsen att detta arbete levererar inte bara en mycket exakt artigenkännare utan också en vars självrapporterade säkerhet kan litas på. Den kombinationen gör det möjligt för myndigheter att fastställa stabila regler — såsom "undersök varje plats där modellen är minst 80 procent säker på att den sett en farlig art" — och förvänta sig att dessa regler beter sig likartat över olika telefoner, regioner och ljusförhållanden. Trots att utmaningar kvarstår i extrema fall som mycket suddiga eller kraftigt dolda insekter erbjuder det föreslagna systemet en praktisk, driftsklar baseline för storskalig myggövervakning och lägger grunden för framtida verktyg som kan hantera nya arter, nya enheter och även ytterligare sensormodaler som ljud.

Citering: Nazari, M.Z., Zarchi, M.S., Emadi, S. et al. A novel deep learning approach for mosquito species classification via a dual-head structure and calibration-aware fusion architecture. Sci Rep 16, 7208 (2026). https://doi.org/10.1038/s41598-026-35453-1

Nyckelord: myggidentifiering, djupinlärning, vektorsurveillance, kalibrerad AI, bildklassificering