Clear Sky Science · sv

Diagnostikens roll vid bedömning av robotars kompetens

Varför robotmisstag angår oss alla

Robotar och AI-system rör sig snabbt från laboratorier in i fabriker, sjukhus och våra gator. När vi börjar förlita oss på dem blir en fråga avgörande: hur avgör människor om en robot verkligen är kompetent? Denna artikel undersöker hur vi bedömer en robot som vanligtvis presterar väl men som då och då gör ett överraskande misstag — eller uppnår en oväntad framgång. Resultaten hjälper förklara varför våra intuitiva känslor inför maskiner kan skilja sig från vad vi säger högt, och varför ett enstaka fel antingen kan avfärdas eller permanent förändra vårt förtroende.

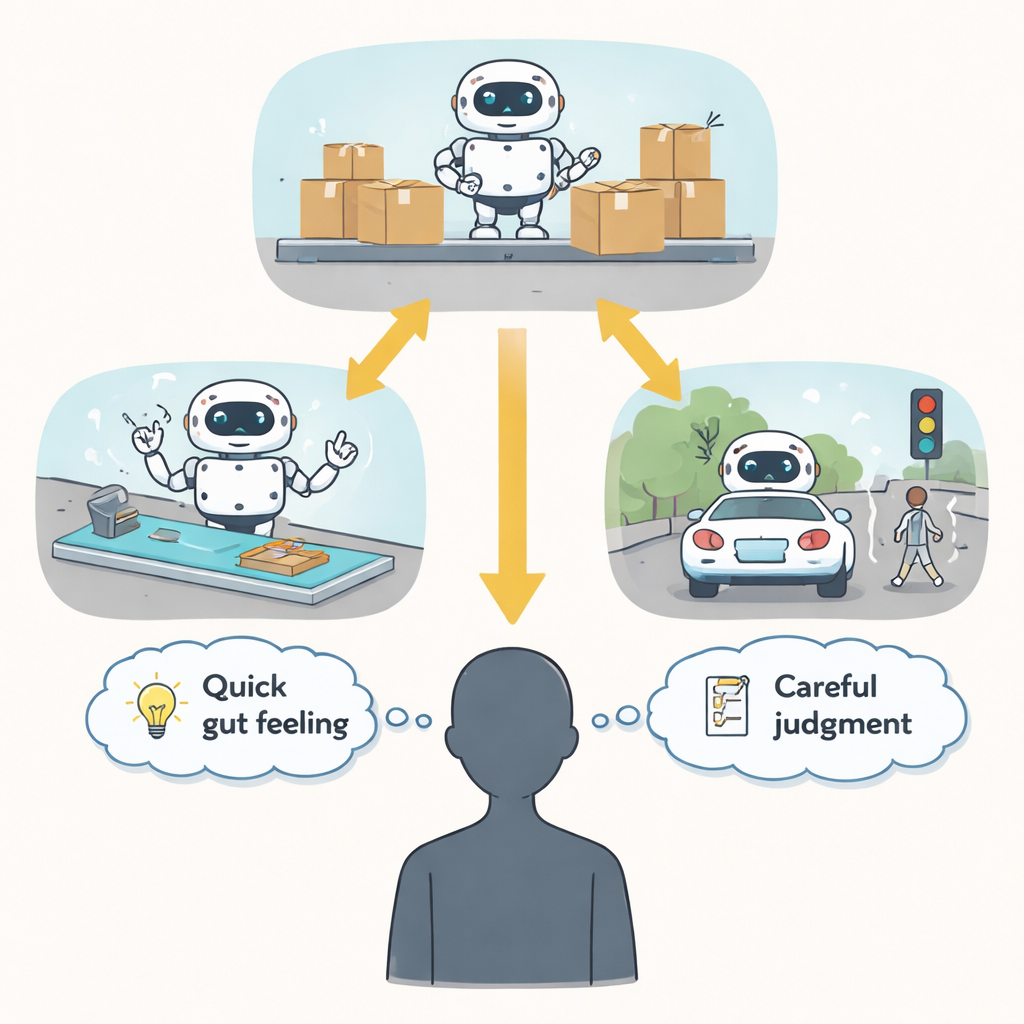

Två sätt vårt sinne bedömer maskiner på

Psykologer skiljer mellan två slags intryck. Explicit intryck är de bedömningar vi kan rapportera direkt när vi blir tillfrågade, till exempel att betygsätta en robot på en skala från 1 till 7 avseende kompetens. Implicita intryck är mer automatiska och syns i snabba responser som folk gör utan att fokusera på utvärdering. Tidigare arbete föreslog att explicita intryck förändras snabbt när vi ser nytt beteende, medan implicita intryck rör sig långsammare. Denna studie frågar om den skillnaden verkligen handlar om olika mentala system — eller om den beror på hur informativt, eller diagnostiskt, det nya beteendet verkar för robotens verkliga förmåga.

Från fabriksgolven till operationssalar och motorvägar

I nio nätbaserade experiment med fler än 3 700 deltagare visade forskarna människor olika robotar i realistiska miljöer: en industrirobot som navigerar i ett trångt lager, en kirurgisk robot som följer precisa banor och en självkörande bil som reagerar på hinder i vägbanan. Ibland var roboten konsekvent skicklig eller konsekvent klumpig. I andra fall var den mestadels kompetent men gjorde ett enda tydligt misstag, eller mestadels inkompetent men hade ett enskilt framstående lyckat tillfälle. Efter att ha sett korta sekvenser av dessa prestationer mättes deltagarnas intryck på två sätt: direkta självrapporterade frågor och indirekta uppgifter som fångade snabba, automatiska reaktioner.

När ett udda framträdande väger tungt

I dessa realistiska scenarier följde människors explicita betyg robotarnas både övergripande mönster och den sällsynta ”oddball”-trialen. Ett enskilt misstag bland många framgångar kunde märkbart dra ner de explicita betygen, och en enstaka framgång bland många misslyckanden kunde höja dem. Implicita intryck berättade däremot en annan historia. De reagerade starkt på robotens typiska beteende — om den vanligtvis var kompetent eller inte — men bortsåg i stor utsträckning från den enskilda oddballen. Denna dissociation kvarstod även när forskarna noggrant omformade sina mått så att de ”explika” och ”implicita” uppgifterna såg ut och kändes så lika som möjligt, och i huvudsak skiljde sig endast i om deltagarna uttryckligen instruerades att bedöma roboten.

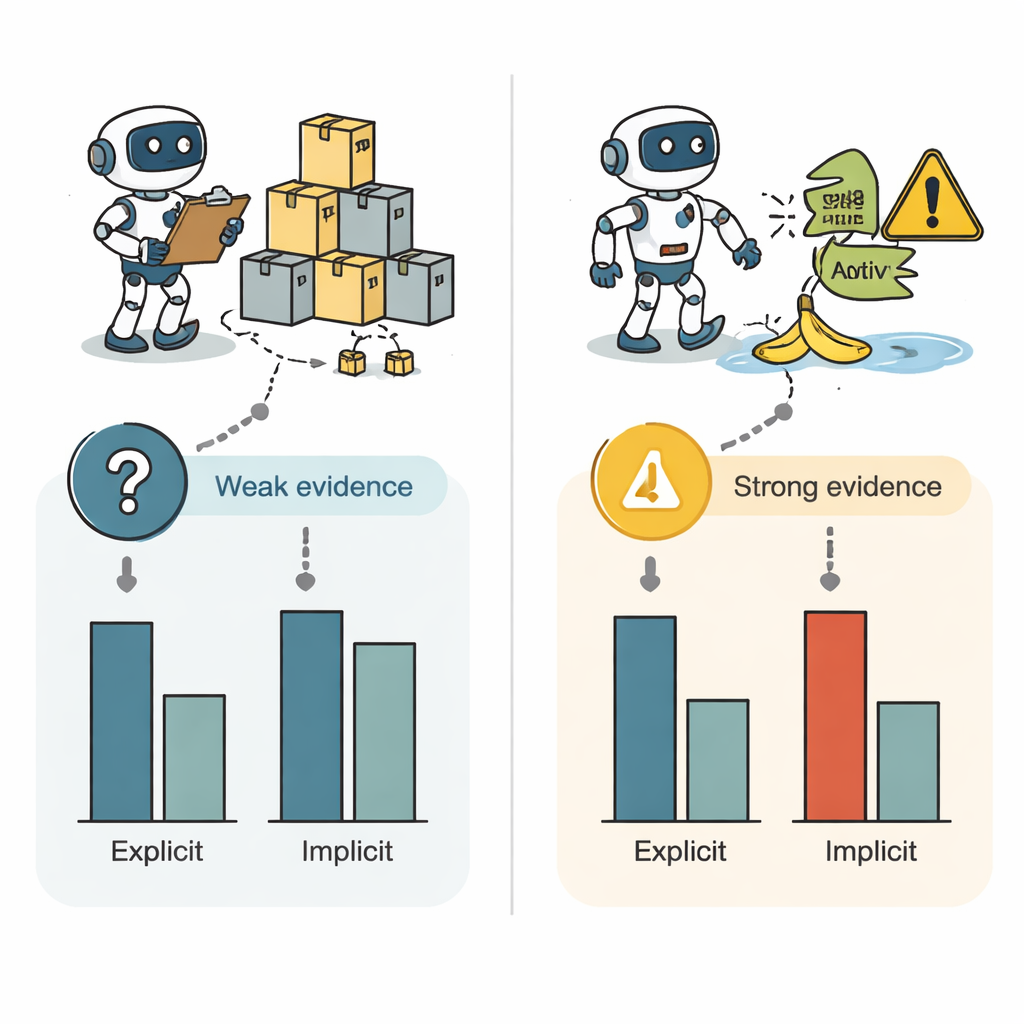

Vad som gör ett robotfel verkligt talande

Forskarna testade sedan en nyckelidé: att styrkan i en oddball-händelse beror på hur diagnostisk den verkar — om människor tror att den verkligen avslöjar något bestående om roboten. I nya studier såg deltagarna först en robot genomföra flera felfria försök, och senare såg de ett eller flera fel. När de senare felen presenterades som viktiga, färska tester, eller när flera fel ackumulerades så att de motsvarade mängden tidigare framgångar, skiftade både explicita och implicita intryck. Avgörande var att under dessa hög-diagnostiska förhållanden räckte även ett enda fel för att rubba automatiska, implicita intryck. När samma slags misstag beskrevs som föråldrat, oviktigt eller ett engångsfel rörde sig de implicita intrycken knappt alls, även om de explicita betygen fortfarande förändrades.

Varför detta spelar roll för vardagligt förtroende för AI

Sammantaget tyder fynden på att våra snabba, automatiska intryck av robotars kompetens inte är blinda för ny information, men att de kräver starkare eller mer tydligt meningsfulla bevis innan de förändras. Våra uttalade bedömningar, däremot, är mycket mottagliga även för svaga eller tvetydiga händelser, delvis eftersom vi känner press att använda vilken information vi har när någon ber oss att bedöma. För formgivare, ingenjörer och beslutsfattare innebär detta att hantering av förtroende för robotar inte bara handlar om att minska fel, utan också om hur dessa fel ramas in och förstås. Ett enda högt talande fel — som en bil som inte stannar när den uppenbart borde — kan omforma både våra magkänslor och våra uttalade åsikter, med direkta konsekvenser för hur villiga vi är att ta i bruk och förlita oss på intelligenta maskiner.

Citering: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Nyckelord: robotkompetens, människa-robot-interaktion, implicit bias, förtroende för AI, diagnostisk information