Clear Sky Science · sv

En multimodal metod för att känna igen falska nyheter och inflytelserika noder som sprider dem med djupinlärning och nätverksanalys

Varför detta spelar roll i vardagen

Varje dag bläddrar miljontals människor i sociala medier och ser inlägg om hälsa, politik, ekonomi med mera. Inbäddat i hjälpsam information finns rykten och falska nyheter som kan väcka rädsla, förvirring eller till och med orsaka verklig skada. Denna studie presenterar ett kraftfullt sätt att göra två saker samtidigt: för det första automatiskt upptäcka falska eller vilseledande inlägg, och för det andra kartlägga vilka som är mest ansvariga för att sprida dem i ett online‑samhälle. Arbetet fokuserar på Twitter‑meddelanden om Covid‑19, men idéerna kan hjälpa plattformar, journalister och allmänheten att reagera snabbare och mer precist på skadlig desinformation inom många områden i livet.

Hur rykten sprider sig i online‑massan

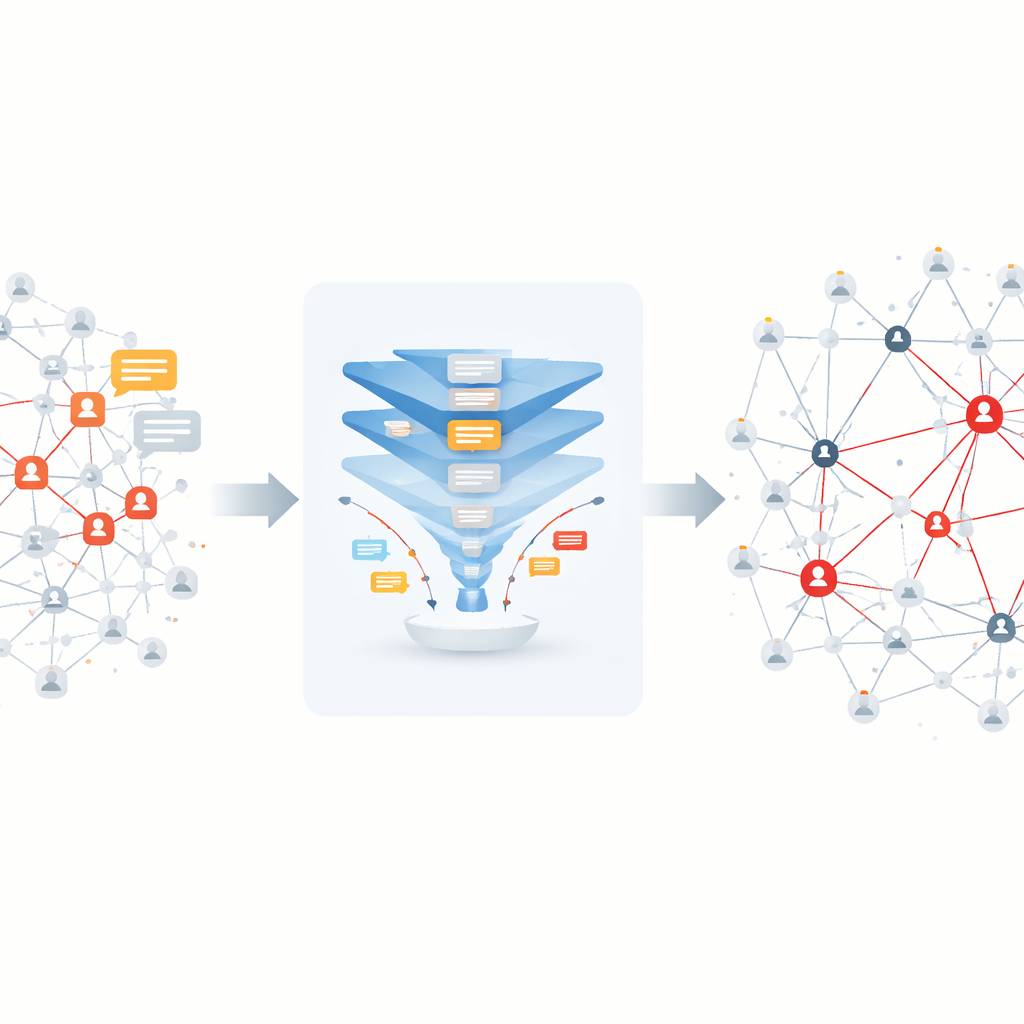

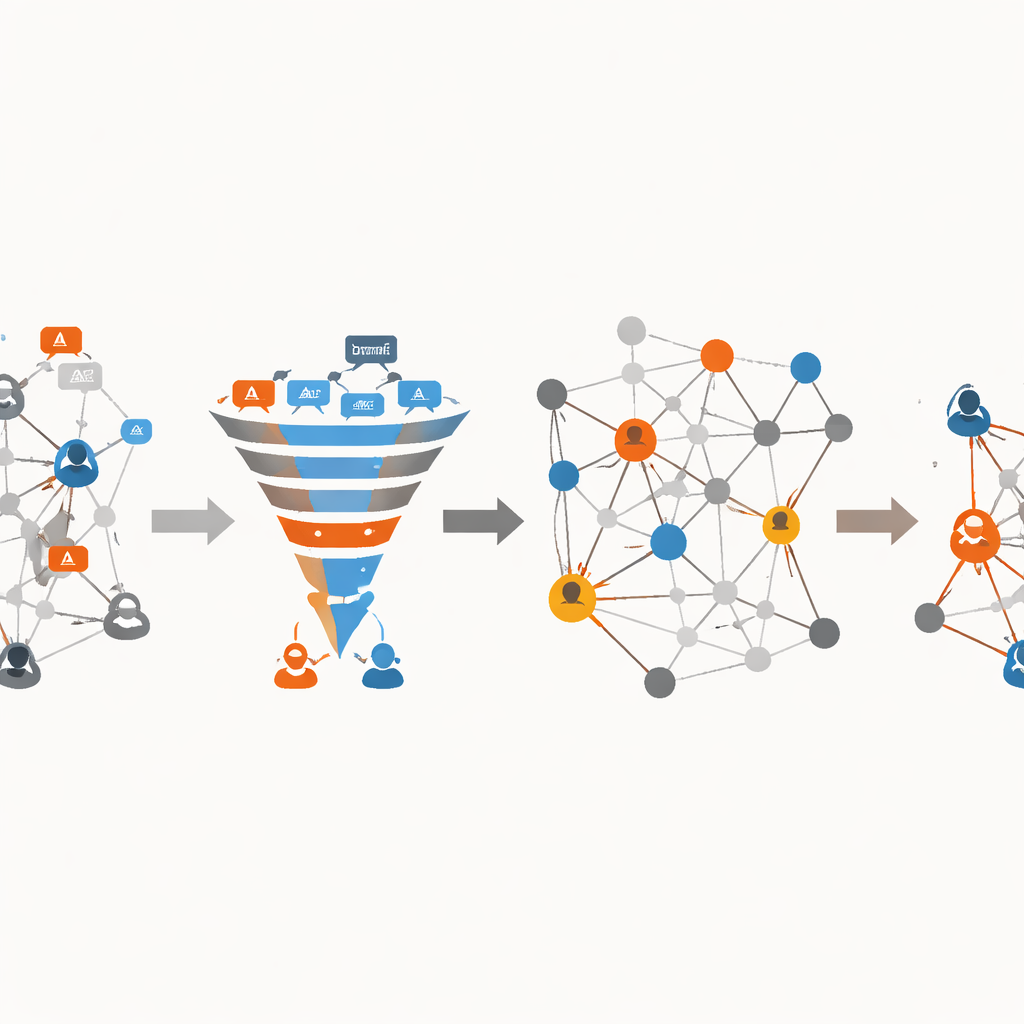

Sociala nätverk som Twitter, Facebook eller meddelandeappar kan ses som stora nät av människor (noder) förbundna av deras interaktioner (länkar). När en användare postar ett meddelande och andra svarar eller delar det kan informationen snabbt sprida sig över nätet. Rykten—obekräftade eller falska påståenden—beter sig mycket som smittsamma sjukdomar: de kan hoppa från person till person, växa snabbt och vara svåra att stoppa. Tidigare forskning har ofta behandlat två frågor separat: hur man avgör om ett visst inlägg är ett rykte, och hur man hittar nyckel"spridare" som hjälper ryktet att nå många andra. Författarna menar att det ger en mycket tydligare bild av hur falska berättelser rör sig att ta itu med båda frågorna samtidigt, samtidigt som man uppmärksammar hur nätverket är kopplat och hur aktiviteten förändras över tid.

Lära en dator att läsa och flagga tvivelaktiga inlägg

Den första delen av metoden fokuserar på innehållet i varje tweet. Forskarna behandlar varje tweet som ett kort dokument och rensar bort störande element som extra symboler, ersätter webblänkar och e‑postadresser med enkla taggar och tar bort vanliga utfyllnadsord som tillför lite mening. De översätter sedan varje ord till en numerisk vektor med en välanvänd teknik kallad GloVe, som fångar hur ord tenderar att förekomma tillsammans i stora textmängder. Genom att genomsnittligt kombinera dessa ordvektorer blir varje tweet en kompakt numerisk sammanfattning av dess innebörd. Dessa sammanfattningar matas därefter in i ett endimensionellt konvolutionsneuronät—en typ av djupinlärningsmodell som kan upptäcka subtila mönster—för att avgöra om en tweet är ett äkta meddelande eller ett rykte.

Hitta de viktigaste spridarna i nätverket

När systemet har separerat rykten från verkliga tweets vänder sig den andra delen av tillvägagångssättet till strukturen i det sociala nätverket självt. Varje användare är en punkt i en riktad, viktad graf, och varje svar eller retweet blir en länk vars styrka speglar hur ofta en användare reagerar på en annan användares meddelanden. Med denna information klustrar författarna först användare i gemenskaper—grupper som interagerar mer med varandra än med utomstående—genom att bygga en speciell trädrepresentation av nätverket och sedan slå ihop nära förbundna undergrupper baserat på hur väl de passar tillsammans. Inom dessa gemenskaper beräknar de hur ofta varje användare ligger på de viktigaste vägarna mellan andra, ett mått känt som betweenness. Användare som återkommer gång på gång på högt värderade vägar behandlas som inflytelserika spridare. Vikterna på kopplingarna uppdateras sedan för att återspegla både hur ofta människor interagerar och hur centrala de anslutna användarna är, vilket avslöjar de mest sannolika rutterna som rykten tar genom nätverket över tid.

Vad Covid‑19‑fallstudien visade

För att testa sitt ramverk tillämpade forskarna det på en massiv Twitter‑datamängd om Covid‑19: nästan 100 miljoner tweets med över 150 000 användare, ur vilka de extraherade fler än 14 000 unika meddelanden märkta som antingen autentisk information eller rykten. På dessa data klassificerade deras djupinlärningsmodell korrekt omkring 99 procent av tweetsen, och överträffade flera befintliga metoder, inklusive andra avancerade detektorer för falska nyheter. I andra steget jämförde de sin lista över inflytelserika användare med en välkänd matematisk modell för hur information sprids och fann högst överensstämmelse bland de testade metoderna. De visade också att när de analyserade längre tidsperioder—120, 240 och sedan 360 dagar—förbättrades modellens förmåga att peka ut nyckelspridare och huvudrutt för rykten, och det gjorde den med kortare beräkningstid än konkurrerande nätverksbaserade tekniker.

Vad detta betyder för kampen mot desinformation

Enkelt uttryckt visar studien att det är möjligt att bygga ett system som inte bara upptäcker sannolika falska nyheter med mycket hög noggrannhet, utan också spårar hur de färdas och vem som är mest ansvarig för deras spridning. Istället för att behandla alla användare och alla kopplingar som lika lyfter metoden fram en mindre uppsättning gemenskaper och individer vars beteende har störst betydelse för att kontrollera skadliga berättelser. Även om arbetet gjordes på anonymiserade Twitter‑data om Covid‑19 och kanske inte direkt generaliserar till varje plattform eller ämne, pekar det på en väg mot mer riktade, databaserade insatser mot online‑rykten—såsom att rikta faktakoll, varningar eller plattformsåtgärder dit de kan ha störst effekt, samtidigt som individuell integritet och etisk användning beaktas.

Citering: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Nyckelord: falska nyheter, sociala nätverk, ryktesspridning, djupinlärning, inflytelserika användare