Clear Sky Science · sv

Förbättrad YOLOv11n för detektion av små objekt i UAV-bilder: högre noggrannhet med färre parametrar

Varför det är viktigt att upptäcka mycket små objekt från luften

Små flygande robotar blir snabbt en del av vardagen, från trafikövervakning och katastrofinsatser till paketleveranser. Men ett ihärdigt problem kvarstår: när en drönare tittar ner från hundratals meters höjd krymper människor, bilar och båtar till bara några pixlar. Standard system för datorseende missar ofta dessa prickar eller förväxlar dem med bakgrundsstörningar. Denna artikel presenterar en smartare, mer strömlinjeformad version av en populär detektionsmodell, YOLOv11n, som är speciellt finjusterad för att hitta dessa små objekt i drönarbilder samtidigt som den fortfarande körs effektivt på lättviktiga omborddatorer.

Se mer i små, suddiga detaljer

Drönarbilder är en tuff miljö för algoritmer. De flesta mål är mindre än 32×32 pixlar, och många är under 16 pixlar i bredd. Rörelse, vibrationer, skiftande ljus, dis och komplexa stadsbakgrunder gör dessa små mål ännu svårare att urskilja. Samtidigt förlitar sig drönare ofta på modest processorkraft och begränsad energi, så tunga modeller är opraktiska. Författarna utgår från YOLOv11n, en kompakt detektor för realtid, och omformar dess interna komponenter för att pressa ut mer användbar information ur små, lågkontrastregioner utan att göra modellen större. Målet är enkelt men krävande: betydligt högre noggrannhet på små objekt, med lika många eller färre inlärningsbara parametrar och acceptabel hastighet på edge-hårdvara.

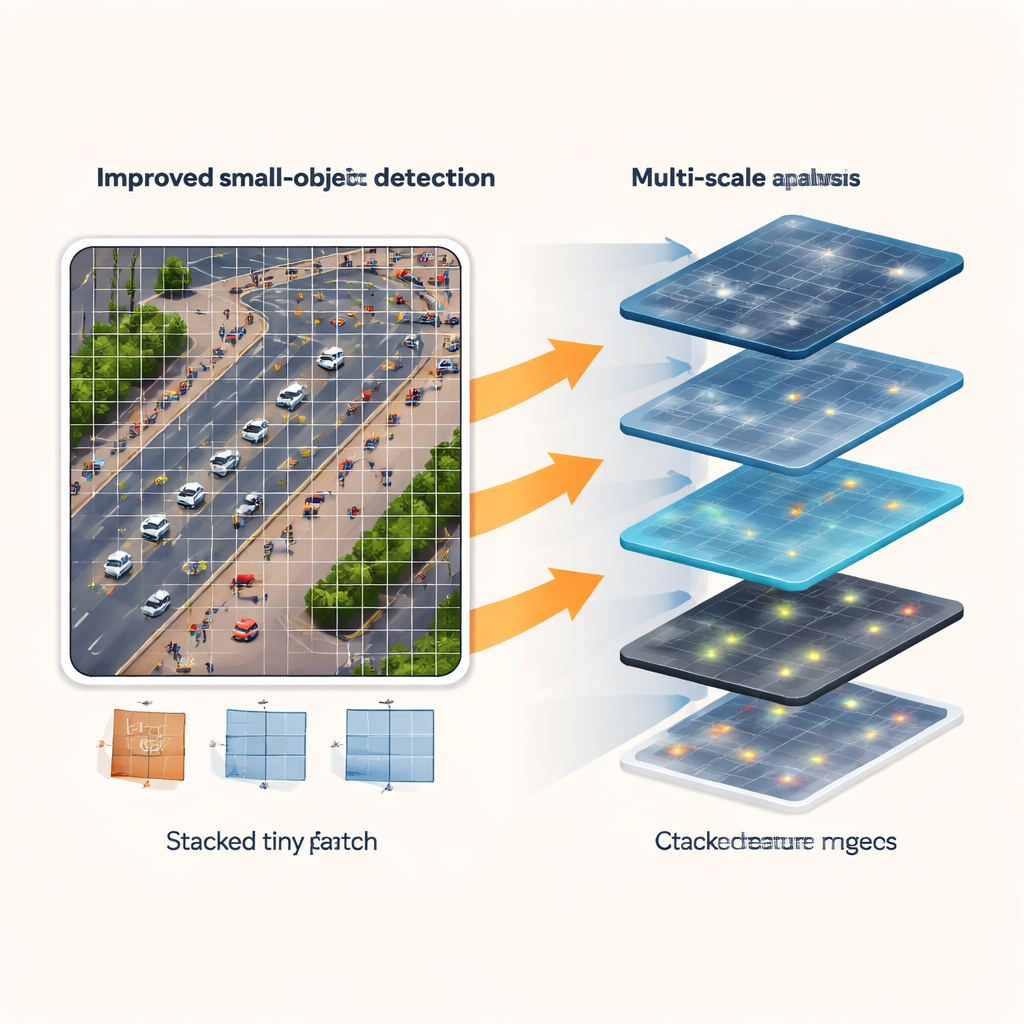

Lära från scenen i flera skalor

Den första förbättringen fokuserar på hur nätverket ”ser” scenen. Istället för att titta genom ett enda fönster i fast storlek observerar den nya Multiscale Edge-Feature Adaptive Selection (MSEAF)-modulen bilden i flera skalor samtidigt. Grova vyer fångar den bredare layouten av vägar, byggnader och folksamlingar, medan finare vyer håller koll på enskilda bilar eller personer. Ett steg för kantförstärkning betonar gränser och former som är lätta för människor att se men som ofta försvinner i mycket små bildutdrag. En smart fusionsmekanism förstärker sedan de mest informativa regionerna medan bakgrundsbrus dämpas. Denna multiskaliga, kantmedvetna representation ger resten av nätverket en rikare utgångspunkt för att hitta svårupptäckta objekt.

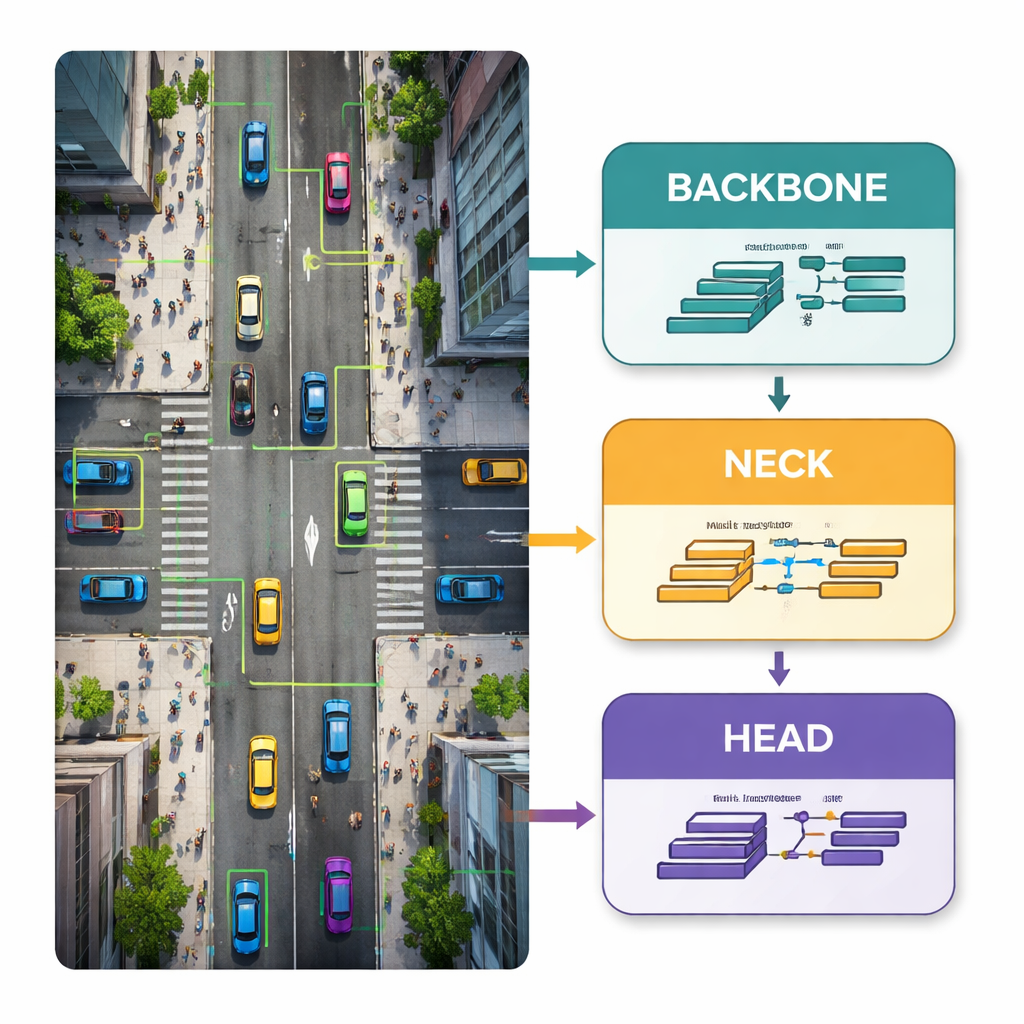

Hålla små objekt vid liv genom hela kedjan

Traditionella YOLO-nätverk krymper ofta funktionskartor upprepade gånger när information flödar från indata till utdata. För stora objekt är detta okej, men för mycket små kan det vara förödande: efter flera nedprovningar kan en fotgängare upptas av bara en eller två pixlar i en intern karta, eller försvinna helt. För att förhindra detta omstrukturerar författarna mittendelen, ”neck”, i nätverket och lägger till ett nytt P2-detekteringshuvud som arbetar på högupplösta funktioner. Anpassade moduler kallade ScalCat och Scal3DC kombinerar försiktigt information från olika lager så att fina detaljer från grundläggande lager och rikare kontext från djupare lager förstärker varandra. Resultatet är en detektor som håller koll på små bilar och människor över flera skalor, istället för att offra dem för hastighet.

Skarpare beslut med färre reglage

Den sista delen är att strömlinjeforma prediktionssteget, känt som detektionshuvudet. I den ursprungliga designen ägnades djupare lager med många kanaler mest åt stora objekt, vilka är relativt sällsynta i drönarscener. Det nya Shared Re-parameterized Detection (SRepD)-huvudet jämnar ut kanalantalet över skalor och använder ett smart träningstrick: under inlärning utforskar flera specialiserade konvolutionsgrenar olika sätt att framhäva funktioner; vid inferens slås dessa grenar matematiskt ihop till en enda, enkel konvolution. Denna delade, re-parametriserade design förbättrar hur väl funktioner smälts samman samtidigt som antalet parametrar faktiskt minskas och beräkningarna förblir hanterbara för edge-enheter.

Vad siffrorna säger i tester i verkliga miljöer

Den förbättrade modellen testas på tre utmanande publika dataset: VisDrone2019 (blandade urbana scener), TinyPerson (extremt små människor över land och hav) och HazyDet (fordon i kraftig dimma ur en drönarperspektiv). På VisDrone2019 förbättrar den nya designen ett nyckelmått för noggrannhet (mAP50) och precision med 4,6 procentenheter jämfört med ursprungliga YOLOv11n, samtidigt som parametrarna minskas med cirka 8,5 procent. På TinyPerson är förbättringarna ännu större—ungefär 5,9 procentenheter i mAP50 och 5,6 i precision—med liknande parameterreduktion, och den kompakta modellen överträffar till och med en betydligt större YOLOv11s som använder fyra gånger fler parametrar. I dimmiga förhållanden överträffar den uppgraderade detektorn också baslinjen i både noggrannhet och robusthet, allt medan den bibehåller realtidsprestanda på ett lågkonsumerande Huawei Atlas 200 DK edge-kort.

Varför detta betyder något för vardaglig drönaranvändning

För icke-specialister är huvudbudskapet att denna forskning visar att drönare kan bli både skarpare i blicken och mer resurseffektiva samtidigt. Genom att ompröva var och hur nätverket letar efter detaljer, bevara högupplöst information för mycket små mål och förenkla prediktionsmekanismen bryter författarna den vanliga kompromissen mellan noggrannhet och modellstorlek. Det resulterande systemet är bättre på att upptäcka små, avlägsna människor och fordon i trånga, dimmiga eller komplexa scener utan att kräva klumpig hårdvara. Denna typ av framsteg förflyttar tillförlitlig, realtidsbaserad luftburen övervakning för trafiksäkerhet, sök- och räddningsinsatser och miljöövervakning närmare vardaglig användning.

Citering: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Nyckelord: drone object detection, small object recognition, YOLO neural network, aerial imagery analysis, edge AI for UAVs