Clear Sky Science · sv

Attention-förstärkta MobileNetV2-modeller för robust upptäckt och klassificering av skogsbränder

Varför snabbare brandlarm spelar roll

Runt om i världen blir skogsbränder hetare, större och dyrare att bekämpa. Minuter kan skilja en liten, kontrollerbar låga från en regional katastrof som skadar ekosystem, fyller städer med rök och kostar miljarder dollar. Denna studie undersöker hur kompakta artificiella intelligens (AI)-modeller kan upptäcka de allra första tecknen på skogsbränder i vanliga bilder och videoströmmar, tillräckligt snabbt för att köras på drönare, säkerhetskameror och lågeffektsensorer utspridda i utsatta landskap.

Övervakning av skogen med smarta kameror

Traditionella brandvakttorn och mänskliga operatörer som granskar livevideoströmmar har svårt att täcka vidsträckta skogsområden, särskilt nattetid eller i rökiga, disiga förhållanden. Författarna angriper problemet genom att göra skogsbrandsdetektion till en enkel ja-eller-nej-fråga: innehåller den här bilden eld eller inte? De sätter ihop en balanserad samling om 5 121 bilder som visar både brand- och icke-brand-scener, hämtade från skogar, städer och industriområden, tagna i dagsljus, på natten och genom rök eller dimma. Genom att noggrant balansera datasetet och kontrollera etiketter för hand strävar de efter att lära AI-system vad verkliga lågor ser ut som i fält, inte bara i idealiska labbexempel.

Slank AI byggd för fältet

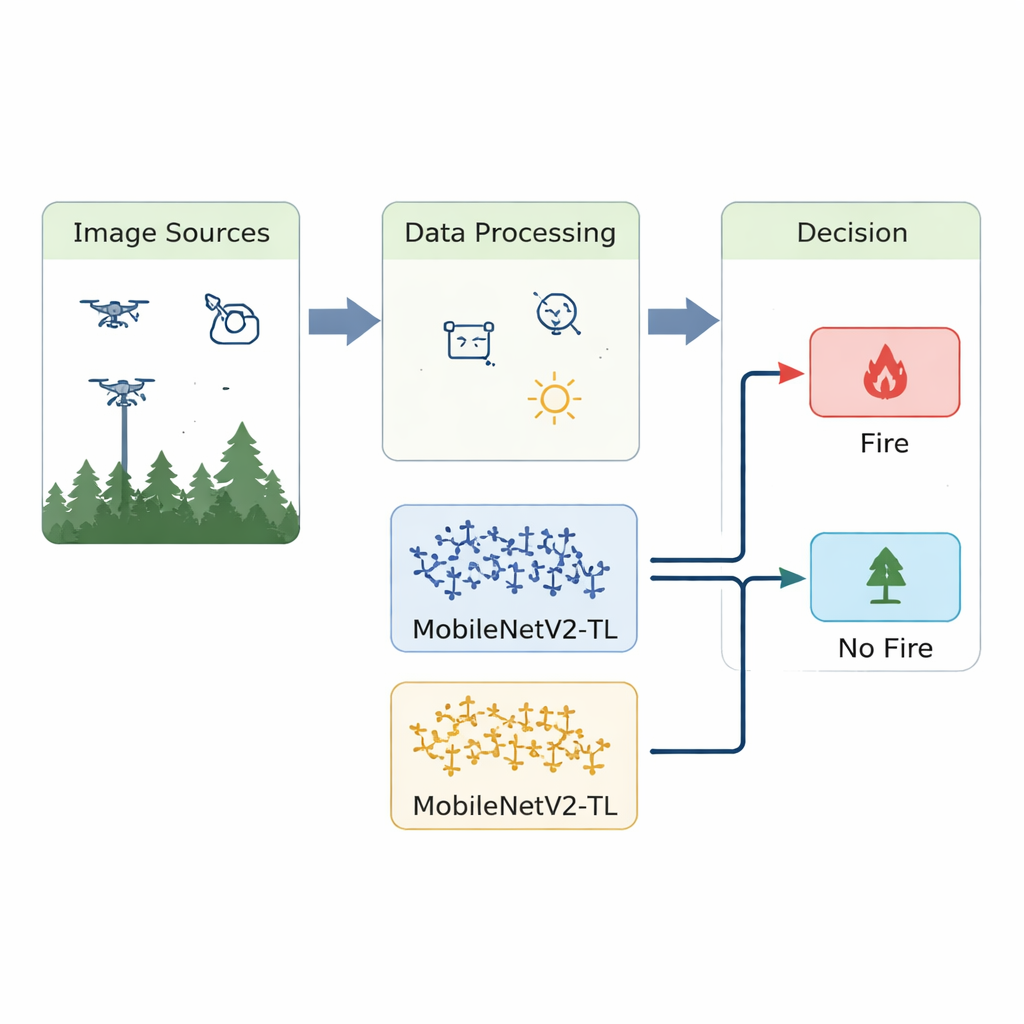

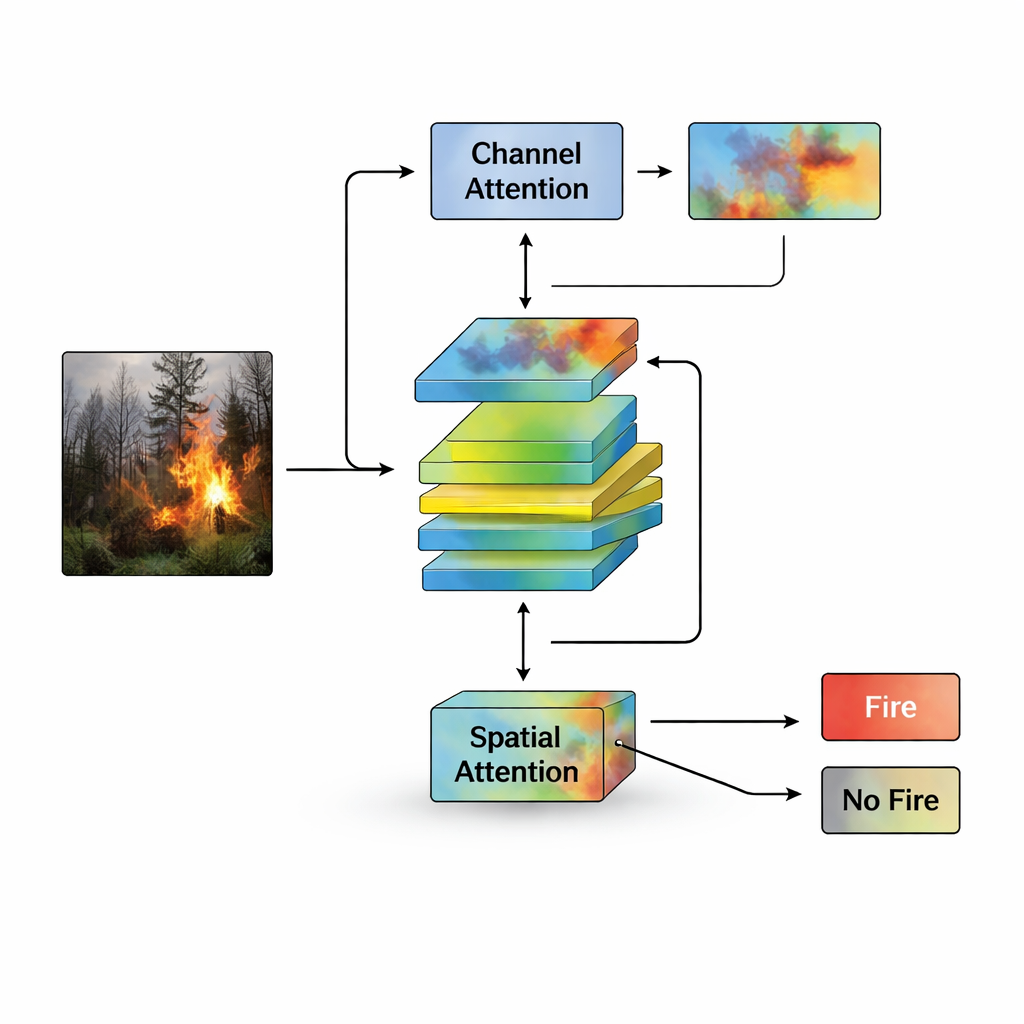

Många kraftfulla bildupplösningssystem är för tunga för att köras på de små datorer som sitter i drönare eller lågkostnadsövervakningskameror. För att undvika det problemet bygger studien vidare på MobileNetV2, en familj av neurala nätverk designade för att vara snabba och sparsamma med minne. Den första modellen, kallad Att-MobileNetV2, lägger till en "attention"-mekanism som hjälper nätverket att koncentrera sig på avslöjande flamfärger, texturer och kanter samtidigt som störande element som solbelysta moln eller starka byggnadsbelysningar ignoreras. Den andra modellen, MobileNetV2-TL, förlitar sig på transfer learning: den återanvänder visuella färdigheter inlärda från miljoner allmänna foton och tränar endast ett litet, uppgiftsspecifikt huvud för brand kontra icke-brand, vilket håller både behandlingstid och energiförbrukning låg.

Träning för tuffa verkliga förhållanden

För att efterlikna de röriga förhållandena vid verklig brandövervakning gör forskarna mer än att bara samla varierade bilder. De applicerar också kontrollerade justeringar på varje träningsbild — såsom små rotationer, speglingar och förändringar i ljusstyrka eller kontrast — för att simulera olika kameravinklar och belysning. Båda modellerna tränas och utvärderas sedan under samma regler, med standardmått som noggrannhet, precision och recall, och genom att kontrollera hur ofta de missar bränder eller ger falska larm. Att-MobileNetV2 når en noggrannhet på cirka 99,6 %, medan MobileNetV2-TL når omkring 98,4 %. Avgörande är att dessa resultat uppnås med endast några få miljoner parametrar och en bråkdel av en miljard operationer per bild, vilket möjliggör beslut på bara 10–12 millisekunder på en enda grafikprocessor.

Överträffar tyngre system med mindre

De två kompakta modellerna jämförs med både klassiska maskininlärningsmetoder och mer komplexa djupa nätverk. Under identiska tränings- och testförhållanden levererar Att-MobileNetV2 den bästa övergripande balansen mellan korrekta branddetektioner och korrekta "allt klart"-beslut, medan MobileNetV2-TL uppnår särskilt hög recall, vilket innebär att den sällan förbiser verkliga bränder — en viktig egenskap för tidiga varningssystem. Ett ensemble som kombinerar båda modellerna presterar till och med något bättre, vilket tyder på att deras sätt att "se" en scen är komplementära. Tester på ett oberoende offentligt dataset visar att modellerna upprätthåller stark prestanda på ny bilddata, vilket indikerar att de generaliserar bortom de specifika bilder de tränades på.

Vad detta betyder för framtidens brandsäkerhet

Enkelt uttryckt visar detta arbete att små, effektiva AI-modeller kan upptäcka skogsbränder tidigt och pålitligt, även när de körs på modest hårdvara monterad på drönare, torn eller vägkantkameror. Genom att använda attention för att fokusera på rätt delar av en bild och transfer learning för att återanvända tidigare visuell kunskap, når de föreslagna systemen en noggrannhet som matchar eller överträffar mycket tyngre modeller. Även om utmaningar kvarstår i tät dimma pekar tillvägagångssättet mot nätverk av smarta, prisvärda sensorer som kan höja larm tidigare, hjälpa brandkårer att agera snabbare och potentiellt förhindra att små gnistor blir katastrofala vildbränder.

Citering: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

Nyckelord: upptäckt av skogsbränder, övervakning av vildmarker, djupinlärning, edge-AI, datorseende