Clear Sky Science · sv

En hybrid intelligent bedömningsmodell för engelskundervisning i översättning med förbättrad BERT och SVM

Varför smartare bedömning av översättningar spelar roll

Varje år lägger språklärare otaliga timmar på att rätta elevernas översättningar. Att avgöra om en mening är ”bra nog” är långsamt, subjektivt och kan skilja sig mycket från en lärare till en annan. Denna artikel undersöker om artificiell intelligens kan avlasta detta arbete—erbjudandes snabba, konsekventa poäng och ledtrådar om vad som gått fel—utan att ersätta läraren. Den presenterar en ny datorbaserad modell, kallad BERT-SVM EduScore, särskilt utvecklad för att bedöma kvaliteten på engelska översättningar i en undervisningsmiljö.

Från grov ordmatchning till djupare förståelse

Under årtionden har datorer främst bedömt översättningar genom att räkna hur många ord eller korta fraser som matchar en referenslösning. Välkända verktyg som BLEU eller METEOR gör detta mycket snabbt, men de har svårt med naturligt språkets flexibilitet: två meningar kan uttrycka samma mening med helt olika formuleringar. I klassrummet, där eleverna experimenterar med synonymer och varierade syntaxer, kan dessa äldre mått orättvist straffa giltiga parafraser och ge liten vägledning om specifika fel. Forskare har därför vänt sig till nyare metoder som jämför betydelser snarare än ytliga ord, med hjälp av kraftfulla språkmodeller tränade på enorma textmängder.

En hybridmodell byggd för klassrummet

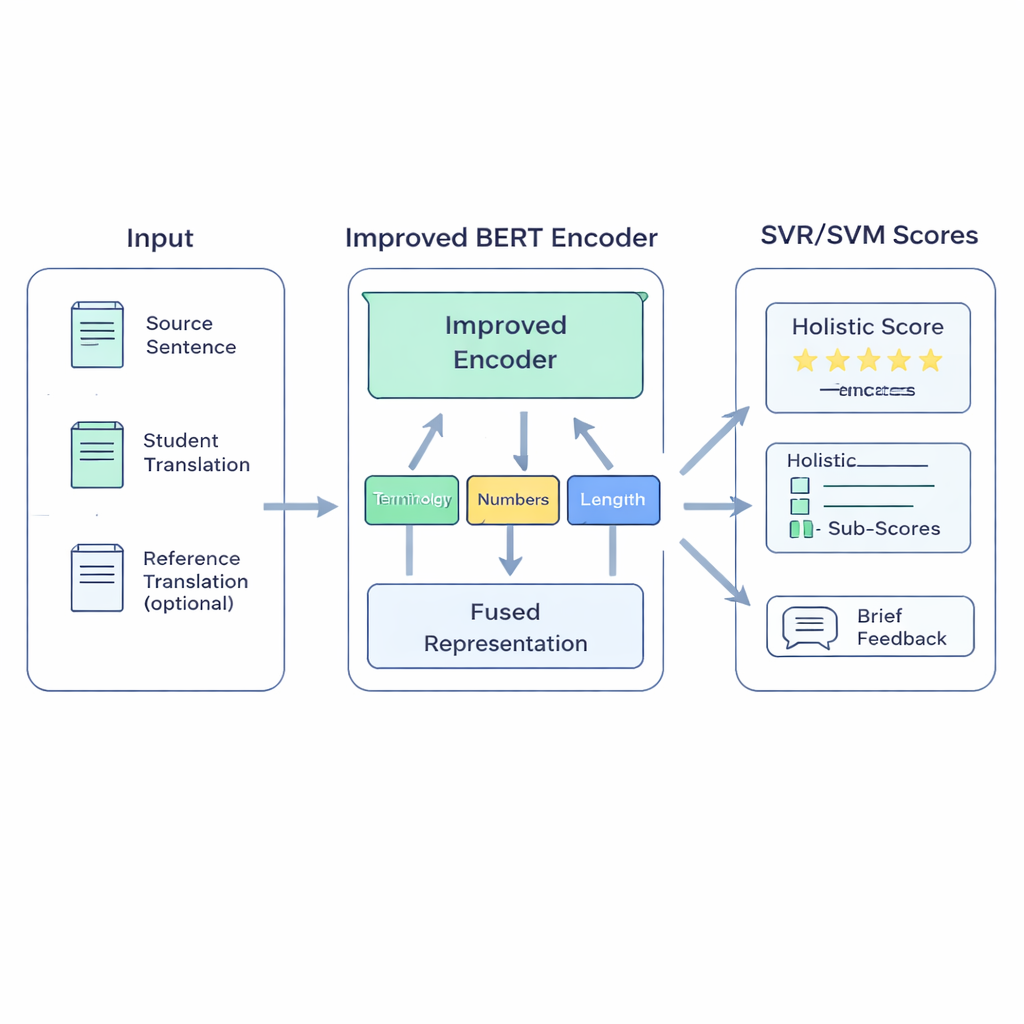

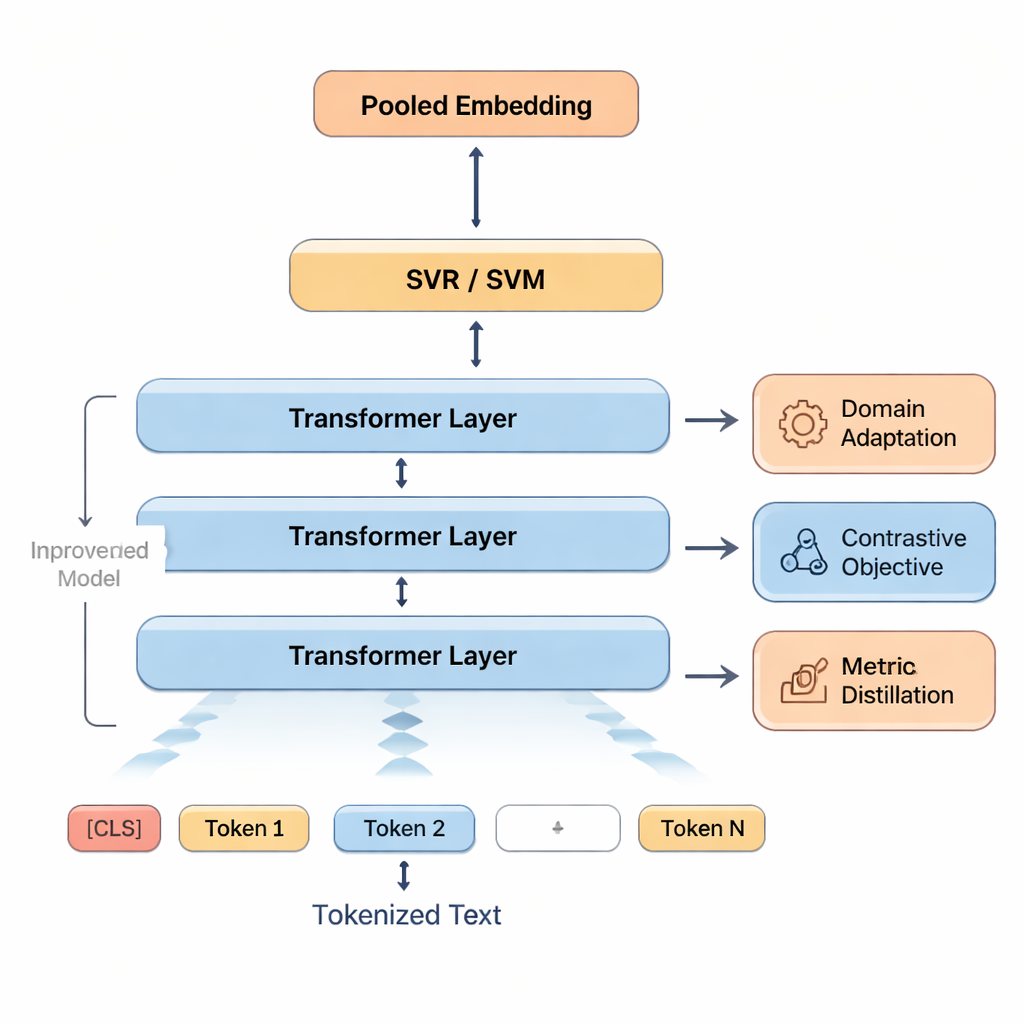

Det föreslagna BERT-SVM EduScore-systemet kombinerar två idéer: djup språklig förståelse och klassisk, robust statistik. Först använder det en förbättrad version av språkmodellen BERT för att läsa tre textstycken: originalmeningen, elevens översättning och, när en referens finns, referensöversättningen. BERT omvandlar dessa till en rik numerisk sammanfattning som speglar inte bara vilka ord som förekommer utan hur väl betydelserna överensstämmer. Ovanpå detta lägger systemet ett litet antal handgjorda kontroller som lärare värdesätter—till exempel om facktermer översätts konsekvent, att siffror och enheter bevaras, att interpunktionen är rimlig och att översättningens längd stämmer med originalet.

Hur systemet lär sig att bedöma som en lärare

Dessa signaler matas sedan in i Support Vector Machines, en familj algoritmer känd för att fungera väl med begränsade datamängder. En del förutspår ett totalt betyg; andra delar kan ge separata poäng för områden som noggrannhet eller flyt, eller sortera översättningar i kvalitetsband. För att hjälpa modellen att anpassa sig till klassrumsnära språk förträner författarna först BERT på texter liknande elevproduktion—en metod kallad domänanpassning. De förfinar vidare BERTs känsla för likhet och skillnad genom att låta den öva på att skilja bra meningar från lätt redigerade dåliga versioner. Slutligen, när högkvalitativa automatiska mått som COMET eller BLEURT finns tillgängliga, lär sig systemet att efterlikna delar av deras bedömningar, och lånar deras styrkor samtidigt som det förblir anpassat till mänskliga bedömningar.

Sätta modellen på prov

Forskarna utvärderar BERT-SVM EduScore på en stor publik datamängd som innehåller engelska–kinesiska maskinöversättningar bedömda av människor. Även om dessa inte är elevuppgifter liknar deras mening-nivåbedömningar klassrumsrättning och ger ett realistiskt stresstest. Det nya systemet jämförs med traditionella ordbaserade mått, nyare betydelsebaserade mått och flera starka neurala modeller. Det stämmer inte bara bättre överens med mänskliga bedömningar—visar högre överensstämmelse och mindre genomsnittliga fel—utan körs också tillräckligt snabbt för att bearbeta ungefär 44 meningar per sekund på standard grafikhårdvara. Noggranna experiment visar att att anpassa BERT till rätt typ av text ger den största förbättringen, medan de extra inlärningsteknikerna ger stadiga, mindre vinster utan att märkbar sakta ner systemet.

Vad detta kan betyda för lärare och elever

Kort sagt visar studien att en omsorgsfullt utformad hybrid mellan djupinlärning och klassiska metoder kan betygsätta översättningar mer tillförlitligt än befintliga automatiska verktyg, samtidigt som den förblir tillräckligt snabb för realtidsanvändning i klassrummet. BERT-SVM EduScore är ännu inte en plug-in-ersättning för mänskliga lärare: den har bara testats på maskinöversättningar, inte verkligt elevmaterial, och har inte genomgått klassrumsstudier eller rättvisegranskningar. Men resultaten tyder på att ett sådant system snart skulle kunna hjälpa lärare genom att erbjuda stabila poäng och lyfta fram sannolika problem—såsom felöversatta termer eller saknade siffror—så att mänsklig återkoppling kan fokusera på djupare, mer kreativa aspekter av översättning.

Citering: Lin, C. A hybrid intelligent assessment model for English translation education with improved BERT and SVM. Sci Rep 16, 5466 (2026). https://doi.org/10.1038/s41598-026-35042-2

Nyckelord: bedömning av översättning, språkutbildning, BERT, support vektormaskiner, kvalitetsuppskattning