Clear Sky Science · sv

Undersöka människors beroende av artificiell intelligens vid beslutsfattande

Varför vårt förtroende för smarta maskiner spelar roll

Från filmtips till kandidaturval och straffrätt hjälper artificiell intelligens (AI) i allt större utsträckning människor att fatta beslut. Många antar att datorer är mindre partiska och mer precisa än människor. Men vad händer egentligen när folk får råd från ett AI-system — använder de det klokt eller lutar de sig alltför mycket på det? Den här studien undersöker hur människor reagerar på AI-vägledning jämfört med råd från andra människor, och vad det betyder för AI:s växande roll i vardagliga beslut.

Testa verkliga människor med verkliga och falska ansikten

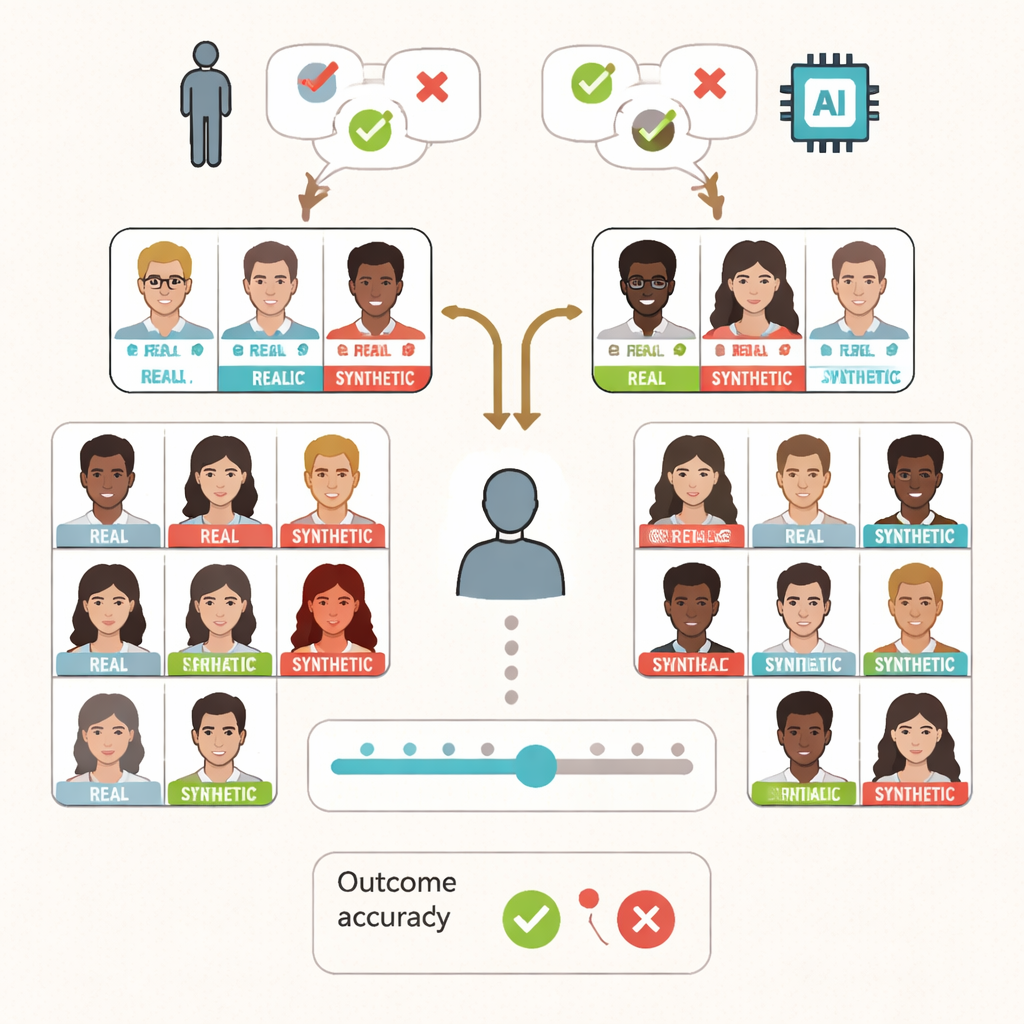

Forskarna bad 295 vuxna utföra en till synes enkel uppgift: avgöra om ett ansikte på en skärm var ett fotografi av en verklig person eller ett AI-genererat falskt ansikte. Varje deltagare såg 80 ansikten — hälften verkliga, hälften syntetiska — som noggrant valts från tidigare arbete så att de flesta kunde klara uppgiften till största delen, men inte perfekt. Intill varje ansikte såg deltagarna en kort vägledning som angav om ansiktet var "verkligt" eller "syntetiskt". De informerades om att råden kom antingen från en grupp mänskliga experter eller från ett AI-system, även om all vägledning i verkligheten var förprogrammerad och bara korrekt hälften av gångerna.

Använder råd, men inte blint

Huvudfrågan var om människor helt enkelt skulle följa råden eller tänka själva. Resultaten visar att deltagarna inte agerade som passiva knapptryckare. De följde råden i högre grad när de råkade vara korrekta och var mer benägna att ignorera dem när de var felaktiga, oavsett om råden uppgavs komma från människor eller AI. Den övergripande noggrannheten i att skilja verkliga från syntetiska ansikten låg kring två tredjedelar korrekt — mycket likt en separat grupp från tidigare forskning som utförde samma uppgift utan någon som helst vägledning. Med andra ord förbättrade eller försämrade närvaron av en AI-"hjälpare" i genomsnitt inte prestationen dramatiskt.

När positiva attityder till AI slår tillbaka

Under dessa medelvärden framträdde dock ett subtilare mönster. Deltagarna fyllde också i enkäter om hur mycket de i allmänhet litar på andra människor och hur de känner inför AI. De som hade mer positiva attityder till AI blev faktiskt sämre på att skilja äkta från falskt när de fick AI-vägledning. De var mindre kapabla att urskilja genuina från syntetiska ansikten än deltagare med mer försiktiga eller negativa uppfattningar om AI. Denna effekt syntes inte när folk trodde att råden kom från människor, vilket antyder att AI-råd på ett unikt sätt kan forma och ibland förvränga vårt beslutsfattande. Studien visade också att de som uppgav att de alltid litade på vägledningen presterade sämre än de som sade att de använde den bara ibland eller inte alls.

Människor spelar fortfarande huvudrollen i besluten

Forskarna grävde djupare i hur människor balanserade sitt eget omdöme mot vägledningen. I genomsnitt visade deltagarna en tendens att märka ansikten som verkliga, och den tendensen ökade något bland dem som rapporterade större benägenhet att lita på andra människor. Ändå såg sättet folk använde vägledningen ut att vara "strategiskt": de tycktes ta hjälp särskilt när de var mindre säkra. Konfidensbedömningar stämde ganska väl överens med prestation — när folk kände sig mer säkra var de generellt också mer korrekta — vilket tyder på att deltagarna hade en rimlig känsla för när de hade rätt eller fel, även med AI i loopen.

Vad detta betyder för vardagliga AI-verktyg

För en lekmannaläsare är huvudbudskapet att AI inte magiskt avlägsnar mänsklig partiskhet, och att det inte automatiskt överväldigar vårt omdöme. Människor behandlar ofta AI-råd på liknande sätt som mänskliga råd och kan ignorera det när det verkar oangenämt. Men när någon redan har mycket positiva uppfattningar om AI kan de vara mer benägna att förlita sig på det på sätt som minskar deras träffsäkerhet. När AI-system sprids till kritiska områden som vård, säkerhet och rättsväsen måste utformare och beslutsfattare förstå dessa mänskliga tendenser. Denna studie antyder att effektiv AI-användning inte bara beror på bättre algoritmer, utan också på informerade människor som vet när de ska lita på maskinen — och när de ska lita på sig själva.

Citering: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Nyckelord: artificiell intelligens, mänskligt beslutsfattande, förtroende för AI, automationsbias, deepfake-ansikten