Clear Sky Science · sv

Inkremetell inlärningsmetod för semantisk segmentering av histologiska hudbilder

Varför det spelar roll att lära datorer läsa hudprover

Hudcancer är en av de vanligaste cancerformerna i världen, och läkare förlitar sig ofta på tunna vävnadsskivor som betraktas i mikroskop för att avgöra hur allvarlig en tumör är och hur den bör behandlas. Att läsa dessa preparat är ett långsamt, krävande arbete som kan variera mellan experter. Denna studie undersöker hur man bygger datasystem som lär sig känna igen olika hudvävnader och cancerformer i mikroskopbilder och, viktigt, fortsätter förbättras över tid när nya typer av bilder läggs till — ungefär som en mänsklig underläkare som hela tiden utvecklas under sin karriär.

Från enkla ja–nej-svar till detaljerade vävnadskartor

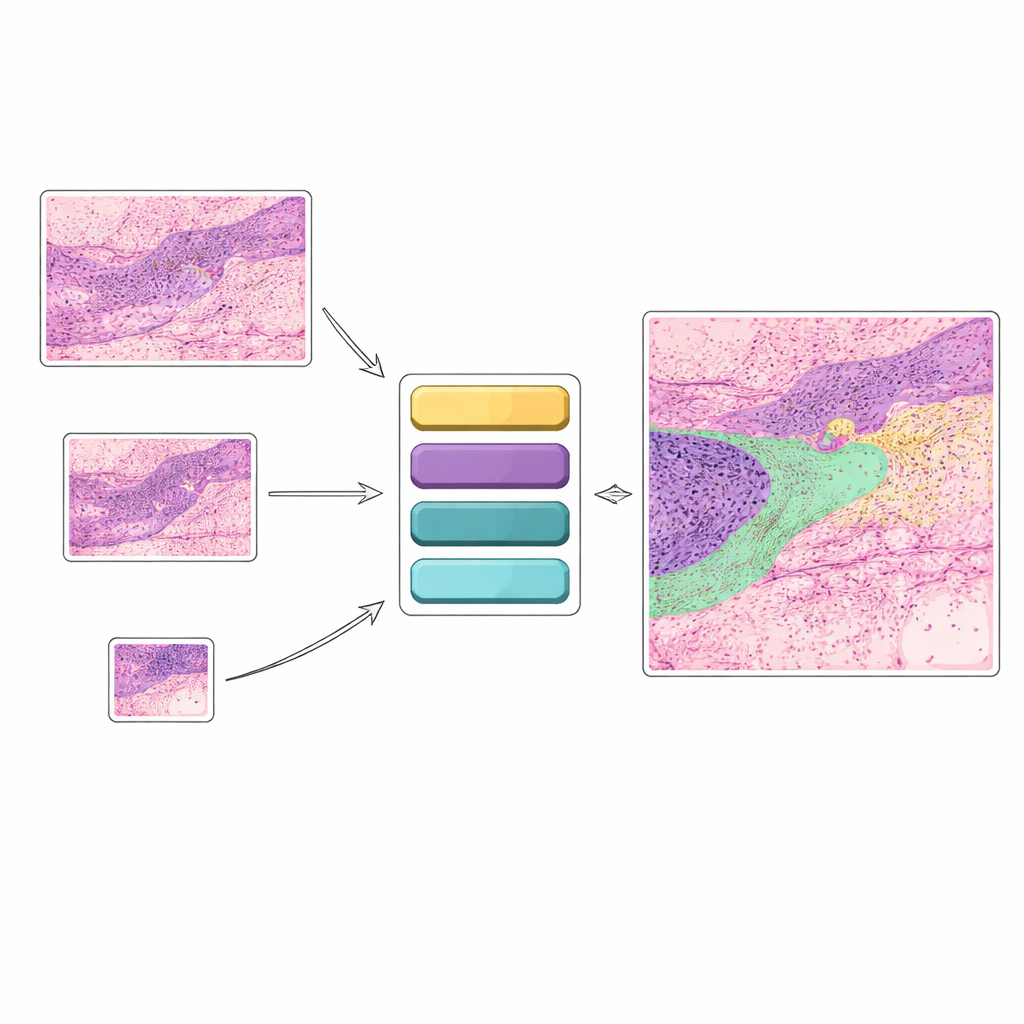

Många befintliga AI-verktyg för hudcancer tittar på en bild och svarar på en snäv fråga som ”cancer” eller ”ingen cancer”. Även om det är användbart fångar denna typ av ja–nej-beslut inte den rika detaljrikedom som patologer ser. I praktiken bryr sig läkare om många strukturer samtidigt: olika cancertyper, friska hudlager, hårsäckar, körtlar, inflammerade områden med mera. Denna studie fokuserar istället på ”semantisk segmentering”, där varje pixel i en histologibild tilldelas en av tolv vävnadskategorier. Det ger en färgkodad karta som visar exakt var olika cancerformer och normal vävnad ligger och ger tydligare vägledning för diagnostik och behandlingsplanering.

Varför nuvarande smarta system har svårt att anpassa sig

Dagens kraftfulla djupinlärningsmodeller förutsätter vanligtvis att all träningsdata finns tillgänglig samtidigt. När de väl är tränade tenderar de att ”låsa in” sin kunskap. Om nya data med andra egenskaper — till exempel bilder i en annan förstoring — introduceras senare, är det ofta säkraste alternativet att träna om hela modellen från grunden. Det är kostsamt och tidskrävande, och ännu värre, att lägga till ny information kan orsaka ”katastrofalt glömmande”, där prestationen på tidigare uppgifter tyst försämras. I kliniska miljöer förändras dock data hela tiden när skannrar uppgraderas, bildinställningar ändras och sjukhus samlar nya typer av prover. Ett AI-verktyg som inte smidigt kan absorbera sådana förändringar är svårt att lita på i vardagligt bruk.

En stegvis inlärningsstrategi inspirerad av hur människor lär sig

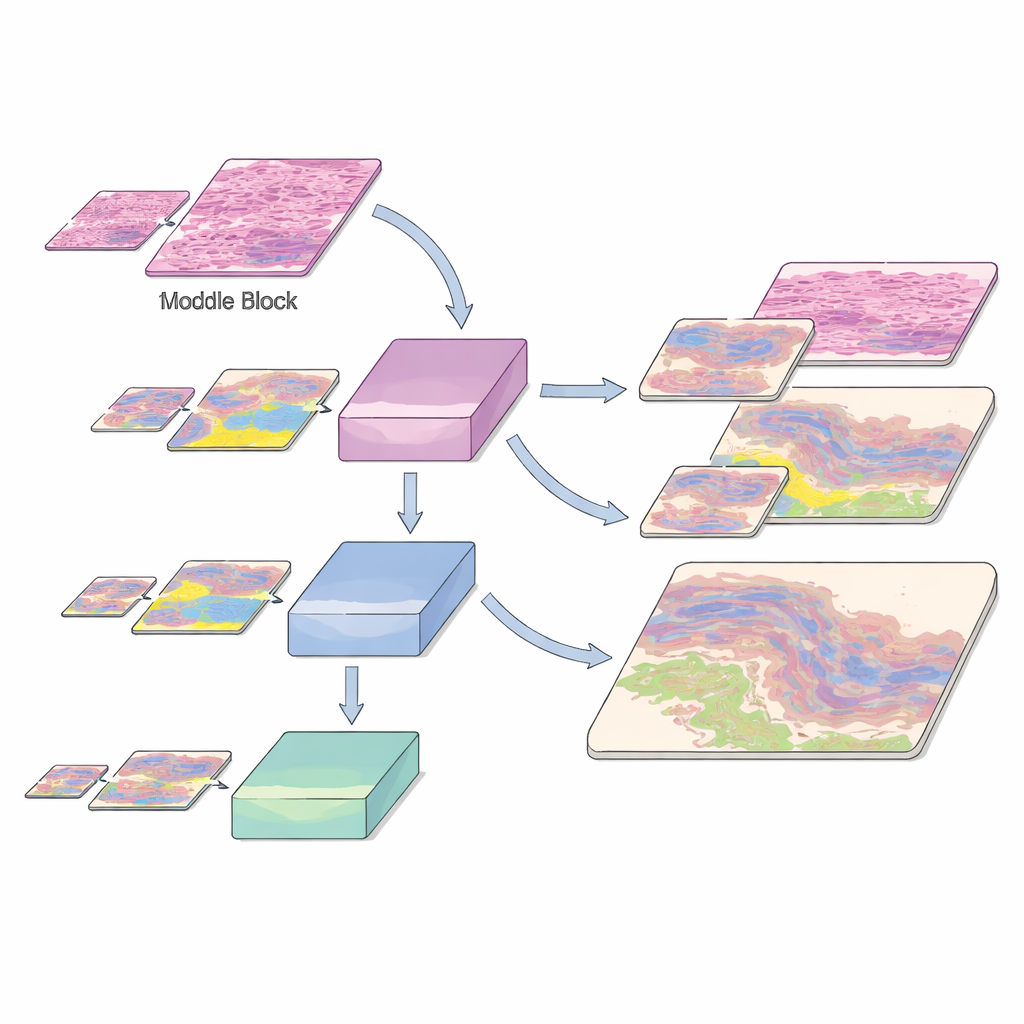

Författarna bygger vidare på en modern vision-transformer-arkitektur kallad SegFormer och förvandlar den till ett system för ”inkrementell inlärning” för icke-melanom hudcancer. Istället för att se all data samtidigt tränas modellen i etapper med histologiska preparat från en offentlig dataset från Queensland University. Först lär den sig från högförstorade (10×) bilder, där fin detalj är tydlig. Senare läggs bilder i 5× och därefter 2× förstoring till, samtidigt som en del av de tidigare högupplösta exemplen behålls i mixen. Särskilda förlustfunktioner hjälper den nya modellversionen att behålla vad den tidigare visste om vävnadsmönster, även när den anpassar sig till de grövre, mer utzoomade vyerna. Denna ”inlärning utan att glömma” styrs av en teknik som kallas knowledge distillation, där en tidigare modell fungerar som lärare åt den nya, och av ett ömsesidigt distillationsterm som får både gamla och nya representationer att hållas i harmoni.

Inlärning över zoomnivåer och sällsynta vävnadstyper

Histologiska bilder är utmanande inte bara eftersom det finns många vävnadstyper, utan också eftersom vissa viktiga strukturer är sällsynta. Datamängden inkluderar vanliga cancerformer som basalcells- och skivepitelcancer, liksom normala och inflammerade hudlager, var och en annoterad på pixelnivå av experter — en mödosam process som tar hundratals timmar. Författarna delar upp dessa enorma bildytor i små patchar och tränar sin modell med en noggrann uppdelning i tränings-, validerings- och testuppsättningar, där blandningen av vävnadsklasser bevaras vid varje förstoring. För att hjälpa systemet att känna igen knappa men kliniskt viktiga regioner förstärker de underrepresenterade klasser genom att rotera patchar och genom att exponera modellen för dessa vävnader på flera zoomnivåer. Denna multiupplösningsexponering hjälper AI att känna igen samma biologiska struktur oavsett om den framträder som en skarp närbild eller en mjukare, utzoomad form.

Vad modellen uppnår jämfört med tidigare verktyg

SegFormer-modeller som tränas separat för varje förstoring presterar redan bättre än tidigare konvolutionella designer som U-Net i många vävnadskategorier. Men när den inkrementella inlärningsschemat tillämpas — först träning på 10×, sedan på 10× plus 5× och slutligen på 10×, 5× och 2× tillsammans — blir förbättringarna påtagliga. Den totala noggrannheten stiger från cirka 89 % med endast 10×-bilder till mer än 95 % efter att alla tre förstoringarna inkluderats. Mått på överlappning mellan förutsagda och verkliga regioner förbättras också stadigt, och prestationen på cancerformer som basalcells- och skivepitelcancer samt viktiga normala lager som epidermis och papillära dermis överträffar konkurrerande metoder. Viktigt är att när varje ny zoomnivå läggs till glömmer inte modellen det den lärt sig tidigare; istället blir dess förståelse av vävnadsstruktur mer robust och generell.

Hur detta arbete för AI-stödd diagnostik närmare kliniken

För icke-specialister är huvudbudskapet att författarna har skapat en hudvävnadskartläggare som kan fortsätta studera nya bildtyper utan att förlora sina tidigare färdigheter. Genom att noga designa hur modellen lär sig i etapper och hur den återanvänder sin tidigare kunskap visar de att det är möjligt att bygga AI-verktyg som anpassar sig i takt med att medicinsk bildpraxis utvecklas. Även om mer validering behövs över olika sjukhus och sjukdomstyper pekar detta inkrementella, transformerbaserade tillvägagångssätt mot AI-system som kan hållas uppdaterade med föränderliga data, erbjuda detaljerade visuella förklaringar av var cancer ligger och i slutänden stödja patologer i att fatta mer självsäkra och konsekventa behandlingsbeslut.

Citering: Fatima, S., Salam, A.A., Akram, M.U. et al. Incremental learning approach for semantic segmentation of skin histology images. Sci Rep 16, 9593 (2026). https://doi.org/10.1038/s41598-025-31553-6

Nyckelord: hudcancer, histologiska bilder, semantisk segmentering, inkrementell inlärning, djupinlärningstransformatorer