Clear Sky Science · sv

Multi-TPC: En multimodal dataset för tredjepartssamtal med tal, rörelser och blick

Varför hur vi rör oss och ser ut när vi pratar spelar roll

När människor talar ansikte mot ansikte utbyter de mer än bara ord. Vi lutar oss fram, nickar, tittar på varandra och pausar på precis rätt ställen. Dessa subtila rörelser blir ännu viktigare när tre personer samtalar samtidigt, eftersom uppmärksamhet och talarroller ständigt skiftar. Ändå har forskare och ingenjörer hittills haft väldigt lite högkvalitativ data som visar hur tal, kroppsrörelser och ögonblick samverkar i smågruppssamtal. Denna artikel presenterar ett nytt dataset utformat för att fylla det gapet och hjälpa till att bygga mer naturliga virtuella assistenter, sociala robotar och verktyg för att studera människors vardagsinteraktioner.

En ny inblick i tresamtal

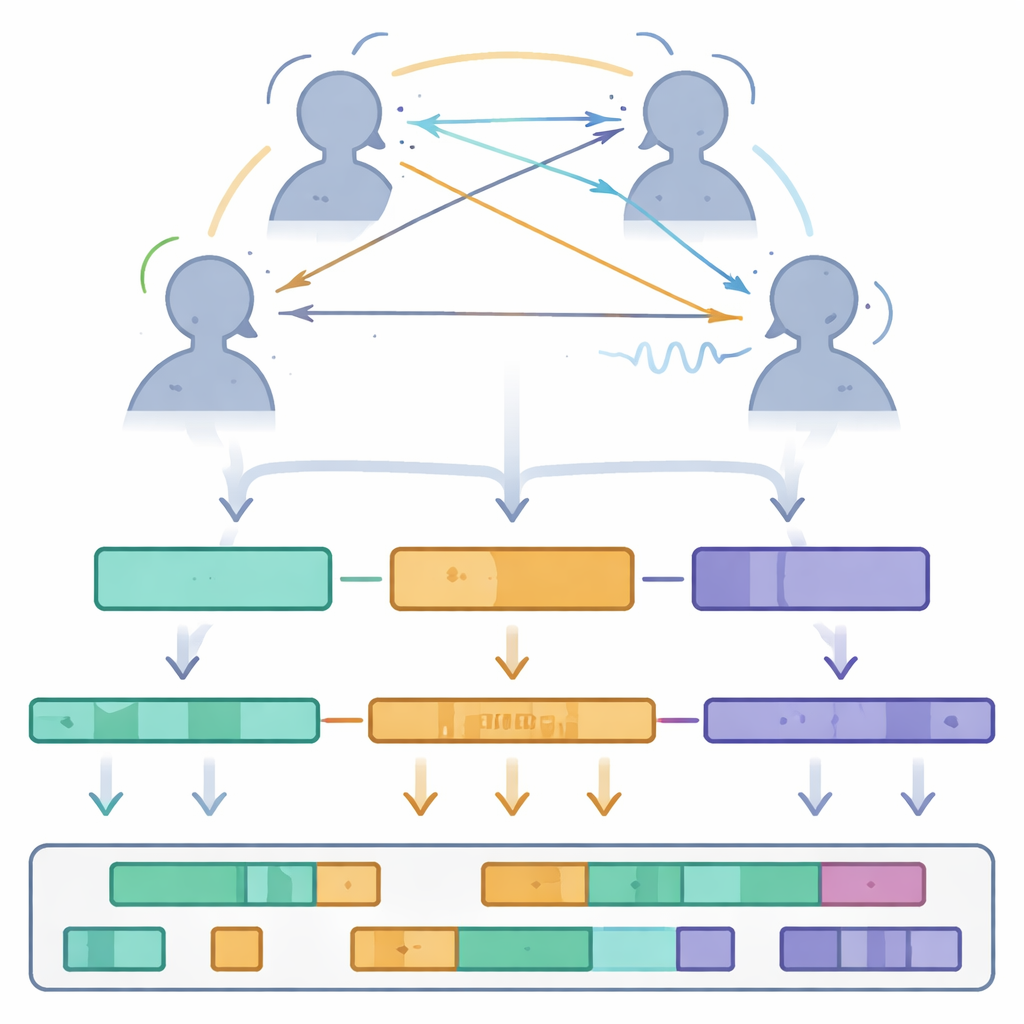

Författarna presenterar Multi-TPC, en offentligt tillgänglig samling av tresamtal inspelade i laboratorium med rörelsefångst, ögonspårare och individuella mikrofoner. Till skillnad från många tidigare resurser som fokuserar på en talare eller på samtal mellan bara två personer fångar Multi-TPC spontana diskussioner mellan tre främlingar som står i en triangel och får prata om vilka ämnen de vill. Över 5,3 timmars inspelningar från 21 unga vuxna ingår, fördelade på 24 sessioner. För varje ögonblick i dessa samtal innehåller datasetet detaljerad information om hur varje person talar, rör sin kropp och var de riktar sin blick.

Så fångades samtalen

För att bygga detta dataset skapade teamet en hybridinspelninguppsättning. Varje deltagare bar en helkroppsdräkt för rörelsefångst med reflekterande markörer så att en uppsättning av åtta kameror kunde spåra deras hållning, huvudrörelser och gester i tre dimensioner. Lätta ögonspårarglasögon, liknande vanliga glasögon i känsla, mätte var varje person tittade i sitt synfält. Trådlösa mikrofoner fästa vid halsen spelade in varje talares röst på separata ljudspår. Innan inspelning kalibrerades deltagarna i systemet och instruerades att stå på fasta punkter som bildade en liksidig triangel på ungefär en meter mellan varje person. En kläppbräda, synlig för kamerorna, ögonspårarna och mikrofonerna, gav en exakt signal för att synkronisera alla enheter i tid, vilket säkerställde att rörelse, blick och tal kunde matchas bildruta för bildruta.

Rengöring, organisering och berikning av data

Insamling av råsignaler var bara det första steget. Forskarna bearbetade noggrant rörelsedata, märkte alla markörer och fyllde små luckor med matematisk interpolation samtidigt som närliggande markörpositioner kontrollerades. Ljudinspelningarna rengjordes med brusreduceringsmetoder och matades sedan in i taligenkänningsprogramvara för att producera ord-för-ord-transkript, som senare rättades manuellt. Blickpunkter mätta i kamerapixlar konverterades till 3D-vinklar som visar var varje person tittade i rummet. Alla signaler nedprovtagna till 60 bildrutor per sekund och synkroniserades, för att sedan lagras i enkla, öppna format. Slutdatasetet är organiserat efter modalitet — rörelse, blick, ljud, ord och prosodiska funktioner som ljudstyrka och tonhöjd — med tydliga filnamnsregler så att forskare lätt kan spåra varje ögonblick över alla tre deltagare.

Vad datasetet visar om gruppsamtal

Med Multi-TPC genomförde författarna en inledande statistisk genomgång av hur tresamtal utvecklas. De mätte talarbyten och tystnader och fann att en typisk talarturn varar omkring 2,7 sekunder, separerad av pauser på strax över en sekund. De undersökte också huvudnickningar och skakningar som en form av lyssnarfeedback och upptäckte ungefär en fjärdedel nickning eller skakning per sekund i genomsnitt — ett tecken på att lyssnare ständigt signalerar uppmärksamhet och attityd utan att säga något. Blickanalysen visade att människor sällan fäster blicken direkt på någon annans ansikte under lång tid. I stället tittar de ofta något åt sidan, och deras blickmönster ändras beroende på vem som talar, om det är paus eller om mer än en person talar samtidigt. Under överlappande tal blir deltagarnas blickar mer jämnt fördelade eller drar sig bort från båda partnerna, vilket antyder osäkerhet om vem som har samtalskontrollen.

Varför denna resurs är viktig för framtida teknik

Genom att paketera alla dessa informationslager i ett väl dokumenterat, delbart dataset erbjuder Multi-TPC en ny grund för att studera hur små grupper hanterar turtagning, uppmärksamhet och feedback genom både ord och rörelser. För allmänheten är slutsatsen att samtalsdansen — vem som talar när, vem som tittar var och hur subtila nickningar formar flödet — nu fångats i fin detalj. För forskare och utvecklare öppnar detta dörren för att bygga virtuella karaktärer och sociala robotar som reagerar mer som riktiga människor i gruppsituationer, samt för fördjupade studier av hur vi samordnar oss med varandra genom röst, kropp och blick.

Citering: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

Nyckelord: multimodalt samtal, gester och blick, dataset för social interaktion, turtagning, virtuella agenter