Clear Sky Science · sv

En storskalig koherent 4D-avbildningssensor

Att se världen i fyra dimensioner

Självkörande bilar, leveransdronor och headset för förstärkt verklighet förlitar sig alla på maskiner som kan förstå den tredimensionella världen omkring dem i realtid. I dag är den typen av syn ofta skrymmande, dyr eller energikrävande. Denna artikel rapporterar ett stort steg mot en ”4D-kamera” — en chipstor sensor som inte bara kartlägger en scen i 3D utan också mäter hur saker rör sig, vilket potentiellt kan ge kompakt maskinsyn till allt från robotar till smarttelefoner.

Från platta foton till levande kartor

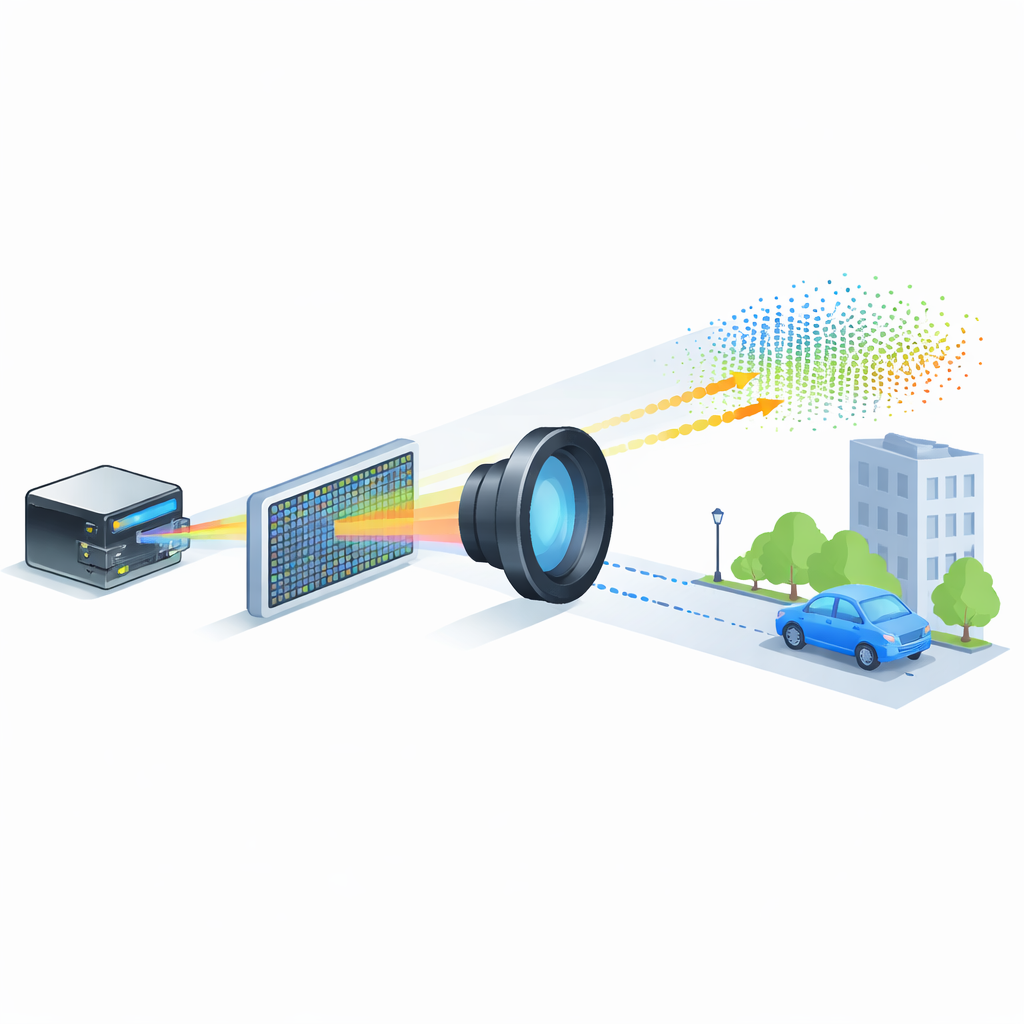

Konventionella kameror fångar ljusets intensitet på en plan yta och producerar vackra 2D-bilder men ingen direkt information om avstånd. Däremot skickar ljusdetektering och avståndsmätning (LiDAR) ut laserpulser och mäter hur lång tid de tar att återvända, vilket bygger en 3D-karta av omgivningen. Befintliga metoder kan se långt och med hög detaljrikedom, men de kräver ofta rörliga delar, stora optiska komponenter eller mycket energi per mätpunkt. Det gör det svårt att bygga något så litet, billigt och robust som en mobilkameramodul men ändå kapabel att säkert skanna gator, industrimiljöer eller trånga rum i detalj.

Ett chip som mäter avstånd och rörelse

Forskarna presenterar en ny typ av LiDAR-fokalplansarray — i praktiken en LiDAR-version av bildsensorn i en digitalkamera. Deras enhet innehåller 352 gånger 176 pixlar, totalt mer än 60 000 mätpunkter, alla byggda på ett enda kisel-fotonikchip tillsammans med dess styrelektronik. Istället för korta laserpulser använder systemet frekvensmodulerat kontinuerligt vågljus (FMCW), där laserfärgen sveps i en kontrollerad ”chirp”. När ljus reflekteras från objekt och återvänder till chippet kombineras det koherent med en referensstråle. Små frekvensskillnader avslöjar både hur långt varje punkt är och hur snabbt den rör sig mot eller från sensorn, vilket lägger till hastighet som en fjärde mätt dimension.

Hur det lilla ljusrasteret fungerar

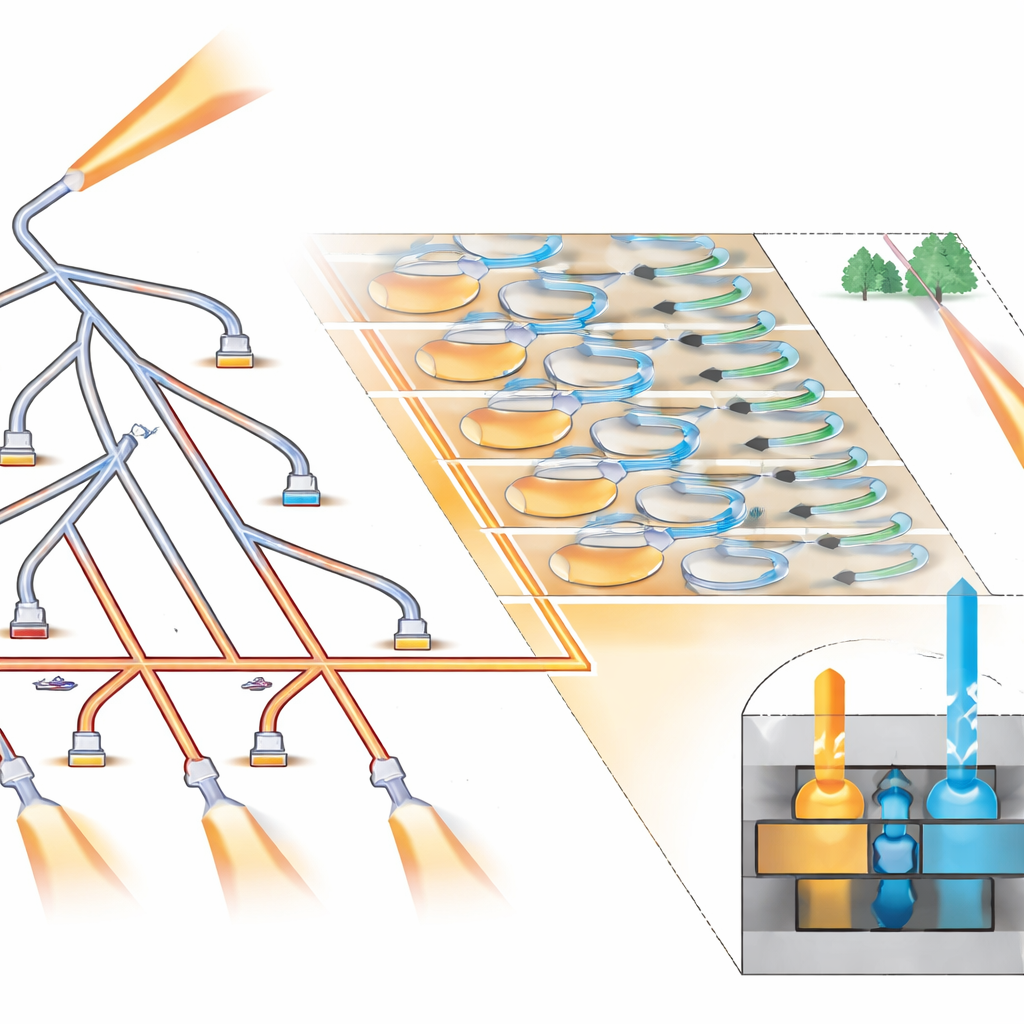

För att täcka många pixlar utan att slösa effekt styr chippet det chirpade laserljuset genom ett träd av miniatyroptiska switchar och leder det sekventiellt till grupper om åtta intilliggande pixlar. Inom varje grupp delas ljuset jämnt så att alla åtta fungerar som sändare och mottagare samtidigt. Varje pixel använder ett par gitterkopplare för att sända och samla ljus, plus ett par balanserade fotodetektorer och en förstärkare på pixeln för att extrahera beatsignalen som kodar avstånd och hastighet. Särskilt utformade mikrolinser deponerade direkt på chippet hjälper till att leda mer ljus in och ut, vilket förbättrar effektiviteten. Eftersom samma öppning sänder och tar emot ljus (en ”monostatisk” design) undviker systemet oönskad koppling mellan pixlar och behöver endast en enda extern bildlins, ungefär som en vanlig kamera.

Att testa 4D-kameran

Med kommersiella kortvågsinfraröda linser byggde teamet en kameralik modul runt chippet och fångade detaljerade 3D-punktmoln av inomhus- och utomhusscener. Med en lins uppnådde sensorn ett synfält på cirka 33 gånger 19 grader och en vinkellägesupplösning så fin som 0,06 grader — tillräckligt för att urskilja möbler i ett kontor och arkitektoniska detaljer på byggnader flera tiotals meter bort. Systemet mätte objekt från 4 till 65 meter med endast tiotals nanojoule optisk energi per punkt och en genomsnittlig målstyrka på omkring 178 microwatt per pixel, vilket hölls inom strikta ögonsäkerhetsgränser. Det spårade också rörelse: i ett experiment mätte det förändrad radiell hastighet hos en snurrande skiva med millimeter-per-sekund-precision.

Prestanda, begränsningar och framtida utveckling

Noggranna mätningar visar att sensorens prestanda ligger nära fundamentala fysiska gränser satta av ljusets kvantnatur, men ännu inte helt där. I dag är den största begränsningen elektroniskt brus från förstärkarna i varje pixel, vilket något minskar signal-till-brus-förhållandet jämfört med en ideal, rent fotonbegränsad detektor. Författarna skisserar enkla designändringar — främst att öka den interna referensljusnivån och förfina den optiska layouten, eventuellt genom att använda blandningar av kisel och kisel-nitrid — som skulle kunna föra systemet in i ett verkligt skottbrusbegränsat läge och öka användbart räckvidd bortom 200 meter. Att flytta vissa on-chip-switchar utanför pixelarrayen skulle också ta bort små luckor i fjärrfältstäckningen och ge renare punktmoln.

Mot vardaglig 4D-syn

Detta arbete demonstrerar en kompakt, fullt integrerad 4D-avbildningssensor som kan matcha de pixelantal och räckvidder som många verkliga tillämpningar kräver, samtidigt som effekt och storlek hålls i schack. Genom att samla ljuskällor, mottagare, strålstyrning och styrelektronik på ett enda kiselchip spelar enheten en liknande roll för 3D- och rörelsesensorik som CMOS-sensorn gjorde för digital fotografering. Med ytterligare förfiningar skulle sådana sensorer kunna bli tillräckligt billiga och robusta för att byggas in i bilar, robotar, telefoner och headset och ge maskiner en precis, realtidsförståelse av den tredimensionella världen och hur den förändras från ögonblick till ögonblick.

Citering: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Nyckelord: LiDAR, 4D-avbildning, kisel-fotonik, autonoma system, djupmätning