Clear Sky Science · sv

Symbolisk analys av Grover-sökningsalgoritmen genom Chain-of-Thought-resonemang och kvantinhemskt tokenisering

Att lära datorer att läsa kvantkretsar

Kvantdatorer lovar dramatiska snabbhetsvinster för vissa uppgifter, men deras program är ökända för att vara svåra för människor att förstå. Dagens verktyg kan beräkna vad en kvantkrets producerar, men de förklarar sällan varför den fungerar. Denna artikel introducerar GroverGPT+, en specialiserad AI-modell avsedd att "läsa" koden för en berömd kvantsökningsalgoritm, Grovers algoritm, och förklara dess logik i klar, steg-för-steg-form—precis som en skicklig lärare som vägleder en elev genom ett komplext pussel.

Från sifferkrossande till förståelse

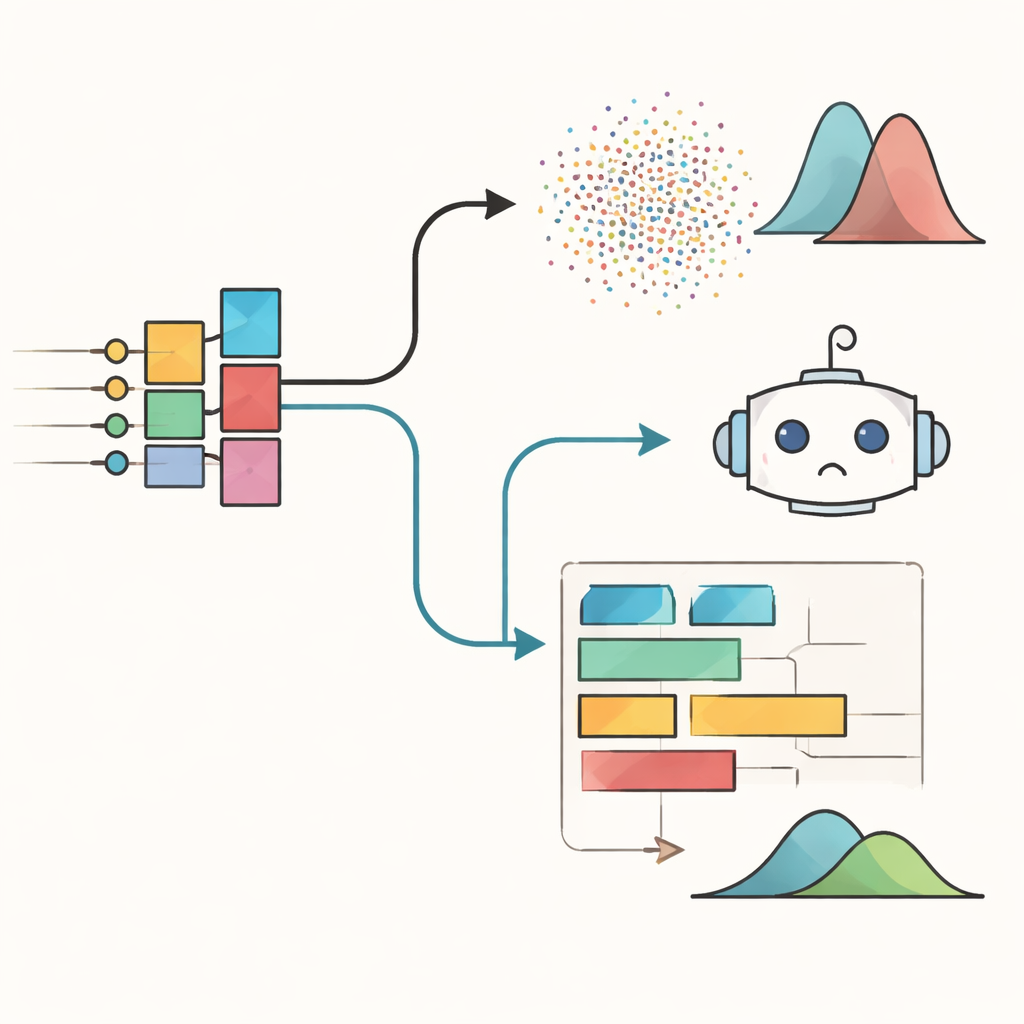

Majoriteten av befintlig programvara för kvantdatorer fokuserar på ren beräkning. Mata in en krets och dessa simulators spårar ett enormt moln av kvantprobabiliteter för att förutsäga mätresultat. Processen är kraftfull men ogenomskinlig: programvaran multiplicerar stora matriser, återger slutliga sannolikheter och lämnar det åt mänskliga experter att sluta sig till hur algoritmen är uppbyggd. I kontrast är GroverGPT+ byggd för att utföra symbolisk analys. Den tar samma lågnivåbeskrivning av en krets, skriven i ett kvantassemblyspråk kallat QASM, och strävar efter att beskriva de olika delarnas högre nivå-roller—särskilt den "orakel" som kodar vilka svar som betraktas som korrekta i Grovers sökning.

En språkmodell med kvantkoll

Under huven är GroverGPT+ en stor språkmodell—en neuralt nätverksarkitektur ursprungligen utvecklad för att förstå och generera naturligt språk. För att göra den flytande i "språket" för kvantkretsar inför författarna två viktiga anpassningar. För det första designar de en kvantinhemsk tokenizer som delar upp QASM-kod i meningsfulla bitar, såsom individuella grindar och kubitidentifierare, istället för godtyckliga textfragment. Denna kompakta, strukturmedvetna kodning hjälper modellen att uppfatta hela operationer på en gång. För det andra tränar de modellen med Chain-of-Thought-övervakning: den lärs inte bara de rätta slutliga svaren, utan också detaljerade resonemangsspår som går igenom hur man extraherar oraklet, identifierar de markerade tillstånden och förutspår sannolikheten för varje möjligt utfall.

Sätta GroverGPT+ på prov

För att noggrant utvärdera systemet använder författarna Grovers algoritm som ett kontrollerat laboratorium. Grovers sökning har rena matematiska egenskaper: för ett givet antal kubitar och markerade tillstånd kan experter exakt skriva ner vilka tillstånd som är speciella och hur sannolikt algoritmen är att hitta dem. Teamet genererar många kretsar med olika storlekar och olika antal mållösningar, och ber sedan GroverGPT+ identifiera de markerade tillstånden och återskapa utskriftssannolikheterna. De mäter framgång på två sätt: sökprecision, som kontrollerar om modellens toppförutsägelser matchar de verkliga markerade tillstånden, och klassisk trohet, som jämför hela sannolikhetsfördelningen med den från en ideal simulator.

Exakt, stabil och förvånansvärt skalbar

Över kretsar med upp till sju kubitar—det intervall den tränas på—lokaliserar GroverGPT+ konsekvent de korrekta måltillstånden och återskapar de korrekta sannolikhetsmönstren, och uppnår sökprecision och trohet nära ett med mycket liten variation. Vanliga språkmodeller, däremot, visar mycket lägre och mindre stabil prestanda. Författarna undersöker sedan hur väl GroverGPT+ generaliserar bortom sitt träningsregim. När den ges något större fullständiga kretsar med åtta eller nio kubitar förblir dess noggrannhet hög med endast en blygsam nedgång. När den ges ett mer kompakt input som endast innehåller orakeldelen av kretsen fortsätter den att prestera väl även upp till tretton kubitar. Lika anmärkningsvärt är att den tid modellen behöver för att analysera en krets endast växer försiktigt med kretsstorleken, och håller sig inom ungefär en ordning av storlek av de minsta fallen—mycket bättre än den exponentiella tillväxten hos full kvanttillståndssimulering.

En ny lins på kvantalgoritmers komplexitet

Dessa resultat antyder att AI-modeller som GroverGPT+ kan bli värdefulla följeslagare för kvantforskare, lärare och studenter. Istället för att ersätta numeriska simulatorer erbjuder de en annan funktion: att omvandla lågnivåkretskod till högre nivå-förklaringar av vad algoritmen gör och varför den fungerar. Författarna går längre och föreslår ett konceptuellt skifte. Om vissa kvantalgoritmer är lätta för en AI-resonerare att lära sig och förklara medan andra inte är det, kan den skillnaden avslöja något om deras underliggande konceptuella komplexitet, utöver traditionella resursmått som grindantal. I detta perspektiv är GroverGPT+ inte bara ett felsökningsverktyg, utan en tidig prototyp av ett AI "vetenskapligt instrument"—ett som hjälper till att utforska strukturen och begripligheten hos kvantalgoritmerna själva.

Citering: Chen, M., Cheng, J., Li, P. et al. Symbolic analysis of Grover search algorithm via Chain-of-Thought reasoning and quantum-native tokenization. npj Quantum Inf 12, 48 (2026). https://doi.org/10.1038/s41534-026-01195-1

Nyckelord: kvantalgoritmer, Grover-sökning, stora språkmodeller, symbolisk analys, verktyg för kvantdatorer