Clear Sky Science · sv

Övervinna gränserna för dimensionell faktorisering i diskreta diffusionsmodeller genom kvantinlärning av gemensamma fördelningar

Varför denna nya vinkel på AI och kvantteknik spelar roll

Moderna AI‑system är anmärkningsvärt skickliga på att generera text, bilder och annan data, men de har fortfarande svårt när många delar av datan är starkt sammankopplade. Denna artikel visar att en stor klass av generativa AI‑modeller, så kallade diskreta diffusionsmodeller, har en inbyggd begränsning: när data blir högdimensionella och mer korrelerade kan deras fel växa snabbt. Författarna föreslår en ny metod som använder kvantdatorer för att lära dessa komplexa relationer mer troget, vilket potentiellt kan ge snabbare och mer flexibla generativa modeller än dagens klassiska tekniker.

När att dela upp saker förstör det som är viktigt

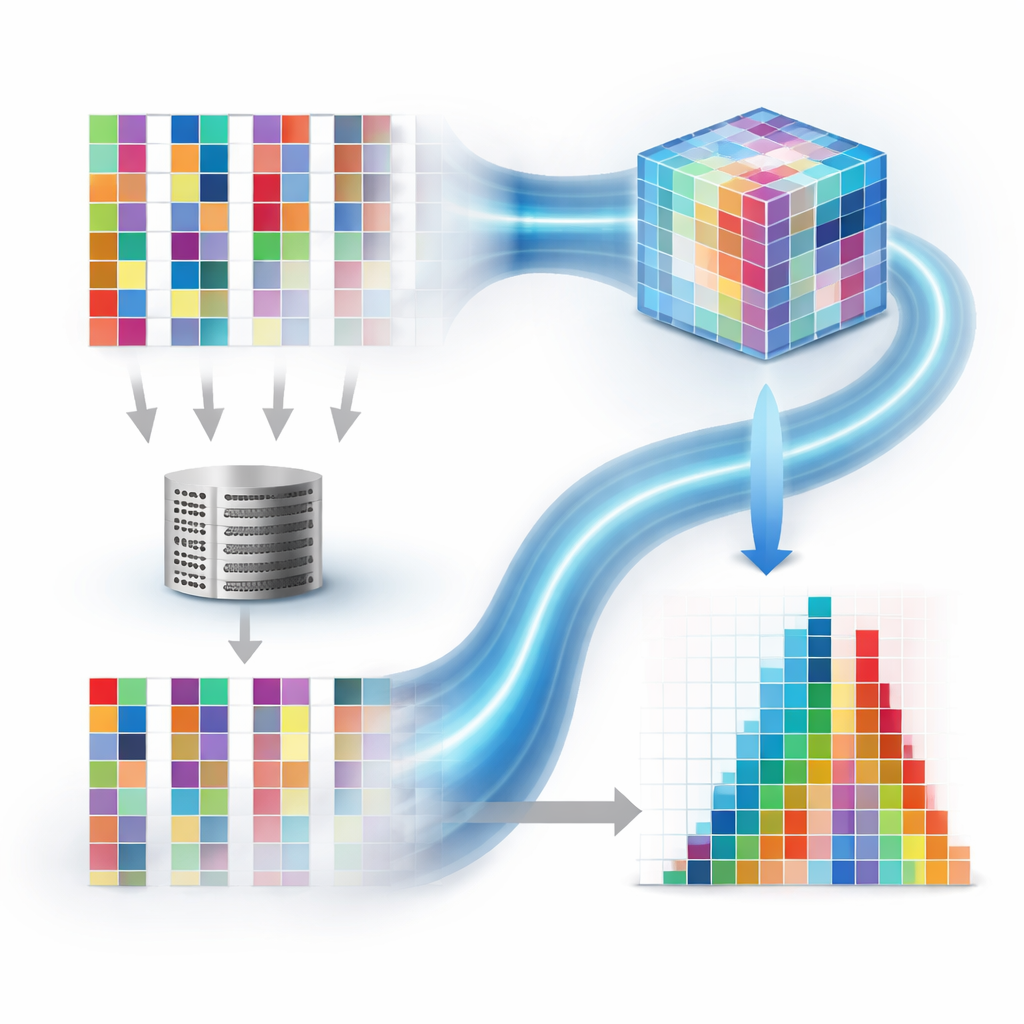

Klassiska diskreta diffusionsmodeller fungerar genom att gradvis korrupera data med brus och sedan lära sig att invertera denna process steg för steg för att generera nya prov. För att hålla beräkningarna hanterbara behandlar de varje dimension—som varje pixel i en bild eller varje symbol i en sekvens—som om den förändras oberoende. Denna "faktorisering" undviker en exponentiell exploderande komplexitet, men den bortser också från korrelationer mellan dimensioner. Författarna analyserar ett värsta‑fall där varje del av datan är starkt knuten till varje annan del. De bevisar att, för sådan data, kan avvikelsen mellan den sanna fördelningen och vad en faktoriserad modell kan lära sig växa ungefär i proportion till antalet dimensioner. Med andra ord, när data blir större och mer strukturerade kan klassiska diskreta diffusionsmodeller fundamentalt misslyckas med att fånga hur informationsbitar beror av varandra.

Använda kvanttillstånd för att bevara korrelationer

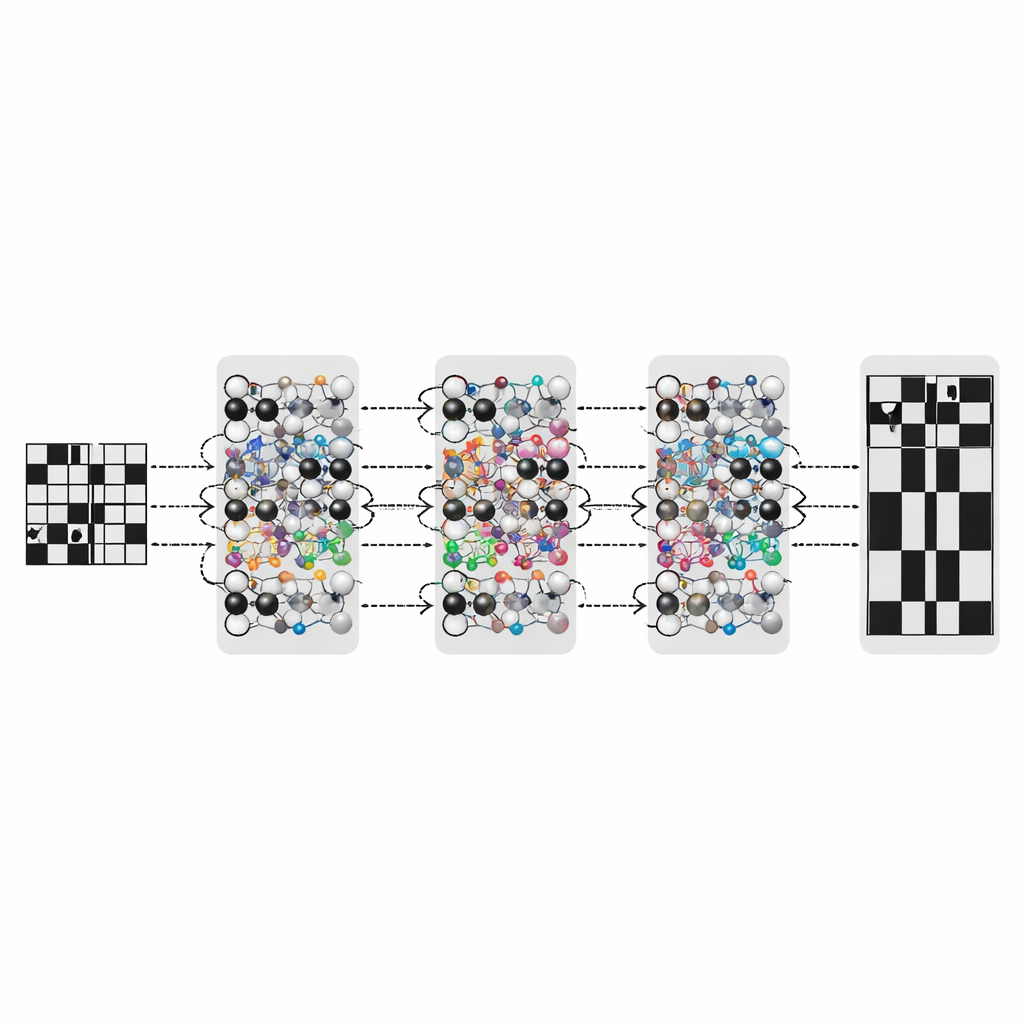

Den föreslagna kvantdiskreta denoising‑diffusion probabilistic‑modellen (QD3PM) angriper detta problem genom att representera data som kvanttillstånd snarare än som separata klassiska variabler. I ett kvantsystem lever en samling qubits naturligt i ett mycket stort kombinerat rum där gemensamma konfigurationer och korrelationer lagras tillsammans. QD3PM kodar in diskreta data i detta rum, applicerar en kontrollerad "diffusions"‑process som tillför brus via kvantkanaler, och lär sig sedan att invertera den processen med en träningsbar kvantkrets. Avgörande är att modellen arbetar på det fullständiga gemensamma tillståndet, så beroenden mellan dimensioner bevaras genom hela diffusions‑ och avbrusningsprocessen. Med en version av Bayes regel anpassad till kvantteori härleder författarna hur man beräknar det exakta "posteriora" kvanttillståndet som bör styra träningen, och de utformar kretsar som fysiskt implementerar denna uppdatering.

Från många långsamma steg till ett enda kvantsprång

Standarddiffusionsmodeller behöver vanligtvis många rundor av gradvis avbrusning för att förvandla rent brus till ett realistiskt prov, vilket gör dem beräkningsmässigt kostsamma. QD3PM beskrivs först på detta bekanta iterativa sätt, men författarna visar sedan hur samma kvantkonstruktion kan tränas för att hoppa direkt från brus till ren data i ett steg. De gör detta genom att låta kvantkretsen lära fördelningen av originaldata villkorad på en brusig indata, och sedan noggrant komponera denna inlärda avbildning med kvantdiffusionen och uppdateringsreglerna. Tack vare egenskaper hos kvantoperationer och mätningar beror det slutliga provtagandet bara på vissa diagonala element i kvanttillståndet, vilket möjliggör förenkling av proceduren utan att ändra observerbara utfall. Detta ger en enstegs‑generator som i princip kan vara mycket snabbare än klassisk flerstegsdiffusion samtidigt som den modellerar den fulla gemensamma fördelningen.

Fyll i luckorna utan att börja om

En praktisk fördel med QD3PM är hur naturligt den hanterar villkorliga uppgifter såsom inpainting—att fylla i saknade delar av en bild givet den synliga regionen. Eftersom modellen beskriver den fulla gemensamma fördelningen över alla dimensioner kan författarna villkora på kända värden helt enkelt genom att upprepade gånger återställa dessa delar av datan under avbrusningsstegen samtidigt som de okända delarna tillåts variera. Detta styr försiktigt provtagningsprocessen mot den korrekta villkorade fördelningen utan att ändra kretsen eller träna om den. I simuleringar på syntetiska dataset som inkluderar högstrukturerade "stänger och ränder"‑mönster passar QD3PM inte bara den övergripande fördelningen mer exakt än både klassiska diffusionsmodeller och kvantmodeller som förlitar sig på faktorisering, utan presterar också robust under realistiska nivåer av kvant‑hårdvarubrus och hanterar villkorlig generering väl.

Vad resultaten betyder framöver

Sammantaget visar analysen och experimenten att att behandla dimensioner oberoende är en allvarlig flaskhals för diskreta diffusionsmodeller när data är starkt korrelerade. Genom att istället använda kvanttillstånd för att direkt lära gemensamma fördelningar undviker QD3PM denna begränsning och kan i teorin matcha komplexa målfördelningar perfekt i fall där klassiska faktoriserade metoder inte kan. Arbetet visar också hur kvantgenerativa modeller kan erbjuda inte bara rå uttrycksförmåga, utan även praktiska fördelar som snabbare enstegsprovtagning och flexibel villkorlig inferens utan omskolning. Även om nuvarande demonstrationer är begränsade till relativt små system som kan simuleras på klassiska datorer ger ramverket en konkret färdplan för hur framväxande kvantmaskinvara en dag skulle kunna förbättra den grundläggande mekaniken i generativ AI.

Citering: Chen, C., Zhao, Q., Zhou, M. et al. Overcoming Dimensional Factorization Limits in Discrete Diffusion Models through Quantum Joint Distribution Learning. npj Quantum Inf 12, 49 (2026). https://doi.org/10.1038/s41534-026-01188-0

Nyckelord: kvantgenerativa modeller, diffusionsmodeller, inlärning av gemensam fördelning, högdimensionella korrelationer, villkorlig generering