Clear Sky Science · sv

Tillförlitliga osäkerhetsuppskattningar i djupinlärning med effektiva Metropolis-Hastings-algoritmer

Varför smartare osäkerhet spelar roll

Från medicinska bilder till självkörande bilar fattar modern artificiell intelligens ofta beslut där att ha fel med hög säkerhet kan vara farligt. Standardlösningar inom djupinlärning är utmärkta på att känna igen mönster, men är notoriska för att vara dåliga på att ange hur osäkra de är. Denna artikel tar sig an den luckan: den presenterar nya sätt att förse djupa neurala nätverk med tillförlitliga mått på osäkerhet, samtidigt som beräkningskostnaden för traditionella bayesianska metoder hålls under kontroll.

Från gissningar till mätt förtroende

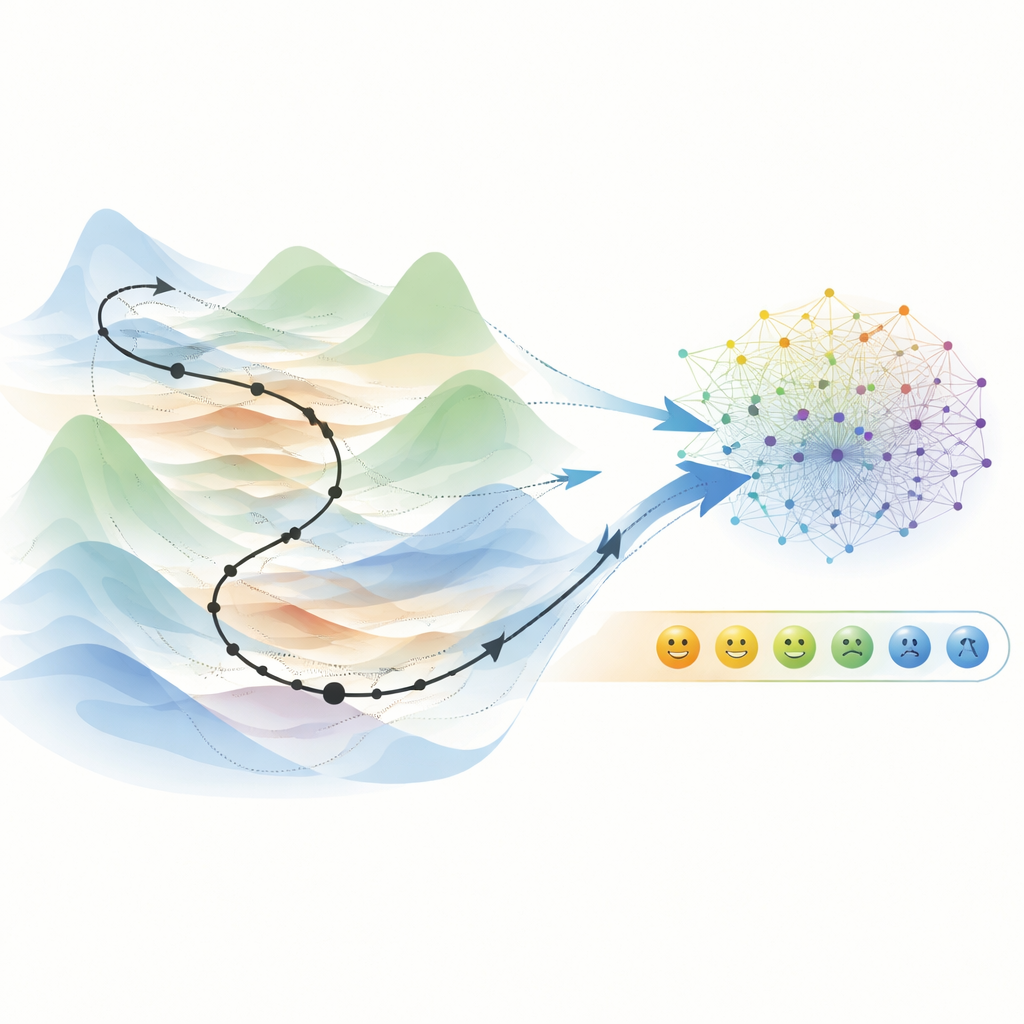

I vardaglig djupinlärning tränas en modell en gång och används sedan som den är. Den ger en enda bästa gissning men ger lite insikt i hur trovärdig den gissningen är. Bayesiska neurala nätverk går en annan väg: istället för att fixera en uppsättning modellparametrar behandlar de parametrarna som stokastiska och försöker fånga en hel fördelning av rimliga modeller. Genom att genomsnittligt väga prediktioner över denna samling kan man både identifiera det mest sannolika svaret och hur mycket modellen bör lita på sig själv. Utmaningen är att korrekt provtagning från denna fördelning med guldkornsmetoder som Hamiltonian Monte Carlo är extremt kostsamt för dagens stora nätverk och datamängder.

Snabbare provtagning utan att tappa helhetsbilden

Författarna fokuserar på en familj metoder kallade stokastisk gradient Hamiltonian Monte Carlo, som redan återanvänder idéer från vanlig träning—mini-batcher och brusiga gradienter—för att påskynda provtagningen. Den saknade ingrediensen är ett pålitligt ”filter” som avgör vilka föreslagna parameteruppdateringar som ska behållas. I klassisk Hamiltonian Monte Carlo sköts denna roll av ett Metropolis-Hastings-acceptanssteg som korrigerar numeriska fel och förhindrar att provtagaren driver iväg till felaktiga regioner. Att föra in detta acceptanssteg i det brusiga, mini-batch-baserade världen av djupinlärning är svårt, eftersom det vanligtvis kräver utvärderingar över hela datasetet och kan stanna upp framsteg om acceptansfrekvenserna blir för låga.

Två nya sätt att vandra landskapet

Artikeln introducerar två kompletterande strategier. Den första, kallad generaliserad stokastisk gradient Hamiltonian Monte Carlo (GSGHMC), utformar ett acceptanstest som körs på mini-batcher samtidigt som den bevarar den viktiga egenskapen att verkliga optima för hela problemet fortfarande känns igen korrekt. Den använder en noggrant vald numerisk integrator så att steg-för-steg-acceptans förblir stabil, även om den bara ser en delmängd av datan åt gången. Detta ger en effektiv provtagare som håller sig nära den sanna bayesianska bilden och producerar ensembler av modeller med särskilt välkalibrerade konfidenspoäng.

Rida långa banor för bättre prediktioner

Den andra metoden, Hamiltonian Trajectory Ensemble (HTE), gör en avsiktlig avvägning: istället för att insistera på exakt bayesianskt beteende favoriserar den långa, momentumburna vandringar genom parameterutrymmet som liknar aggressiva träningskörningar. I slutet av varje sådan bana avgör ett Metropolis-liknande test huruvida det resulterande modellögonblicksbilden ska behållas. Eftersom dessa banor tenderar att landa i breda, generaliserbara dalar i förlustlandskapet, bildar de insamlade modellerna ett varierat men fokuserat ensemble. I bildklassificeringsbenchmarks som EMNIST och CIFAR-10 förbättrar HTE noggrannheten med upp till cirka sex procentenheter över starka bayesianska referenser, och med flera procentenheter över vanlig deterministisk träning, samtidigt som den fortfarande erbjuder nyttig osäkerhetsinformation och stark upptäckt av indata utanför fördelningen.

Mindre ensembler, smartare användning

Att provta hundratals eller tusentals modeller låter dyrt vid testtid, så författarna studerar även hur många ensemblemedlemmar som verkligen behövs. Genom att girigt kassera modeller som har liten effekt på prestandan finner de att ungefär en tredjedel av ensemblen ofta kan behållas utan att skada noggrannheten, även om bibehållen mycket skarp kalibrering typiskt kräver fler medlemmar. Över bilduppgifter och ett kaotiskt tidsserieförutsägelseproblem överträffar eller matchar deras metoder konsekvent populära alternativ som variational inference, Monte Carlo dropout och enklare deep ensembles, om än till en högre träningskostnad än ren deterministisk inlärning.

Vad detta betyder för verklig AI

För en icke-specialist är kärnbudskapet att vi kan göra djupinlärning inte bara mer exakt utan också ärlig om vad den inte vet, utan att behöva superdatorresurser i toppklass. Genom att varsamt väva in klassiska provtagningsidéer i modern, minibatch-baserad träning levererar de två föreslagna tillvägagångssätten bättre prediktioner och mer tillförlitliga konfidensuppskattningar än många befintliga tekniker. Denna kombination av effektivitet, robusthet och kalibrerad osäkerhet är ett viktigt steg mot att kunna använda djupinlärning säkert i känsliga domäner där kostnaden för överdriven säkerhet kan mätas i liv, inte bara procentenheter.

Citering: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Nyckelord: Bayesiska neurala nätverk, osäkerhetsuppskattning, Hamiltonian Monte Carlo, ensemble i djupinlärning, stokastisk gradient-MCMC