Clear Sky Science · sv

Slutna uttryck för inlärning utan återkoppling med framåtriktad projektion

Undervisa maskiner utan bakåtriktade signaler

Modern artificiell intelligens lär sig till stor del med en metod kallad backpropagation, där fel skickas bakåt genom ett nätverk för att justera dess interna kopplingar. Men denna process liknar inte hur verkliga hjärnor fungerar och kan vara långsam och resurskrävande. Denna artikel introducerar ett nytt sätt för neurala nätverk att lära sig, kallat Forward Projection, som hoppar över det bakåtriktade steget helt men ändå uppnår stark prestanda, särskilt i utmanande biomedicinska uppgifter med begränsade datamängder.

Ett nytt sätt att styra inlärning

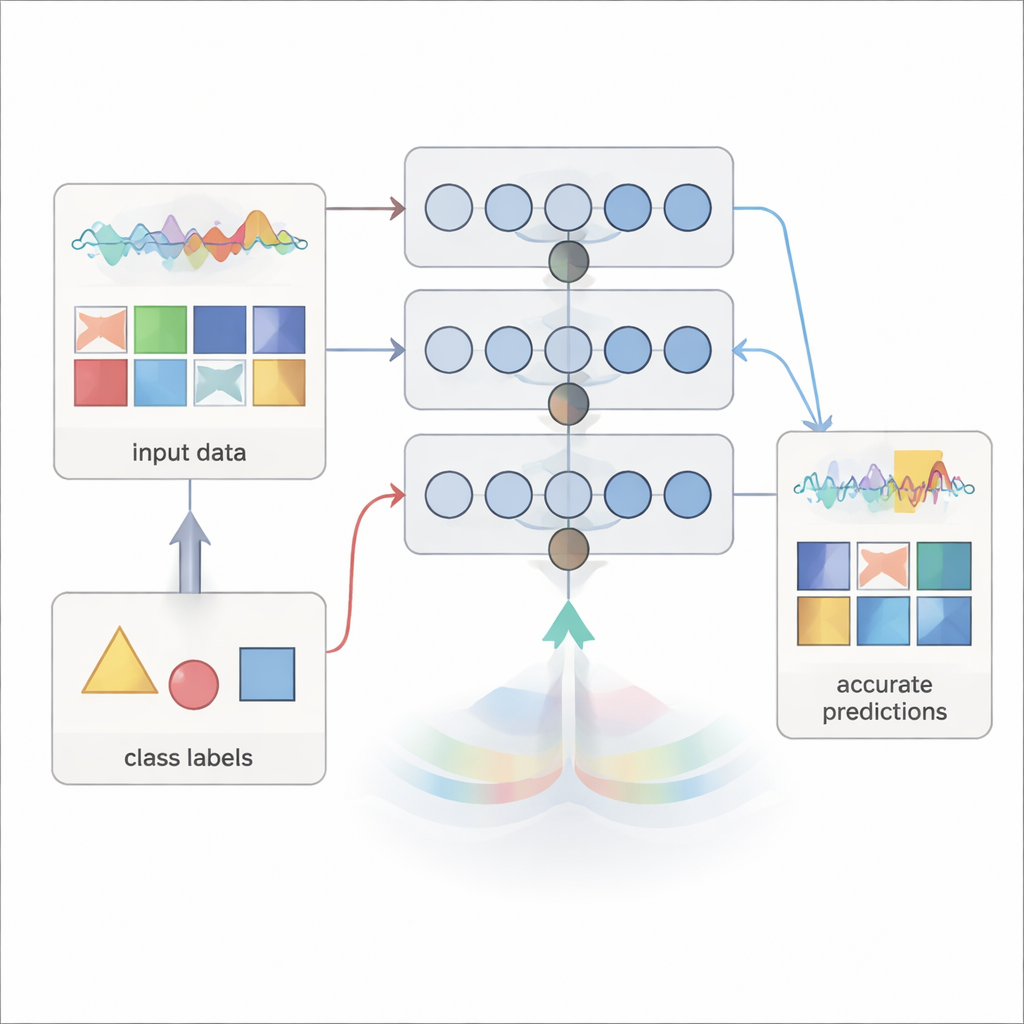

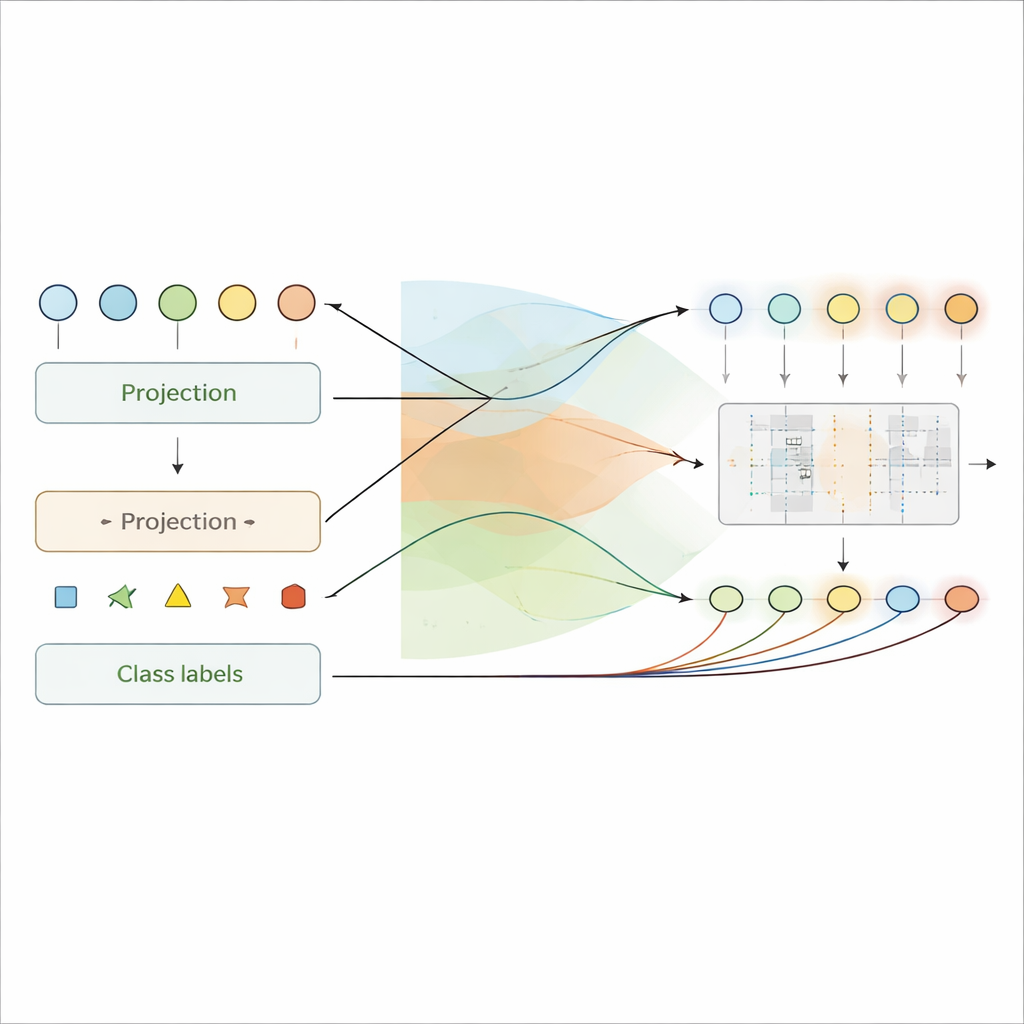

Traditionella neurala nätverk lär sig genom att jämföra sina prediktioner med rätt svar och skicka fel-signaler bakåt genom varje lager för att finjustera kopplingarna. Forward Projection tar en annan väg. Istället för att förlita sig på dessa bakåtriktade felmeddelanden använder den endast information som finns tillgänglig när signaler rör sig framåt: lagrets nuvarande aktivitet och mål-etiketten. I varje lager kombinerar metoden lagrets input och den önskade output-etiketten med fasta slumpmässiga projektioner som passerar genom en enkel icke-linearitet. Detta skapar ett ”mål” för det interna signalvärdet i det lagret — ett mönster av membranliknande aktivitet som lagret ska försöka matcha.

När dessa mål har skapats löses varje lags viktförbindelser i ett svep med hjälp av sluten-form-regression, en standardstatistisk formel istället för iterativ gradientnedstigning. Det betyder att nätverket kan tränas i ett enda genomlopp över datasetet, utan att upprepade gånger gå tillbaka till samma exempel eller lagra stora mängder mellanliggande aktiveringar. Eftersom ingen information behöver färdas bakåt respekterar metoden den ensidiga kommunikation som ses hos biologiska neuroner och kan bli enklare att implementera på specialiserad hårdvara med envägsförbindelser.

Se mening i dold aktivitet

En slående fördel med Forward Projection är att de interna signalerna i dolda lager blir direkt tolkbara. Eftersom varje lager uttryckligen tränas för att koda både input och etiketten i sina membranliknande potentialer kan dessa interna värden läsas som lokala prediktioner av klassen. Författarna visar hur man ungefärligt kan ”avkoda” dessa signaler tillbaka till etikettutrymme, vilket förvandlar aktivitetsmönster till per-lager-förklaringar av vad nätverket tror i varje steg. I experiment blir dessa förklaringar mer precisa i djupare lager, vilket speglar progressiv inlärning — tidiga lager fångar breda mönster, medan senare lager fokuserar på beslutskritiska detaljer.

Denne tolkbarhet är särskilt värdefull inom medicin, där förståelsen för varför en modell fattade ett beslut kan vara lika viktigt som själva beslutet. Med hjälp av elektrokardiogramdata visar författarna att Forward Projection framhäver kliniskt kända tecken på hjärtinfarkt — såsom förändringar i specifika vågformssegment — vid rätt tidpunkter. På ögonskanningar som används för att upptäcka onormal blodkärlsbildning fokuserar metoden naturligt på vätskefickor, ljusa avlagringar och ärrliknande områden som specialister letar efter, även när den tränats med så få som 100 exempel per klass.

Snabb träning, starka resultat

Gruppen jämförde Forward Projection med flera alternativ som också försöker undvika full backpropagation, samt med standard backpropagation själv. På bild- och sekvensuppgifter såsom Fashion-MNIST, igenkänning av DNA-promotorer, detektion av hjärtinfarkt från elektrokardiogram och objektigenkänning matchade eller överträffade den nya metoden prestandan hos andra lokala inlärningsregler. I standardinställningar hade backpropagation fortfarande en övergripande fördel, men Forward Projection nådde förvånansvärt nära i noggrannhet samtidigt som den endast använde ett enda träningspass.

Fördelarna blev tydligare i ”få-skotts”-scenarier, där endast ett fåtal märkta exempel är tillgängliga, vilket är vanligt i klinisk praxis. Här generaliserade Forward Projection ofta bättre än både backpropagation och konkurrerande lokala metoder på bröströntgenbilder, näthinneskanningar och små bilddelmängder. Backpropagation tenderade antingen att överanpassa de mycket små datamängderna eller misslyckas med att lära sig tillräckligt rika drag, medan Forward Projection producerade mer stabila, återanvändbara interna representationer. Ur ett beräkningsperspektiv krävde träning av ett stort lager flera storleksordningar färre multiplikations- och ackumuleringsoperationer än att köra många epoker av backpropagation, vilket översätts till betydande hastighetsförbättringar och lägre energikostnad.

Vad detta betyder för framtida AI och hjärninspirerad beräkning

I vardagliga termer visar detta arbete att neurala nätverk inte behöver förlita sig på tunga, biologiskt osannolika återkopplingsslingor för att lära sig användbara och förståeliga interna representationer. Genom att klokt blanda input och etiketter i ett enda framåtpass och lösa vikterna i slutet-form erbjuder Forward Projection ett sätt att snabbt träna modeller, tolka deras inre funktioner och hantera små, brusiga biomedicinska dataset. Medan backpropagation kvarstår som guldstandarden för många storskaliga uppgifter pekar detta återkopplingsfria tillvägagångssätt mot mer hjärnliknande och hårdvaruvänliga inlärningsstrategier som kan ligga till grund för nästa generationens effektiva, förklarbara AI-system.

Citering: O’Shea, R., Rajendran, B. Closed-form feedback-free learning with forward projection. Nat Commun 17, 2414 (2026). https://doi.org/10.1038/s41467-026-69161-1

Nyckelord: inlärning utan återkoppling, neurala nätverk, få-skotts träning, biomedicinsk AI, förklarbar djupinlärning