Clear Sky Science · sv

Uggle-visionsinspirerad nära-sensorn-beräkning

Se i mörkret som en uggla

Föreställ dig en drönare som kan upptäcka en vilsekommen vandrare eller ett avlägset rymdfarkost utan sökstrålkastare, även under stjärnljus så svagt att vanliga kameror knappt ser något alls. Denna artikel beskriver ny synhårdvara inspirerad av ugglor som för tanken närmare verkligheten. Genom att efterlikna hur en ugglas ögon anpassar sig till mörker och hur dess hjärna effektivt bearbetar svaga signaler bygger forskarna en liten elektronisk ”synaps” som både känner svagt ljus och utför delar av den beräkning som krävs för igenkänning, direkt på sensorn.

Varför befintliga maskiner har svårt i natten

Modern artificiell intelligens kan känna igen ansikten, föremål och scener med imponerande noggrannhet, men gör det vanligtvis med kraftfulla kretsar som förbrukar enorma mängder energi. Konventionella kameror skiljer också sensing från beräkning: först fångar kameran en bild; sedan bearbetar avlägsna processorer datan. Vid mycket svagt ljus misslyckas dessa kameror ofta om de inte får hjälp av kraftiga lampor eller omfattande digital förstärkning. En ugglas öga och hjärna samarbetar däremot: näthinnan samlar små mängder fotoner över tid, och neurala kretsar anpassar sig så att svaga former gradvis blir synliga. Författarna vill överföra en liknande, tätt integrerad och energieffektiv strategi till maskinseende.

En liten enhet som lär sig av ljus

I kärnan av arbetet finns en ”ugglainspirerad tvåläges adaptiv synaps”—en liten transistorbaserad enhet som fungerar både som ljussensor och som en lärande koppling mellan nervceller. Enheten byggs i lager: en genomskinlig botten-elektrod, en dielektrisk film som kan fånga laddningar, en specialutformad ljusabsorberande blandning och en organisk halvledarkan al högst upp. När svagt ljus träffar absorptionslagret genereras ett fåtal laddningsbärare som, styrda av en applicerad spänning, fastnar i dielekt-riken och ackumuleras i kanalen. Detta ökar gradvis enhetens elektriska respons, på samma sätt som stavceller i en ugglas näthinna blir mer känsliga när de anpassar sig till mörker. Författarna visar att deras enhet kan reagera på ljusintensiteter så låga som 0,146 nanowatt per kvadratcentimeter—ungefär tre storleksordningar svagare än vad standardkamerachips klarar—samtidigt som den uppvisar en stark, justerbar förstärkning som kvantifierar dess mörkeranpassning.

Agera som en artificiell synaps

Utöver att bara känna ljus efterliknar enheten också hur biologiska synapser försvagas eller stärks med aktivitet. Under upprepade ljuspulser över ett brett färgområde, från ultraviolett till nära-infrarött, ökar enhetens ström i bestående steg och lagrar en minnesbild av den optiska historien. Vid elektriska pulser applicerade på dess grind uppvisar den långtidspotentiering och depressionsfenomen—gradvisa, reversibla förändringar i ledningsförmåga som kodar synaptiska ”vikter” i artificiella neurala nätverk. Dessa vikter lagras icke-flyktigt, vilket betyder att enheten minns dem utan konstant strömförsörjning, och kan justeras över flera nivåer likt ett flertalsbitarigt digitalt värde. Av avgörande betydelse är att varje synaptiskt händelse förbrukar i storleksordningen 10 femtojoule energi, jämförbart med eller till och med lägre än uppskattningar för biologiska synapser, och många ordningar lägre än energibudgetarna för typisk AI-hårdvara.

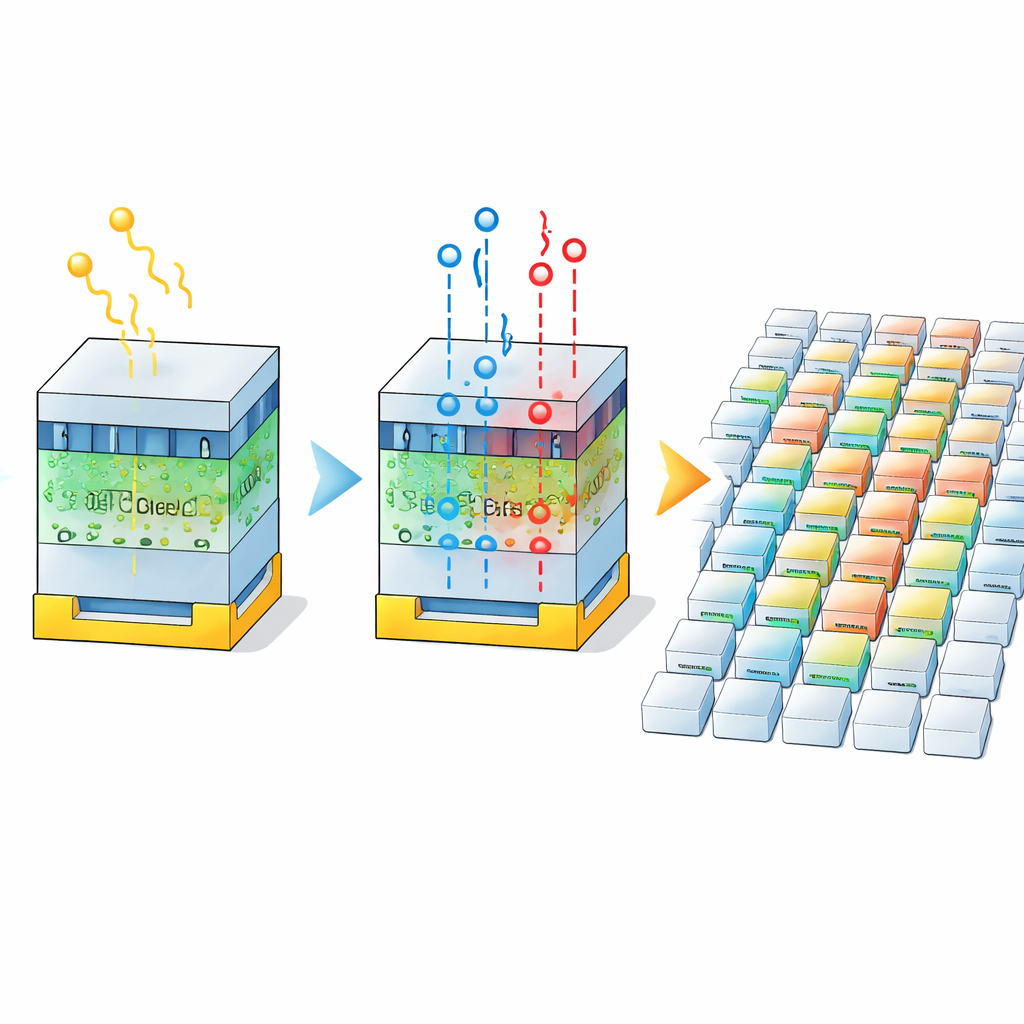

Från en enstaka synaps till synsystem

För att bekräfta att detta beteende håller i större skala tillverkar teamet en matris på 19 gånger 17 enheter och visar att de fungerar enhetligt. När ett svagt ljusmönster projiceras på matrisen växer fotoströmmarna vid belysta punkter gradvis under anpassningen, vilket avslöjar tidigare dolda former under ultralåg illumination, ungefär som en ugglas näthinna som skärper en bild i mörkret. Författarna kartlägger sedan enhetens flera ledningsnivåer till vikter i maskininlärningsmodeller, inklusive enkla flerskiktsperceptroner, konvolutionsnätverk och en djup VGG-liknande arkitektur. Även med relativt grova, diskreta vikter når dessa simulerade nätverk fortfarande över 90 procent noggrannhet på standardbilddataset, vilket visar att de synaptiska tillstånden är tillräckliga för praktisk beräkning.

Nattsyn för drönare och vidare

För att illustrera verklig potential simulerar forskarna ett luft-till-marknads-igenkänningssystem monterat på en liten drönare, tränat att upptäcka ett klädesformigt mål vid olika ljusstyrkenivåer som motsvarar stjärnbelysta förhållanden. Genom att relatera enhetens tidsberoende respons till kontrasten i fångade bilder bygger de ett förbehandlingssteg som ”anpassar” bilden, höjer användbar kontrast samtidigt som den håller sig inom realistiskt sensorbeteende. Ett populärt objektidentifieringsnätverk (YOLOv5) tränat på dessa anpassade data uppnår över 95 procents igenkänningsnoggrannhet även på den lägsta testade ljusnivån. Enkelt uttryckt visar arbetet att genom att kombinera ugglelika mörkeranpassningar med inbyggd synaptisk inlärning direkt i sensorn är det möjligt att föra maskinseende ner till förhållanden där traditionella kameror misslyckas, samtidigt som mycket mindre energi används. Sådan teknik skulle så småningom kunna ligga till grund för sök- och räddningsdrönare, autonoma utforskare eller astronomiska instrument som ser mer samtidigt som de ger ifrån sig mindre ljus.

Citering: Zhao, Z., Cao, Y., Huang, S. et al. Owl-vision-inspired near sensor computing. Nat Commun 17, 2676 (2026). https://doi.org/10.1038/s41467-026-69123-7

Nyckelord: seende i svagt ljus, neuromorfisk sensor, ugglainspirerad bildgivning, nära-sensor-beräkning, objektdetektion nattetid