Clear Sky Science · sv

Transferinlärning i DeepLC förbättrar LC-retentionstidsprognoser över avsevärt olika modifieringar och uppsättningar

Varför det är viktigt att förutsäga kemins tidpunkter

Varje gång forskare studerar proteiner i våra celler förlitar de sig på en metod som först skickar små proteinbitar, kallade peptider, genom en vätskefylld kolonn innan de vägs i en masspektrometer. Hur länge varje peptid stannar i kolonnen – dess ”retentionstid” – är oerhört informativt och hjälper forskare att känna igen och bekräfta vad de mäter. Men eftersom varje laboratorium använder något olika instrument och inställningar, fallerar ofta datormodeller som förutsäger dessa retentionstider när de flyttas från en uppsättning till en annan. Denna artikel visar hur ett modernt maskininlärningstrick, kallat transferinlärning, kan göra dessa prognoser mycket mer tillförlitliga och flexibla över många experimentella förhållanden.

Tajma resan för proteinfragment

I proteinforskning är vätskekromatografi–masspektrometri den centrala arbetsmetoden. Vätskekromatografi-steget separerar tusentals peptider baserat på deras kemiska egenskaper, så att de inte alla anländer till detektorn samtidigt. Den resulterande retentionstiden, tillsammans med peptidens uppmätta massa, ger forskare ett kraftfullt tvådimensionellt fingeravtryck. Under det senaste decenniet har forskare tränat datormodeller för att förutsäga retentionstider direkt från peptidsekvenser. Dessa förutsägelser ökar säkerheten i peptididentifieringar, hjälper till att designa bättre experiment och är viktiga för att bygga stora, datorgenererade spektralbibliotek som används i moderna höggenomströmmade arbetsflöden.

Problemet med förändrade laboratorieförhållanden

Tyvärr är retentionstid mycket känslig för detaljer som lösningsmedlets surhetsgrad, kolonnmaterial, tryck och temperatur. Även små förändringar kan omfördela ordningen i vilken peptider kommer ut ur kolonnen. Traditionella metoder försöker åtgärda detta genom att ”kalibrera” en modell som tränats någon annanstans med en liten uppsättning referenspeptider, med antagandet att ordningen i vilken peptider elueras förblir densamma. När detta antagande bryts – till exempel när kolonnkemin eller provets pH ändras – kan kalibrering misslyckas kraftigt. Ett annat alternativ är att träna en helt ny modell för varje uppsättning, men det kräver många välmätta peptider, vilket inte alltid finns tillgängligt, särskilt för sällsynta eller ovanliga kemiska modifieringar.

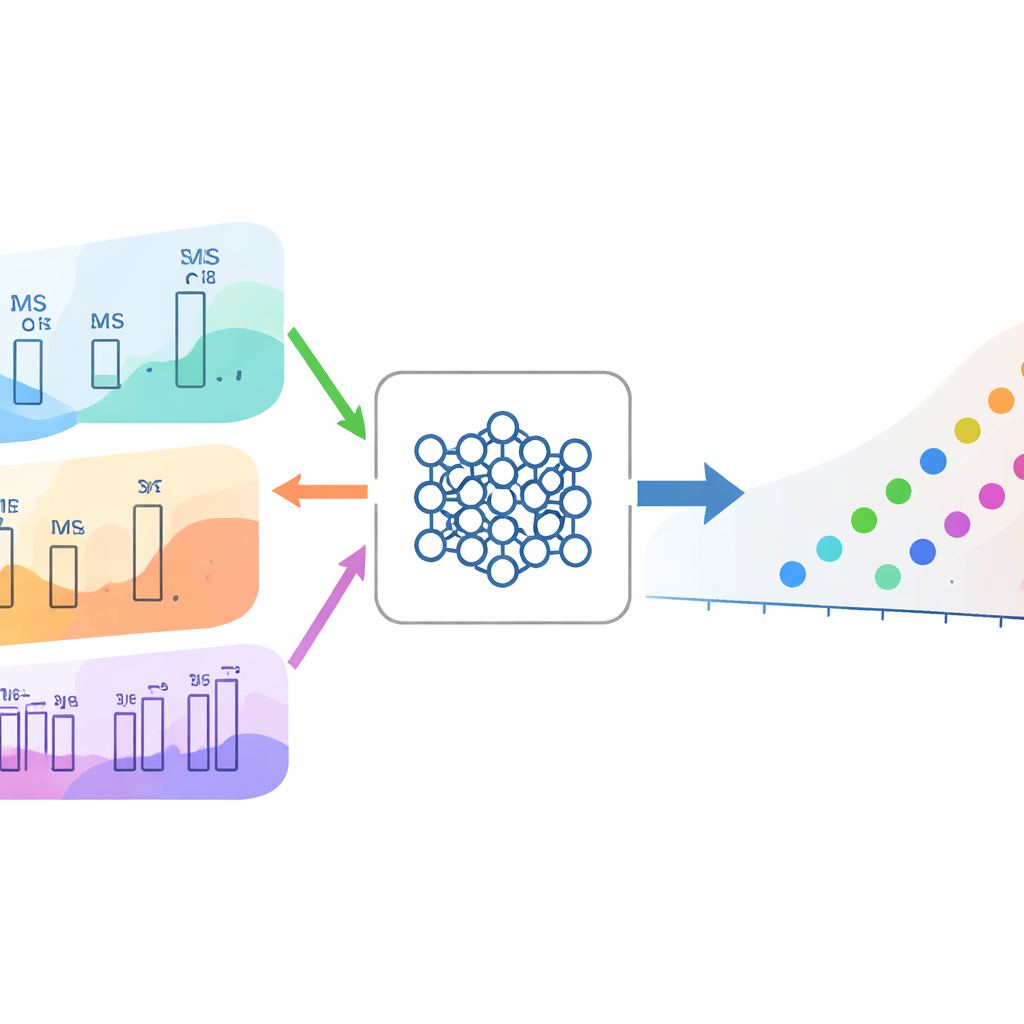

Återanvända kunskap med transferinlärning

Författarna bygger vidare på DeepLC, en djuplärningsmodell som redan förutsäger retentionstider för många peptidtyper. Istället för att börja om från noll för varje ny situation återanvänder de en modell som tränats på en stor, högkvalitativ datamängd och finjusterar den på en mycket mindre samling peptider från den nya uppsättningen. Över 474 datamängder hämtade från hundratals offentliga experiment överträffar denna transferinlärningsstrategi nästan alltid både enkel kalibrering och att träna en ny modell från slumpmässiga startinställningar. Vinsterna är särskilt tydliga när endast några hundra till ett par tusen träningspeptider är tillgängliga, ett vanligt scenario i verkliga studier. Även när många exempel finns tenderar transferinlärning fortfarande att ge något bättre noggrannhet.

Hantering av ovanlig kemi och extrema förhållanden

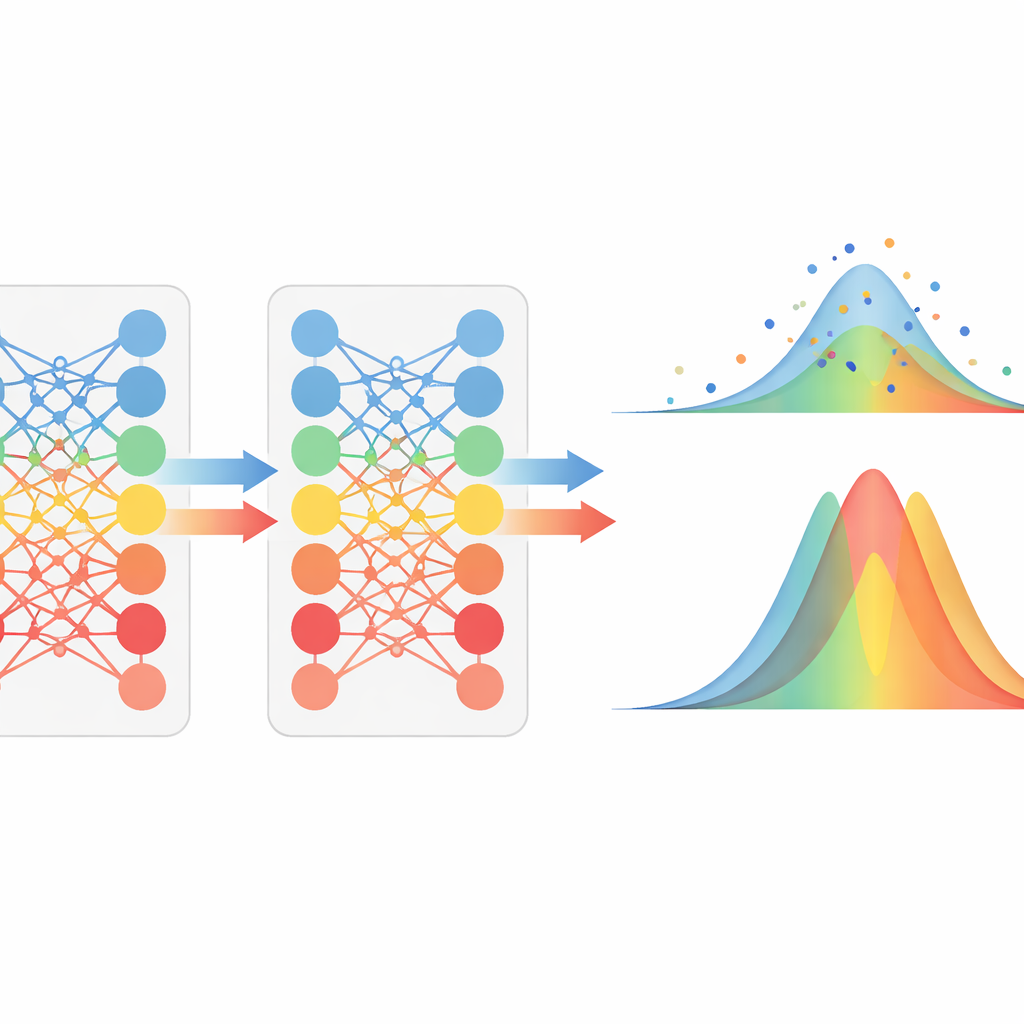

För att testa hur långt detta tillvägagångssätt kan drivas undersökte teamet mycket utmanande scenarier. I ett fall bar peptiderna en skrymmande kemisk etikett som gör dem mycket mer ”feta”, vilket kraftigt försköt deras retentionstider. I ett annat gjordes vätskan i kolonnen basisk istället för sur, vilket fundamentalt förändrar hur peptider interagerar med kolonnen. I båda fallen misslyckades enkel kalibrering, och även en nytränad modell behövde många exempel för att uppnå god noggrannhet. Transferinlärning anpassade sig däremot snabbt och uppnådde likvärdig eller bättre prestanda med två till tre gånger färre träningspeptider. Metoden förbättrade också förutsägelser för en bred panel av posttranslationella modifieringar som aldrig setts under träningen, vilket indikerar att modellens förkunskaper om peptidkemi överförs till nya modifieringar.

Vad detta betyder för framtida proteinstudier

För icke-specialister är huvudbudskapet att återanvändning av vad ett neuralt nätverk redan lärt sig om peptiders beteende gör det mycket enklare att få precisa tidsprognoser under nya experimentella förhållanden. Istället för att mödosamt samla stora träningsset eller acceptera dålig prestanda från enkel kalibrering kan forskare finjustera en befintlig DeepLC-modell med ett måttligt antal exempel och ändå uppnå mycket exakta retentionstider. Detta gör avancerade prognosverktyg mer robusta och mer tillgängliga, möjliggör tillförlitliga analyser över olika instrument, kemiska förhållanden och sällsynta peptidmodifieringar, och hjälper i slutändan forskare att läsa proteinvärlden med större klarhet och effektivitet.

Citering: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Nyckelord: proteomik, vätskekromatografi, prognos av retentionstid, djuplärning, transferinlärning