Clear Sky Science · sv

Träna taktila sensorer att lära sig kraftmätning av varandra

Robotar som kan känna och dela sin känsel

När robotar flyttar ut ur fabriker och in i hem, sjukhus och lager behöver de en förmåga vi ofta tar för given: känsel. Precis som våra fingrar automatiskt anpassar sig när vi plockar upp en potatischips kontra en tung låda, måste framtidens robotar lära sig hur hårt de ska klämma och när ett föremål håller på att glida. Denna artikel presenterar ett nytt sätt för robotisk ”hud” att lära sig kraftmätning från andra hudar, vilket minskar dyr kalibrering och för maskiner närmare människolik fingerfärdighet.

Varför robotkänsel är så svår att få rätt

Moderna robotar har redan många typer av artificiell hud. Vissa använder små kameror som tittar in i mjuka geler, andra förlitar sig på magneter eller elektroniska nät som känner tryck. Varje design utmärker sig vid vissa uppgifter, men de talar alla olika ”dialekter” av känsel: samma tryck på två sensorer kan ge mycket olika signaler. Idag kräver nästan varje ny sensor en egen mödosam träningsprocess med precisa kraftmätare, upprepad tusentals gånger. Värre är att mjuka material åldras och slits, så denna kostsamma kalibrering måste göras om när en sensor byts ut.

Låna en idé från den mänskliga hjärnan

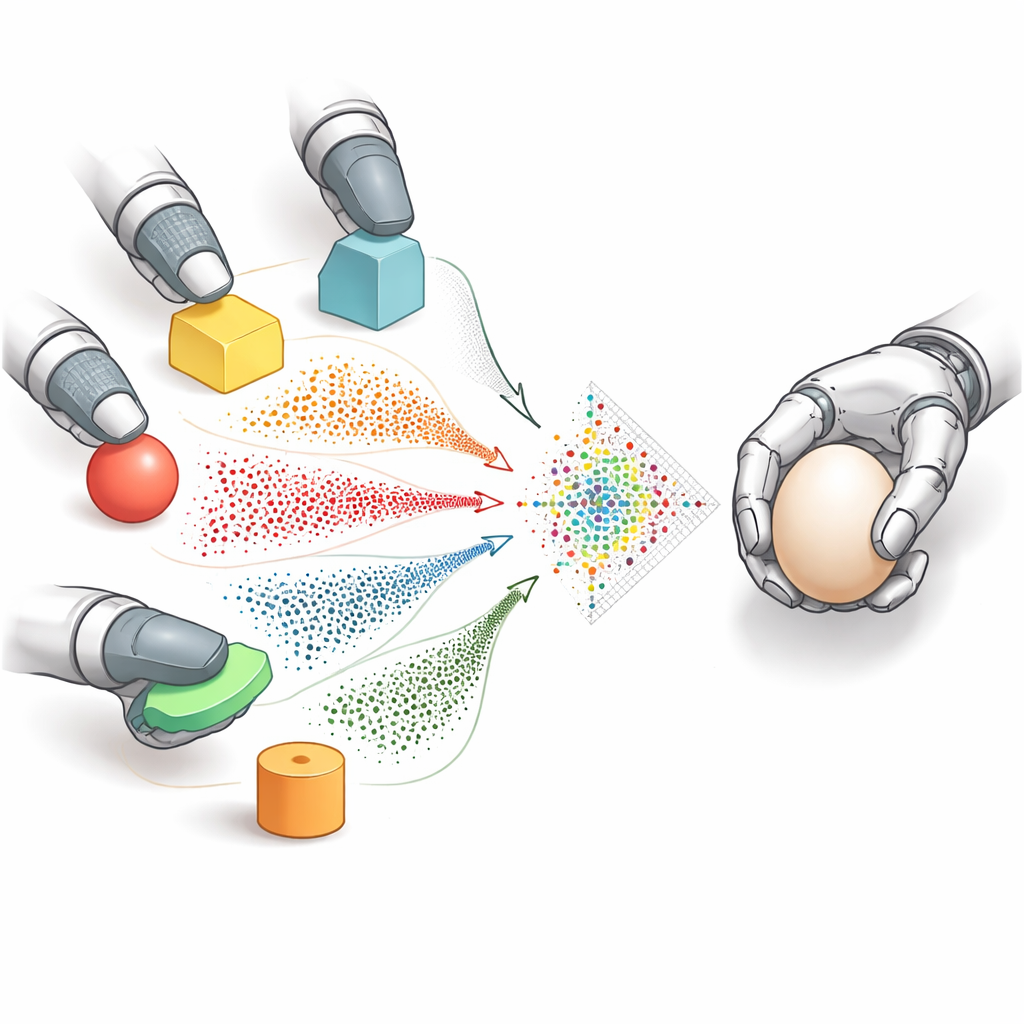

Människor löser ett liknande problem utan ansträngning. Vår hud är full av olika sorters känselreceptorer, ändå omvandlar hjärnan alla deras signaler till en gemensam intern kod. Det här enhetliga taktila minnet låter oss uppskatta hur något skulle kännas på en del av handen som aldrig rört vid det tidigare, genom att dra på tidigare erfarenhet. Forskarna bakom detta arbete efterliknar den idén i robotar. De omvandlar alla sensorutgångar — kamerabilder, magnetavläsningar eller elektriska signaler — till en gemensam bildlik form gjord av punkter, som representerar hur huden deformeras. Denna delade markörrepresentation fungerar som ett enkelt ”känselspråk” som vilken sensor som helst kan använda.

Lära en sensor att imitera en annan

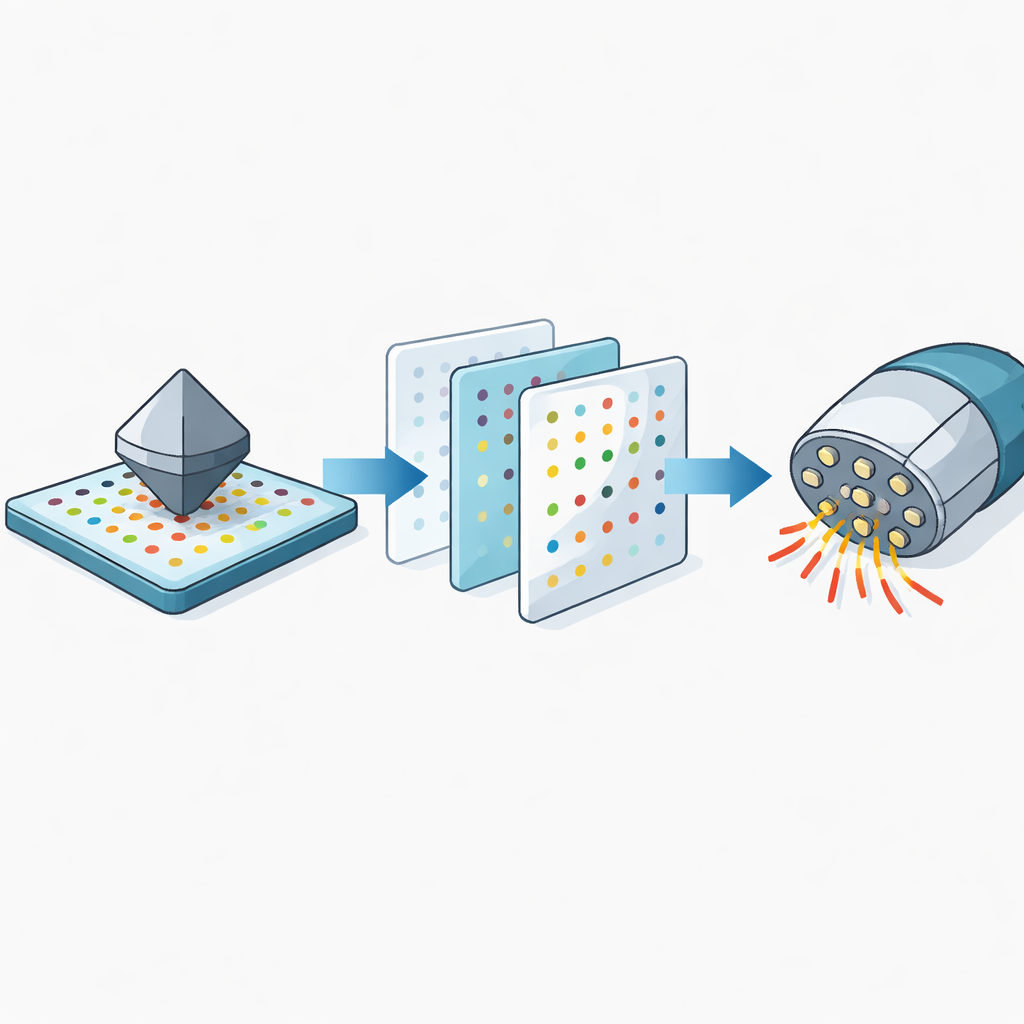

När alla sensorer talar detta punktbaserade språk introducerar teamet ett översättningssteg kallat markör-till-markör-översättning. Med kraftfulla generativa modeller tränar de ett system som kan omvandla punktmönstret från en sensor till det mönster en annan sensor skulle ha visat vid samma kontakt. Det innebär att en välkalibrerad sensor effektivt kan ”föreställa sig” vad en okalibrerad sensor skulle känna och generera syntetiska träningsdata för den. En andra modell betraktar sedan korta sekvenser av dessa punktbilder för att förutsäga hur krafter förändras över tiden i tre riktningar, med hänsyn till både tryck och sidledes skjuvning.

Hantering av verkliga skillnader i mjuk hud

I praktiken är olika robothudar inte bara formade och kopplade olika; de är också gjorda av material som kan vara mjukare eller styvare, och som förändras med tiden. Dessa skillnader kan förvränga kraftuppskattningar även om mönstren ser lika ut. Forskarna mäter hur varje typ av mjukt material böjer sig under belastning och bygger ett enkelt korrigeringsteg som skalar kraftetiketterna upp eller ner innan träning. Denna materialkompensation minskar felen avsevärt, särskilt vid överföring av kunskap mellan mycket mjuka och mycket styva hudar.

Från labb bänk till vardaglig manipulation

Teamet testar sin metod, kallad GenForce, på en bred blandning av sensorer, från flera kopior av samma kamerabaserade platta till mycket olika konstruktioner som använder magneter eller böjda, fingertoppsliknande former. I mer än 200 kombinationer i simulering och hårdvara minskar GenForce prediktionsfelen markant jämfört med att bara återanvända en modell tränad på en annan sensor. I demonstrationer använder en robothand utrustad med olika taktila hudar på varje finger överförda modeller för att varsamt greppa ömtåliga föremål som frukt och potatischips, och för att upptäcka och korrigera glidande objekt genom att samordna avläsningarna från båda sidor av ett grepp.

Vad detta betyder för framtidens robothänder

Genom att låta taktila sensorer lära sig kraftmätning av varandra istället för att börja från noll pekar GenForce mot robothänder som är lättare och billigare att ta i bruk i stor skala. En enda noggrant kalibrerad sensor skulle kunna träna många andra, även av olika konstruktioner, och förtränade modeller skulle kunna finjusteras med bara en liten mängd ny data. För icke-specialister är slutsatsen enkel: detta arbete gör det mer praktiskt för robotar att känna hur hårt de klämmer och att reagera snabbt när föremål börjar glida, vilket för oss närmare maskiner som hanterar verkligheten med samma säkra känsel som mänskliga händer.

Citering: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Nyckelord: robotkänsel, taktila sensorer, kraftmätning, robotmanipulation, transferinlärning