Clear Sky Science · sv

Storskaliga språkmodellers mosaikminne

Varför nära‑träffkopior spelar roll

Stora språkmodeller som ChatGPT lär sig från oceaner av text och memoriserar ibland delar av den texten. Det väcker oro kring integritet, upphovsrätt och hur rättvist vi kan bedöma vad dessa system verkligen kan. Denna artikel visar att memorering inte bara handlar om exakt kopiering. Istället kan språkmodeller återskapa stycken från många något olika versioner, ungefär som att sätta ihop en mosaik. Att förstå denna dolda typ av minne är avgörande för alla som bryr sig om säker och pålitlig AI.

Ett nytt sätt att tänka om maskinminne

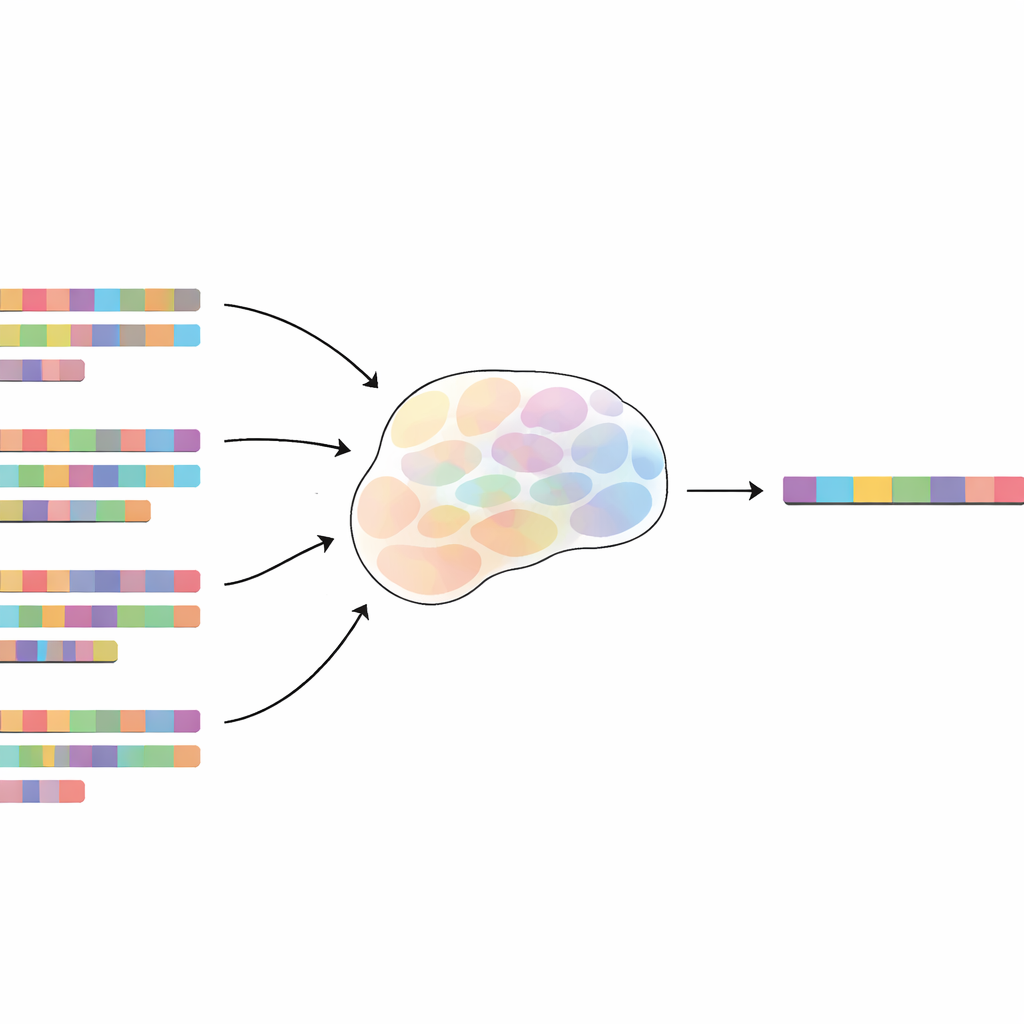

De flesta antar att en språkmodell bara memoriserar något om den ser exakt samma mening om och om igen. Författarna utmanar den bilden genom att presentera ”mosaikminne”. Enligt denna idé kan en modell memorera ett 100‑ordsstycke inte bara från exakta upprepningar utan också från många fuzzy‑dupliceringar — versioner där några ord saknas, ändrats eller blandats. För att studera detta noggrant planterar de konstgjorda testfraser, kallade kanariefåglar, i modellens träningsdata tillsammans med många ändrade varianter. Efter träning mäter de hur lätt det är att avgöra om en given kanariefågel fanns i träningsuppsättningen, med hjälp av en typ av integritetstest kallat membership inference attack.

Hur fuzzy‑kopior ändå lämnar ett tydligt spår

Genom att jämföra fuzzy‑dupliceringar med exakta upprepningar definierar forskarna en ”exakt duplicat‑ekvivalent”: hur mycket en fuzzy‑kopia bidrar till memorering jämfört med en perfekt kopia. De finner att även mycket milda förändringar knappt försvagar memoreringen. Om bara omkring 10 % av orden i varje duplikat ersätts slumpmässigt bidrar en enskild fuzzy‑kopia fortfarande ungefär 60–65 % så mycket som ett exakt duplicat. Även när hälften av orden ändras räknas varje ändrad version fortfarande för omkring 15–20 % av ett fullständigt exemplar. Effekten är robust: att lägga in slumpmässiga fyllnadsord mellan nyckelfraser eller att blanda om satser minskar memoreringen, men utplånar den inte. Modellen verkar kunna bortse från brus, fokusera på överlappande fragment och sy ihop dem igen.

Form framför mening i vad modeller lagrar

Med tanke på att moderna språkmodeller kan lösa matematikproblem, följa instruktioner och översätta mellan språk kan man tro att deras minnen handlar om mening. Överraskande nog visar studien motsatsen. När författarna ersätter ord med alternativ som bevarar mening förbättras memoreringen bara marginellt jämfört med att ersätta dem med slumpord. Parafraser som genererats av andra AI‑system — vilka bevarar samma idé men ändrar många ytliga detaljer — bidrar relativt lite till memorering såvida de inte fortfarande delar många korta ordsekvenser med originalet. I en rad tester är det överlappning i exakta tokens (modellens grundläggande ordbitar), inte delade idéer, som verkligen driver minnet. Med andra ord handlar modellens mosaikminne främst om form, inte om mening.

Dolda duplicat i verkliga träningsdata

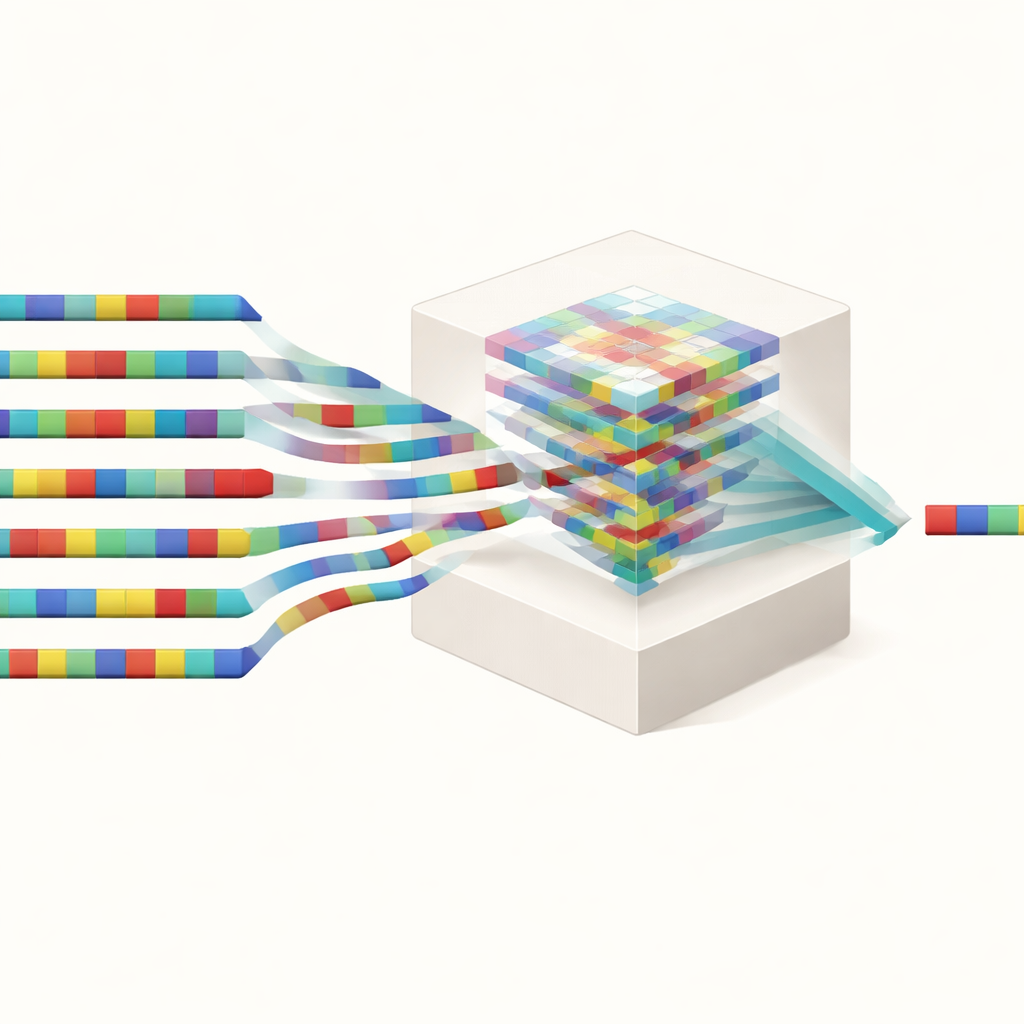

Författarna undrar sedan hur vanliga fuzzy‑duplicat är i en populär, kraftigt rensad webbdatamängd som används för att träna språkmodeller, känd som SlimPajama. Trots att denna datamängd redan fått nära‑identiska dokument borttagna finner teamet att många 100‑tokensekvenser som förekommer exakt 1 000 gånger också har tusentals nära‑träffar. För små redigeringsavstånd — ungefär 10 % av tecknen förändrade — finns i genomsnitt omkring fyra gånger så många fuzzy‑duplicat som exakta, och tiotusentals fler vid större men ändå inflytelserika avstånd. Viktigt är att standardtekniker för ”deduplicering” som används i branschen, vilka vanligtvis tar bort endast långa exakta överlappningar, lämnar de flesta av dessa fuzzy‑kopior orörda. Det betyder att modeller ändå kan memorera känsligt eller upphovsrättsskyddat material genom att pussla ihop det från många lätt förändrade källor.

Varför detta spelar roll för integritet, rättvisa och kontroll

Dessa resultat har vittgående implikationer. För integritet visar de att det inte räcker att bara rensa bort exakta upprepningar från träningsdata: personlig eller konfidentiell information kan memoriseras genom familjer av liknande stycken. För upphovsrätt och benchmarktester kan fuzzy‑duplicat få modeller att reproducera skyddad text eller konstgjort höja poäng på tester som de i praktiken sett i förklädd form. För försök att ”avlära” specifika data räcker det inte att ta bort ett enskilt offending‑exempel om många varianter finns kvar. Sammanfattningsvis visar arbetet att språkmodellernas minne är en komplex mosaik byggd av många små överlappningar, vilket utmanar dagens säkerhetsverktyg och kräver smartare, mer finmaskiga metoder för att rensa och granska träningsdata.

Citering: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Nyckelord: språkmodellens memorering, fuzzy-dupliceringar, datasekretess, rengöring av träningsdata, benchmarkkontaminering