Clear Sky Science · sv

Modell‑agnostisk linjär‑minnes onlineinlärning i spikande neurala nätverk

Varför det är så svårt att träna hjärnliknande datorer

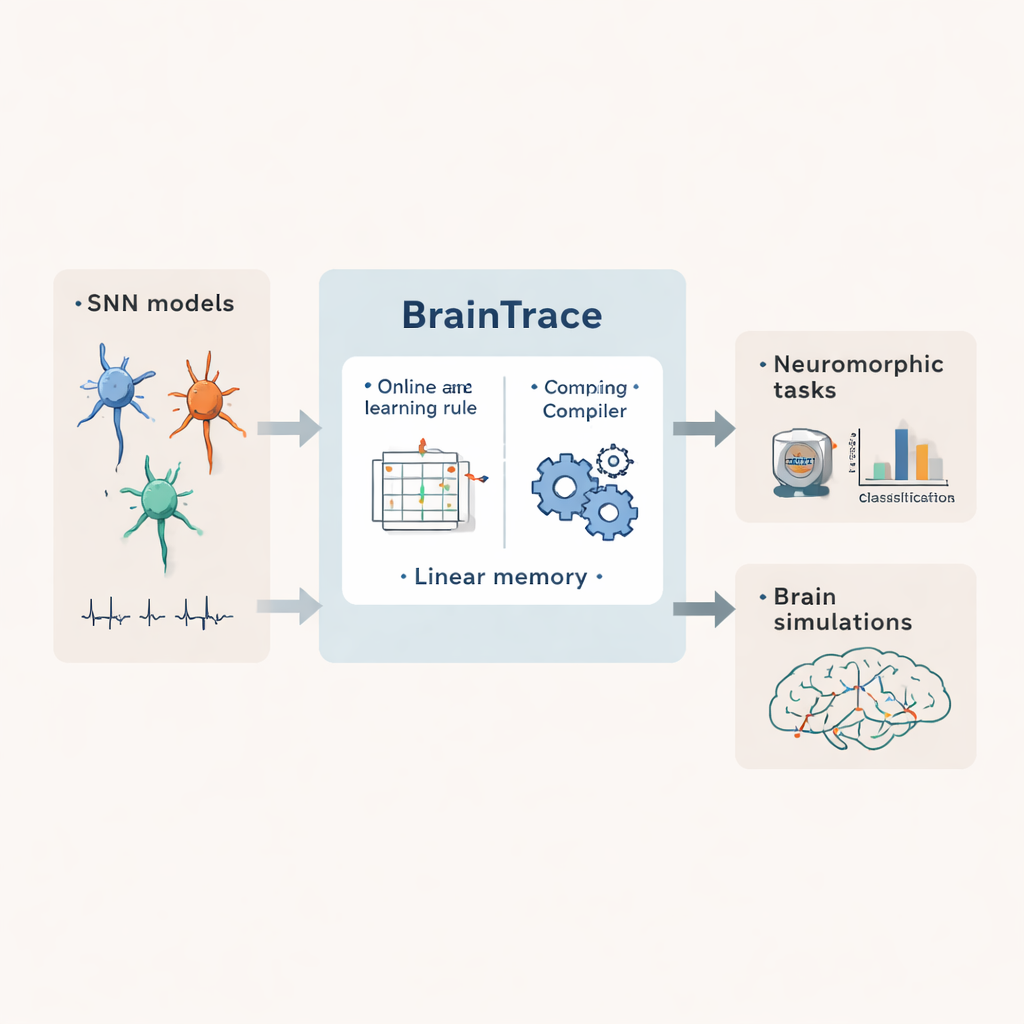

Spikande neurala nätverk är en klass av artificiella nätverk som kommunicerar med korta elektriska pulser, mycket likt verkliga hjärnceller. De lovar ultralåg energiförbrukning, hjärninspirerad beräkning och mer realistiska simuleringar av nervkretsar. Men att lära dessa nät att utföra komplexa uppgifter, särskilt över långa tidsrymder, kräver ofta enorma mängder datorminne och handgjord kod. Den här artikeln presenterar BrainTrace, ett system utformat för att göra träning av spikande nät både praktiskt genomförbar och lättillgänglig.

Att lära nätverk som lär i realtid

De mest kraftfulla träningsmetoderna för hjärnliknande nätverk fungerar genom att spela upp en hel sekvens av aktivitet och föra felinformation bakåt genom varje tidssteg. Denna metod, känd som backpropagation through time, kan vara mycket exakt men stöter snabbt på problem när sekvenser är långa eller nätverken stora: varje mellanläge måste sparas, vilket leder till minnesökning som skalar med både tid och nätverksstorlek. Alternativa ”online”-metoder uppdaterar kopplingarna stegvis medan data strömmar in, vilket kraftigt minskar lagringsbehovet. Dock fungerar befintliga online‑regler antingen endast för förenklade neuronmodeller eller kräver fortfarande minne som växer kvadratiskt med nätverksstorlek, vilket gör dem svåra att tillämpa på realistiska, hjärnskaliga system.

Ett allmänt recept för många typer av spikande nätverk

BrainTrace angriper detta genom att först beskriva spikande nätverk på ett enhetligt sätt. Författarna visar att många neuron‑ och synapstyper kan uttryckas som två interagerande delar: interna dynamiker som beskriver hur varje neurons tillstånd förändras över tid, och interaktionsdynamiker som omvandlar inkommande spikar till strömmar mellan celler. De introducerar vidare två modelleringssynsätt, kallade AlignPre och AlignPost, som organiserar synapser antingen runt den sändande neuronen eller den mottagande neuronen. Denna abstraktion gör att en mängd biologiska och konstruerade modeller kan hanteras med samma matematiska verktyg, från enkla läckande neuroner till rikare celler med adaptiva trösklar och komplexa synapser.

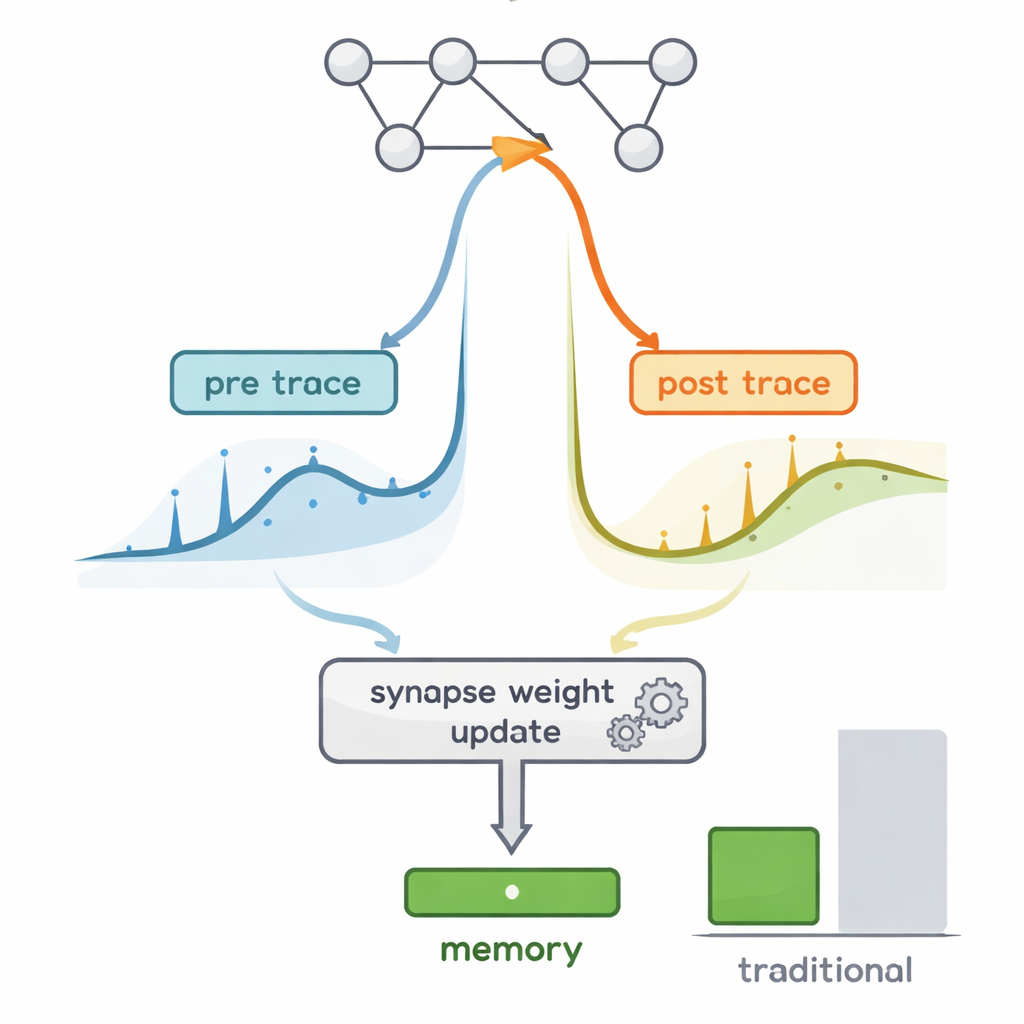

En minnessnål metod för att följa orsak och verkan

Kärnutmaningen i onlineinlärning är att spåra hur små förändringar i varje koppling så småningom skulle påverka nätverkets beteende, en storhet som fångas av så kallade ”eligibility traces” (behörighetsspår). I princip kräver full behörighetsinformation spårning av enorma matriser som skalerar med kuben av antalet neuroner. BrainTrace utnyttjar tre nyckelegenskaper hos spikande nätverk: de flesta neuroner är tysta största delen av tiden; varje neurons egen läckning och reset dominerar hur dess tillstånd ändras; och spikar samt synaptiska ledningar är alltid positiva. Med dessa faktum visar författarna att de tunga behörighetsmatriserna kan approximeras väl av produkten av bara två kompakta spår per synaps, ett som summerar presynaptisk aktivitet och ett som summerar postsynaptisk aktivitet. Denna pre‑post‑propagationsregel, kallad pp‑prop, använder minne som bara växer linjärt med nätverksstorleken, men ger ändå gradienter som ligger väl i linje med dem från full backpropagation.

Automatiska verktyg som döljer matematiken

Utöver själva inlärningsregeln tillhandahåller BrainTrace en kompilator som spelar en roll liknande automatiska differentieringsbibliotek i djupinlärning. En användare skriver ner dynamiken för sin spikande modell i ett högre nivåspråk. BrainTrace‑kompilatorn analyserar sedan hur tillstånd och parametrar är kopplade, konstruerar nödvändiga behörighetsspår och genererar optimerad kod som kör pp‑prop eller en besläktad algoritm effektivt på CPU:er, GPU:er eller specialiserade acceleratorer. Det innebär att modellbyggare kan fokusera på vetenskapliga frågor i stället för att handkoda känslig gradientlogik, samtidigt som de drar nytta av onlineinlärning med effektivt minnesutnyttjande.

Från små sensorer till en hel fruktflugehjärna

Författarna testar BrainTrace på standardiserade neuromorfa benchmarkar, där spikande nätverk klassificerar händelsebaserade versioner av bilder, ljud och gester. I flera dataset och arkitekturer matchar pp‑prop noggrannheten hos full backpropagation samtidigt som det använder flera storleksordningar mindre minne och kör snabbare än andra online‑metoder. Avgörande är att systemet också skalar till krävande neurovetenskapliga problem. I ett exempel lär sig ett biologiskt detaljerat spikande nätverk med separata excitatoriska och inhibitoriska populationer en uppgift i evidensakkumulering och utvecklar aktivitetsmönster som liknar dem som registrerats i musens kortex. I ett annat tränas en spikande modell med mer än 125 000 neuroner, kopplad enligt fruktflugans connectom, för att återge vilotillståndsaktivitet inspelad över hela flughjärnan—en bedrift som överstiger minneskapaciteten för konventionell träning på ett enda grafikkort.

Vad detta betyder för framtidens hjärnliknande beräkning

För icke‑experter är huvudbudskapet att BrainTrace förvandlar en tidigare opraktisk dröm—att träna rika, hjärnskaliga spikande nätverk i realtid—till en realistisk möjlighet. Genom att hitta ett smart sätt att hålla reda på orsak och verkan med endast en liten mängd minne, och genom att paketera detta i automatiserade verktyg, för arbetet hjärninspirerad beräkning närmare vardagsanvändning både inom artificiell intelligens och grundläggande neurovetenskap. Det pekar mot en väg för maskiner som lär och anpassar sig med effektiviteten och tidsmässiga precisionen hos verkliga nervsystem, utan att kräva superdatorresurser.

Citering: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Nyckelord: spikande neurala nätverk, onlineinlärning, neuromorf beräkning, hjärnsimulering, gradientbaserad träning