Clear Sky Science · sv

Estimering och redigering av belysning från en enda vy för dynamisk ljusfältsvisning

Varför din virtuella värld bör matcha ditt vardagsrum

Alla som har använt ett VR- eller mixed-reality-headset har sett det: ett digitalt föremål som ser märkligt malplacerat ut, med ljus och skuggor som inte riktigt stämmer överens med rummet du befinner dig i. Denna artikel tar sig an det problemet. Författarna presenterar ett sätt för headset att ”förstå” belysningen i din verkliga omgivning från endast en enda kameraposition, och använder den kunskapen för att få virtuella objekt att se ut som om de verkligen hör hemma i din värld—ingen speciell ljusprobe, inga komplicerade inspelningar eller omfattande kalibrering krävs.

Göra ljus i rummet lättare att hantera

I fysik och datorgrafik styrs en scenens utseende av dess fulla ”ljusfält”: alla ljusstrålar som färdas genom rummet i alla riktningar. Att rekonstruera detta fält exakt kräver vanligtvis mycket data, med många bilder och noggranna mätningar. Moderna 3D-tekniker som neurala radiansfält kan lagra scener i neurala nätverk, men de ”bakar in” oftast det ljus som rådde vid inspelningen. Det innebär att den virtuella scenen bara ser korrekt ut under de ursprungliga förhållandena och faller sönder när rummets belysning förändras. Författarna vill bryta denna begränsning genom att hitta en kompakt beskrivning av verklighetens belysning från minimala data och sedan använda den för att flexibelt återbelysa en neural 3D-scen.

Lära ett headset att läsa av rummet

Den första delen av ramverket är en modul för beräkningsbaserad optisk perception (COP), utformad för att avläsa belysning från en enda kameravy. I stället för att rekonstruera hela ljusfältet fokuserar COP på den dominerande ljuskällan: dess riktning och styrka. Ett mångskaligt neuralt nätverk skannar ingångsbilden efter fysiskt avslöjande ledtrådar—ljusa reflektioner, skugggradienter och skuggor—medan ett särskilt interpolationssteg korrigerar för det icke-linjära sätt som kameror komprimerar ljusstyrka på. Detta ger numeriska uppskattningar av ljusintensitet och riktning som bättre motsvarar verklig energifördelning i scenen. Ett andra steg, kallat den semantiska tolken, förfinar sedan dessa värden och producerar en kort textlik beskrivning av belysningen (till exempel att ljuset kommer ovanifrån och från höger). Denna kombination av siffror och ord gör uppskattningen mer stabil och lättare att använda i de följande stegen.

Måla om objekt med nytt ljus

Beväpnad med denna kompakta beskrivning av belysningen tar den andra modulen—generativ ljustransportsyntes (GLTS)—över. GLTS utgår från en befintlig 3D-neural representation av ett objekt eller en scen, renderad en gång under dess gamla, inbakade belysning. Vägledd av den härledda ljust riktning, intensitet och den textuella beskrivningen ”målar” ett generativt nätverk om denna vy så att högdagrar och skuggor matchar den nya miljön. För att hålla resultatet både realistiskt och specifikt för objektet blandar GLTS två typer av styrning: global kontroll från belysningsparametrarna och finare detaljer hämtade direkt från den observerade bilden. Genom en specialiserad träningsprocess som koncentrerar sig enbart på hur ett enskilt objekt reagerar på olika ljus lär sig modellen att flytta reflektioner och mjuka upp skuggkanter på fysikaliskt trovärdiga sätt i stället för att bara applicera ett generiskt stilfilter.

Bygga ett konsekvent 3D-ljusfält från många vyer

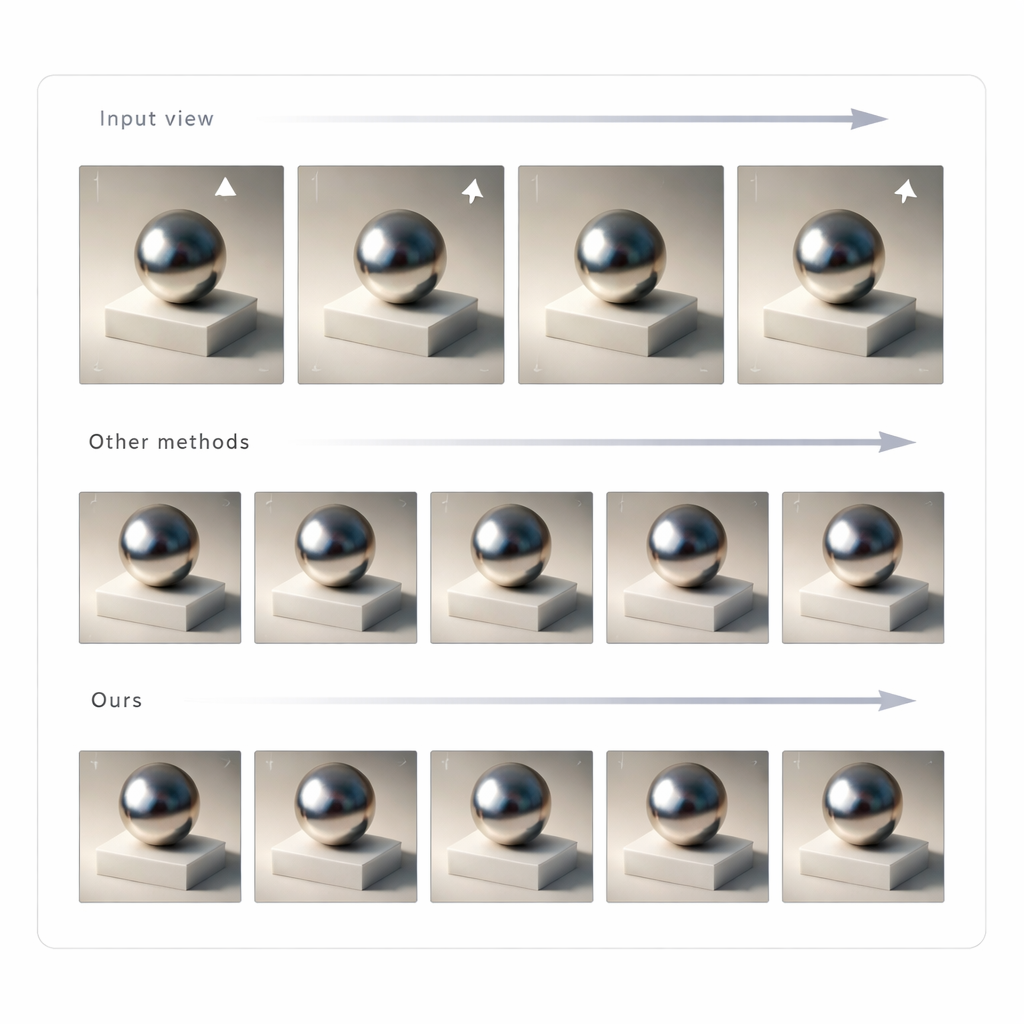

Att förändra en enskild bild räcker inte för övertygande mixed reality; belysningen måste förbli konsekvent när du rör på huvudet. För att uppnå detta använder författarna GLTS för att generera en uppsättning återbelysta bilder från många synvinklar och behandlar sedan dessa som målbilder för att återskapa 3D-scenen. En gemensam optimeringsprocess justerar samtidigt den neurala 3D-representationen och de virtuella kamerapositionerna så att rendering av den nya modellen återger alla syntetiserade vyer. Detta steg korrigerar subtila distorsioner introducerade av det generativa nätverket och producerar en sammanhängande 3D-resurs vars utseende förblir stabilt och trovärdigt från varje vinkel. Teamet testade sin metod mot flera moderna relighting-approacher och fann att den gav skarpare överensstämmelse med referensbilder och mer naturligt utseende skuggor och reflektioner, enligt både pixelnivå- och perceptionsbaserade mått.

Vad detta betyder för framtida headset

För icke-specialister är huvudpoängen att detta arbete visar hur framtida VR-, AR- och mixed-reality-enheter skulle kunna anpassa virtuellt innehåll till verklig belysning från bara en snabb blick genom headsetets kamera. I stället för arbetskrävande inspelningsupplägg eller att träna om skräddarsydda modeller för varje ny scen uppskattar systemet de viktigaste belysningsförhållandena, återgenererar hur scenen bör se ut under dessa förhållanden och bygger upp en konsekvent 3D-representation. Resultatet blir virtuella objekt vars ljusstyrka, glans och skuggor reagerar på din omgivning ungefär som riktiga objekt gör, vilket banar väg för mixed-reality-upplevelser som känns mindre som överlagrade grafiklager och mer som genuina tillägg till den fysiska världen.

Citering: Hong, X., Xie, J., Sheng, J. et al. Single-view neural illumination estimation and editing for dynamic light field display. Light Sci Appl 15, 147 (2026). https://doi.org/10.1038/s41377-026-02234-4

Nyckelord: belysning för mixed reality, neural ljusfält, relighting från en vy, virtuella verklighetsdisplayer, beräkningsbaserad bildbehandling