Clear Sky Science · ru

Копилот для хирургии RARP: визуально-языковая модель для робот-ассистированной радикальной простатэктомии

Более разумная помощь в операционной

Современные операции при раке простаты выполняют с помощью сложных роботов и камер, но хирурги по‑прежнему вынуждены принимать сложные решения, ориентироваться в быстро меняющихся видах и постоянно отвечать на вопросы студентов и персонала. В этой статье представлен искусственный интеллект — «копилот», который может смотреть потоковое видео операции и отвечать на устные вопросы на месте, подобно очень осведомленному ассистенту. Для пациентов это означает более безопасные и последовательные операции; для хирургов — перспективу, при которой экспертное руководство и обучение доступны в каждой операционной.

Цифровой помощник, который видит и говорит

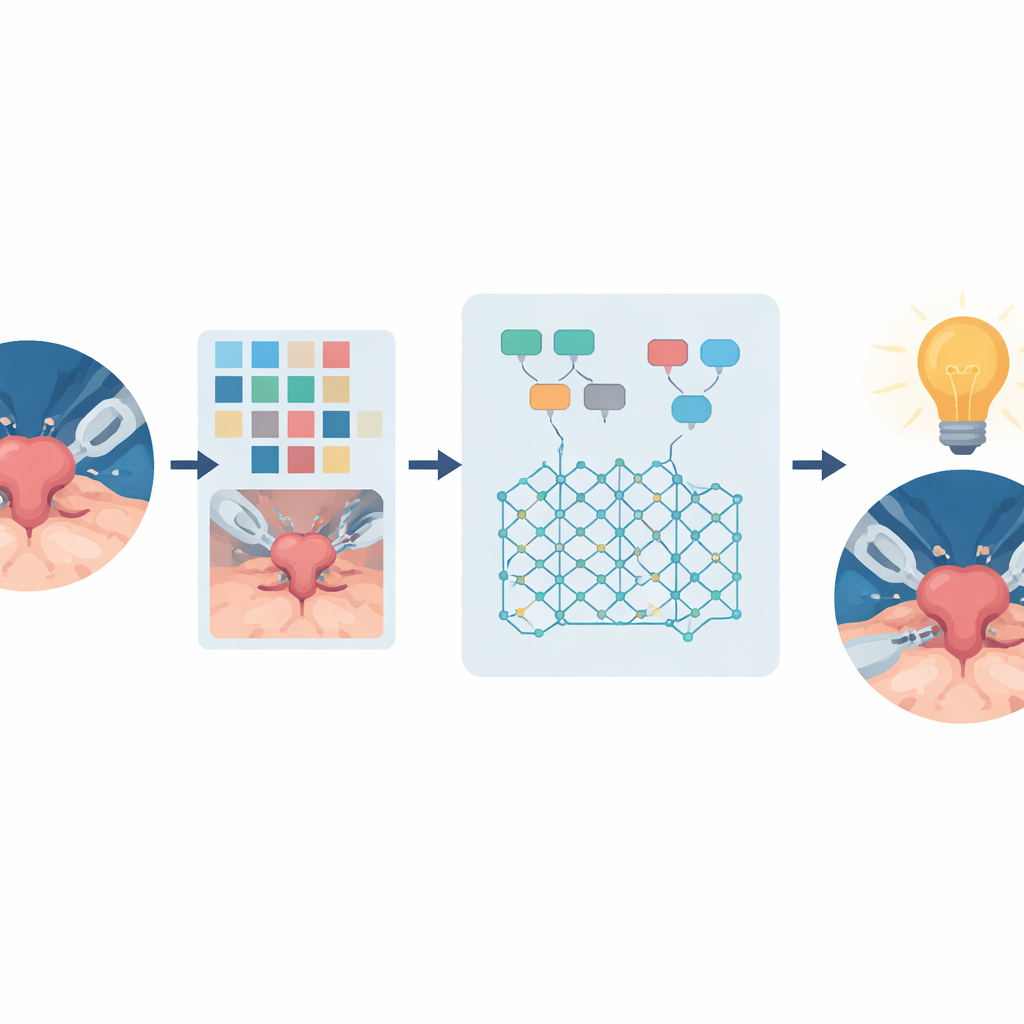

Исследователи создали Surgical RARP Copilot для конкретной операции — робот-ассистированной радикальной простатэктомии, стандартной процедуры для многих мужчин с локализованным раком простаты. При этой операции хирург с помощью робота удаляет предстательную железу через небольшие проколы, ориентируясь по высокоразрешающей камере внутри тела. Традиционные текстовые системы ИИ обрабатывают только текст и не могут интерпретировать то, что показывает хирургическая камера. Копилот же сочетает компьютерное зрение с крупной языковой моделью, что позволяет ему «видеть» операционное поле и генерировать ответы на естественном языке о том, что происходит, какие инструменты видны или какие шаги следует выполнить дальше.

Обучение копилота хирургическому опыту

Чтобы придать Копилоту содержательные хирургические знания, команда собрала специализированный тренировочный набор данных, а не полагалась на общедоступные интернет‑изображения. Они собрали почти 20 000 размеченных кадров из записанных простатэктомий, отметив положения инструментов, органов и текущий этап процедуры. Также добавили приблизительную информацию о глубине, чтобы система могла различать, какие объекты находятся впереди или контактируют друг с другом. С помощью правил, разработанных экспертами, эти метки были преобразованы в детальные текстовые подписи, описывающие, что показано на каждом кадре и на каком этапе операции он сделан. Затем крупные языковые модели были подсказаны в голосах разных «персон» — от старших хирургов до любознательных детей — чтобы сгенерировать более миллиона пар вопрос–ответ на основе этих подписей. Отдельная модель проверяла эти пары на логическую согласованность, а некорректные примеры отфильтровывались перед обучением.

Как хорошо работает копилот

После обучения Копилот проверяли несколькими способами. На отложенном наборе синтетических пар вопрос–ответ дообучение увеличило долю хотя бы частично правильных ответов примерно с 61% до 83%, а полностью правильных — с 0% до 59%. Затем рецензенты‑люди задали 650 вопросов по prerecorded хирургическим изображениям; почти семь из десяти ответов были признаны полностью правильными. Система также справлялась с классическими задачами компьютерного зрения без дополнительного дообучения: она определяла, на каком этапе простатэктомии находится кадр, с точностью 82% и распознавала хирургические инструменты с F1‑мерой 94%, одновременно оценивая, сколько осталось времени до завершения операции. Эти результаты показывают, что единая универсальная модель может соперничать со специализированными инструментами в нескольких задачах и при этом вести открытый диалог.

Внедрение ИИ в живую операцию

Самая впечатляющая демонстрация прошла в реальной операционной. Копилот развернули на мощном edge‑компьютере, напрямую подключенном к видеопотоку робота. Во время живой простатэктомии, выполненной на другой платформе, чем та, что использовалась для обучения, аудитория из хирургов и инженеров отправила 276 вопросов через смартфоны. После фильтрации нерелевантных и дублирующих запросов эксперты посчитали, что Копилот правильно ответил примерно на 77% оставшихся вопросов — сопоставимо с его офлайн‑результатами. Система начинала отвечать примерно через полсекунды и генерировала текст достаточно быстро, чтобы ощущаться интерактивно, при этом применяя фильтры безопасности и действуя консервативно в условиях неуверенности.

Что это означает для будущей хирургии

Для непрофессионального читателя ключевая мысль такова: ИИ теперь способен наблюдать деликатную онкологическую операцию в реальном времени и давать полезные, зависящие от контекста ответы о том, что происходит и что следует делать дальше. Хотя нынешний Копилот ограничен одним типом операции, опирается на отдельные снимки, а не на полную видеопамять, и пока не имеет доступа к полным медицинским записям, он доказывает, что мультимодальный ИИ можно безопасно вводить в операционную. По мере расширения подобных систем на другие процедуры, подключения к более полным данным о пациенте и тщательной оценки их клинического воздействия они могут поддерживать обучение, улучшать коммуникацию в команде и в конечном счете делать сложную хирургию более безопасной и прозрачной.

Цитирование: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Ключевые слова: роботизированная хирургия, рак предстательной железы, хирургический ИИ, визуально-языковая модель, помощь в операционной