Clear Sky Science · ru

Систематическая оценка и рекомендации по использованию Segment Anything Model в анализе хирургического видео

Почему интеллектуальные видеосистемы важны в операционной

Современная хирургия всё в большей степени опирается на видео: крошечные камеры заглядывают внутрь тела, а хирурги управляют деликатными инструментами, глядя на экран. Превращение этих богатых, но шумных видеопотоков в ясные, размеченные карты инструментов и тканей может сделать операции безопаснее, обучение — эффективнее, а будущую роботизированную помощь — надёжнее. В этом исследовании берут мощную универсальную систему машинного зрения, изначально обученную на повседневных видео, и задают простой, но важный вопрос: может ли она «видеть» внутри человеческого тела достаточно хорошо, чтобы быть полезной в реальной хирургии — без полного переобучения на дорогих медицинских данных?

Гибкий инструмент зрения, созданный для любых сцен

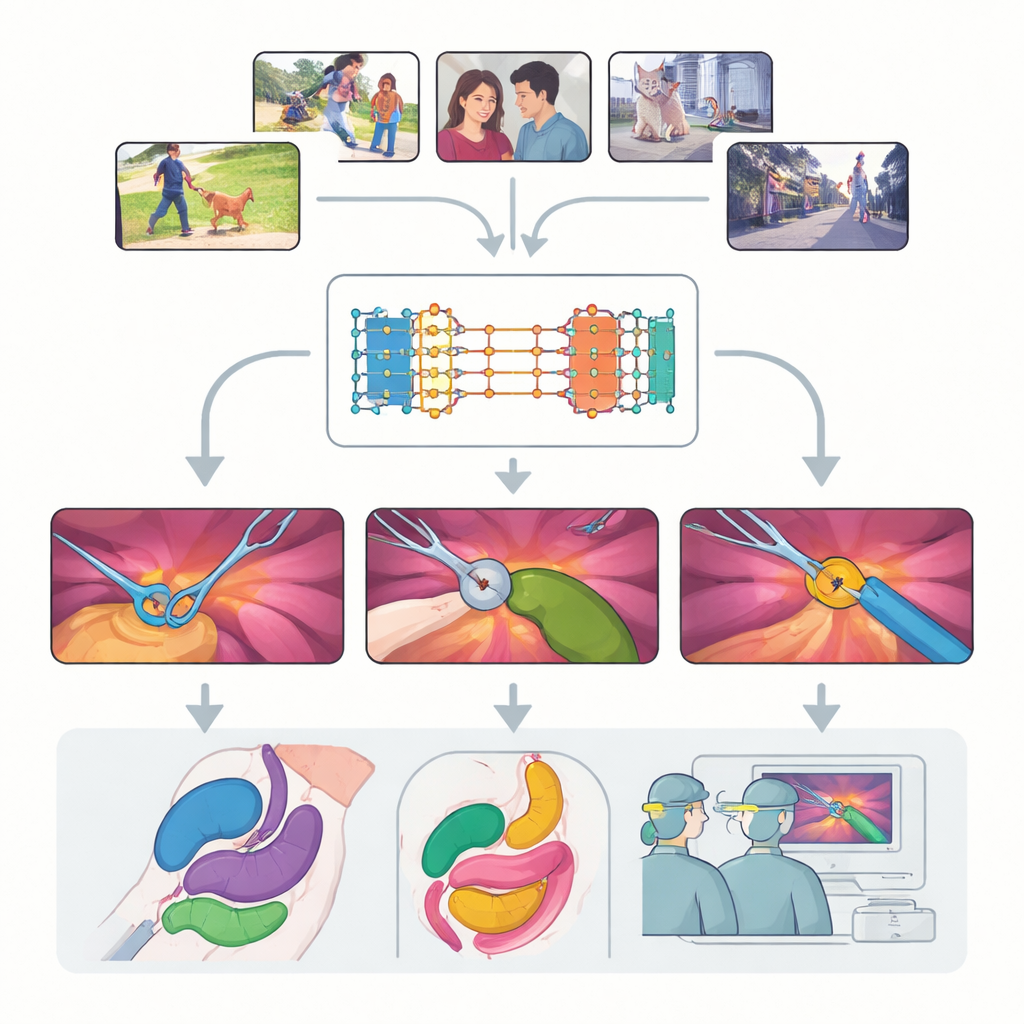

Работа сосредоточена на Segment Anything Model 2 (SAM2) — крупной системе ИИ, предназначенной для выделения объектов в кадре, когда ей дают подсказку или «промпт» о том, что искать. В отличие от традиционных моделей, которые изучают фиксированные категории, SAM2 не привязана к классам: ей безразлично, собака это, машина или хирургический захват, если пользователь указывает на объект точкой, рамкой или примерной маской. Важное новшество в SAM2 — модуль памяти, который запоминает, как объект выглядел в предыдущих кадрах, и использует эту память, чтобы отслеживать его во времени. Это делает SAM2 особенно перспективной для хирургического видео, где инструменты появляются и исчезают из поля зрения, а ткани постоянно деформируются.

Тестирование модели на разных операциях

Авторы проводят масштабную систематическую оценку SAM2 на девяти различных наборах данных, охватывающих семнадцать типов процедур — от лапароскопической холецистэктомии до роботизированной простатэктомии и эндоскопии. Они рассматривают три основные задачи: отслеживание инструментов, сегментация нескольких органов и анализ сцен, где смешиваются инструменты и ткани. Для каждой задачи тестируются разные способы подсказок — одиночные точки, множественные точки, ограничивающие рамки и полные маски — и изучается, как часто эти подсказки нужно обновлять по ходу видео. Также сравнивают модель «из коробки» с несколькими способами лёгкого дообучения на хирургических изображениях, чтобы понять, насколько можно повысить качество без больших новых датасетов.

Что работает лучше внутри тела

В целом SAM2 показывает себя неожиданно хорошо в этой непривычной среде. Без хирургического дообучения она уже конкурентно сегментирует инструменты и многие органы по сравнению со специализированными медицинскими моделями, особенно если получать богатые подсказки, такие как рамки или маски. Периодическое «реинициализирование» подсказок каждые ~30 кадров — фактически напоминание системе о том, где что находится — значительно улучшает отслеживание в длинных сложных клипах. Когда исследователи дообучают только отдельные части SAM2, например модуль, превращающий подсказки в маски, точность на мультиорганных сценах резко растёт, при этом требования к обучению остаются умеренными. Напротив, попытки подстроить весь энкодер изображений при ограниченных хирургических данных могут ухудшать результаты, что показывает: большая часть общих визуальных знаний SAM2 лучше сохраняется без изменений.

Ограничения в шумных и быстро меняющихся сценах

Исследование также выявляет явные слабые места. SAM2 испытывает трудности при узком угле обзора камеры, в шумных или плохо освещённых кадрах, а также когда ткани лишены чётких границ, как это бывает в некоторых эндоскопических процедурах. Тонкие ветвящиеся структуры, такие как кровеносные сосуды и протоки, сложно отделить, когда они перекрываются или имеют схожий контур. Использование видеопамяти не всегда помогает: в сильно динамичных сценах с резким движением камеры временные подсказки могут вводить модель в заблуждение вместо того, чтобы стабилизировать её. Эти результаты подчеркивают, что хотя универсальная фундаментальная модель может многое, некоторые реальности хирургии всё ещё требуют предметно‑специфической настройки и лучшей обработки движения и изменений внешнего вида.

Рекомендации для будущих умных хирургических систем

Из этого обширного тестирования авторы выводят практические советы для исследователей и клиницистов, желающих применять SAM2 в хирургических проектах. Они рекомендуют начинать с масок или рамок в качестве подсказок и простого дообучения, ориентированного на декодер масок, добавлять периодическое обновление подсказок для длинных видеозаписей и переходить к более сложному обучению с учётом видео только когда сцены относительно стабильны. Они показывают, что даже разреженно размеченные клипы — когда аннотированы лишь отдельные кадры — могут быть достаточны для эффективной адаптации модели. Проще говоря, вывод обнадёживает: одна широко обученная модель зрения может решать многие задачи хирургической сегментации, значительно уменьшая необходимость создавать отдельный инструмент для каждой процедуры. При продуманном использовании подсказок и лёгкой кастомизации такие системы, как SAM2, могут стать мощными строительными блоками для следующего поколения систем навигации, автоматизации и обучения в хирургии.

Цитирование: Yuan, C., Jiang, J., Yang, K. et al. Systematic evaluation and guidelines for segment anything model in surgical video analysis. npj Digit. Surg. 1, 2 (2026). https://doi.org/10.1038/s44484-025-00002-2

Ключевые слова: анализ хирургического видео, сегментация изображений, фундаментальные модели, компьютерно‑ассистированная хирургия, медицинский ИИ