Clear Sky Science · ru

Обнаружение стигматизирующей лексики в клинических записях с помощью больших языковых моделей для ухода при зависимости

Почему слова в вашей медицинской карте имеют значение

По мере того как всё больше пациентов получают онлайн‑доступ к своим медицинским записям, язык, которым пользуются клиницисты, перестаёт быть скрытым в больничных компьютерах — он становится видимым для тех, о ком в нём говорится. Для людей с зависимостью одна фраза вроде «наркоман» может незаметно укреплять стыд, подрывать доверие и даже влиять на оказываемую помощь. В этом исследовании поставлен актуальный вопрос: могут ли современные методы искусственного интеллекта помочь больницам обнаруживать и уменьшать использование стигматизирующей лексики в клинических записях до того, как это навредит пациентам?

Вредные ярлыки, скрытые в повседневных записях

Стигма в здравоохранении проявляется не только в зрительном контакте или тоне голоса; она также вписана в письменные записи. Электронные медицинские карты содержат миллионы заметок, которые сопровождают пациентов по клиникам и больницам. Термины вроде «злоупотребление алкоголем» или «поведение в поисках наркотиков» могут формировать отношение будущих врачей к человеку задолго после неотложного визита или госпитализации. Исследователи сосредоточились на записях из отделений интенсивной терапии о пациентах с проблемами употребления веществ, где ставки велики, а документация обширна. Они опирались на национальные рекомендации, поощряющие уважительную, ориентированную на человека лексику, например «человек с расстройством, связанным с употреблением веществ» вместо «наркоман», и использовали эти принципы для создания большой размеченной выборки заметок как стигматизирующих или нет.

Обучение ИИ читать между строк

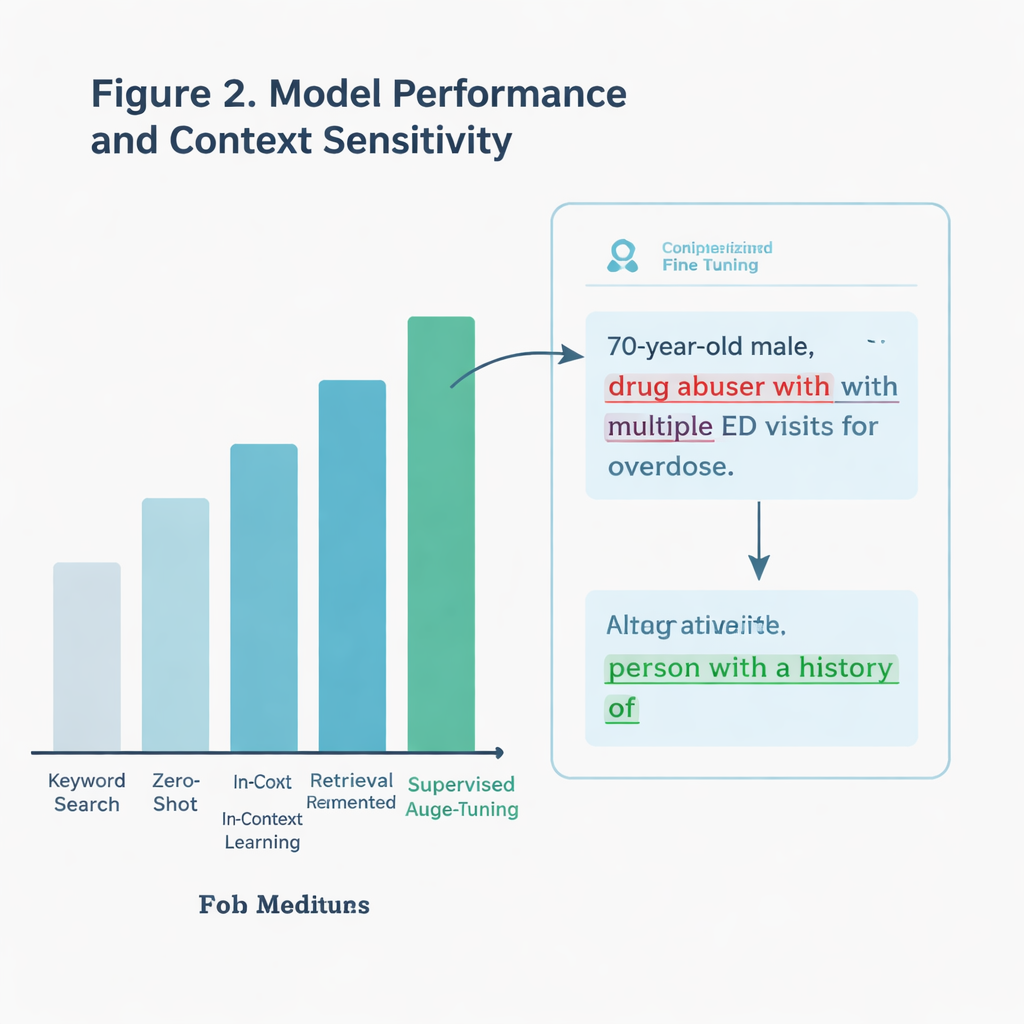

Вместо того чтобы просто искать «плохие» слова, команда хотела получить систему ИИ, способную понимать контекст. Например, в заметке может быть приведена цитата пациента: «я был пьян», что не то же самое, что когда клиницист навешивает такой ярлык. Авторы сравнили несколько подходов, все основанные на большой языковой модели (вид ИИ, который обрабатывает и генерирует текст). Один базовый метод искал только определённые ключевые слова из рекомендаций. Более продвинутые подходы просили ИИ оценивать каждую заметку напрямую — либо без дополнительных примеров, либо с подсказками, основанными на коммуникационных рекомендациях, либо после специальной дообучения, или «тонкой настройки», на тысячах размеченных заметок из ОИТ.

Что лучше всего сработало в реальных условиях

Победителем стала модель с тонкой настройкой. На отложенной тестовой выборке из более чем 11 000 заметок она правильно выявляла стигматизирующую лексику примерно в 97 % случаев, значительно превосходя простой поиск по ключевым словам. Она также лучше показала себя на особенно сложной подвыборке заметок, содержащих потенциально заряженные термины, которые не всегда использовались вредоносно. Модель могла различать действительно осуждающие выражения и нейтральные или цитируемые употребления, на которых грубый поиск ошибался бы. Когда команда проверила систему на заметках из другой медицинской системы — почти 300 000 записей из ОИТ, написанных в другом штате — она всё равно превзошла подход с ключевыми словами, хотя в этой реальной выборке стигматизирующая лексика встречалась редко.

Поиск новых проблемных фраз, которые упускали клиницисты

Исследователи пошли дальше и попросили ИИ объяснить, почему он пометил те или иные заметки. Специалист по зависимостям затем проверил эти объяснения. В десятках случаев модели выделяли действительно стигматизирующие выражения, которые человеческие аннотаторы изначально пропустили, включая фразы, не перечисленные в существующих рекомендациях. Примеры включали описания вроде «поведение в поисках наркотиков» или случайные упоминания «алкогольного цирроза», которые тонко возлагают вину на человека, а не на болезнь. Это указывает на то, что хорошо спроектированные инструменты ИИ могут не только обеспечивать соблюдение текущих лучших практик, но и помогать расширять представление о том, как выглядит вредная лексика по мере эволюции клинического письма.

От исследовательского инструмента к помощнику у постели больного

В исследовании также оценивали практические вопросы. Поиск по ключевым словам очень быстрый, но поверхностный. Самая точная модель ИИ требовала нескольких часов обучения на мощных графических процессорах, однако после обучения она могла проверять заметки за несколько секунд каждая — медленнее, чем поисковая система, но приемлемо для фонового помощника в больничной системе. Другой, менее кастомизированный подход, опирающийся только на тщательно составленные подсказки, показывал разумные результаты без дополнительного обучения, что намекает на более лёгкие варианты для клиник с ограниченными техническими ресурсами. В совокупности эти находки указывают на системы, которые могут в реальном времени помечать рискованную формулировку и предлагать более уважительные альтернативы по мере того, как клиницист печатает.

Шаг к более уважительному уходу

Для неспециалиста главный вывод прост: слова в вашей карте — это не только технический жаргон; они формируют то, как к вам относятся. Эта работа показывает, что большие языковые модели могут надёжно выявлять многие формы стигматизирующей лексики, связанной с зависимостью, в записях интенсивной терапии, даже когда проблема тонкая. Хотя ни одна система не идеальна, такие инструменты могут выступать в роли постоянно работающих редакторов, подталкивая клиницистов к языку, признающему людей большими, чем их диагнозы. В долгосрочной перспективе такой сдвиг — от обвинения к уважению — может быть так же важен для исцеления, как любое лекарство или устройство.

Цитирование: Sethi, R., Caskey, J., Gao, Y. et al. Detecting stigmatizing language in clinical notes with large language models for addiction care. npj Health Syst. 3, 15 (2026). https://doi.org/10.1038/s44401-026-00069-0

Ключевые слова: стигма зависимости, клинические записи, большие языковые модели, электронные медицинские карты, язык, ориентированный на человека