Clear Sky Science · ru

Объяснимая многоуровневая рамочная модель атрибутивного рассуждения для обнаружения фейковых новостей

Почему распознавать фейковые новости становится сложнее

Каждый день через социальные сети проходят миллионы публикаций, сочетающих слова и изображения. Часть из них безобидна, часть — правдива, а часть — тщательно срежиссованные фальшивки, созданные, чтобы привлечь внимание, разжечь эмоции или повлиять на мнение. По мере того как инструменты редактирования изображений и генераторы на базе ИИ становятся дешевле и доступнее, фейки обретают большую полировку и опасность. В этой работе предлагается новый способ заглянуть внутрь систем обнаружения фейков, чтобы понять не только то, вероятен ли пост как ложный, но и почему.

Как фейковые новости обманывают наши глаза и разум

Создатели фальшивок пользуются тем, как люди быстро просматривают заголовки и изображения. Они могут подделывать или изменять фото, вплетать частично правдивые детали в невозможную историю, сшивать фрагменты из разных событий или смешивать места и временные рамки, которые к друг другу не относятся. Один пост о срочном событии может показать эффектную картинку из другого инцидента несколько лет назад, а убедительная фотография может быть полностью сгенерирована ИИ. Традиционные системы обнаружения обычно относятся ко всем фейкам одинаково и упаковывают текст и изображение в одну слитую «суповую» характеристику. Такой подход может давать приемлемые результаты, но ведёт себя как чёрный ящик: журналистам, платформам и обычным пользователям сложно понять конкретные подсказки, которые вызвали тревогу.

Новый способ задать вопрос: «Почему это фейк?»

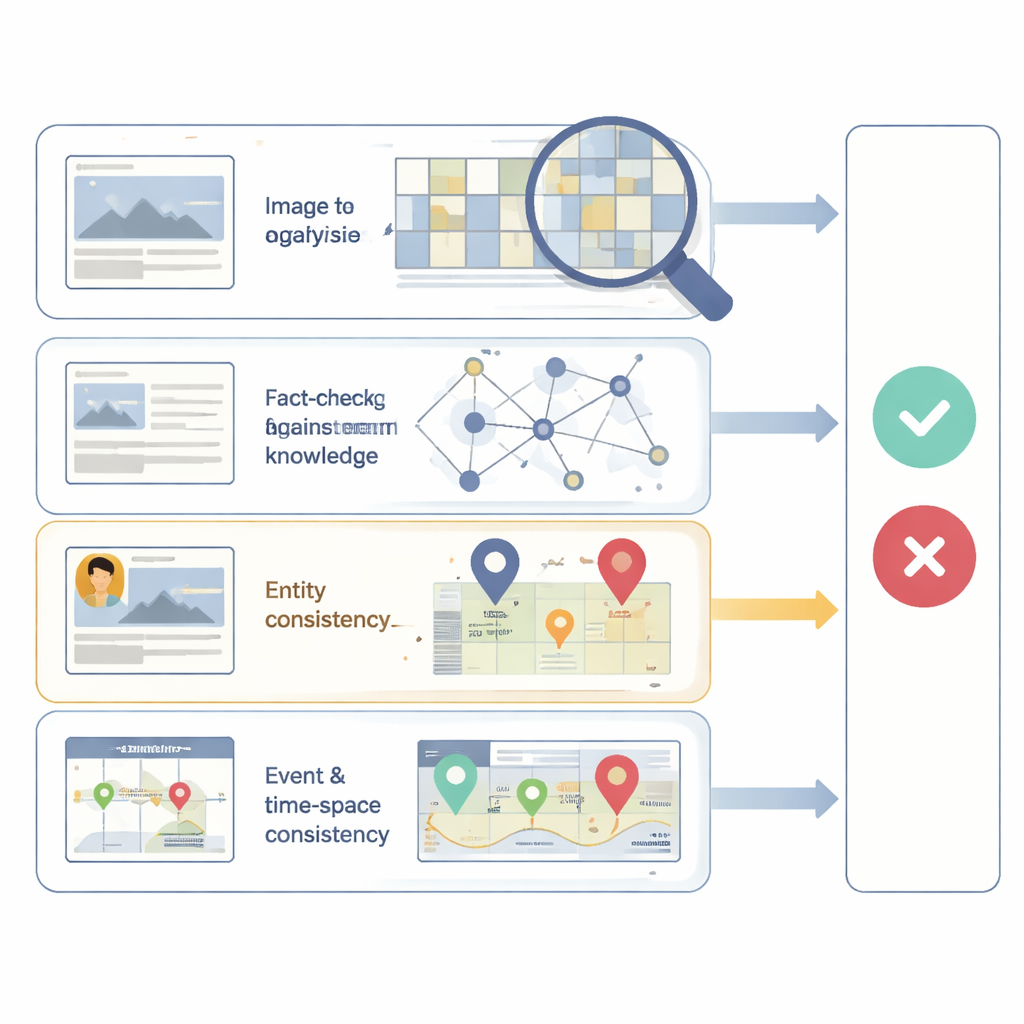

Авторы предлагают объяснимую рамочную модель EMAR‑FND, которая рассматривает новостные посты с четырёх разных точек зрения, каждая связана с распространённым способом создания фальшивок. Во‑первых, она проверяет, не выдают ли изображение признаки правки или синтетической генерации, анализируя тонкие шумовые паттерны на уровне камеры, которые меняются при изменении снимка. Во‑вторых, она сверяет факты истории с надёжными внешними знаниями, такими как известные связи между людьми, местами и событиями. В‑третьих, модель проверяет, соответствуют ли ключевые сущности в тексте — например, публичная фигура или город — тому, что видно на сопроводительном изображении. В‑четвёртых, она оценивает, согласуется ли описанное событие во времени и пространстве, например выявляя несоответствие между заявленным местом и визуальными подсказками на фото либо между сообщённой временной последовательностью и другими свидетельствами.

Сбор улик с разных сторон

Каждая из этих четырёх проверок реализована в отдельном модуле рассуждения, который выносит частичное суждение о том, насколько доверителен конкретный аспект. Один модуль концентрируется на визуальной подделке; другой опирается на внешние графы знаний; третий строит богатую сеть связей между словами, объектами на изображении и извлечёнными событиями; четвёртый сопоставляет пост с сопутствующими доказательствами во времени и пространстве. Вместо того чтобы скрывать эти сигналы в едином слитом представлении, EMAR‑FND сохраняет их вклад раздельно и затем комбинирует через финальный шаг принятия решения, который может учитывать, какое значение имеет каждая точка зрения для конкретного случая. В результате получается не только итоговый балл «правда или ложь», но и атрибуция, показывающая, например, что пост помечен главным образом потому, что изображение выглядит подделанным, или потому, что описанное событие не соответствует известным фактам.

Тестирование системы в реальных условиях

Чтобы оценить эффективность подхода, исследователи применили EMAR‑FND к двум открытым коллекциям реальных и фейковых новостных постов, содержащих как текст, так и изображения. На этих наборах данных их метод превзошёл несколько сильных существующих систем, показав более высокую точность и лучший баланс между обнаружением фейков и избеганием ложных срабатываний. При анализе кластеризации постов внутри модели реальные новости, как правило, образовывали плотные и согласованные группы, тогда как фейки были более рассредоточены — что отражает разнообразие приёмов, которыми пользуются фальсификаторы. Атрибутивные выводы также оказались полезны в сложных реальных примерах: посты, где текст и изображение по‑первому выглядели согласованными, раскрывались как фальшивки либо потому, что изображение содержало скрытые следы манипуляции, либо потому, что внешние знания противоречили заявленным фактам.

Что это значит для обычных читателей

Проще говоря, исследование показывает, что возможно построить детекторы фейков, которые ведут себя не как прорицатели, а как вдумчивые следователи. Вместо сухого ответа «да» или «нет» EMAR‑FND подчёркивает, какая часть поста вызывает подозрение: изображение, факты, упомянутые люди или само событие. Такой тип объяснений помогает факт‑чекингу, платформам и читателям доверять решениям системы и учиться распознавать распространённые схемы обмана. По мере дальнейшей эволюции фейков инструменты, которые одновременно обнаруживают и объясняют манипуляцию, будут иметь решающее значение для поддержания здоровья и прозрачности онлайн‑информационной экосистемы.

Цитирование: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Ключевые слова: обнаружение фейковых новостей, мультимодальная дезинформация, объяснимая ИИ, целостность социальных сетей, анализ подделки изображений