Clear Sky Science · ru

DeepKoopFormer: архитектура на основе трансформера с улучшением по Коупману для прогнозирования временных рядов

Почему важны более умные прогнозы

От погодного и энергетического планирования до финансовых рынков — многие важные решения зависят от предсказания того, как будут меняться явления во времени. Эти «временные ряды» — потоки измерений, таких как скорость ветра, выработка электроэнергии или курс криптовалюты — становятся длиннее, шумнее и сложнее. Современные инструменты ИИ, называемые трансформерами, способны обрабатывать такие данные, но часто остаются «черными ящиками» и могут становиться неустойчивыми при прогнозировании на дальние горизонты. В этой статье представлена DeepKoopFormer — метод прогнозирования, который сохраняет предсказательную мощь трансформеров, добавляя математическую структуру, делающую их поведение более стабильным, интерпретируемым и надежным на длинных промежутках времени.

Новый способ уравновесить мощные модели

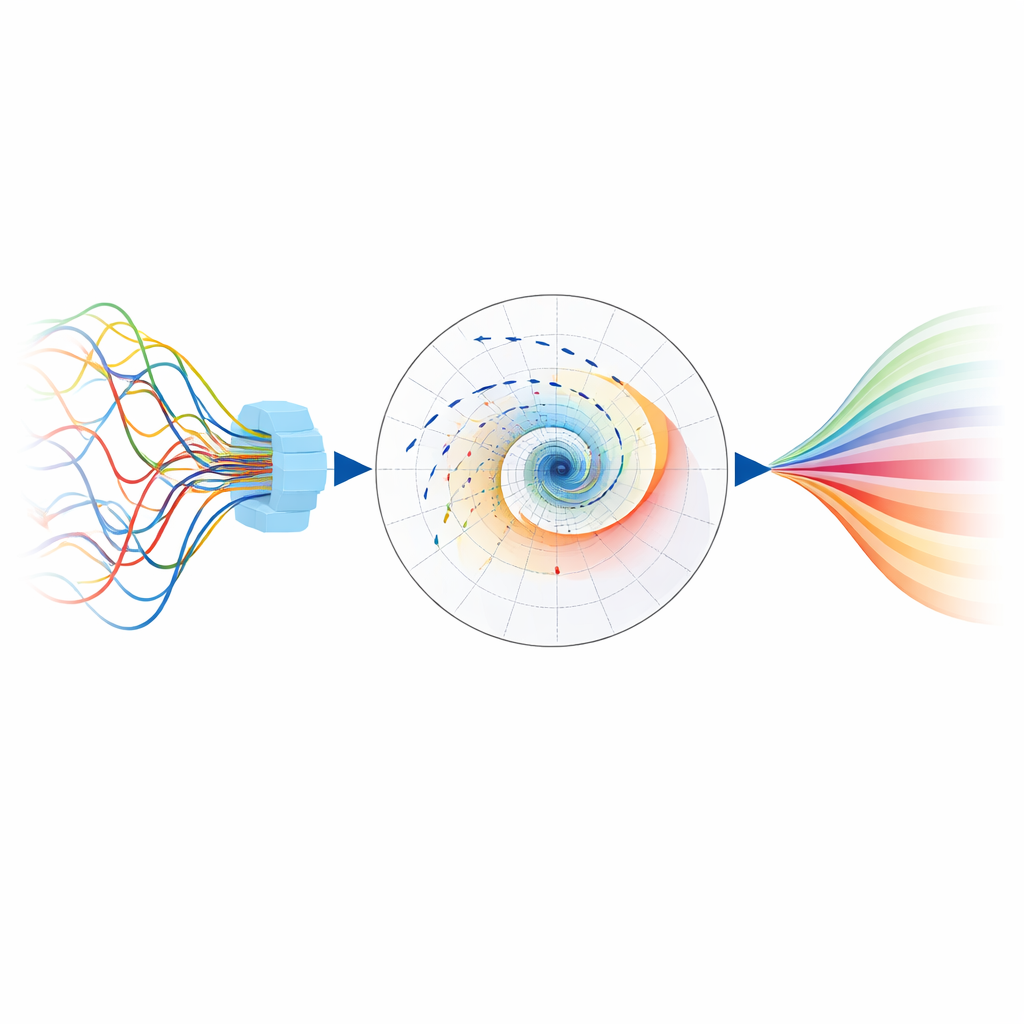

Авторы исходят из привычной идеи в современном ИИ: использовать трансформер для преобразования сырых временных рядов в богатое внутреннее представление. DeepKoopFormer затем вставляет тщательно спроектированный промежуточный слой, вдохновленный понятием из теории динамических систем — оператором Коупмана. Вместо того чтобы позволять модели развиваться сложным полностью нелинейным образом, этот средний слой продвигает внутреннее состояние с помощью простой линейной трансформации в скрытом пространстве. Ключевое свойство — эта трансформация сконструирована так, чтобы её воздействие со временем постепенно уменьшалось, а не росло без контроля, что математически гарантирует отсутствие взрывной или чрезмерно осциллирующей динамики в долгосрочных прогнозах.

Как модель сохраняет равновесие

Чтобы обеспечить такую стабильность, DeepKoopFormer накладывает ограничения на линейный шаг несколькими способами. Преобразование факторизуется на три части: две ортогональные матрицы (сохраняющие длины и углы), завернутые вокруг диагональной матрицы масштабных коэффициентов, все элементы которой принуждаются быть меньше единицы. Это означает, что скрытое состояние при обновлении мягко сжимается, а не усиливается. Второй компонент — регуляризация по Ляпунову — добавляет штраф в процессе обучения всякий раз, когда «энергия» скрытого состояния растет от шага к шагу. Вместе эти механизмы гарантируют спокойную и корректную внутреннюю динамику, в то время как трансформер до этого шага и линейный декодер после него остаются свободными и выразительными. Вместимость модели для обучения сложных закономерностей и её стабильность контролируются отдельными настройками, что позволяет подстраивать одно свойство, не нарушая другое.

Испытание метода

Исследователи оценивали DeepKoopFormer на контролируемых и реальных задачах. Сначала они тестировали его на классических хаотических системах, таких как аттрактор Лоренца, где небольшие возмущения приводят к резко различающимся будущим, и добавляли случайный шум, имитирующий реальные измерения. При разных архитектурах трансформеров версии с улучшением по Коупману точно отслеживали истинные траектории, сохраняя при этом стабильное внутреннее поведение на множестве короткосрочных прогнозов. Затем авторы перешли к требовательным реальным наборам данных: климатические проекции и реанализ над Германией (скорость ветра и давление на поверхности), цены на криптовалюты и выработка электроэнергии из нескольких источников в Испании. В этих случаях варианты DeepKoopFormer сравнивали со стандартной сетью долгой краткосрочной памяти (LSTM) и более простыми линейными базовыми моделями при различных длинах входного окна, горизонтах прогнозирования и размерах модели.

Что показали эксперименты

По задачам в области климата, финансов и энергетики модели трансформеров с дополнением Коупмана в целом достигают меньшей ошибки предсказания и более стабильного поведения, чем базовая LSTM, особенно при прогнозировании на множество шагов вперёд или при работе с высокоразмерными данными. Для задач по ветру и давлению над Германией и для выработки электроэнергии версии DeepKoopFormer на основе PatchTST и Informer обычно показывают лучшие результаты, надежно улавливая как плавные тренды, так и быстрые флуктуации. В некоторых специальных случаях, когда лежащие в основе закономерности почти полностью линейны, очень простая линейная модель всё ещё может выиграть по точности на тесте, что подчёркивает, что нет универсально оптимальной модели. Однако дизайны, основанные на операторе Коупмана, последовательно демонстрируют более плавные паттерны ошибок с ростом горизонта прогнозирования, что указывает на лучшее управление долгосрочной неопределённостью и меньшую склонность к переобучению на странностях тренировочных данных.

Почему этот подход перспективен

В результате DeepKoopFormer показывает, что возможно объединить гибкость глубокого обучения с гарантиями классической теории динамических систем. Вставляя структурированный, стабильный линейный шаг в иначе стандартную конвейерную схему трансформера, авторы получают прогнозы, которые точны, устойчивы к шуму и математически более доступны для анализа. Для практиков, полагающихся на долгосрочные прогнозы в климатологии, энергетике или финансах — где стабильность и интерпретируемость так же важны, как и чистая точность — эта схема предлагает способ немного больше доверять мощным нейронным моделям и лучше понимать, как и почему их предсказания ведут себя во времени.

Цитирование: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Ключевые слова: прогнозирование временных рядов, модели трансформеров, оператор Коупмана, устойчивая динамика, данные климата и энергетики