Clear Sky Science · ru

Вариационная схема для адаптивности на основе невязки в нейронных решателях PDE и обучении операторов

Более разумный ИИ для сложных уравнений

Многие современные научные прорывы — от климатического моделирования до проектирования новых материалов — зависят от решения сложных уравнений, описывающих поток жидкости, распространение волн или движение химических фронтов. Нейросети в последнее время стали мощными инструментами для решения таких уравнений, но они часто испытывают трудности, когда физика становится сложной: резкие скачки, мелкомасштабные структуры и долгосрочные прогнозы могут привести к сбоям. В этой статье предложен систематический подход, который заставляет эти ИИ‑решатели сосредоточивать усилия именно там, где они испытывают наибольшие затруднения, делая их быстрее и точнее.

Почему нейросетям нужна наводка

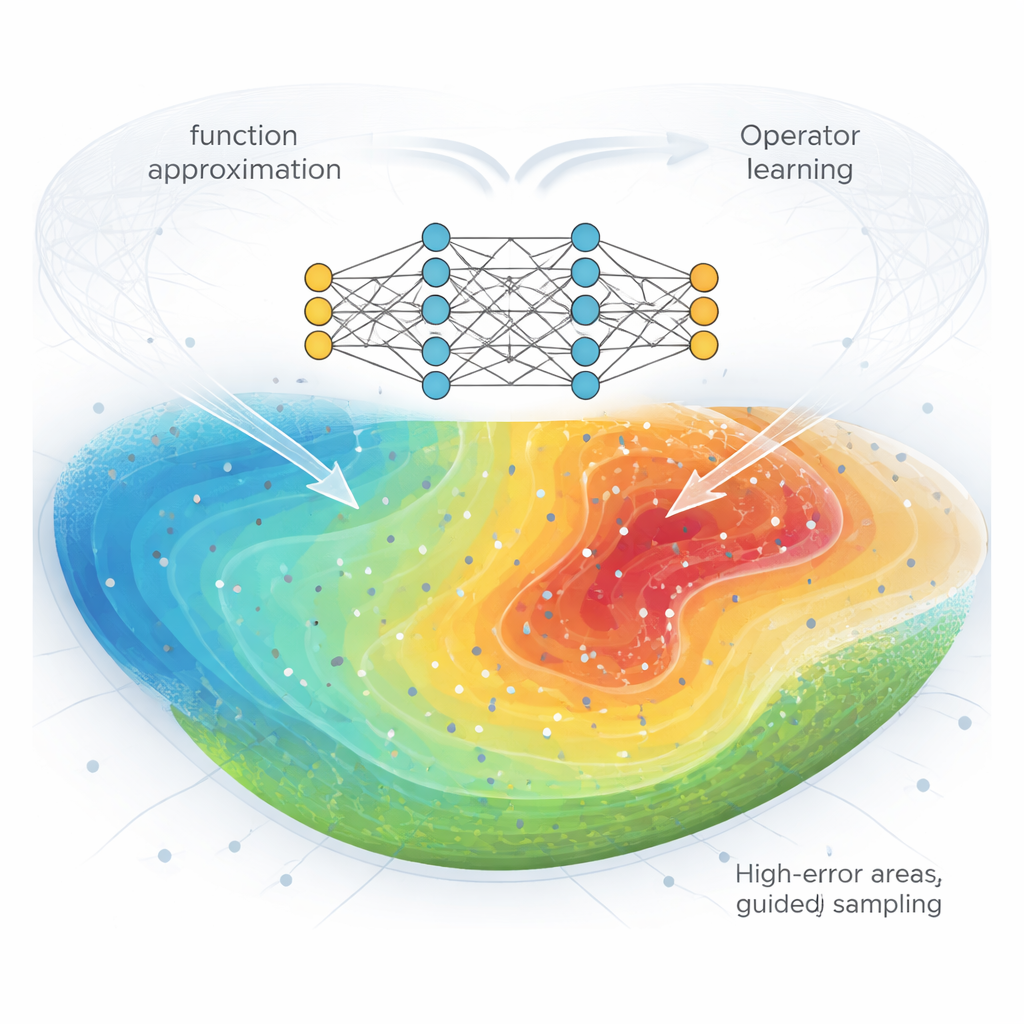

В научном машинном обучении нейросети обучаются либо воспроизводить решение одного уравнения (как в physics‑informed neural networks, PINN), либо изучать отображение от входов к решениям (известное как обучение операторов). В обоих случаях сеть оценивают по «невязке» — величине того, насколько она нарушает основное уравнение в каждой точке пространства и времени. Стандартное обучение относится ко всем точкам одинаково, минимизируя среднюю ошибку. Это работает для простых задач, но для уравнений с резкими градиентами, движущимися фронтами или локализованными структурами низкое среднее может скрывать серьёзные ошибки в критических областях. Исследователи предлагали эмпирические правила, которые размещают больше обучающих точек там, где невязка велика, но до сих пор эти правила оставались эвристическими и слабо обоснованными.

Единый рецепт для адаптивного внимания

Авторы развивают вариационную схему, которая превращает эти эвристики в принципиальный рецепт. Ключевая идея — рассматривать выбор выборки и взвешивания как выбор распределения вероятностей по пространству (и по обучающим примерам), которому сеть должна уделять наибольшее внимание. Они вводят семейство «потенциальных» функций, которые преобразуют невязку в новую целевую функцию. Разные варианты потенциала соответствуют разным приоритетам: экспоненциальный потенциал заставляет сеть сокращать свою наихудшую ошибку, в то время как квадратичный потенциал делает акцент на уменьшении разброса, или дисперсии, ошибки по области. Математически оптимизация этих преобразованных целей естественно приводит к тому, что в регионах с высокой текущей невязкой берутся образцы чаще. Полученный метод, названный вариационное внимание на основе невязки (vRBA), обобщает многие существующие адаптивные схемы и даёт понятный путь для разработки новых.

Расширение на обучение полных физических отображений

Современные ИИ‑решатели всё чаще ставят целью изучить не одно решение, а целый оператор: отображение от входов, таких как начальные условия или внешние источники, к полным пространственно‑временным полям. Это цель архитектур нейронных операторов, таких как DeepONet, Fourier Neural Operators (FNO) и условные по времени U‑Nets. Здесь задача усложняется: имеется вариация между разными входными функциями и вариация по пространству и времени внутри каждого примера. Авторы адаптируют свою схему к этому произведённому (product) случаю, комбинируя два уровня адаптивности. Сначала они перенастраивают веса пространственных точек внутри каждого примера, чтобы области с высокой невязкой имели большее значение. Затем они используют накопленные невязки, чтобы предпочтительно повторно выбирать целые обучающие примеры, которые труднее всего изучать. Эта гибридная схема может быть интегрирована прямо в популярные модели обучения операторов без переработки их архитектуры.

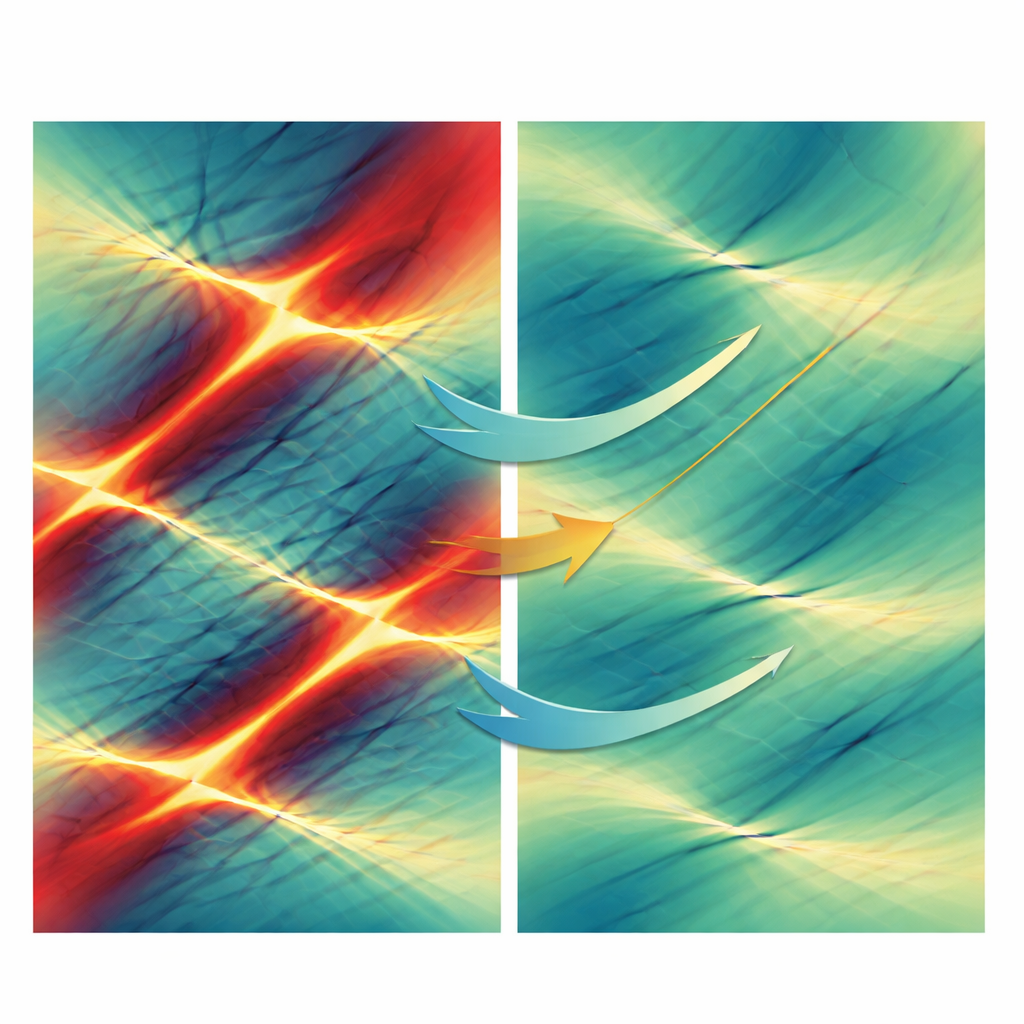

Более чёткие детали, медленнее растущая ошибка

На множестве бенчмарков подход vRBA последовательно превосходит традиционное обучение. Для PINN команда тестирует классические нелинейные уравнения, такие как Аллена–Кэна, Бюргерса и Кортевега–де Вриса. Некоторые из этих задач известны как такие, что стандартные PINN терпят неудачу из‑за резких внутренних слоёв или взаимодействующих волновых импульсов. С vRBA те же сети сходятся быстрее и достигают существенно более низкой ошибки, а в трудных случаях, где базовый метод фактически проваливается, адаптивные методы восстанавливают точные решения. Для обучения операторов vRBA применяют к росту пузырьков в жидкостях, течениям в ударной трубке при высоком давлении, двумерной турбулентности и распространению волн. Здесь главный эффект — не только лучшее конечное значение ошибки, но и гораздо более медленное накопление ошибок во времени, что критично, когда выход модели многократно подается обратно как её собственный вход.

Очистка шума в сигнале обучения

Авторы связывают эти улучшения с двумя основными эффектами. Во‑первых, изменяя способ выборки или взвешивания точек обучения, vRBA уменьшает статистический шум в оценке лосса: случайные мини‑пакеты точек дают более надёжную картину того, насколько хорошо сеть работает в целом. Это прямо снижает дискретизационную ошибку — разрыв между непрерывной идеальной целью и конечным набором точек, используемых на практике. Во‑вторых, метод улучшает отношение сигнал/ шум в градиентах, которые движут обучением, так что разные области области «сходятся во мнении» относительно направления, в котором должны измениться параметры. В результате сети намного быстрее выходят из медленных, нерешительных фаз обучения и входят в режим, где ошибка быстро падает. Схема также проясняет, когда агрессивные стратегии — сильно наказывающие наибольшие невязки — могут помочь, а когда они способны дестабилизировать обучение.

Что это значит для будущего научного ИИ

Для неспециалистов суть в том, что более разумное внимание к тому, где ИИ‑решатель ошибается, может сделать его гораздо более надёжным инструментом для науки и техники. Вместо опоры на правила методом проб и ошибок эта работа предлагает математический план по направлению нейросетей к наиболее информативным частям задачи, будь то ударные фронты, тонкие осцилляции или долгосрочное поведение. По мере того как научные модели становятся масштабнее и используются в условиях критичных для безопасности, такие принципиальные стратегии уменьшения ошибки и стабилизации обучения будут необходимы, чтобы превратить мощные нейросети в надёжные научные инструменты.

Цитирование: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Ключевые слова: нейросети с физическими ограничениями, обучение операторов, адаптивная выборка, научное машинное обучение, частные дифференциальные уравнения