Clear Sky Science · ru

AI agent in healthcare: applications, evaluations, and future directions

Почему умные цифровые помощники в медицине важны

Больницы тонут в данных, врачи перегружены, а пациенты хотят более ясных ответов о своём здоровье. Новый тип искусственного интеллекта, основанный на моделях крупного языка, которые читают и пишут как люди, превращают в «агентов ИИ», способных рассуждать и выполнять многошаговые задачи. В этом обзорном материале объясняется, как такие цифровые помощники начинают помогать с диагнозом, выбором лечения, документацией, общением с пациентами и даже медицинским образованием — а также даются предупреждения о том, что нужно сделать, чтобы сохранить их точность, справедливость и безопасность.

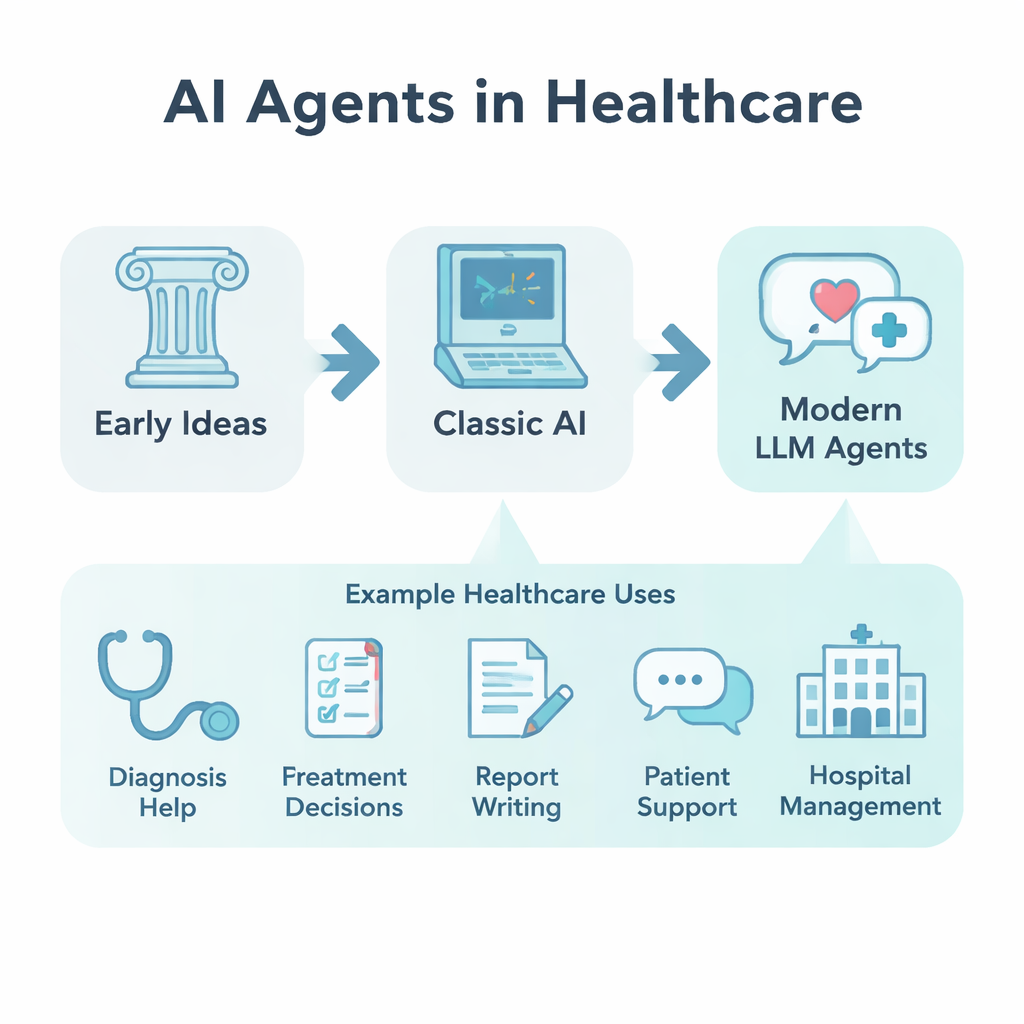

От мысленных экспериментов к практическим цифровым коллегам

Идея «агента», действующего с целями и намерениями, восходит к древней философии. Современные версии появились с ранним искусственным интеллектом, экспертными системами, а позже — с машинным обучением и глубоким обучением, которые позволили компьютерам извлекать закономерности из данных. Прорыв моделей крупного языка (LLM) после 2022 года пошёл дальше: вместо простых ответов эти модели теперь могут планировать, запоминать предыдущие шаги и вызывать другие программные инструменты. В здравоохранении это означает, что агент ИИ может читать медицинские записи, сверяться с руководствами, составлять заметки и предлагать следующие действия, ведя себя скорее как младший цифровой коллега, а не как поисковая система.

Чем эти агенты отличаются от обычного ИИ

По определению, принятому в статье, агент ИИ в здравоохранении — это не просто одна модель. В его основе лежит LLM, окружённая четырьмя ключевыми способностями: планирование, память, использование инструментов и саморефлексия. Планирование позволяет разбивать сложную медицинскую задачу на более простые шаги. Память даёт возможность отслеживать историю пациента или долгий процесс принятия решения. Использование инструментов означает, что он, например, может подтягивать результаты анализов из электронной карты или искать по медицинской базе данных. Модули саморефлексии проверяют и корректируют собственные ответы. В сочетании с сильными языковыми навыками и растущими возможностями логического рассуждения эти функции делают агентов достаточно гибкими, чтобы переключаться между задачами и медицинскими специальностями.

Как агенты ИИ тестируют в реальной медицинской работе

Исследователи сейчас создают и моделируют многие типы агентов, чтобы понять, где они наиболее полезны. Некоторые разрабатывают поддержку диагноза, разыгрывая разговоры между виртуальными врачами и пациентами или устраивая дебаты между несколькими специализированными агентами по сложному случаю. Другие сосредоточены на выборе терапии, объединяя мнения виртуальных терапевтов, специалистов и фармацевтов для выработки общего плана. Есть агенты, которые составляют радиологические отчёты по рентгенограмме грудной клетки или переводят технические заключения в понятный пациенту язык. Системы в стиле чат‑ботов испытывают для поддержки психического здоровья, коучинга по снижению веса и напоминаний о приёме лекарств. Дополнительные агенты помогают управлять рецептами, выявлять побочные эффекты препаратов, оптимизировать электронную документацию или обучать студентов-медиков с помощью реалистичных симулированных пациентов.

Как оценивать, готовы ли такие системы к работе с пациентами

Поскольку ошибки в медицине могут угрожать жизни, в обзоре утверждается, что агентам ИИ нужны проверки не только на сообразительность. Авторы группируют тесты в два уровня. Базовые проверки спрашивают: фактически ли ответы верны? Соответствует ли формулировка экспертным отчётам? Надёжно ли агент завершает задачу, в том числе вызывает ли нужные инструменты? Проверки, ориентированные на развитие, оценивают скорость, понятность и качество взаимодействия системы с людьми, включая уважение, эмпатию и справедливость по отношению к разным группам пациентов. Исследования сравнивают агентов как с ведущими языковыми моделями, так и с врачами‑людьми, а регуляторы в Европе, Великобритании, Китае и других странах начинают разрабатывать официальные «песочницы» для тестирования безопасности, равенства и клинической пользы до внедрения.

Следующие шаги: роботы, правила и доверие людей

Смотря в будущее, статья выделяет семь приоритетов: подключение агентов к физическим роботам, способным действовать в реальном мире; сочетание универсальных моделей с более мелкими экспертными моделями; расширение оценок с учётом затрат, инцидентов с безопасностью и удовлетворённости пациентов; создание более строгих мер защиты и надзора; внедрение этики и гарантий конфиденциальности; проектирование для доверия пользователей и непрерывной обратной связи; а также помощь медицинским сотрудникам в адаптации карьеры к работе с ИИ, а не к замене им. Авторы заключают, что агенты ИИ могут стать мощными партнёрами в здравоохранении, но только если их будут разрабатывать, тестировать и регулировать с той же тщательностью, которой общество требует от любой новой медицинской технологии.

Цитирование: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Ключевые слова: агенты ИИ в здравоохранении, модели крупного языка, поддержка клинических решений, медицинские чат‑боты, цифровое здравоохранение