Clear Sky Science · ru

Улучшение few-shot распознавания именованных сущностей для больших языковых моделей с помощью структурированного динамического подсказок и извлечения с расширенной генерацией

Почему важно умнее «читать» медицинские тексты

Современная медицина генерирует океаны текста — от заметок в отделениях интенсивной терапии до онлайн‑обсуждений приема препаратов. В этих словах скрыты важные подсказки о заболеваниях, лечении и побочных эффектах. Автоматическое обнаружение и маркировка таких фрагментов информации, задача, называемая «распознавание именованных сущностей», помогает исследователям отслеживать вспышки, раньше замечать проблемы с лекарствами и поддерживать врачей в реальном времени. Но традиционные системы требуют больших размеченных датасетов, которые дорого создавать и которых часто не хватает для редких или новых проблем со здоровьем. В этой работе исследуется, как большие языковые модели, похожие на те, что используются в современных чат‑ботах, можно направлять с помощью тщательно продуманных подсказок и интеллектуального поиска примеров, чтобы они эффективно выполняли маркировку даже при наличии лишь нескольких аннотированных образцов.

Обучение машин находить важные слова

Авторы сосредоточились на биомедицинском распознавании именованных сущностей — обнаружении упоминаний заболеваний, лекарств, симптомов и социальных последствий в тексте. Это сложно, потому что медицинский язык сильно специализирован, варьируется между больницами и областями и часто включает редкие состояния, которые встречаются в датасете лишь несколько раз. Существующие модели машинного обучения могут достигать уровня, близкого к человеческому, но обычно требуют больших хорошо размеченных корпусов, которые дорого создавать и трудно распространять, особенно при строгих правилах конфиденциальности. Обучение с малым числом примеров, при котором модели учатся на нескольких размеченных образцах, предлагает обход этой проблемы. Большие языковые модели особенно перспективны, поскольку они могут извлекать шаблоны напрямую из инструкций и примеров, представленных в подсказке, без дополнительного обновления внутренних весов.

Создание лучших инструкций для языковых моделей

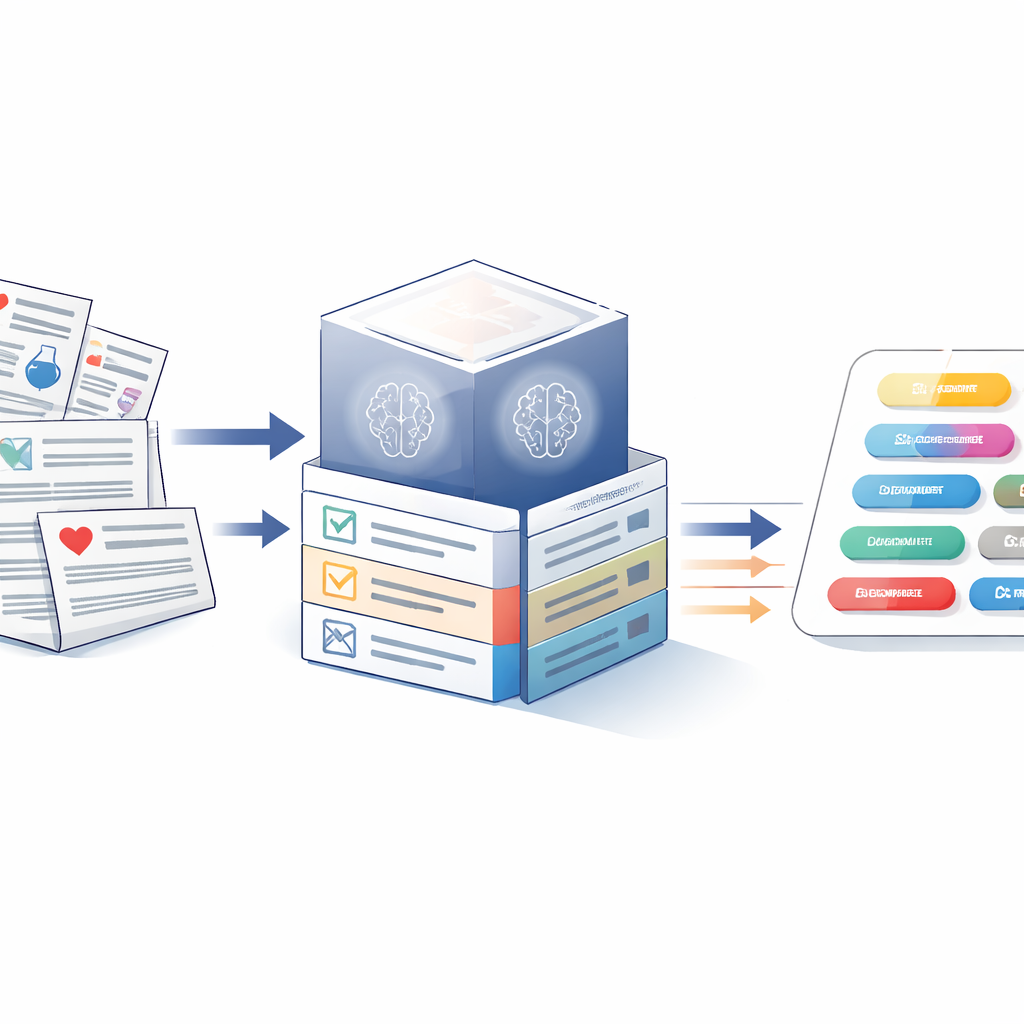

Первая часть работы разрабатывает строго структурированную «статическую» подсказку — многоразовый блок инструкций и примеров, который подается модели для каждой помечаемой строки. Вместо простого требования отметить сущности подсказка разбита на шесть элементов: четкое описание задачи и определения типов сущностей; краткое описание источника и тематики датасета; часто встречающиеся примерные слова, типичные для каждой сущности; необязательные фоновые медицинские знания; резюмированная обратная связь по предыдущим ошибкам модели; и несколько полностью размеченных примерных предложений. Команда протестировала эту схему на трех больших языковых моделях — GPT‑3.5, GPT‑4 и LLaMA 3‑70B — на пяти биомедицинских наборах данных, охватывающих клинические записи, научные аннотации и посты Reddit об употреблении опиоидов. Тщательная композиция этих компонентов повысила F1‑метрики (баланс точности и полноты) примерно на 11–12 процентных пунктов по сравнению с базовой подсказкой, причем наилучшие результаты показал GPT‑4.

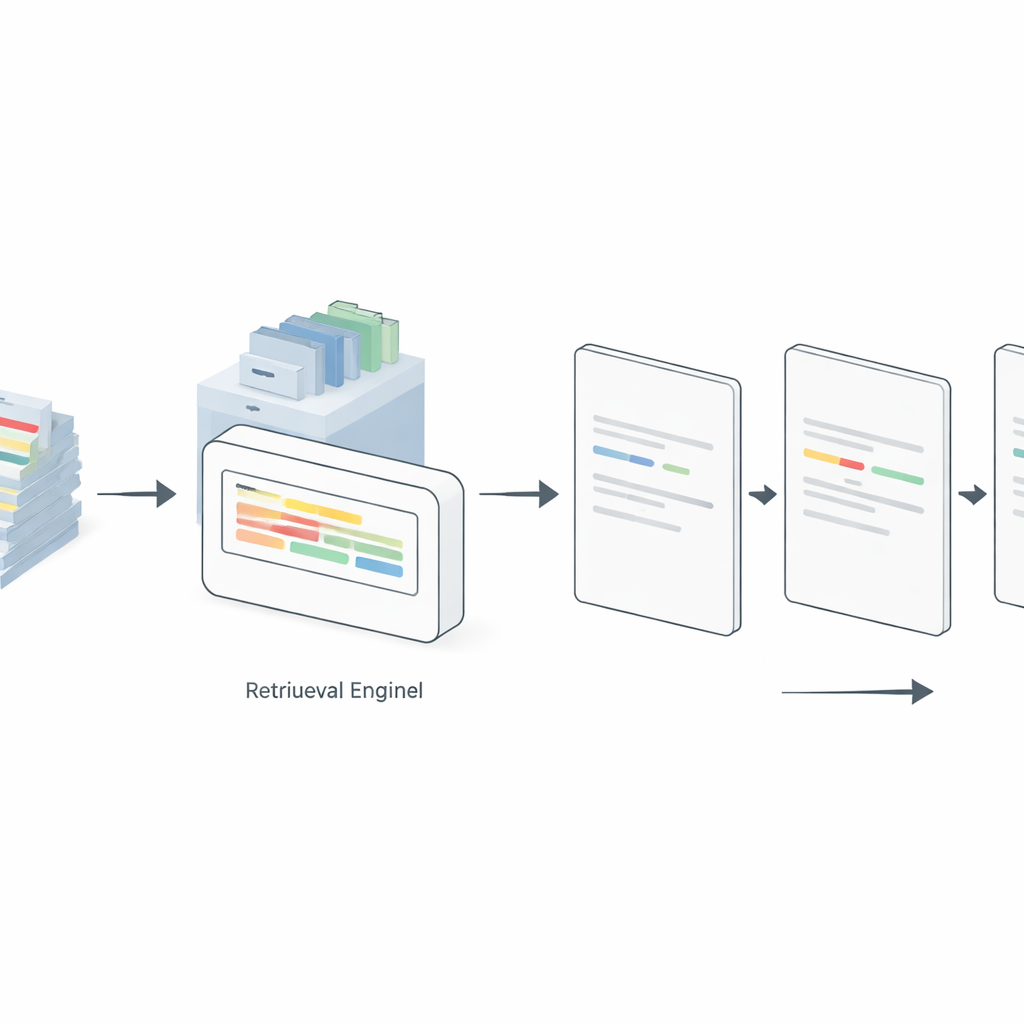

Разрешая модели подбирать более подходящие примеры на лету

Однако статические подсказки всегда показывают одни и те же примеры, даже если они плохо соответствуют новому предложению. Чтобы решить эту проблему, авторы предлагают стратегию «динамической» подсказки на основе генерации с поддержкой извлечения. Здесь отдельный механизм поиска индексирует все доступные размеченные примеры. Для каждого нового входного предложения система ищет в этом пуле наиболее похожие размеченные предложения и вставляет только их в подсказку. В исследовании сравниваются несколько методов извлечения — от простых схем на основе частоты терминов (TF–IDF) до нейронных эмбеддинговых моделей, таких как Sentence‑BERT (SBERT), ColBERT и Dense Passage Retrieval. По результатам на GPT‑4, LLaMA 3 и открытой модели с доступными весами GPT‑OSS‑120B динамический выбор релевантных примеров последовательно превосходил статические подсказки в сценариях с 5, 10 и 20 примерами. Удивительно, но простой метод TF–IDF часто не уступал и даже превосходил более сложные подходы, особенно на более чистых, стандартизованных датасетах, в то время как SBERT проявлял себя лучше на шумных текстах из социальных сетей.

Больше результата при меньшем количестве размеченных примеров

Поскольку аннотирование медицинских текстов дорогостояще, авторы также изучали, сколько размеченных примеров нужно индексировать механизму поиска, чтобы он был полезен. На примере LLaMA 3‑70B они варьировали пул извлечения от 50 примеров до всего тренировочного набора. В целом производительность улучшалась с ростом пула, но прирост быстро сглаживался: пулы примерно в 100–200 примеров давали почти ту же точность, что и индексирование всех доступных данных, часто в пределах статистической погрешности. В некоторых случаях очень большие пулы немного ухудшали результаты, вероятно, из‑за появления более нерелевантных или запутывающих примеров и удлинения подсказки. Эти результаты указывают на то, что в сочетании со сильной языковой моделью и хорошо продуманными подсказками даже умеренные усилия по аннотированию могут дать надежное биомедицинское распознавание сущностей, что делает подход жизнеспособным для редких заболеваний, новых клинических понятий или учреждений с ограниченными ресурсами.

Что это значит для реальной медицины

В целом исследование показывает, что большие языковые модели способны надежно выделять важные медицинские концепции в тексте, имея в распоряжении всего несколько размеченных примеров, при условии, что их направляют структурированные подсказки и система поиска, которая извлекает наиболее релевантные предыдущие случаи. GPT‑4 демонстрирует наилучшие общие показатели, в то время как открытые и более компактные модели также значительно выигрывают от той же схемы подсказок и извлечения. Для практикующих специалистов это означает, что не нужно создавать огромные датасеты каждый раз, когда появляется новый тип сущности или проблема со здоровьем; компактный, тщательно подобранный набор примеров в сочетании с интеллектуальными подсказками может быть достаточным. По мере цифровизации медицинских записей и того, как пациенты делятся опытом в сети, такие эффективные и адаптивные инструменты могут значительно упростить извлечение клинически полезных знаний из огромного и разнородного массива медицинских текстов.

Цитирование: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

Ключевые слова: биомедицинское распознавание именованных сущностей, обучение с малым числом примеров, большие языковые модели, генерация с поддержкой извлечения, майнинг клинических текстов