Clear Sky Science · ru

Анализ справедливости предсказаний агрессии методами машинного обучения в условиях кризисной психиатрической помощи

Почему это важно для реальных людей

Больницы обращаются к искусственному интеллекту, чтобы выявлять пациентов, которые могут стать агрессивными, с надеждой предотвратить вред без применения травмирующих ограничений. Но если такие инструменты предвзяты, они могут усугубить те самые неравенства, которые уже влияют на то, кого считают «опасным». В этом исследовании ставится насущный вопрос: когда машина помогает решать, кто в психиатрическом отделении представляет высокий риск, относится ли она ко всем пациентам одинаково?

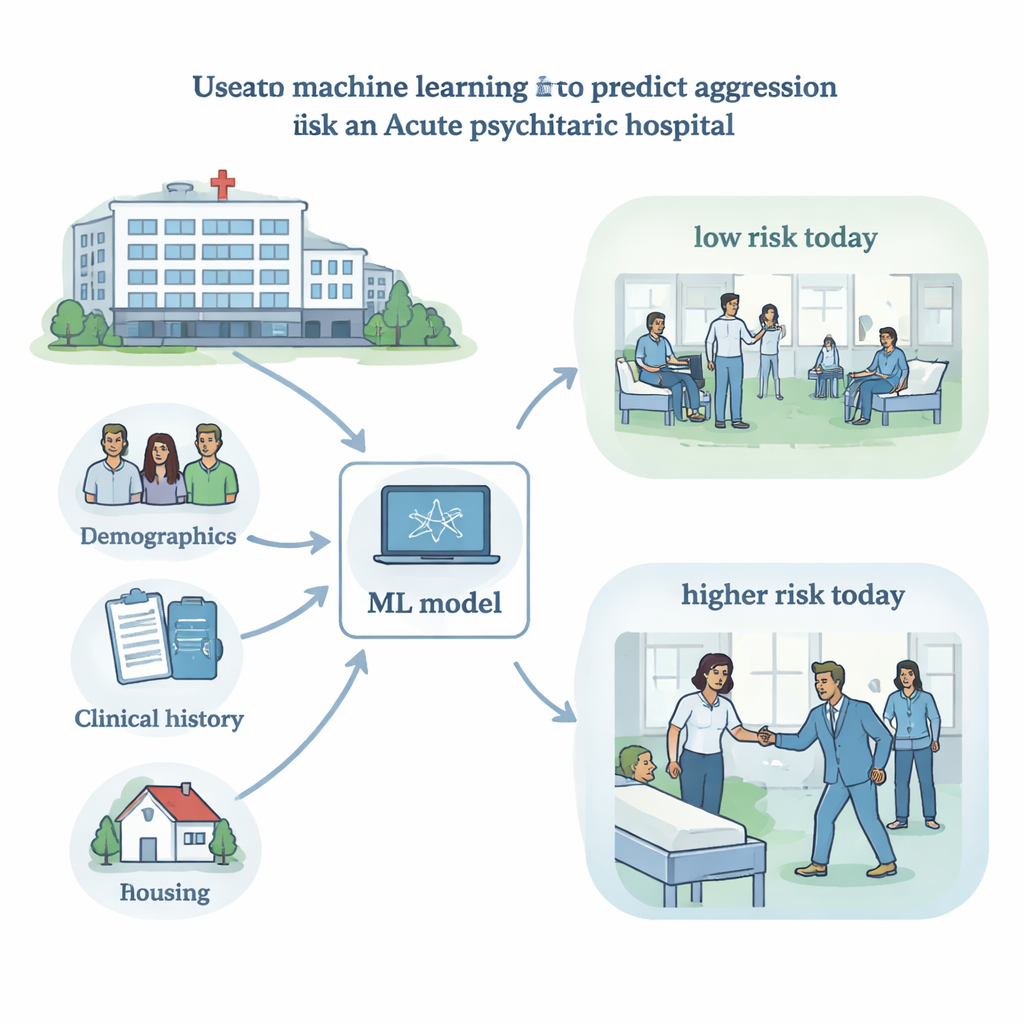

Использование больничных данных для выявления краткосрочного риска

Исследователи проанализировали записи более чем 17 000 пациентов, пролеченных в остропсихиатрических отделениях крупной канадской психиатрической больницы в период с 2016 по 2022 год. В течение каждой из до трёх дней пребывания на отделении персонал заполнял стандартизированный прикроватный чек-лист Dynamic Appraisal of Situational Aggression (DASA), оценивающий поведение, такое как раздражительность или словесные угрозы, которые могут сигнализировать о неминуемой агрессии. Команда сочетала эти оценки с информацией, собранной при поступлении — диагнозом, возрастом, полом, расой или этнической принадлежностью, жилищной ситуацией и тем, как человек попал в больницу — и обучила модель машинного обучения предсказывать, будет ли пациент вовлечён в инцидент агрессии (включая применение ограничений или изоляцию) в следующие 24 часа.

Как инструмент прогнозирования работал в целом

Лучшей по результатам оказалась система на основе широко используемого метода машинного обучения — случайного леса. На отложенной тестовой выборке она в большинстве случаев верно ранжировала дни по уровню риска, достигая площади под кривой примерно 0,81, что сопоставимо с похожими инструментами в психиатрии. Однако случаи агрессии были редки — примерно 33 дня без инцидентов приходились на каждый день с инцидентом — поэтому модель всё равно пропускала многие реальные события и давала некоторые ложные тревоги. Оценки важности признаков показали, что ключевой вклад в предсказания вносили клинические показатели текущего состояния, особенно элементы DASA, такие как раздражительность и недавние инциденты, а не только демография. Это означает, что модель улавливала клинически значимые признаки предупреждения, но одних метрик производительности недостаточно, чтобы понять, одинаково ли ей можно доверять для всех групп.

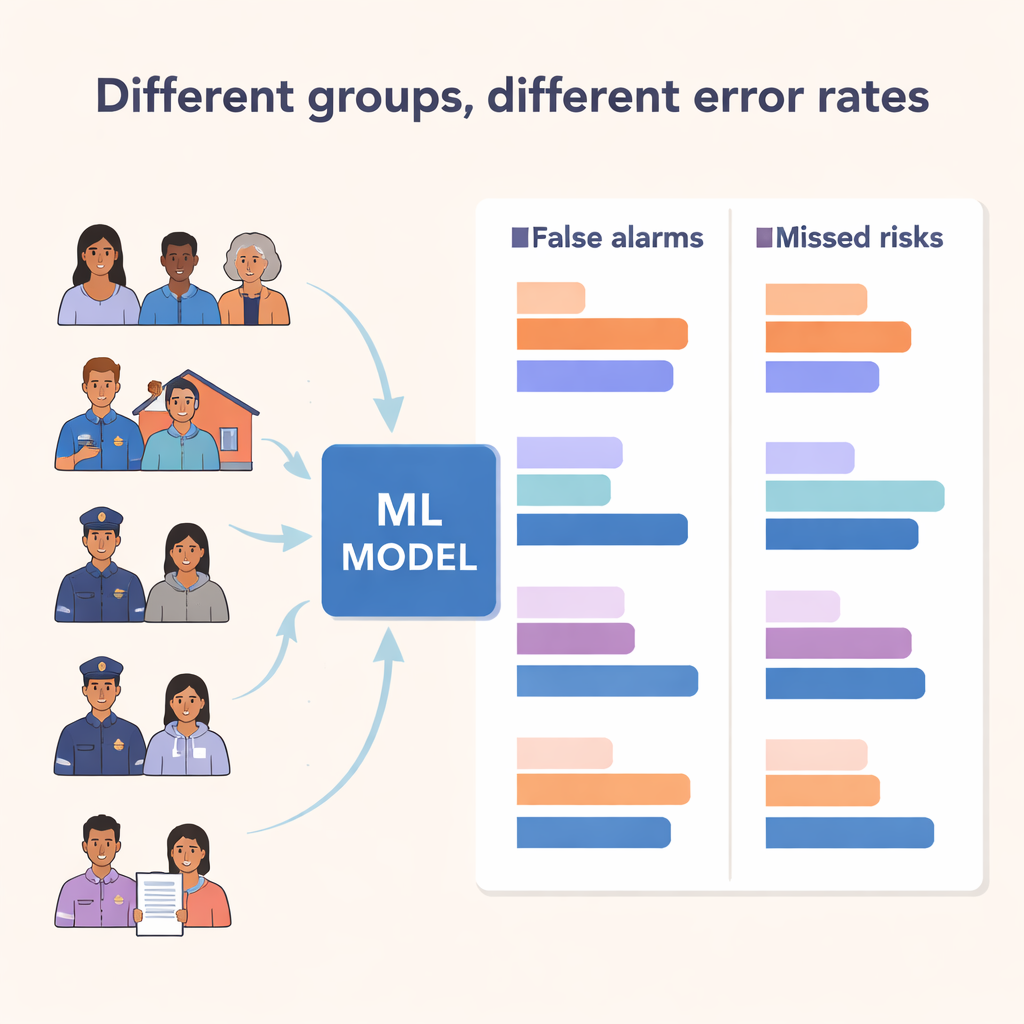

Неравные ошибки для разных групп

Сердцем исследования была проверка на справедливость. Команда сосредоточилась на двух типах ошибок: ложноположительных — когда модель помечает риск, но инцидента не происходит, и истинноположительных — когда она правильно предсказывает событие. По одному из часто используемых критериев, «уравнённые шансы» (equalized odds), справедливая модель должна иметь схожие показатели ложноположительных и истинноположительных срабатываний в разных группах. Вместо этого исследователи обнаружили значительные различия. Ложные положительные срабатывания были выше для пациентов с происхождением с Ближнего Востока и для чернокожих пациентов, мужчин, людей, доставленных в больницу полицией, а также для тех, кто был без жилья или проживал в поддерживаемом жилье. Некоторые группы — например, пациенты, доставленные полицией, или лица с нестабильным жильём — имели одновременно более высокие показатели обнаружения и больше ложных тревог, что указывает на то, что модель была настроена на повышенную чувствительность к ним. Другие, как чернокожие пациенты, столкнулись с тревожной комбинацией: больше ложных тревог и худшая способность правильно выявлять реальный риск.

Когда идентичности пересекаются, разрыв увеличивается

Поскольку опыт людей формируется более чем по одному признаку одновременно, исследователи также изучили пересекающиеся идентичности, особенно сочетание расы или этничности и пола. Здесь наиболее ярко проявился тревожный сигнал у мужчин ближневосточного происхождения: у них был самый высокий уровень ложноположительных срабатываний среди всех групп, тогда как у женщин с таким же происхождением этого не наблюдалось. Чернокожие и коренные (Indigenous) мужчины также сталкивались с повышенным уровнем ложных срабатываний по сравнению с женщинами той же группы. Эти паттерны перекликаются с хорошо задокументированными неравенствами в психиатрической помощи, такими как более частое вмешательство полиции, принудительные госпитализации и ошибки диагностики у некоторых расовых групп и у мужчин. Система машинного обучения не создала эти неравенства, но обучилась на данных, пропитанных ими, и рисковала усилить их при клиническом применении.

Что это означает для будущего ИИ в психиатрии

Авторы утверждают, что анализ справедливости должен рассматриваться как базовая проверка безопасности, а не опциональная дополнительная мера, прежде чем любой прогнозный инструмент будет внедрён в практику. Они отмечают, что технические методы «дебайасинга» — например, корректировка обучающих данных или установка разных порогов оповещений для разных групп — могут помочь, но их эффективность ограничена, если исходные записи уже отражают неравное обращение и принудительные практики. В конечном счёте выбор того, что считать «справедливой» моделью, — это не просто математическая задача; это социальный и этический вопрос, требующий вклада пациентов, клиницистов и сообществ. Это исследование показывает, что машинное обучение может помочь выявлять краткосрочный риск агрессии, но оно также может молча воспроизводить структурный расизм, сексизм и жилищное неравенство, если справедливость не измерять, не обсуждать и не устранять строго и последовательно.

Цитирование: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Ключевые слова: алгоритмическая справедливость, психиатрическая агрессия, машинное обучение в здравоохранении, неравенство в здравоохранении, модели прогнозирования риска