Clear Sky Science · ru

Определение эксплуатационной безопасности в клинических системах искусственного интеллекта

Почему безопасный ИИ в медицине важен

Больницы быстро внедряют искусственный интеллект для чтения снимков и выявления заболеваний, но есть вопрос, на который обычные показатели точности ответить не могут: когда действительно безопасно позволить машине принять решение? В этой статье предлагается практический способ определить, когда врачи могут с уверенностью полагаться на систему ИИ, когда её следует игнорировать, а когда требуется внимательное рассмотрение человеком. Цель не просто в создании более умных алгоритмов, а в интеграции их в повседневную практику так, чтобы защищать пациентов, сокращать ненужные обследования и облегчать нагрузку на клиницистов, а не увеличивать её.

От одного показателя к трём понятным зонам действий

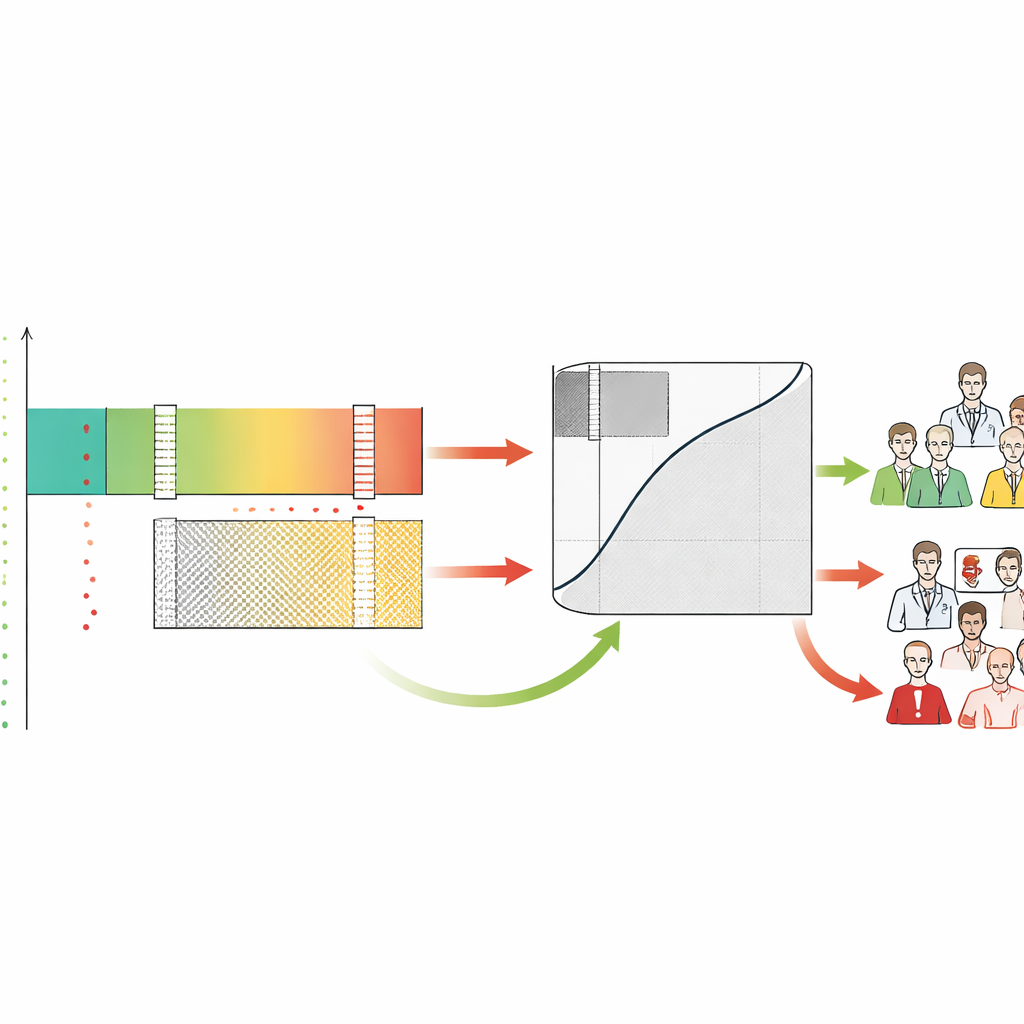

Большинство медицинских инструментов ИИ выдают один риск‑балл, например вероятность того, что маммограмма выявляет рак. Традиционно разработчики оценивают такие инструменты кривой, которая суммирует, насколько хорошо они разделяют больных и здоровых пациентов в целом. Авторы утверждают, что этого недостаточно. Они предлагают фреймворк Safety‑Aware ROC (SA‑ROC), который начинается с тех же риск‑баллов, но преобразует их в три практичные области. Зона «rule‑in» с высоким баллом включает пациентов, чьи результаты достаточно надёжны, чтобы инициировать действие, например срочное дообследование. Зона «rule‑out» с низким баллом включает пациентов, чьи результаты достаточно надёжны, чтобы безопасно снизить приоритет. Между ними находится «серая зона» неопределённости, где ИИ недостаточно надёжен и дело должен пересмотреть эксперт‑человек.

Предоставление клиницистам возможности задать планку безопасности

Ключевое преимущество SA‑ROC в том, что клиницисты и учреждения могут заранее определять собственные целевые уровни безопасности. Они выбирают, насколько уверенными хотят быть перед тем, как действовать по положительному результату (минимально допустимая вероятность того, что помеченное отклонение действительно патологично), и насколько уверенными перед тем, как ослабить контроль по отрицательному результату (минимально допустимая вероятность того, что очищенный случай действительно нормален). Исходя из этих целей, фреймворк просматривает шкалу оценок модели и находит точные границы, которые им соответствуют. Баллы выше верхней границы формируют безопасную зону rule‑in, баллы ниже нижней границы — безопасную зону rule‑out, а всё остальное становится серой зоной. Затем фреймворк количественно оценивает, сколько пациентов попадает в каждую область и какой объём неразрешённой неопределённости — случаев, возвращённых людям — оставляет ИИ.

Выявление скрытых различий между похожими системами ИИ

Авторы демонстрируют, что две системы ИИ с почти одинаковыми традиционными показателями точности могут вести себя совершенно по‑разному с точки зрения безопасности. В моделях‑симуляциях системы с одинаковой общей эффективностью давали сильно различающиеся размеры зон rule‑in, rule‑out и серой зоны в зависимости от распределения их баллов. Одна система могла превосходно подтверждать болезнь с высокой уверенностью, в то время как другая — безопасно освобождать от внимания большое количество пациентов с низким риском. В реальном примере двух инструментов для скрининга рака груди, одобренных Управлением по контролю за продуктами и лекарствами США, система с более высоким стандартным показателем точности оказалась на деле хуже для высокоуверенного скрининга. При самом строгом уровне безопасности — без пропущенных случаев рака в группе низкого риска — якобы более слабая система безопасно исключила почти вдвое больше женщин из очереди радиолога. Таким образом, SA‑ROC выявляет своего рода «реверс производительности», которое скрывают традиционные метрики.

Понимание напряжения между человеком и ИИ и рабочей нагрузки

Маркируя каждый случай как rule‑in, rule‑out или grey, фреймворк также показывает, как люди‑врачи ведут себя в этих зонах. Авторы обнаружили, что рентгенологи часто «пережижают» случаи, которые ИИ оценивал как безопасно низкорисковые, создавая множество ложных тревог в той самой области, где машина была наиболее надёжна. Напротив, и люди, и ИИ испытывали трудности в серой зоне, что подтверждает её как область, требующую экспертного внимания. SA‑ROC фиксирует размер этой серой зоны одним числом, которое отражает стоимость неопределённости. Небольшая серая зона означает больше безопасной автоматизации и меньшую нагрузку на людей; большая серая зона означает, что многие случаи по‑прежнему требуют тщательного ручного рассмотрения и что система может увеличить выгорание вместо его снижения.

Перевод правил безопасности в повседневную практику

Помимо измерения, фреймворк задуман как инструмент управления, который превращает политики в конкретное поведение ИИ. Больницы могут использовать его двумя способами. Во‑первых, они могут напрямую задать требования безопасности или пределы на число случаев, которые готовы отправлять в серую зону, и позволить фреймворку вычислить соответствующие пороги. Во‑вторых, они могут назначать значения и штрафы разным исходам — обнаружение рака, пропуск его, назначение ненужного теста или передача на человеческое рассмотрение — и позволить фреймворку искать политику, максимизирующую общую пользу. Эти стратегии можно настраивать под разные цели: массовые скрининговые программы, направления к специалистам или исследовательские когорты, используя одну и ту же базовую модель.

Что это значит для пациентов и клиницистов

Проще говоря, эта работа предлагает способ сказать не только «этот ИИ точен», но и «вот когда и как ему можно доверять в клинике». Разбивая выходы ИИ на безопасные, небезопасные и неопределённые области, связанные с явными обещаниями по безопасности, SA‑ROC помогает системам здравоохранения решать, когда машина может действовать самостоятельно, а когда человек должен оставаться полностью вовлечённым. Она подчёркивает, что традиционные показатели точности могут вводить в заблуждение и что настоящая безопасность зависит от поведения модели в крайних случаях, где ошибки наиболее дорогостоящи. При широком внедрении и валидации в больших реальных условиях этот фреймворк может поддержать более надёжную автоматизацию, сократить ненужные тревоги и обследования и превратить самые трудные случаи ИИ — «серую зону» — в целенаправленный источник обучения и улучшения как для алгоритмов, так и для медицины в целом.

Цитирование: Kim, YT., Kim, H., Bahl, M. et al. Defining operational safety in clinical artificial intelligence systems. npj Digit. Med. 9, 281 (2026). https://doi.org/10.1038/s41746-026-02450-7

Ключевые слова: клинический искусственный интеллект, эксплуатационная безопасность, медицинская визуализация, поддержка принятия решений, стратификация риска