Clear Sky Science · ru

Настраиваемые визуальные подсказки с учётом анатомии для кросс‑модального понимания рака груди

Более умная скрининговая диагностика для распространённого рака

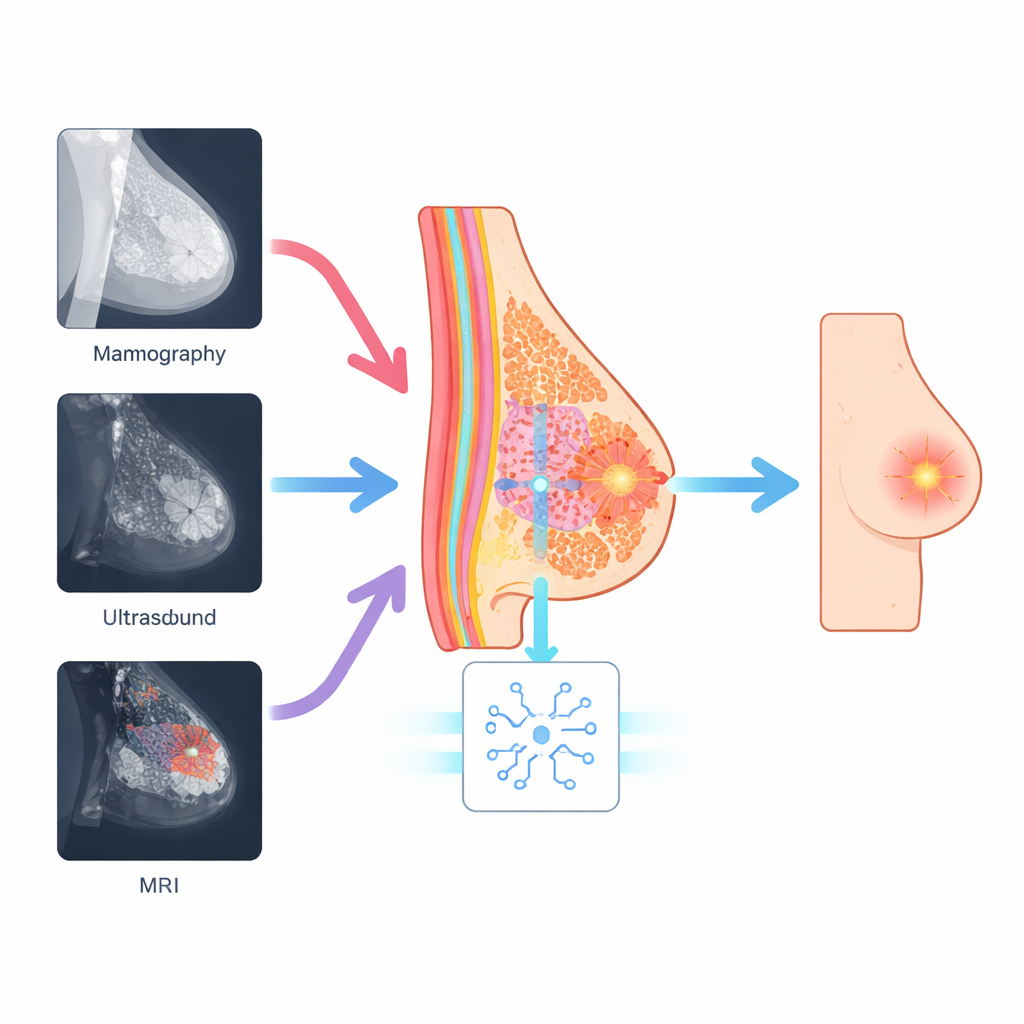

Рак молочной железы — одна из ведущих причин смерти от онкологических заболеваний у женщин, и врачи всё чаще опираются на компьютерные программы при интерпретации сложных медицинских изображений. Однако маммография, УЗИ и МРТ показывают грудь совершенно по‑разному, из‑за чего современным системам искусственного интеллекта трудно сохранять надёжность при работе с разными аппаратами и в разных клиниках. В этом исследовании предложен новый подход, при котором ИИ «учитывает» анатомию груди, а не только шаблоны яркости на изображении, что приводит к более точному и последовательному выявлению подозрительных участков.

Почему разные снимки сбивают с толку компьютеры

Маммография, ультразвук и МРТ опираются на разную физику, чтобы заглянуть внутрь груди. То, что на УЗИ выглядит как яркая точка, на маммограмме может проявляться как едва заметная тень, а на МРТ — как светящаяся область. Многие современные ИИ‑системы, включая мощные визуальные трансформеры и модели «видение–язык», в основном учатся по общему внешнему виду снимков. Они часто пропускают крошечные но важные признаки — микрокальцификаты или неровные контуры — и их качество резко падает при переносе с одного типа сканера или одной клиники в другую. Этот разрыв между условиями обучения и реальной клинической практикой ограничивает доверие врачей к таким инструментам.

Использование самой груди как ориентира

Авторы группы утверждают, что хотя изображения выглядят по‑разному, биология груди остаётся неизменной между сканами. Любой снимок содержит железистую ткань, жировую ткань и протоковые структуры, расположенные в узнаваемом порядке. Их метод, названный Anatomy‑Guided Visual Prompt Tuning (A‑VPT), внедряет эту базовую карту груди прямо в модель ИИ. Вместо перенастройки миллионов внутренних весов система добавляет небольшой набор дополнительных «подсказок», которые указывают сети, какие области ткани она рассматривает. Эти подсказки генерируются из грубых анатомических карт или изученных признаков ткани и затем вводятся слой за слоем в замороженный предварительно обученный трансформер. Фактически модель постоянно напоминают, где находятся протоки, железы и жир, чтобы она могла оценивать подозрительные участки в правильном контексте.

Обучение одной системы «разговаривать» на языках разных методов визуализации

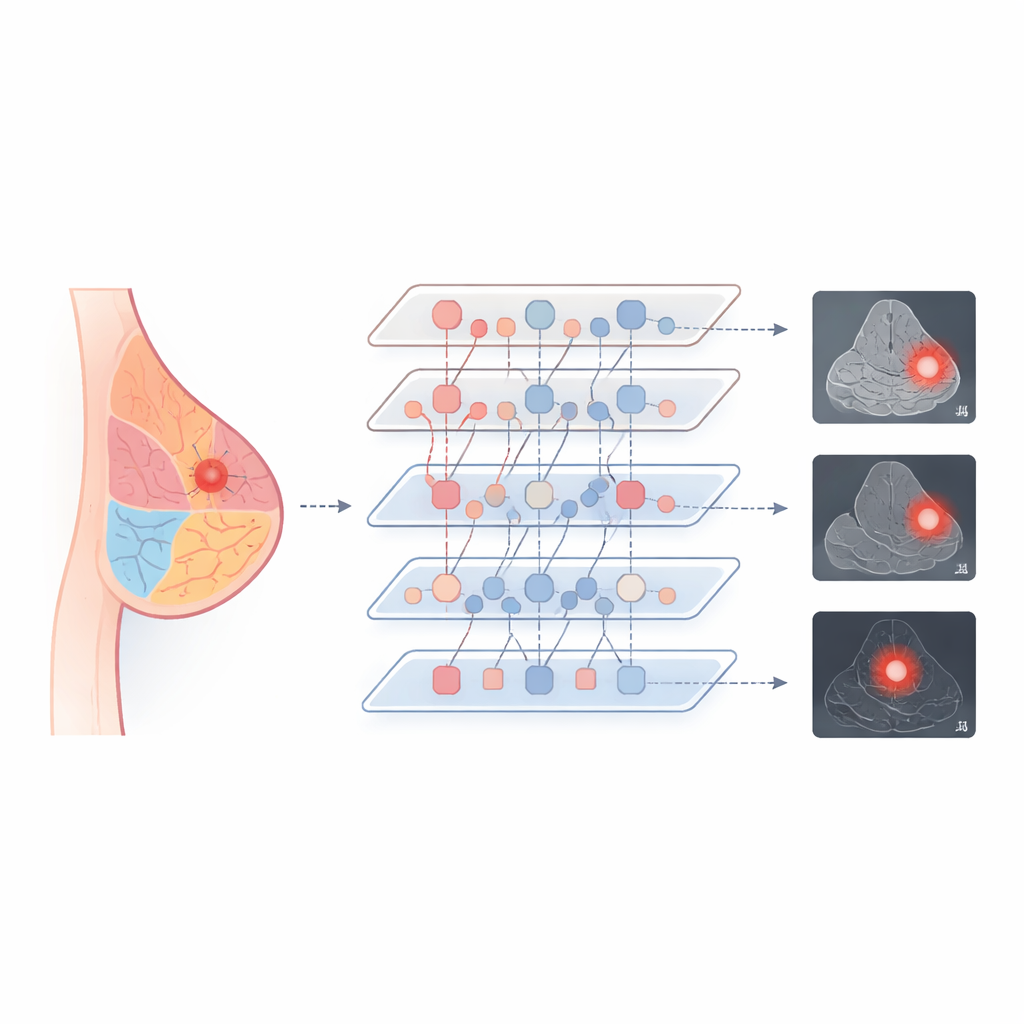

Чтобы модель работала во всех типах изображений, команда разработала схему обучения, которая заставляет ИИ одинаково обрабатывать схожие ткани независимо от способа сканирования. Они выравнивают внутренние «отпечатки» жировых, железистых и протоковых областей, извлечённые из маммографии, УЗИ и МРТ, сближая их в общем пространстве представлений. Там, где доступны текстовые заключения, система также связывает эти тканевые шаблоны с короткими описательными фразами, соотнося визуальные признаки с медицинской терминологией. В процессе обработки специализированные модули взаимодействия позволяют анатомическим подсказкам и признакам изображения обмениваться информацией в обе стороны, а шаг с «затвором» (gating) контролирует, насколько сильно анатомия влияет на каждый слой. Такое сочетание помогает модели фокусироваться на нужных структурах при сохранении устойчивости и эффективности.

Лучшая точность при меньших изменениях

Авторы протестировали A‑VPT на трёх известных коллекциях изображений молочной железы, покрывающих все три модальности. По сравнению с традиционными глубокими сетями и несколькими популярными способами дообучения крупных моделей их метод показал наивысшие результаты как в классификации поражений на доброкачественные и злокачественные, так и в выделении их границ. Особенно успешно он работал при переносе знаний между типами сканов — например, при обучении на маммограммах и последующей оценке на УЗИ — где старые методы часто терпят неудачу. Примечательно, что A‑VPT добился этих результатов, обновляя менее 2% параметров модели, что снижает требования к вычислениям и упрощает развёртывание в реальных больницах. Визуализации областей, на которые «смотрела» модель, показали, что она концентрировалась на реалистичных железистых и периоопухолевых зонах, что указывает на соответствие её решений логике радиологов.

Что это значит для пациентов и клиник

Проще говоря, работа демонстрирует, что обучение ИИ базовой анатомии делает его одновременно умнее и более понятным. Привязывая рассуждения к реальной структуре груди, A‑VPT лучше обнаруживает и очерчивает опухоли в разных методах визуализации, требуя меньше донастройки и проявляя более прозрачное поведение. При дальнейшей валидации такая стратегия может обеспечить более последовательный скрининг и диагностику в разнообразных условиях — от крупных медицинских центров до небольших клиник — и быть расширена на другие органы, например лёгкие или печень. В конечном счёте анатомически‑осведомлённый ИИ может стать ключевым партнёром в более раннем и надёжном выявлении рака.

Цитирование: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Ключевые слова: визуализация рака груди, медицинский ИИ, визуальные трансформеры, кросс‑модальное обучение, анатомически направленные подсказки