Clear Sky Science · ru

Независимая и совместная работа больших языковых моделей и медиков в диагностике и сортировке пациентов

Почему это важно перед вашим следующим визитом к врачу

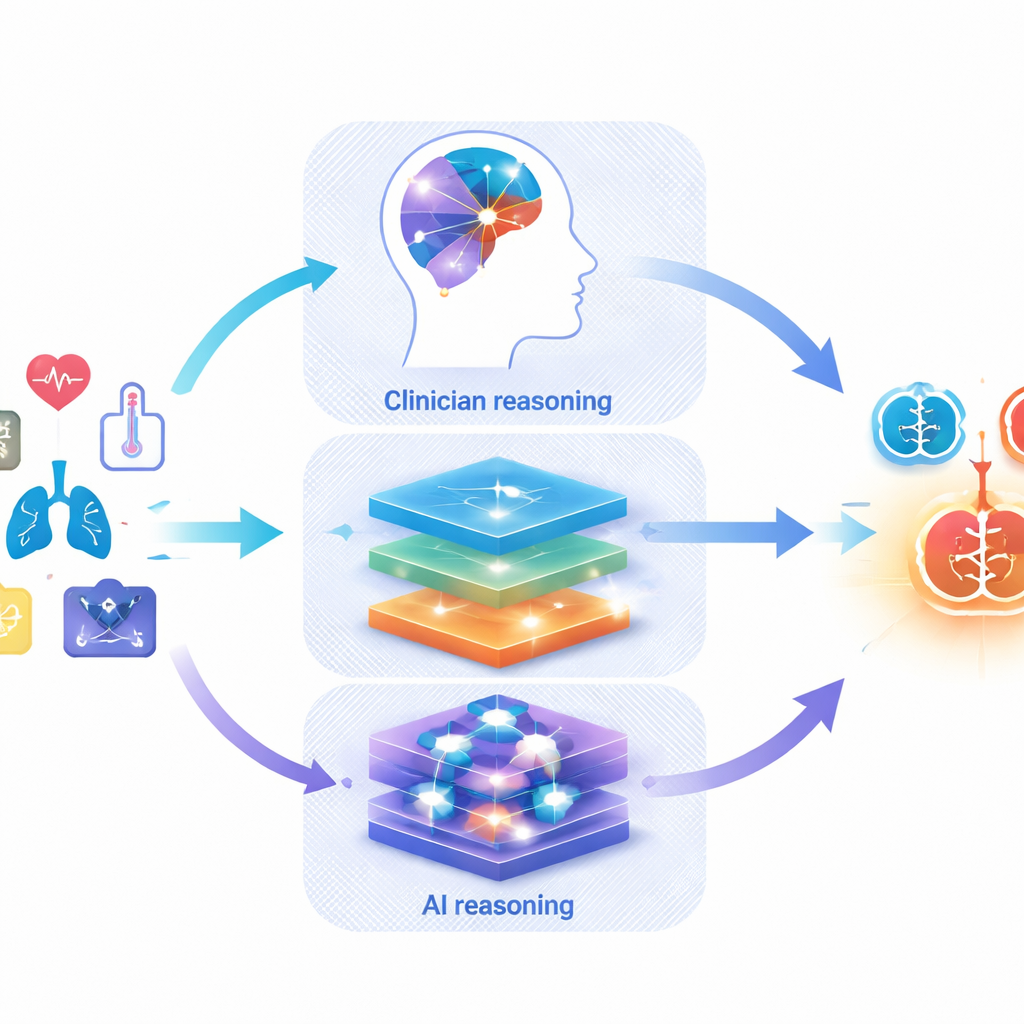

Когда вы вводите симптомы в онлайн-чат-бот или спрашиваете приложение с ИИ, что может быть не так, вы пользуетесь тем же классом технологий, который врачи сейчас испытывают в больницах: большими языковыми моделями (LLM). В этом исследовании поставлен простой, но важный вопрос: насколько хорошо эти инструменты действительно ставят диагноз и оценивают срочность случая по сравнению с реальными медицинскими специалистами — и что происходит, когда они работают вместе?

Как исследователи посмотрели на проблему в целом

Авторы не тестировали один чат-бот в одной клинике. Вместо этого они объединили данные из 50 отдельных исследований, проведённых по всему миру в период с 2020 по 2025 годы. Эти исследования охватывали множество специальностей — от заболеваний глаз и чтения снимков мозга до неотложной помощи. В каждом случае врачам и одной или нескольким LLM предъявлялись одинаковые описания реальных или тщательно сконструированных клинических случаев. Модели должны были предложить возможные диагнозы или решить, насколько срочно пациенту требуется помощь, то же делали и врачи. В некоторых исследованиях врачам также показывали предложения ИИ, чтобы оценить, помогает ли это им работать точнее.

Насколько хороши системы ИИ самостоятельно?

Во всех исследованиях инструменты ИИ часто включали правильный диагноз в свой список возможных вариантов, но обычно уступали врачам, когда требовалось выбрать только один ответ. Если учитывать только первоочередную догадку, LLM в среднем были примерно на 11% менее точны, чем медицинские специалисты. По мере увеличения длины допустимого списка вариантов этот разрыв сокращался и в конечном счёте исчезал — когда допускалось до десяти возможных диагнозов, системы ИИ как минимум так же часто, как врачи, включали правильный вариант. Для решений по триажу — оценки срочности и уровня необходимой помощи — ИИ и люди в целом выступали сопоставимо. Однако результаты сильно варьировали в зависимости от конкретных моделей и условий тестирования, что указывает на то, что некоторые инструменты гораздо более надёжны, чем другие.

Что происходит, когда врачи используют ИИ как напарника?

Девять исследований непосредственно рассматривали совместную работу: врачи сначала работали самостоятельно, потом повторяли задачу с помощью LLM. Здесь новости обнадёживают. При поддержке ИИ врачи в целом стали работать точнее, особенно когда им разрешали указывать несколько возможных диагнозов. Например, с помощью LLM их точность для коротких списков кандидатов улучшалась примерно на 10–40%, в зависимости от числа рассматриваемых вариантов. Это говорит о том, что ИИ особенно полезен как партнёр по генерации идей, расширяющий круг возможных диагнозов и подталкивающий клиницистов учитывать менее очевидные состояния, в то время как окончательное решение остаётся за человеком-экспертом.

Почему сегодняшние результаты могут выглядеть лучше, чем реальная практика

Несмотря на обещающие цифры, авторы предупреждают, что большинство существующих исследований далеки от идеала. Многие опирались на аккуратные, похожие на учебник резюме случаев или редкие примеры, выбранные для обучения, а не на запутанные, неполные истории, с которыми пациенты приходят в реальные клиники. Лишь немногие исследования использовали пациентов в реальном времени. Часто отсутствовали подробности о том, как отбирались случаи, как настраивались инструменты ИИ и как оценивались ответы. Визуальная информация, такая как снимки или фотографии кожи, использовалась реже, и когда тестировали только изображения, опытные клиницисты явно превосходили ИИ. Авторы также отмечают, что начинающие врачи и эксперты могут по‑разному реагировать на советы ИИ, а такие проблемы, как конфиденциальность данных, скрытые предубеждения и излишнее доверие к рекомендациям машин, остаются в значительной степени неразрешёнными в повседневной практике.

Что это значит для пациентов и будущего медицины

В целом исследование показывает, что нынешние чат-боты и LLM ещё не готовы заменить вашего врача, но они скоро могут стать ценными помощниками. При разумном использовании они помогут сформировать более широкий перечень возможных диагнозов и поддержат более точные решения, особенно если врачи сохраняют контроль и рассматривают ИИ как второе мнение, а не как окончательный приговор. Прежде чем эти инструменты будут внедрены в рутинную практику, авторы утверждают, что нужны лучше спроектированные исследования в реальных условиях, более прозрачные стандарты отчётности и строгие гарантии по безопасности, справедливости и приватности. Для пациентов это означает, что ИИ может со временем помочь вашей бригаде по уходу мыслить шире и действовать быстрее, но любая надёжная система должна быть проверена так же тщательно, как новый препарат или медицинский прибор.

Цитирование: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Ключевые слова: ИИ для медицинской диагностики, клиническая сортировка, большие языковые модели, сотрудничество врача и ИИ, безопасность цифрового здравоохранения