Clear Sky Science · ru

Сотрудничество человека и больших языковых моделей в клинической медицине: систематический обзор и метаанализ

Почему это важно для повседневной медицины

Врачи всё чаще обращаются к мощным чат‑ботам на основе ИИ, так называемым большим языковым моделям, чтобы помогать разбирать сложные случаи, составлять записи и интерпретировать медицинские тесты. В этом исследовании поставлен простой, но ключевой вопрос: выиграют ли от такого взаимодействия пациенты? Обобщая данные лучших доступных испытаний, авторы показывают, что ответ сложнее, чем гласит хайп: иногда сотрудничество помогает, иногда эффект минимален, а в отдельных ситуациях оно может даже мешать.

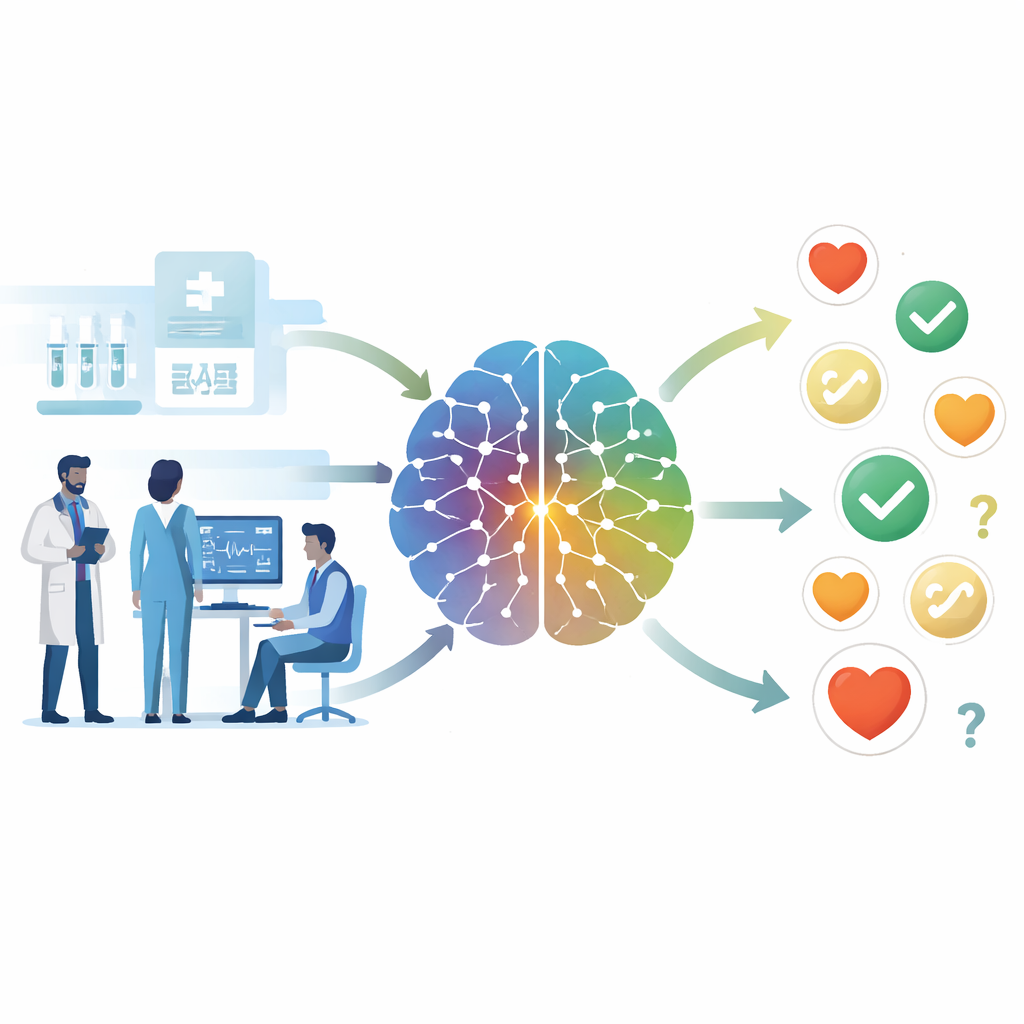

Что изучали исследователи

Команда систематически искала в крупных медицинских базах исследований, где клиницисты работали либо с помощью, либо без помощи системы ИИ на базе больших языковых моделей, таких как GPT‑4. Для включения в обзор исследование должно было напрямую сравнивать рабочий процесс «врач плюс ИИ» с обычной практикой врачей в одиночку, а иногда и с работой ИИ в автономном режиме. Клинические задачи охватывали ряд реальных проблем: установление причин состояния критически больного пациента, интерпретация снимков мозга, составление и чтение амбулаторных записей, а также принятие решений по ведению стенокардии и других частых жалоб. В сумме в анализ вошло 10 рецензируемых рандомизированных испытаний, а несколько препринтов использовали только для проверки устойчивости выводов.

Насколько хорошо работали команды врач–ИИ

В этих исследованиях сочетание врачей с ИИ давало небольшие, но заметные улучшения по ряду показателей качества диагностики и менеджмента. В двух рандомизированных испытаниях с детальными системами оценки клинических решений команды «врач плюс ИИ» набирали примерно на пять процентных пунктов больше, чем врачи в одиночку. Проще говоря: если при самостоятельной работе врачи принимали около 100 ключевых решений, добавление ИИ могло предотвратить примерно пять ошибок. Однако авторы подчёркивают, что исходные данные скудны: в эти оценки внесли вклад всего несколько испытаний, и диапазон правдоподобных реальных результатов достаточно широк, чтобы включать отсутствие выгоды или даже вред в других условиях.

Скорость, документация и скрытые ошибки

Многие надеются, что ИИ освободит время врачей. Здесь доказательная база оказалась скромной. Объединив три испытания, в которых измеряли время выполнения задач, исследователи не обнаружили существенной экономии времени в целом. В некоторых симуляциях врачи работали с ИИ немного быстрее; в одном исследовании в реальной клинике суммарный эффект на продолжительность визита был почти нулевым, хотя в отдельных подгруппах отмечались умеренные выигрыши. Ситуация с документацией была похожей и «смешанной». Помощь ИИ часто делала записи более понятными и структурированными, и помогала неспециалистам лучше разбирать технические отчёты по глазной помощи. Тем не менее при фактической проверке выяснилось, что примерно в одной из трёх заметок с поддержкой ИИ всё ещё встречались ошибки. Такое сочетание — более аккуратно выглядящие записи, которые при этом могут быть неверными — вызывает очевидные опасения по части безопасности.

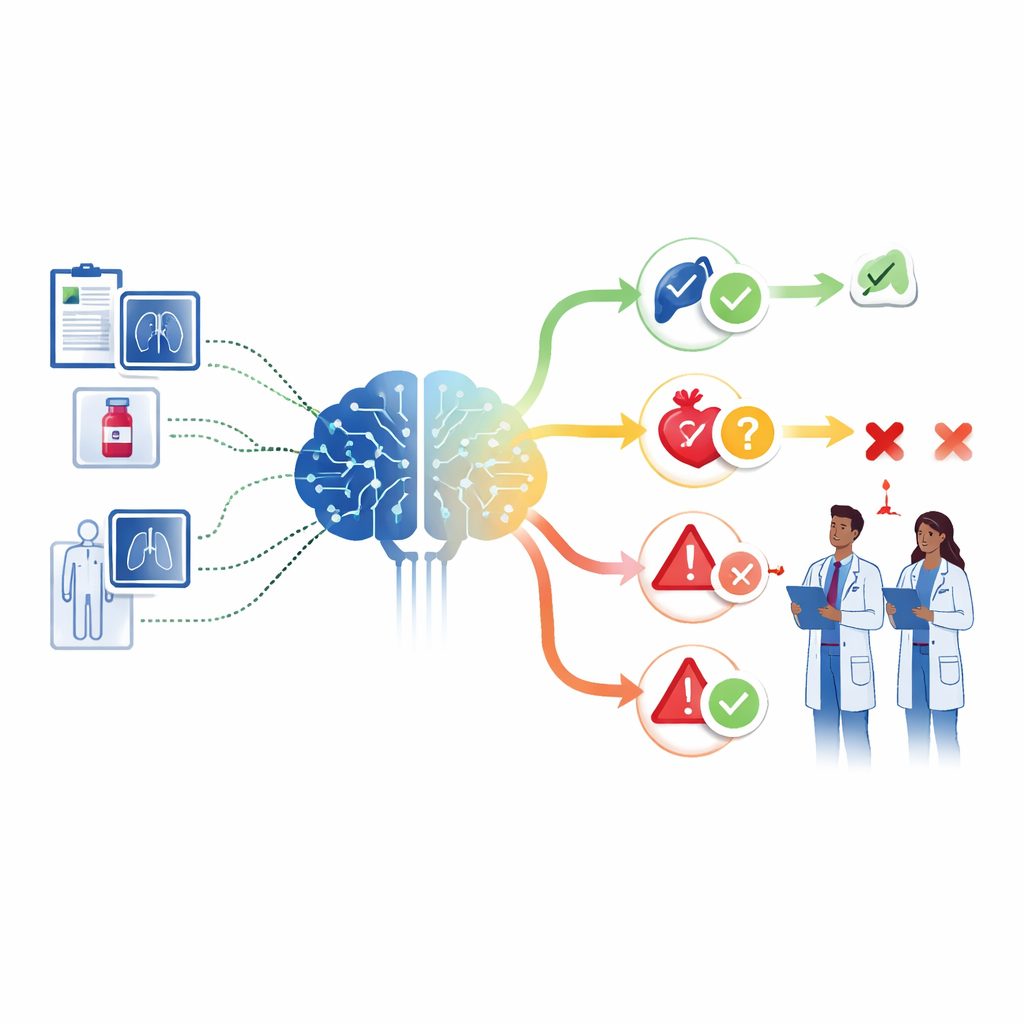

Когда сотрудничество не превосходит машину

Яркое наблюдение получили из испытаний, в которых также оценивали ИИ в автономном режиме. В одном исследовании среди критически больных пациентов ИИ в одиночку работал примерно так же, как команда «врач плюс ИИ», и лучше многих врачей, работавших в одиночку. В другом случае автоматически сгенерированные тестовые отчёты ИИ были явно хуже тех, которые создавали человеческие эксперты, независимо от того, использовали ли ИИ в качестве ассистента. В совокупности эти результаты выявляют то, что авторы называют «парадоксом сотрудничества»: простое введение человека в цепочку не гарантирует улучшения по сравнению с сильным ИИ, а в некоторых ситуациях партнёрство может размывать сильные стороны каждого. На то, помогает ли сотрудничество или мешает, влияют такие факторы, как способ представления советов, степень доверия или недоверия врачей к ним и то, как инструмент встроен в повседневный рабочий поток.

Что это значит для будущего команд врач–ИИ

В целом обзор рисует картину осторожной надежды, а не уже свершившейся революции. Команды «врач–ИИ» могут умеренно улучшать определённые баллы при принятии решений и делать медицинские тексты более удобными для чтения, но они не дают надёжной экономии времени и всё ещё генерируют тревожное количество фактических ошибок. Авторы утверждают, что медицинские системы должны внедрять такие инструменты постепенно, с жёсткими мерами безопасности, ориентированными на обнаружение ошибок, а не только на повышение эффективности. Они также призывают к более масштабным клиническим испытаниям в реальных условиях — в оживлённых больницах и клиниках, а не только в контролируемых симуляциях. До появления таких данных самый безопасный подход — рассматривать большие языковые модели как мощных, но ошибочных помощников и проектировать рабочие процессы так, чтобы клиницисты выступали критическими рецензентами и хранителями разрешений, а не пассивными получателями советов ИИ.

Цитирование: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Ключевые слова: сотрудничество человека и ИИ, система поддержки клинических решений, большие языковые модели, точность диагностики, медицинская документация